PySpark là gì? Đặc điểm và các tính năng chính của PySpark

Đã kiểm duyệt nội dung

Đánh giá

PySpark là API Python của Apache Spark, cho phép bạn xử lý và phân tích dữ liệu lớn trên cụm máy chủ nhưng vẫn sử dụng cú pháp Python quen thuộc, kết hợp được cả sức mạnh phân tán và sự linh hoạt của hệ sinh thái Python. Bài viết này được đúc kết từ kinh nghiệm xử lý hàng Terabyte dữ liệu log hệ thống và xây dựng các Data Pipeline phức tạp cho doanh nghiệp, giúp bạn hiểu rõ từ khái niệm nền tảng, kiến trúc hệ thống và cách ứng dụng PySpark tối ưu nhất trong các dự án Big Data thực tế.

Những điểm chính

- Quan điểm của mình: Nếu bạn đã thành thạo hệ sinh thái Python và đang muốn bước chân vào mảng Big Data thì PySpark là công cụ bắt buộc phải học. PySpark sẽ giúp bạn xé bỏ giới hạn tài nguyên của một máy tính đơn lẻ để xử lý dữ liệu ở quy mô cụm máy chủ.

- Khái niệm PySpark: Hiểu rõ PySpark là giao diện lập trình bằng Python dành cho Apache Spark, giúp bạn xử lý và phân tích dữ liệu lớn theo kiểu phân tán trên cụm máy chủ.

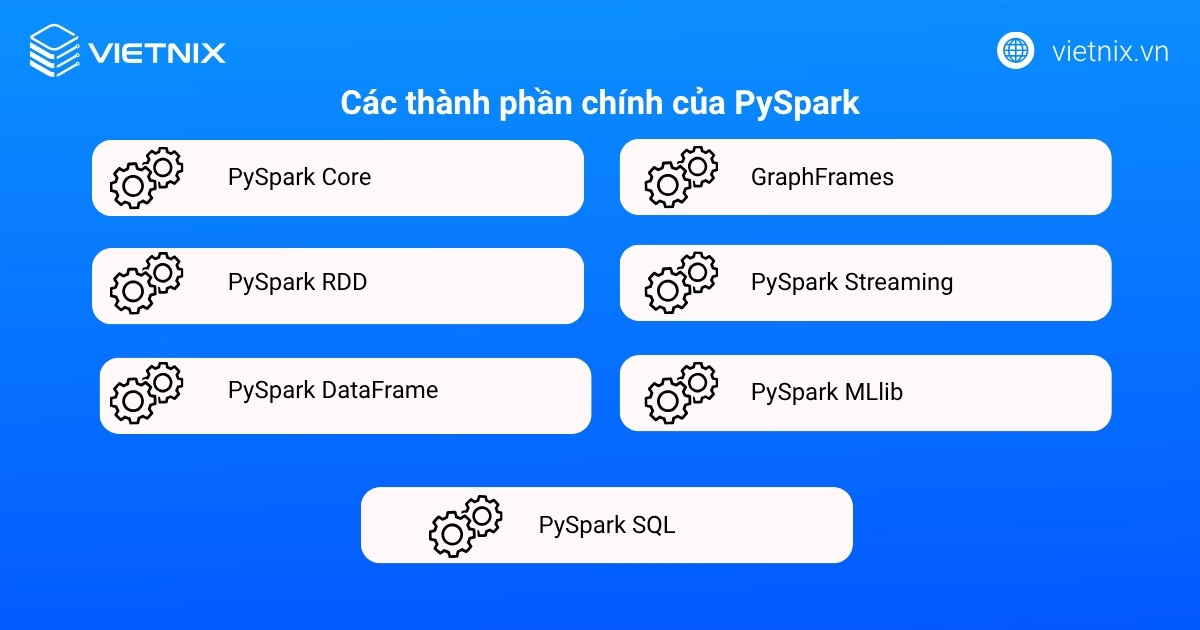

- Các thành phần chính: Nắm được các thành phần cốt lõi của PySpark như Core, RDD, DataFrame, SQL, MLlib, Streaming, GraphFrames.

- Các tính năng nổi bật: Nắm được các tính năng ưu việt như API Python quen thuộc, hỗ trợ đa dạng định dạng dữ liệu, xử lý dữ liệu trong bộ nhớ và khả năng chịu lỗi cao.

- Lý do sử dụng: Biết được các lý do chính khiến PySpark trở thành tiêu chuẩn trong ngành dữ liệu, giúp bạn đánh giá giá trị và tiềm năng.

- Vai trò trong hệ sinh thái Python: Phân biệt PySpark với Pandas, Dask và Apache Flink, giúp bạn lựa chọn công cụ phù hợp với bối cảnh và quy mô xử lý dữ liệu.

- Ứng dụng thực tiễn: Biết được các ứng dụng điển hình trong ngành Tài chính, Thương mại điện tử, Viễn thông và Y tế, giúp bạn hình dung cách PySpark được triển khai trong thực tế.

- Cách cài đặt và sử dụng cho người mới: Nắm vững quy trình cài đặt PySpark, khởi tạo SparkSession và thao tác đọc/xử lý dữ liệu cơ bản, giúp bạn bắt đầu làm chủ PySpark một cách bài bản.

- Biết thêm Vietnix: Tìm hiểu về VPS Vietnix, giúp có thêm lựa chọn nền tảng tối ưu để triển khai dự án PySpark chuyên nghiệp.

- Câu hỏi thường gặp: Được giải đáp các thắc mắc về cách tải/cài đặt, sự khác biệt với Pandas và việc sử dụng PySpark có yêu cầu trả phí bản quyền không, giúp củng cố kiến thức và làm rõ các vấn đề thực tế.

PySpark là gì?

PySpark là một giao diện lập trình bằng Python dành cho Apache Spark, cho phép xử lý và phân tích dữ liệu lớn theo kiểu phân tán trên cụm máy chủ theo thời gian thực. API này được thiết kế để tận dụng sức mạnh tính toán song song vượt trội của Spark và cú pháp dễ sử dụng của ngôn ngữ Python. Nhờ đó, các kỹ sư dữ liệu có thể dễ dàng xây dựng pipeline ETL, phát triển mô hình Machine Learning và phân tích các luồng dữ liệu phức tạp mà không bị giới hạn bởi dung lượng bộ nhớ của một máy tính đơn lẻ.

Để chạy PySpark hiệu quả, đặc biệt là các project xử lý dữ liệu lớn, việc sở hữu hạ tầng mạnh mẽ là vô cùng cần thiết. Dịch vụ VPS NVMe tại Vietnix được trang bị ổ cứng NVMe tốc độ cao giúp tối ưu hóa thời gian đọc/ghi dữ liệu (I/O), đảm bảo hiệu suất tối đa cho các ứng dụng xử lý dữ liệu phân tán. Với cấu hình linh hoạt, an toàn và hỗ trợ kỹ thuật 24/7, Vietnix VPS NVMe là giải pháp lý tưởng giúp bạn triển khai Spark tối ưu chi phí.

Website nhanh hơn – Bán được nhiều hàng hơn

- Chiếm lĩnh TOP Google, hút traffic.

- Mua sắm mượt mà, tăng tỷ lệ chốt đơn.

- Chuyên gia kỹ thuật đồng hành 24/7.

Các thành phần chính của PySpark

PySpark sở hữu một hệ sinh thái mạnh mẽ với nhiều module chuyên biệt để xử lý từng định dạng dữ liệu khác nhau. Dưới đây là các thành phần cốt lõi cấu tạo nên PySpark:

- PySpark Core: Đây là nền tảng cơ bản nhất, chịu trách nhiệm quản lý việc lập lịch tác vụ, phân phối dữ liệu và phục hồi lỗi trên các nút trong cụm máy tính.

- PySpark RDD: RDD (Resilient Distributed Datasets) là cấu trúc dữ liệu nền tảng cấp thấp nhất của Spark. Thành phần này lưu trữ dữ liệu dưới dạng các bản ghi phân tán trên nhiều máy chủ vật lý, đồng thời có khả năng phục hồi tự động khi một node mạng gặp sự cố.

- PySpark DataFrame: DataFrame là cấu trúc dữ liệu dạng bảng được tối ưu hóa, hoạt động tương tự như một bảng trong cơ sở dữ liệu quan hệ SQL hoặc thư viện Pandas. Thành phần này giúp người dùng truy vấn dữ liệu dễ dàng và mang lại hiệu suất thực thi cao hơn nhiều so với RDD.

- PySpark SQL: Module này hỗ trợ người dùng thực thi trực tiếp các câu lệnh SQL truyền thống trên nền tảng Spark. Bạn có thể dễ dàng kết nối PySpark SQL với nhiều nguồn dữ liệu đa dạng như Hive, Parquet, Avro, JSON và JDBC.

- PySpark MLlib: Đây là thư viện Machine Learning phân tán độc quyền của PySpark. MLlib cung cấp các thuật toán học máy phổ biến như phân loại, hồi quy và phân cụm với khả năng tính toán trên tập dữ liệu hàng terabyte.

- PySpark Streaming: Module này chuyên dùng để xử lý luồng dữ liệu thời gian thực. PySpark Streaming thu thập dữ liệu liên tục từ các nguồn như Kafka hay Flume, sau đó chia nhỏ thành các batch để xử lý tuần tự.

- GraphFrames: Thành phần chuyên dụng để phân tích dữ liệu dạng đồ thị, giúp mô hình hóa và tìm kiếm mối quan hệ phức tạp giữa các thực thể dữ liệu.

Các tính năng nổi bật của PySpark

Trong bối cảnh ứng dụng vào các bài toán big data và machine learning, PySpark mang lại nhiều lợi ích thực tế cho lập trình viên và doanh nghiệp:

- API Python quen thuộc: Cung cấp giao diện lập trình bằng Python, giúp những người đã quen với hệ sinh thái Python (data analyst, data scientist) tiếp cận và thao tác với Spark mà không cần học thêm ngôn ngữ mới.

- Hỗ trợ đa dạng định dạng dữ liệu: Làm việc tốt với nhiều nguồn và kiểu dữ liệu khác nhau như CSV, JSON, Parquet, cơ sở dữ liệu quan hệ, NoSQL,… bao phủ cả dữ liệu có cấu trúc, bán cấu trúc và không có cấu trúc.

- Tích hợp hệ sinh thái Python: Dễ dàng kết hợp với các thư viện phân tích và machine learning phổ biến như NumPy, pandas, scikit‑learn để xây dựng pipeline từ tiền xử lý, phân tích đến huấn luyện mô hình.

- Khả năng mở rộng trên cụm: Cho phép phân tán khối lượng tính toán trên một cụm nhiều máy, nhờ đó tăng khả năng mở rộng, tận dụng tài nguyên phần cứng và xử lý được tập dữ liệu lớn hơn nhiều so với chạy Python đơn lẻ trên một máy.

- Xử lý dữ liệu trong bộ nhớ: Khác với cơ chế ghi dữ liệu liên tục xuống ổ cứng của Hadoop MapReduce, PySpark thực hiện các phép tính trực tiếp trên bộ nhớ RAM. Cách tiếp cận này giúp tốc độ xử lý dữ liệu được đẩy nhanh gấp 100 lần.

- Đánh giá lười: PySpark không thực thi mã lệnh ngay khi bạn khai báo các hàm biến đổi. Thay vào đó, hệ thống sẽ ghi nhớ toàn bộ quy trình và chỉ tiến hành tính toán thực sự khi nhận được lệnh kích hoạt, giúp cụm máy chủ tối ưu hóa kế hoạch thực thi và tiết kiệm tài nguyên.

- Khả năng chịu lỗi cao: Khi một máy chủ trong cụm bị tắt đột ngột, PySpark sẽ tự động phục hồi lại phần dữ liệu bị mất thông qua hệ thống sơ đồ RDD DAG (Directed Acyclic Graph). Do đó, tiến trình phân tích dữ liệu của bạn sẽ không bao giờ bị gián đoạn.

Tại sao nên sử dụng PySpark?

Việc ứng dụng PySpark mang lại nhiều lợi ích thiết thực cho các dự án Big Data quy mô lớn. Dưới đây là những lý do chính khiến PySpark trở thành tiêu chuẩn trong ngành dữ liệu:

- Cú pháp viết code đơn giản: Ngôn ngữ Python vốn nổi tiếng về sự trực quan và dễ hiểu. Khi kết hợp với Spark, các lập trình viên có thể xây dựng các hệ thống dữ liệu phức tạp bằng số lượng dòng code ít hơn hẳn so với việc dùng Scala hay Java.

- Hỗ trợ xử lý đa dạng định dạng: PySpark có khả năng đọc, ghi và chuyển đổi nhiều loại cấu trúc dữ liệu khác nhau, từ dữ liệu có cấu trúc (bảng SQL), dữ liệu bán cấu trúc (JSON, XML) cho đến dữ liệu phi cấu trúc (văn bản thuần, log hệ thống).

- Tích hợp hệ sinh thái đa dạng: Việc sử dụng PySpark cho phép bạn kết hợp mượt mà với các thư viện nổi tiếng khác của Python như NumPy, TensorFlow hoặc Scikit-Learn để trực quan hóa dữ liệu và huấn luyện mô hình AI.

- Cộng đồng hỗ trợ lớn mạnh: Vì Python là ngôn ngữ phổ biến nhất trong ngành khoa học dữ liệu, cộng đồng sử dụng PySpark cực kỳ đông đảo. Đặc điểm này giúp người lập trình dễ dàng tìm kiếm tài liệu hướng dẫn và khắc phục lỗi thông qua các diễn đàn công nghệ.

- Rào cản gia nhập thấp: Lập trình viên Python có thể làm quen với PySpark rất nhanh mà không cần học các ngôn ngữ phức tạp như Scala hay Java.

Vai trò của PySpark trong hệ sinh thái Python

Trong Python, có nhiều công cụ hỗ trợ xử lý dữ liệu khối lượng lớn, nhưng mỗi công cụ lại phù hợp với một bối cảnh và quy mô khác nhau, PySpark nổi bật ở mảng xử lý phân tán và big data. Bảng dưới đây tóm lược một số đặc trưng chính giữa các công cụ phổ biến:

| Tiêu chí | PySpark | Pandas | Dask | Apache Flink |

|---|---|---|---|---|

| Phù hợp với big data | Có, thiết kế cho tập dữ liệu rất lớn chạy phân tán trên cụm máy. | Không, chủ yếu cho dữ liệu nhỏ đến vừa trên 1 máy. | Không tối ưu cho cực lớn như Spark/Flink, phù hợp dữ liệu lớn vừa. | Có, mạnh về xử lý dữ liệu quy mô lớn, phân tán. |

| Khả năng mở rộng | Có, scale ngang bằng cách tăng số node trong cluster. | Không, bị giới hạn bởi RAM và CPU của một máy. | Có, mở rộng phân tán, nhưng thiên về linh hoạt hơn là cực lớn. | Có, hỗ trợ scale lớn, cả batch lẫn streaming. |

| Độ phức tạp sử dụng | Cao, bạn cần hiểu kiến trúc Spark và mô hình phân tán. | Thấp, API trực quan, dễ học với người dùng Python. | Thấp đến trung bình, cú pháp gần Pandas, kiến trúc đơn giản hơn. | Cao, mô hình lập trình và khái niệm khá phức tạp. |

| Độ dễ sử dụng | Trung bình, thân thiện hơn Scala nhưng vẫn có độ dốc học tập. | Cao, tài liệu phong phú, cộng đồng lớn. | Cao, API quen thuộc, dễ thử nghiệm và mở rộng dần. | Trung bình – mạnh nhưng cần nhiều kinh nghiệm. |

| Yêu cầu tài nguyên hệ thống | Cao, bạn thường cần cụm máy hoặc hạ tầng mạnh. | Thấp, bạn chỉ cần máy cá nhân có đủ RAM. | Thấp đến trung bình, bạn có thể chạy từ máy cá nhân đến cụm nhỏ. | Cao, bạn thường dùng trong môi trường cluster chuyên dụng. |

Lựa chọn của chuyên gia: Mặc dù Pandas rất tuyệt vời cho việc nghiên cứu dữ liệu nhỏ, nhưng nếu dự án của bạn vượt quá 10GB dữ liệu hoặc cần mở rộng trong tương lai, mình khuyên bạn nên sử dụng PySpark ngay từ đầu. Dask là một giải pháp thay thế tốt nếu bạn chỉ muốn mở rộng nhẹ nhàng, còn Apache Flink sẽ là lựa chọn số 1 nếu hệ thống của bạn yêu cầu xử lý streaming theo thời gian thực.

Ứng dụng thực tiễn của PySpark

PySpark đang được triển khai sâu rộng trong nhiều lĩnh vực công nghiệp để giải quyết các bài toán dữ liệu phức tạp. Dưới đây là một số ứng dụng tiêu biểu trong thực tế:

- Ngành Tài chính – Ngân hàng: Các tổ chức tài chính sử dụng PySpark để xây dựng hệ thống phát hiện gian lận thẻ tín dụng theo thời gian thực nhờ khả năng quét hàng triệu giao dịch mỗi giây.

- Ngành Thương mại điện tử: Các nền tảng mua sắm trực tuyến ứng dụng thư viện PySpark MLlib để tạo ra hệ thống gợi ý sản phẩm cá nhân hóa, dựa trên việc phân tích lịch sử duyệt web và thói quen mua hàng của người tiêu dùng.

- Ngành Viễn thông: Các nhà mạng lớn sử dụng module PySpark Streaming để phân tích tệp dữ liệu Log khổng lồ, từ đó dự đoán trước các sự cố rớt mạng và tiến hành bảo trì hạ tầng trạm phát sóng kịp thời.

- Ngành Y tế: Các trung tâm nghiên cứu y khoa sử dụng PySpark để xử lý hàng triệu hồ sơ bệnh án điện tử và giải mã cấu trúc bộ gen, qua đó hỗ trợ các bác sĩ chẩn đoán bệnh lý chính xác hơn.

Cách cài đặt và sử dụng PySpark cho người mới

Cài đặt PySpark

Để bắt đầu, bạn cần đảm bảo máy tính đã cài đặt Java (JRE/JDK 8 hoặc 11) vì Spark chạy trên nền tảng JVM. Sau đó, bạn chỉ cần mở terminal hoặc command prompt và thực hiện lệnh cài đặt sau:

pip install pysparkLệnh này sẽ tải xuống các tệp tin cần thiết của Spark và cấu hình môi trường Python để bạn có thể gọi thư viện này trực tiếp từ bất kỳ trình soạn thảo nào như VS Code hay Jupyter Notebook.

Lỗi thường gặp: Theo kinh nghiệm hỗ trợ của mình, 80% người mới gặp lỗi “Java gateway process exited before sending its port number” ở bước này. Nguyên nhân là do bạn chưa cấu hình đúng biến môi trường JAVA_HOME. Hãy chắc chắn bạn đã trỏ đường dẫn biến môi trường đến thư mục cài đặt JDK của mình.

Khởi tạo SparkSession để làm việc

Mọi ứng dụng PySpark đều bắt đầu bằng việc khởi tạo một đối tượng gọi là SparkSession. Đây là điểm đầu vào duy nhất cho phép bạn tạo DataFrame, đăng ký các bảng tạm thời và thực thi các câu lệnh SQL. Việc thiết lập appName giúp bạn dễ dàng định danh ứng dụng của mình trên giao diện quản lý (Web UI) của Spark khi ứng dụng đang chạy trong môi trường thực tế hoặc trên các cụm máy tính tập trung.

Để tạo một SparkSession hoàn chỉnh, bạn cần nạp thư viện và cấu hình phương thức builder như ví dụ dưới đây:

from pyspark.sql import SparkSession

# Tạo session

spark = SparkSession.builder \

.appName("MyFirstPySparkApp") \

.getOrCreate()

print("Khởi tạo cụm Spark thành công!")Thao tác đọc và xử lý dữ liệu cơ bản

Sau khi có session, bạn có thể thực hiện đọc các định dạng file phổ biến như CSV, JSON hay Parquet vào một DataFrame. Cú pháp của PySpark rất tương đồng với Pandas nhưng hoạt động trên cơ chế phân tán. Bạn có thể sử dụng các hàm như .select(), .filter(), và .groupBy() để biến đổi dữ liệu. Cuối cùng, hãy luôn nhớ gọi lệnh .show() để hiển thị kết quả hoặc .stop() để giải phóng tài nguyên hệ thống sau khi hoàn thành.

Một số lệnh cơ bản như sau:

# Đọc file CSV

df = spark.read.csv("data.csv", header=True, inferSchema=True)

# Hiển thị 5 dòng đầu tiên

df.show(5)

# Lọc và tính toán

df.filter(df.age > 20).groupBy("gender").count().show()

# Đóng session

spark.stop()Mẹo từ chuyên gia: Khi bạn cần tái sử dụng một DataFrame nhiều lần (ví dụ: dùng bảng df để tính toán cho nhiều biểu đồ khác nhau), hãy sử dụng lệnh df.cache(). Việc này sẽ lưu bảng dữ liệu đó vào RAM, giúp các thao tác truy vấn sau đó nhanh hơn gấp hàng chục lần so với việc phải đọc lại từ ổ cứng.

Triển khai dự án PySpark chuyên nghiệp với dịch vụ VPS Vietnix

Khi triển khai các dự án PySpark chuyên nghiệp, việc thuê máy chủ ảo là giải pháp tối ưu để sở hữu tài nguyên độc lập. Dịch vụ thuê VPS tại Vietnix cung cấp đa dạng gói cấu hình với tài nguyên CPU, RAM và băng thông mạnh mẽ, giúp bạn dễ dàng thiết lập các cụm Spark Cluster tùy chỉnh. Với hạ tầng hiện đại đặt tại các trung tâm dữ liệu đạt chuẩn, Vietnix cam kết tốc độ đường truyền ổn định và hỗ trợ kỹ thuật 24/7, giúp các kỹ sư dữ liệu tập trung hoàn toàn vào việc tối ưu thuật toán mà không cần lo lắng về vận hành phần cứng.

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

Làm sao để tải và cài đặt PySpark?

Bạn có thể cài PySpark trực tiếp từ PyPI bằng lệnh pip install pyspark, sau đó đảm bảo đã cài Java và khai báo biến môi trường SPARK_HOME nếu chạy Spark cục bộ. Nếu không muốn cấu hình nhiều, bạn có thể dùng các môi trường sẵn như Databricks, EMR, hoặc notebook online hỗ trợ sẵn Spark.

PySpark khác gìPandas?

Pandas là thư viện xử lý dữ liệu chạy trên một thiết bị duy nhất và phụ thuộc hoàn toàn vào sức mạnh vật lý của máy tính đó. Trái lại, PySpark là công cụ xử lý phân tán trải dài trên nhiều máy chủ, cho phép bạn thao tác mượt mà với những tập dữ liệu khổng lồ lên tới quy mô petabyte mà Pandas hoàn toàn không thể gánh vác.

Tìm code mẫu PySpark trên GitHub ở đâu?

Bạn có thể tìm trực tiếp từ repo chính thức apache/spark (thư mục examples/src/main/python) hoặc các repo cộng đồng với từ khóa như pyspark project, pyspark tutorial, customer_segmentation_pyspark trên GitHub. Nhiều tổ chức, cá nhân cũng mở mã nguồn notebook hướng dẫn ETL, ML và streaming bằng PySpark để bạn clone về chạy thử.

Việc sử dụng PySpark có yêu cầu trả phí bản quyền không?

PySpark là một nền tảng mã nguồn mở do quỹ Apache Software Foundation phát triển và quản lý. Do đó, tất cả người dùng hoàn toàn có quyền tải về, cài đặt và sử dụng phần mềm này miễn phí 100% cho cả mục đích nghiên cứu cá nhân lẫn phát triển thương mại.

PySpark không chỉ là một công cụ hỗ trợ xử lý dữ liệu lớn, mà còn là cầu nối giúp bạn đưa toàn bộ kỹ năng Python vào thế giới big data và hệ sinh thái Apache Spark hiện đại. Nếu doanh nghiệp hoặc đội ngũ của bạn đang muốn xây dựng các pipeline dữ liệu, hệ thống phân tích và mô hình machine learning ở quy mô lớn, đầu tư học và áp dụng PySpark ngay từ bây giờ sẽ là bước đi nền tảng để bứt phá trong vài năm tới.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày