TPU là gì? Nguyên lý hoạt động và cách phân biệt với CPU và GPU

Đã kiểm duyệt nội dung

Đánh giá

Trong quá trình trực tiếp triển khai và huấn luyện các mô hình Deep Learning quy mô lớn, mình đã ghi nhận sự khác biệt rõ rệt về hiệu suất khi chuyển đổi khối lượng công việc từ các bộ vi xử lý thông thường sang cấu trúc chuyên dụng của TPU. TPU không chỉ giúp tối ưu hóa thời gian tính toán mà còn là yếu tố then chốt để tiết kiệm chi phí tài nguyên phần cứng. Trong bài viết này, mình sẽ phân tích chi tiết cơ chế hoạt động của TPU và cung cấp các tiêu chí kỹ thuật để phân biệt chính xác dòng chip này với CPU và GPU.

Những điểm chính

Đối với mình, TPU không chỉ là một phần cứng chuyên dụng mà còn là giải pháp giúp tăng tốc xử lý các tác vụ AI và machine learning với hiệu năng vượt trội. Để giúp bạn hiểu rõ và lựa chọn phù hợp, bài viết dưới đây sẽ cung cấp các thông tin gồm:

- Định nghĩa TPU: Hiểu rõ TPU là bộ tăng tốc phần cứng chuyên dụng được thiết kế bởi Google để tối ưu hóa các phép toán ma trận và tensor, giúp rút ngắn thời gian huấn luyện và suy luận AI vượt xa CPU/GPU truyền thống.

- Nguyên lý hoạt động: Nắm vững cách TPU nhận dữ liệu, xử lý song song các phép nhân-cộng trên vector/ma trận nhờ băng thông bộ nhớ cực cao, giúp tối ưu hiệu suất trên mỗi watt điện.

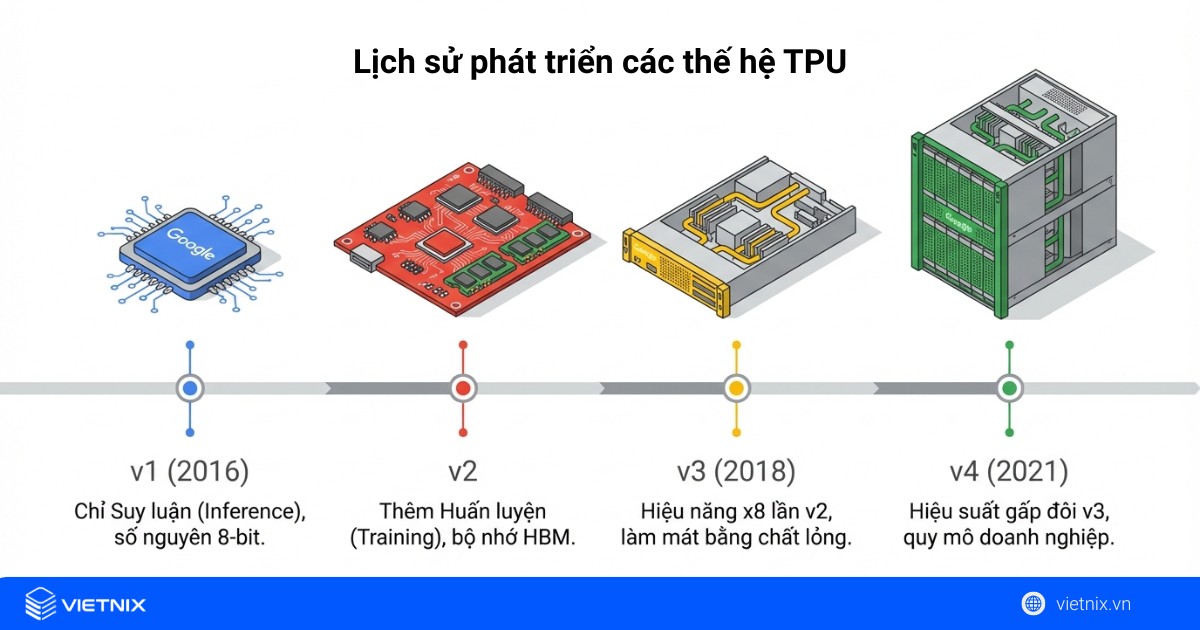

- Lịch sử phát triển: Biết được quá trình tiến hóa từ thế hệ TPU v1 đến TPU v5p và Edge TPU.

- Ưu nhược điểm: Cân nhắc giữa hiệu năng AI vượt trội và tiết kiệm điện năng của TPU so với sự hạn chế về tính linh hoạt và sự phụ thuộc vào hệ sinh thái Google Cloud.

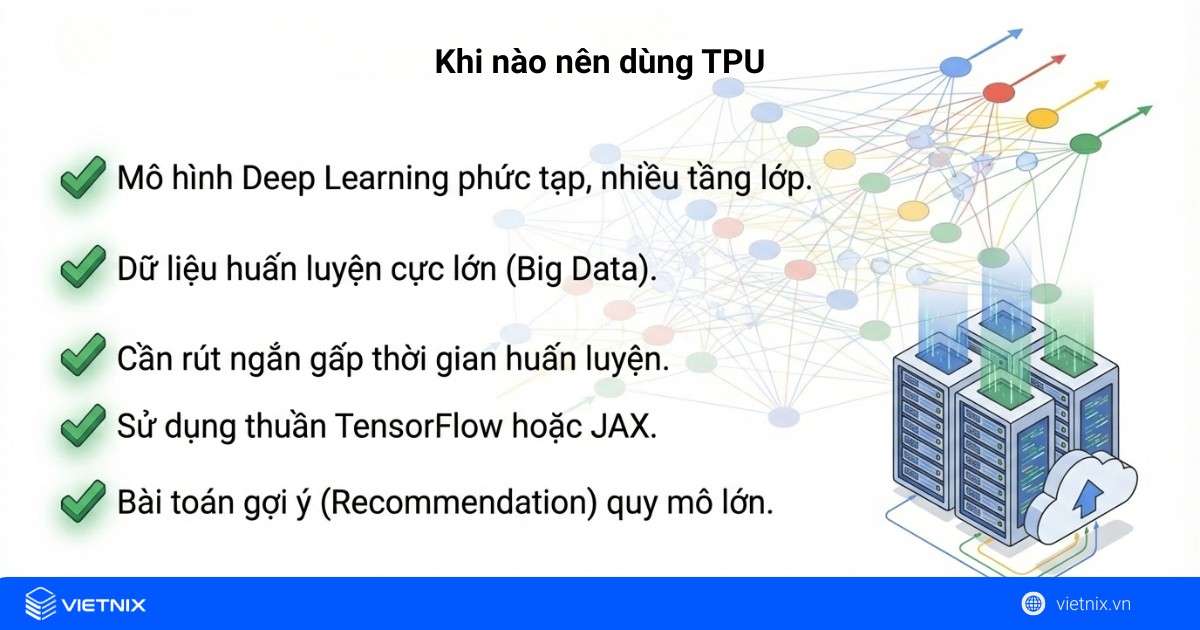

- Trường hợp nên dùng TPU: Ưu tiên cho các mô hình AI phức tạp, yêu cầu huấn luyện trên tập dữ liệu khổng lồ, cần rút ngắn thời gian training từ tuần xuống giờ, hoặc các hệ thống tối ưu theo hệ sinh thái TensorFlow/JAX.

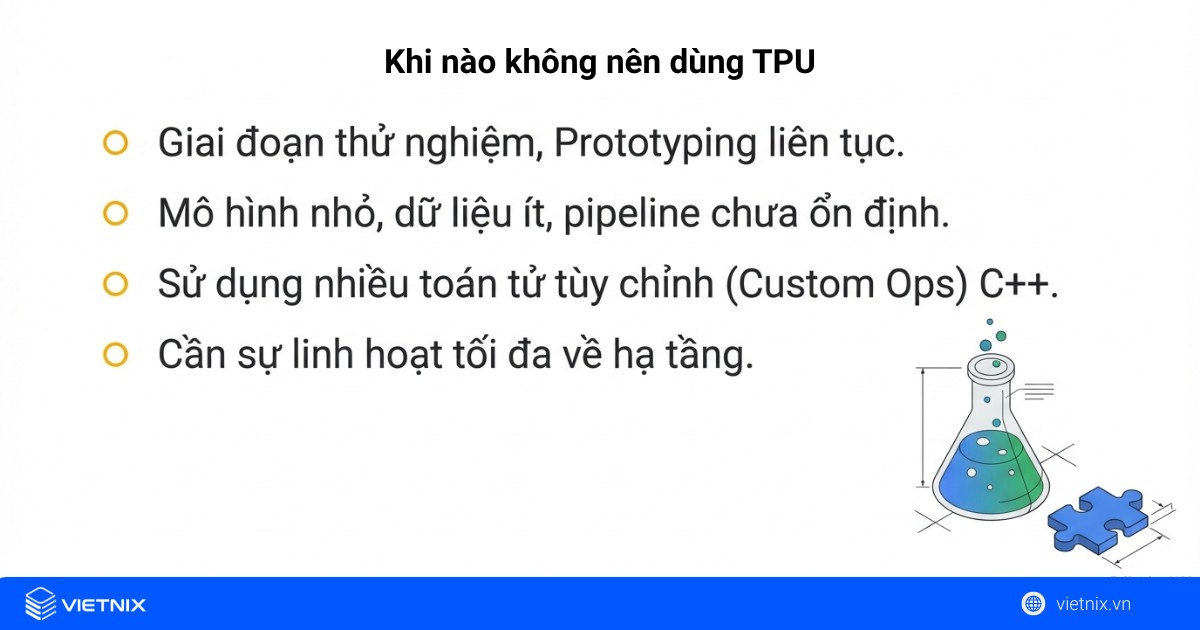

- Trường hợp không nên dùng TPU: Tránh sử dụng cho các mô hình nhỏ/đơn giản, giai đoạn thử nghiệm linh hoạt, quy trình chưa ổn định hoặc khi mô hình phụ thuộc quá nhiều vào các toán tử tùy chỉnh phức tạp.

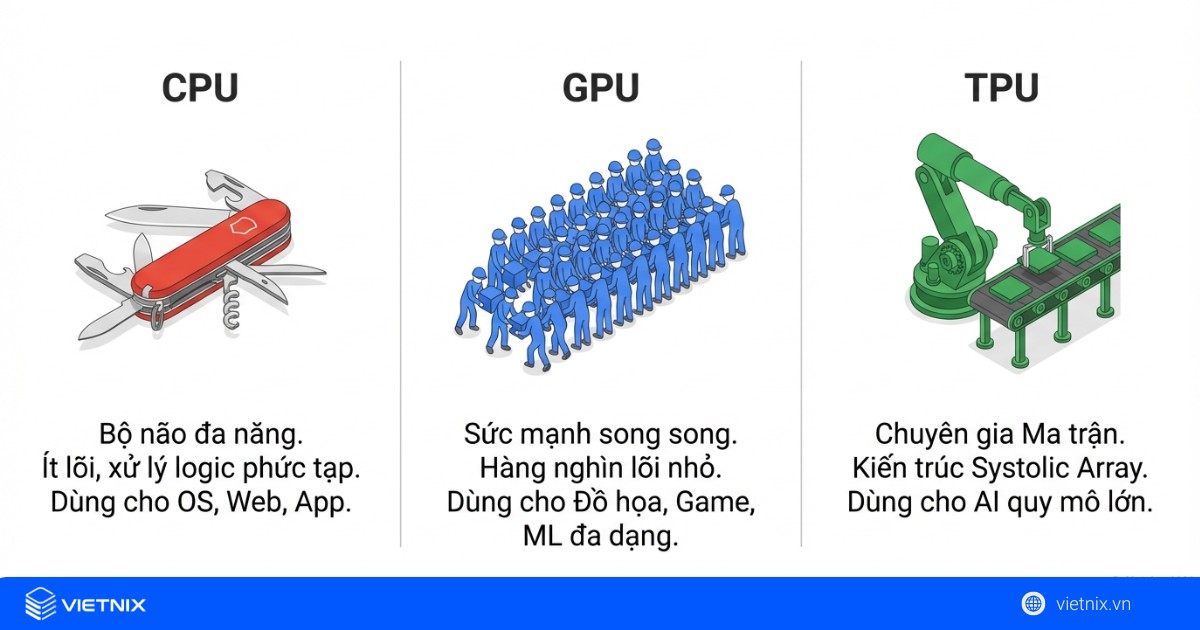

- So sánh với CPU và GPU: Phân biệt rõ sự khác biệt giữa TPU với CPU và GPU về mục đích thiết kế, kiến trúc và loại tác vụ phù hợp, giúp bạn đưa ra quyết định lựa chọn phần cứng tối ưu cho từng dự án AI.

- Các giải pháp tăng tốc AI khác: Biết thêm về các bộ tăng tốc phần cứng khác như Intel NCS, Microsoft Brainwave, Alibaba Hanguang 800 và Graphcore IPU, giúp có cái nhìn tổng quan về thị trường phần cứng AI.

- Biết thêm Vietnix là nhà cung cấp dịch vụ hosting, VPS tốc độ, bảo mật và support nhiệt tình.

- Câu hỏi thường gặp: Giải đáp các thắc mắc liên quan đến TPU.

TPU là gì?

TPU (Tensor Processing Unit – Đơn vị xử lý Tensor) là một loại chip ASIC chuyên dụng do Google phát triển, được tối ưu hóa riêng cho các tác vụ machine learning và deep learning. Thay vì hoạt động đa năng như CPU hay GPU, TPU được thiết kế để xử lý khối lượng phép toán ma trận, vector và tensor ở quy mô rất lớn trong giai đoạn huấn luyện và suy luận của các mô hình AI, từ đó rút ngắn thời gian xử lý và cải thiện hiệu suất toàn hệ thống.

Trong kiến trúc hệ thống, TPU thường đảm nhận vai trò bộ tăng tốc phần cứng, phối hợp với CPU để nhận lệnh, phân bổ và thực thi các tác vụ tính toán cho mô hình, chủ yếu thông qua các framework như TensorFlow hoặc TensorFlow Lite trên nền tảng đám mây hoặc các thiết bị Edge chuyên dụng.

Việc lựa chọn hạ tầng phù hợp phụ thuộc rất lớn vào mục tiêu triển khai thực tế. Nếu bạn đang cần một môi trường để phát triển ứng dụng, xử lý dữ liệu, test mô hình hoặc vận hành các hệ thống không yêu cầu phần cứng AI chuyên dụng, thì một nền tảng có tốc độ truy xuất cao và độ ổn định tốt sẽ là ưu tiên. Trong trường hợp này, dịch vụ NVMe VPS tại Vietnix sẽ đáp ứng hiệu quả nhu cầu về hiệu năng, giúp tối ưu tốc độ xử lý và đảm bảo hệ thống vận hành mượt mà. Liên hệ ngay để được tư vấn chi tiết về dịch vụ!

Website nhanh hơn – Bán được nhiều hàng hơn

- Chiếm lĩnh TOP Google, hút traffic.

- Mua sắm mượt mà, tăng tỷ lệ chốt đơn.

- Chuyên gia kỹ thuật đồng hành 24/7.

Nguyên lý hoạt động của TPU

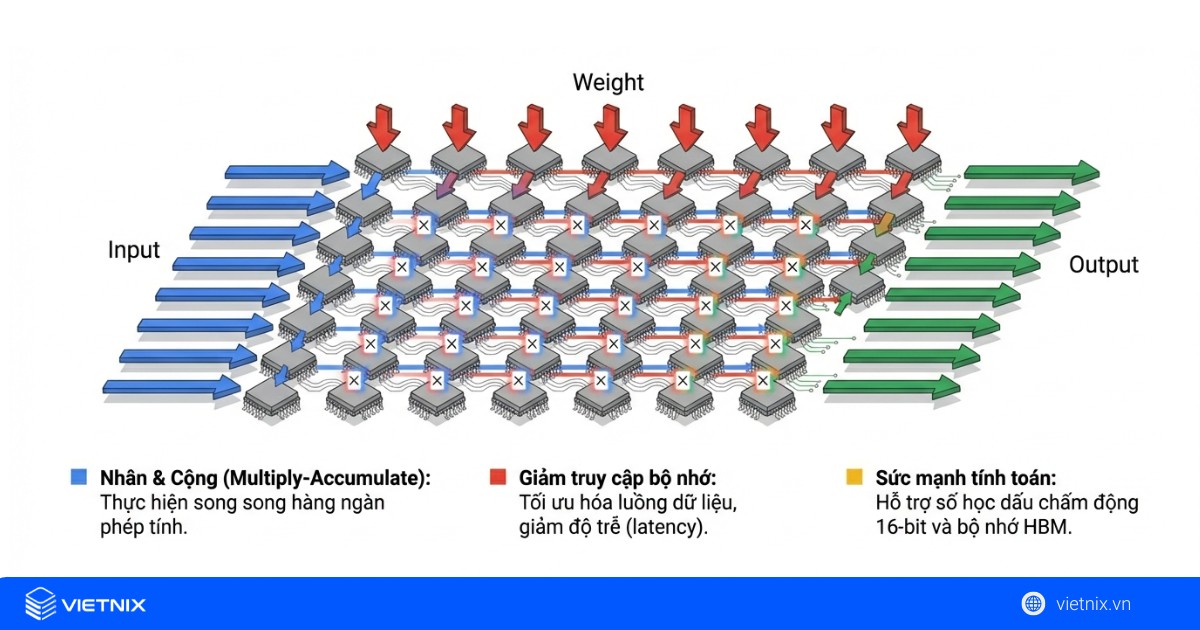

TPU là bộ tăng tốc phần cứng chuyên biệt cho AI/ML, không được thiết kế để xử lý các tác vụ tính toán tổng quát hằng ngày như CPU. Kiến trúc TPU tối ưu cho các phép toán nhân – cộng trên ma trận và vector, giúp quá trình huấn luyện và suy luận mô hình deep learning diễn ra nhanh hơn, đồng thời giảm tiêu thụ điện năng so với bộ xử lý truyền thống.

Trong quá trình vận hành, TPU nhận dữ liệu đầu vào, chia dữ liệu thành các vector, thực hiện song song các phép nhân và cộng trên những vector này rồi trả kết quả cho mô hình AI. Các thế hệ TPU mới hỗ trợ số học dấu chấm động 16‑bit, sử dụng bộ nhớ băng thông cao (TPU v5p đạt khoảng 2.765 GB/s) và có khả năng tự điều chỉnh hiệu năng theo từng loại ứng dụng AI khác nhau.

Lịch sử hình thành và phát triển của TPU

Từ khi thế hệ đầu tiên xuất hiện vào năm 2016, Tensor Processing Unit đã liên tục được nâng cấp, cho thấy định hướng đầu tư dài hạn của Google vào phần cứng chuyên dụng cho AI, với mỗi phiên bản đều cải thiện về hiệu năng, khả năng mở rộng và hiệu quả năng lượng:

- TPU v1: Thế hệ mở đầu, tập trung vào xử lý số nguyên 8‑bit, hoạt động như bộ nhân ma trận chuyên dụng, tối ưu cho suy luận nhưng chưa hỗ trợ tốt tính toán số thực.

- TPU v2: Được giới thiệu để giải quyết hạn chế về băng thông của v1, trang bị 16 GB HBM và hỗ trợ số thực dấu phẩy động/bfloat16, cho phép phục vụ cả huấn luyện lẫn suy luận mô hình.

- TPU v3: Ra mắt năm 2018, tăng gấp đôi sức mạnh xử lý so với v2 và mở rộng quy mô triển khai, đem lại mức hiệu năng tới khoảng 8 lần trên mỗi pod so với thế hệ trước.

- TPU v4: Công bố năm 2021 với hiệu suất hơn gấp đôi v3, được Google triển khai trong trung tâm dữ liệu để xử lý các workload AI cỡ doanh nghiệp.

- Edge TPU: Biến thể tối ưu cho thiết bị biên và ứng dụng IoT, tiêu thụ khoảng 2 watt nhưng vẫn đạt tới 4 TOPS, rất phù hợp cho điện thoại Pixel và các hệ thống AI nhúng công suất thấp.

Ưu và nhược điểm của TPU

Hiệu năng xử lý AI vượt trội: TPU đặc biệt mạnh ở các phép toán ma trận và tensor quy mô lớn, giúp rút ngắn đáng kể thời gian huấn luyện và suy luận cho các mô hình deep learning so với khi chạy trên CPU hoặc nhiều loại GPU phổ thông.

Tiết kiệm năng lượng cho workload ML: Nhờ được thiết kế riêng cho tác vụ học máy, TPU thường đạt hiệu suất tính toán trên mỗi watt điện tốt hơn, giúp giảm chi phí vận hành và nhu cầu làm mát, nhất là trong các trung tâm dữ liệu lớn.

Hiệu quả chi phí ở quy mô lớn: Với các bài toán phải train/infer liên tục trên Google Cloud, Cloud TPU có thể mang lại chi phí trên mỗi đơn vị hiệu năng hấp dẫn hơn so với thuê GPU, đặc biệt khi tận dụng tốt kiến trúc pod và batch lớn.

Tính chuyên dụng cao, ít linh hoạt: Do được tối ưu cho học máy, TPU không phù hợp cho các tác vụ tính toán đa năng, xử lý hệ thống hay đồ họa giống CPU/GPU và khó áp dụng cho các workload ngoài AI.

Gắn liền với hệ sinh thái Google Cloud: Cách tiếp cận phổ biến là sử dụng TPU thông qua dịch vụ Cloud TPU trên Google Cloud Platform, làm giảm sự tự do lựa chọn hạ tầng so với GPU vốn có mặt trên nhiều nền tảng cloud và on premise.

Yêu cầu tối ưu lại code và framework: Để tận dụng tối đa sức mạnh TPU, đội ngũ phát triển thường phải điều chỉnh code theo các API, thư viện được tối ưu (TensorFlow, JAX, một phần PyTorch).

Chi phí cao cho nhu cầu nhỏ lẻ: Với nhóm nghiên cứu nhỏ, cá nhân hoặc dự án quy mô vừa và nhỏ, chi phí giờ chạy Cloud TPU có thể khó tối ưu, trong khi GPU hoặc CPU vẫn đáp ứng tốt mà ít ràng buộc hơn.

Trường hợp nên dùng TPU?

Trong các trường hợp dưới đây, lựa chọn TPU thường mang lại hiệu quả rõ rệt hơn so với CPU/GPU:

- Mô hình AI rất phức tạp, dùng nhiều phép toán ma trận/deep learning: Áp dụng cho các mô hình lớn, nhiều tầng, yêu cầu xử lý tính toán cường độ cao liên tục.

- Khối lượng dữ liệu huấn luyện cực lớn: Thích hợp với các bài toán big data, nơi tài nguyên CPU/GPU phổ thông bắt đầu trở nên quá tải hoặc kém hiệu quả.

- Cần rút ngắn mạnh thời gian training: Hữu ích khi muốn giảm thời gian huấn luyện từ nhiều ngày/tuần xuống còn vài giờ để tăng tốc chu trình phát triển mô hình.

- Mô hình xây dựng thuần trên TensorFlow/JAX, ít dùng custom op: Tối ưu nhất khi pipeline bám sát hệ sinh thái mà TPU hỗ trợ tốt, hạn chế toán tử tùy chỉnh.

- Bài toán dạng gợi ý, phân tích dữ liệu lớn, huấn luyện trên cloud: Phù hợp với hệ thống recommendation, phân tích hành vi quy mô lớn, huấn luyện trên Google Cloud với TensorFlow.

Trường hợp không nên dùng TPU?

Ngược lại, trong các trường hợp sau, CPU hoặc GPU thường là lựa chọn hợp lý và kinh tế hơn TPU:

- Mô hình đơn giản, huấn luyện nhanh trên GPU/CPU: Dùng hạ tầng phổ thông sẽ tối ưu hơn về chi phí, độ phức tạp và thời gian triển khai.

- Đang ở giai đoạn thử nghiệm, prototype liên tục: Phù hợp với môi trường linh hoạt như GPU, dễ thay đổi kiến trúc, framework và thư viện.

- Dữ liệu huấn luyện còn ít, pipeline chưa ổn định: Chưa cần đến hạ tầng tăng tốc chuyên dụng, tránh lãng phí tài nguyên và chi phí.

- Mô hình phụ thuộc nhiều vào custom op C++ hoặc toán tử đặc biệt: Dễ gặp hạn chế tương thích trên TPU, phải chỉnh sửa nhiều code hoặc không khai thác được hết khả năng tăng tốc.

So sánh chi tiết TPU với CPU và GPU

Để lựa chọn đúng phần cứng cho từng bài toán, việc so sánh TPU với CPU và GPU sẽ giúp bạn nhìn rõ sự khác biệt về kiến trúc, hiệu năng xử lý và khả năng ứng dụng trong thực tế. Dưới đây là bảng so sánh chi tiết:

| Tiêu chí | CPU | GPU | TPU |

| Mục đích thiết kế | Bộ xử lý trung tâm, xử lý logic, số học, điều khiển và I/O cho mọi loại chương trình, đóng vai trò bộ não đa năng của hệ thống. | Bộ xử lý đồ họa, tăng tốc hiển thị giao diện, kết xuất hình ảnh, video và các tác vụ tính toán song song quy mô lớn (game, CAD, ML, render,…). | Bộ xử lý chuyên dụng dạng ASIC, tối ưu cho bài toán AI/ML, đặc biệt là TensorFlow và các mô hình dùng phép toán ma trận/tensor. |

| Kiến trúc và cách xử lý | Ít lõi, đường ống xử lý sâu, thực thi tuần tự hoặc song song hạn chế, ưu tiên độ linh hoạt và khả năng xử lý đa nhiệm, đa tác vụ. | Hàng nghìn lõi nhỏ, kiến trúc song song cao, xử lý đồng thời khối lượng lớn phép toán giống nhau, thông lượng dữ liệu lớn nhưng đa nhiệm kém hơn CPU. | Một hoặc nhiều khối xử lý ma trận (MXU, systolic array), các đơn vị vector/vô hướng, tập lệnh hẹp nhưng cực tối ưu cho nhân – cộng ma trận ở quy mô lớn. |

| Loại tác vụ phù hợp | Hệ điều hành, ứng dụng văn phòng, web, dịch vụ hệ thống, logic nghiệp vụ, các mô hình ML nhỏ hoặc mang tính thử nghiệm cần linh hoạt cao. | Đồ họa 2D/3D, game, render video, khoa học dữ liệu, deep learning, các mô hình ML trung bình đến lớn, tận dụng batch size lớn và tính song song. | Huấn luyện và suy luận mô hình AI quy mô rất lớn, bài toán phụ thuộc mạnh vào phép toán ma trận/tensor, workload TensorFlow trên hạ tầng cloud. |

| Độ linh hoạt | Rất linh hoạt, chạy hầu hết mọi loại phần mềm, hỗ trợ nhiều ngôn ngữ và framework, phù hợp giai đoạn prototype, thử nghiệm mô hình. | Linh hoạt cao cho AI/ML, được hỗ trợ rộng rãi bởi nhiều framework (TensorFlow, PyTorch,…), phù hợp đa dạng bài toán tính toán tăng tốc. | Tính linh hoạt thấp hơn, thường gắn chặt với TensorFlow/JAX và một số API được hỗ trợ, không phù hợp các mô hình dùng nhiều toán tử/custom op đặc biệt. |

| Hiệu năng | Tối ưu cho độ trễ thấp trên từng tác vụ đơn, nhưng thông lượng tổng thể cho workload song song lớn bị giới hạn bởi số lõi và kiến trúc. | Hiệu năng cao cho tác vụ song song, rút ngắn đáng kể thời gian huấn luyện mô hình phức tạp so với chỉ dùng CPU. | Hiệu năng cao cho tính toán ma trận, performance per watt vượt trội với một số mô hình AI so với CPU/GPU, giúp rút ngắn training từ tuần xuống giờ. |

| Mức độ chuyên biệt | Đa năng, không tối ưu riêng cho AI, nhưng đủ tốt cho nhiều tác vụ thông thường và các mô hình ML nhỏ. | Chuyên cho đồ họa và tính toán song song nói chung, không chỉ riêng AI, thích hợp nhiều loại workload tính toán nặng. | Chuyên sâu cho AI/ML, gần như ASIC cho tensor, ít phù hợp tác vụ ngoài scope học máy. |

| Quy mô triển khai điển hình | Máy cá nhân, máy chủ phổ thông, mọi loại hạ tầng CNTT. | PC đồ họa, trạm làm việc, máy chủ GPU, cloud GPU cho AI, render, khoa học dữ liệu. | Cloud TPU, pod TPU trong trung tâm dữ liệu, Edge TPU trên thiết bị/IoT cho AI nhúng. |

Theo kinh nghiệm của mình, nếu bạn cần sự linh hoạt để chuyển đổi giữa các kiến trúc AI khác nhau, hãy chọn GPU. Nếu bạn cần tốc độ xử lý nhanh cho các mô hình học sâu khổng lồ và đã sẵn sàng cam kết với hệ sinh thái của Google, TPU là giải pháp tối ưu nhất, còn CPU sẽ đóng vai trò là trung tâm điều phối không thể thay thế trong mọi kịch bản.

Một số giải pháp phần cứng tăng tốc AI khác

Bên cạnh TPU của Google, nhiều tập đoàn công nghệ lớn cũng đã giới thiệu các bộ tăng tốc phần cứng riêng để phục vụ nhu cầu triển khai mô hình học máy:

- Intel Neural Compute Stick (NCS): Thiết bị tăng tốc AI dạng USB nhỏ gọn, sử dụng VPU để chạy suy luận mô hình học máy trực tiếp trên thiết bị biên, phù hợp cho các ứng dụng thị giác máy tính và mô hình nhẹ.

- Microsoft Brainwave: Nền tảng tăng tốc AI dựa trên FPGA, được tối ưu cho suy luận thời gian thực trong môi trường đám mây, nhắm tới các workload quy mô lớn trên hạ tầng Azure.

- Alibaba Hanguang 800: Chip tăng tốc AI do Alibaba phát triển, tập trung vào xử lý suy luận cho các bài toán thương mại điện tử, tìm kiếm và gợi ý sản phẩm trong hệ sinh thái Alibaba Cloud.

- Graphcore IPU (Intelligence Processing Unit): Bộ xử lý được thiết kế riêng cho deep learning, tối ưu cho các mô hình phức tạp và các kiến trúc AI mới, thường được cung cấp thông qua các hệ thống IPU Pod/Bow Pod trên nền tảng cloud chuyên dụng.

Vietnix – Nhà cung cấp dịch vụ hosting, VPS tốc độ, bảo mật và support nhiệt tình

Vietnix là nhà cung cấp dịch vụ thuê hosting website và thuê máy chủ ảo VPS tốc độ cao dành cho doanh nghiệp, tập trung vào hiệu năng, tính ổn định và khả năng hỗ trợ trong suốt quá trình vận hành hệ thống. Với nền tảng được tối ưu về tốc độ truy xuất dữ liệu, các giải pháp tại Vietnix phù hợp cho nhiều mục đích từ website doanh nghiệp đến nền tảng thương mại điện tử. Bên cạnh đó, đội ngũ kỹ thuật hỗ trợ 24/7 giúp xử lý nhanh các vấn đề phát sinh, đảm bảo hệ thống luôn hoạt động liên tục và hạn chế tối đa downtime. Liên hệ ngay!

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

Google TPU là gì?

Google TPU (Tensor Processing Unit) là bộ xử lý chuyên dụng do Google phát triển để tăng tốc các tác vụ học máy và trí tuệ nhân tạo, đặc biệt là các mô hình deep learning chạy trên TensorFlow hoặc JAX.

TPU trong AI được dùng để làm gì?

Trong lĩnh vực AI, TPU được sử dụng để rút ngắn thời gian huấn luyện và suy luận của các mô hình lớn bằng cách tăng tốc các phép toán ma trận và tensor, giúp xử lý hiệu quả hơn so với chỉ dùng CPU hoặc một số cấu hình GPU thông thường.

TPU chip là gì?

TPU chip là vi mạch tích hợp chuyên dụng (ASIC) do Google thiết kế, bên trong chứa các khối xử lý ma trận và phần cứng tối ưu cho tính toán AI, được triển khai trong trung tâm dữ liệu hoặc dưới dạng phiên bản thu gọn như Edge TPU.

Sự khác nhau giữa TPU và GPU là gì?

TPU được tối ưu riêng cho tác vụ học máy (đặc biệt TensorFlow) với các đơn vị nhân và cộng ma trận chuyên biệt, trong khi GPU là bộ xử lý đồ họa đa dụng, mạnh về xử lý song song cho cả đồ họa lẫn nhiều loại workload tính toán khác nhau.

Trong bối cảnh trí tuệ nhân tạo phát triển ngày càng mạnh mẽ, TPU đang trở thành mảnh ghép quan trọng trong hạ tầng tính toán hiện đại, giúp các mô hình AI quy mô lớn được huấn luyện và triển khai nhanh hơn, hiệu quả hơn. Tùy vào nhu cầu thực tế, việc kết hợp TPU với CPU và GPU một cách hợp lý sẽ giúp doanh nghiệp và nhà phát triển tối ưu hiệu năng, chi phí cũng như khả năng mở rộng cho các dự án AI trong tương lai.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày