Hướng dẫn 3 cách chạy OpenClaw miễn phí chi tiết

Đã kiểm duyệt nội dung

Đánh giá

OpenClaw là một dự án mã nguồn mở cho phép người dùng tự host trợ lý AI trên máy cá nhân hoặc VPS. Nhờ khả năng kết nối với nhiều mô hình AI miễn phí hoặc chạy LLM cục bộ, bạn có thể vận hành OpenClaw với chi phí gần như bằng 0. Dựa trên kinh nghiệm triển khai và thử nghiệm thực tế trong quá trình làm việc với các hệ thống AI agent, bài viết này sẽ hướng dẫn chi tiết các cách chạy OpenClaw miễn phí để bạn có thể áp dụng nhanh trong môi trường thực tế.

Những điểm chính

- OpenClaw là gì: Hiểu rõ OpenClaw là AI agent mã nguồn mở cho phép tự host và tự động hóa nhiều tác vụ với LLM, giúp người dùng kiểm soát dữ liệu, chi phí và hệ thống.

- Lý do OpenClaw được nhiều người sử dụng: Nắm được những ưu điểm nổi bật như khả năng tự host, tích hợp nhiều nền tảng chat và hỗ trợ LLM miễn phí giúp OpenClaw trở thành công cụ AI agent linh hoạt cho lập trình viên.

- Yêu cầu hệ thống trước khi chạy OpenClaw: Biết được cấu hình tối thiểu và môi trường cần thiết để triển khai OpenClaw ổn định trên máy cá nhân hoặc VPS.

- Cách chạy OpenClaw miễn phí: Hướng dẫn chi tiết 3 cách chạy OpenClaw miễn phí bằng OpenRouter; kết nối OpenClaw với các API miễn phí như Gemini, Groq, Mistral; chạy OpenClaw hoàn toàn miễn phí bằng Ollama (LLM cục bộ).

- Lưu ý bảo mật khi vận hành OpenClaw: Tránh các rủi ro phổ biến khi tự host OpenClaw như lộ API key hoặc public server, giúp hệ thống hoạt động an toàn hơn.

- So sánh và lựa chọn cách chạy OpenClaw phù hợp: Tổng hợp đánh giá thực tế để giúp người đọc chọn phương án chạy OpenClaw phù hợp với nhu cầu về tốc độ, chi phí hoặc bảo mật.

- Giới thiệu Vietnix: Biết đến Vietnix là nhà cung cấp VPS OpenClaw giúp việc triển khai OpenClaw nhanh chóng để hệ thống AI agent hoạt động liên tục, ổn định và dễ mở rộng.

- Câu hỏi thường gặp khi chạy OpenClaw miễn phí: Giải đáp các thắc mắc phổ biến về cấu hình máy, lựa chọn mô hình AI và khả năng chạy OpenClaw trên Windows.

OpenClaw là gì?

OpenClaw là một AI agent mã nguồn mở cho phép kết nối các mô hình ngôn ngữ lớn (LLM) với hệ thống của người dùng nhằm tự động hóa nhiều tác vụ khác nhau. Công cụ này có thể thực hiện các hoạt động như truy cập và xử lý file, chạy script, tương tác với trình duyệt hoặc trả lời tin nhắn trên nhiều nền tảng giao tiếp.

OpenClaw hỗ trợ tích hợp với nhiều nền tảng phổ biến như Telegram, WhatsApp, Slack, Discord, Signal và Microsoft Teams. Nhờ khả năng chạy trực tiếp trên máy cá nhân hoặc máy chủ riêng, người dùng có thể chủ động kiểm soát dữ liệu và tăng cường bảo mật trong quá trình sử dụng.

Dự án OpenClaw được phát triển bởi kỹ sư phần mềm người Áo Peter Steinberger vào tháng 11/2025. Ban đầu, dự án có tên Clawdbot, sau đó lần lượt đổi tên thành Moltbot và cuối cùng là OpenClaw. Dù trải qua nhiều lần thay đổi tên gọi, cộng đồng vẫn thường nhắc đến dự án với hai tên quen thuộc là OpenClaw hoặc Clawdbot.

Chỉ trong vòng 72 giờ sau khi được chú ý rộng rãi, dự án đã đạt hơn 60.000 lượt sao trên GitHub, cho thấy mức độ quan tâm lớn từ cộng đồng AI và lập trình viên trên toàn thế giới.

Lý do OpenClaw được nhiều người sử dụng

Dưới góc độ của một lập trình viên, mình nhận thấy OpenClaw được cộng đồng quan tâm và sử dụng rộng rãi nhờ khả năng kết hợp giữa tính linh hoạt của AI agent và mô hình triển khai tự host, giúp người dùng chủ động kiểm soát hệ thống và chi phí.

Một số ưu điểm nổi bật của OpenClaw có thể kể đến:

- Hỗ trợ nhiều nền tảng nhắn tin: Có thể tích hợp với các dịch vụ phổ biến như Telegram, WhatsApp, Slack hoặc Discord.

- Có thể chạy cục bộ trên máy cá nhân: Người dùng có thể tự triển khai trên máy tính hoặc máy chủ riêng mà không phụ thuộc vào dịch vụ bên ngoài.

- Cho phép AI tương tác trực tiếp với hệ thống: OpenClaw có khả năng truy cập tệp tin, chạy script hoặc làm việc với trình duyệt để tự động hóa nhiều tác vụ.

- Mã nguồn mở hoàn toàn: Người dùng có thể tự do cài đặt, tùy chỉnh hoặc phát triển thêm các tính năng phù hợp với nhu cầu.

- Không bắt buộc sử dụng API trả phí: Có thể kết nối với các mô hình AI miễn phí hoặc sử dụng LLM chạy cục bộ.

Trong một số trường hợp, chi phí chỉ phát sinh khi sử dụng API của các mô hình AI thương mại. Tuy nhiên, người dùng vẫn có nhiều lựa chọn miễn phí như các gói free tier hoặc mô hình AI cục bộ để vận hành hệ thống với chi phí rất thấp.

Yêu cầu hệ thống cơ bản trước khi chạy OpenClaw

- Hệ điều hành: macOS, Linux, Windows (WSL) hoặc VPS.

- RAM tối thiểu: 8GB.

- Khuyến nghị: 16GB+ nếu sử dụng các mô hình lớn như Llama 70B.

Repo chính thức: https://github.com/openclaw/openclaw

Cài đặt phiên bản mới nhất:

npm install -g openclaw@latestViệc đáp ứng các yêu cầu trên, đặc biệt là về RAM và một môi trường luôn hoạt động 24/7, có thể là một trở ngại nếu chỉ sử dụng máy tính cá nhân. Để có một trợ lý AI thực sự ổn định, luôn sẵn sàng và không chiếm dụng tài nguyên máy local, việc triển khai trên một VPS là giải pháp tối ưu.

Hiểu được nhu cầu đó, Vietnix cung cấp dịch vụ VPS OpenClaw được cấu hình sẵn. Thay vì phải tự mình thiết lập một server từ đầu, bạn có thể sở hữu ngay một môi trường đã được tối ưu, giúp tiết kiệm thời gian và công sức để tập trung vào việc trải nghiệm và phát triển các kỹ năng cho trợ lý AI của mình.

Hướng dẫn 3 cách chạy OpenClaw miễn phí

Cách 1: Sử dụng API miễn phí từ OpenRouter

OpenRouter là cách dễ nhất để sử dụng OpenClaw với nhiều mô hình AI miễn phí. OpenRouter hoạt động như một cổng API thống nhất, cho phép bạn truy cập nhiều mô hình khác nhau chỉ với một cấu hình.

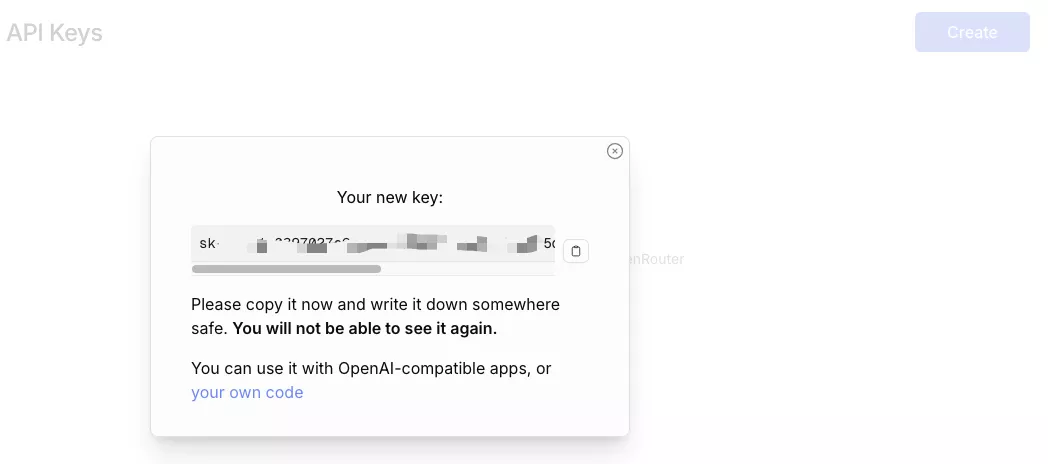

Bước 1: Tạo tài khoản OpenRouter

Để sử dụng OpenRouter với OpenClaw, bạn cần:

- Truy cập openrouter.ai.

- Đăng ký tài khoản miễn phí.

- Vào mục API Keys.

- Tạo một khóa API mới cho cài đặt OpenClaw của bạn.

- Sao chép khóa API, bạn sẽ cần để cấu hình OpenClaw.

Bước 2: Chọn mô hình miễn phí

OpenRouter cung cấp nhiều mô hình miễn phí tương thích với OpenClaw như:

| Mô hình | Nhà cung cấp | Kích thước Context | Phù hợp |

|---|---|---|---|

| meta-llama/llama-3.2-3b-instruct | Meta | 128K | Các tác vụ chung |

| google/gemma-2-9b-it | 8K | Phản hồi nhanh | |

| mistralai/mistral-7b-instruct | Mistral | 32K | Các tác vụ lập trình |

| qwen/qwen-2-7b-instruct | Alibaba | 32K | Sử dụng đa ngôn ngữ |

| microsoft/phi-3-mini-128k-instruct | Microsoft | 128K | Context dài |

Bước 3: Cấu hình OpenClaw

Sau khi cài đặt OpenClaw, bạn cần cấu hình để hệ thống có thể kết nối với OpenRouter và sử dụng các mô hình AI miễn phí.

Thực hiện theo các bước sau:

- Mở file cấu hình của OpenClaw trên máy của bạn.

- Thiết lập API Base URL để OpenClaw kết nối đến OpenRouter:

OPENAI_API_BASE=https://openrouter.ai/api/v1- Thêm API Key OpenRouter vừa tạo:

OPENAI_API_KEY=your_openrouter_api_key_here- Chọn mô hình AI muốn sử dụng. Ví dụ:

MODEL=meta-llama/llama-3.2-3b-instruct:free- Lưu cấu hình và khởi động lại OpenClaw để các thay đổi có hiệu lực.

Sau khi hoàn tất các bước trên, OpenClaw của bạn đã được kết nối với các mô hình AI miễn phí trên OpenRouter và sẵn sàng hoạt động.

Giới hạn gói miễn phí của OpenRouter

Gói miễn phí của OpenRouter cung cấp một số giới hạn nhất định, bao gồm:

- Giới hạn tốc độ được reset mỗi ngày.

- Quyền truy cập vào nhiều mô hình AI miễn phí khác nhau.

- Không yêu cầu thông tin thẻ tín dụng để đăng ký.

Với nhu cầu sử dụng OpenClaw ở mức cơ bản hoặc cho mục đích cá nhân, các giới hạn này thường đã đủ để vận hành hệ thống một cách ổn định.

Cách 2: Sử dụng API miễn phí từ các nhà cung cấp AI

Ngoài OpenRouter, bạn có thể kết nối OpenClaw trực tiếp với các nhà cung cấp AI có cung cấp gói miễn phí. Dưới đây là hướng dẫn chi tiết cho từng nhà cung cấp.

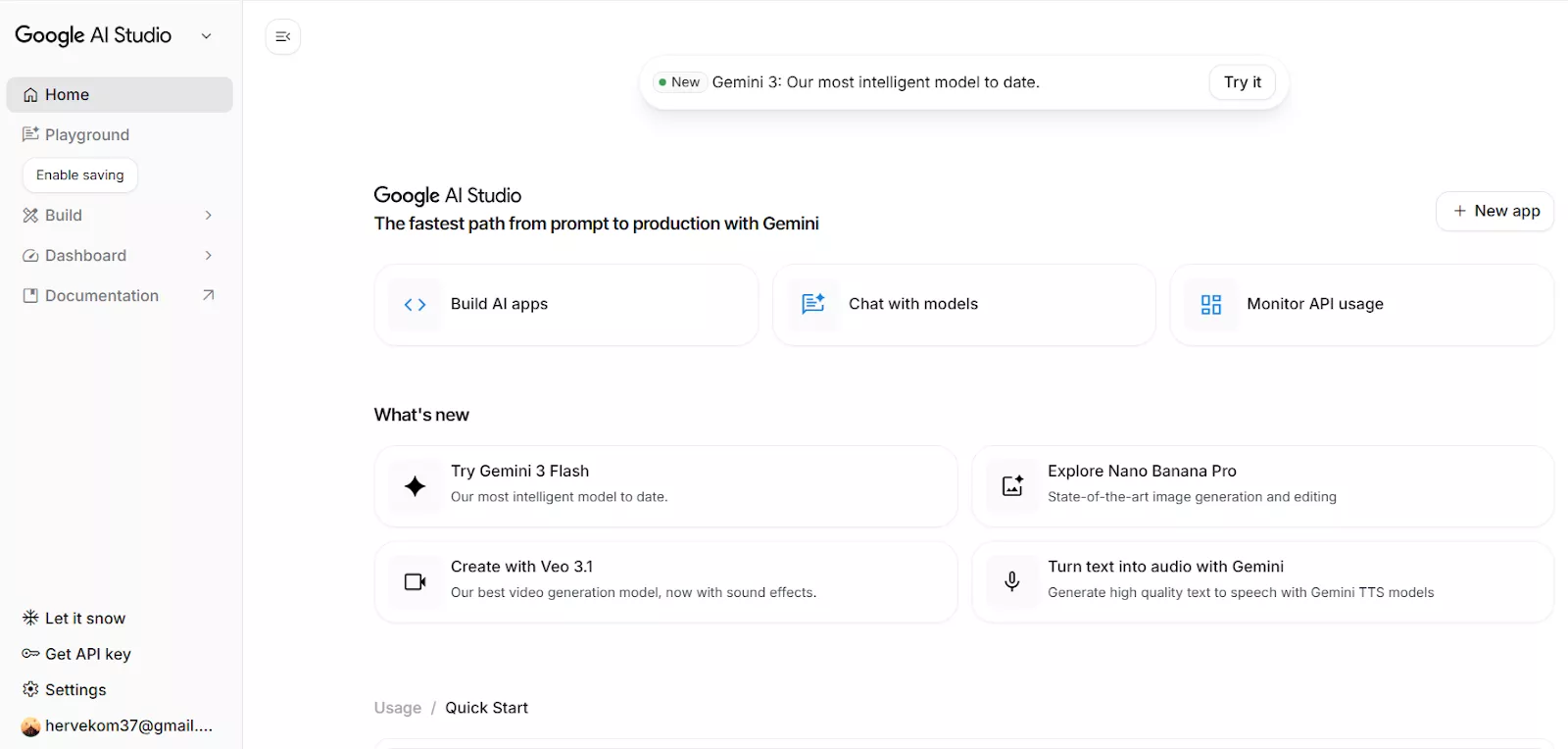

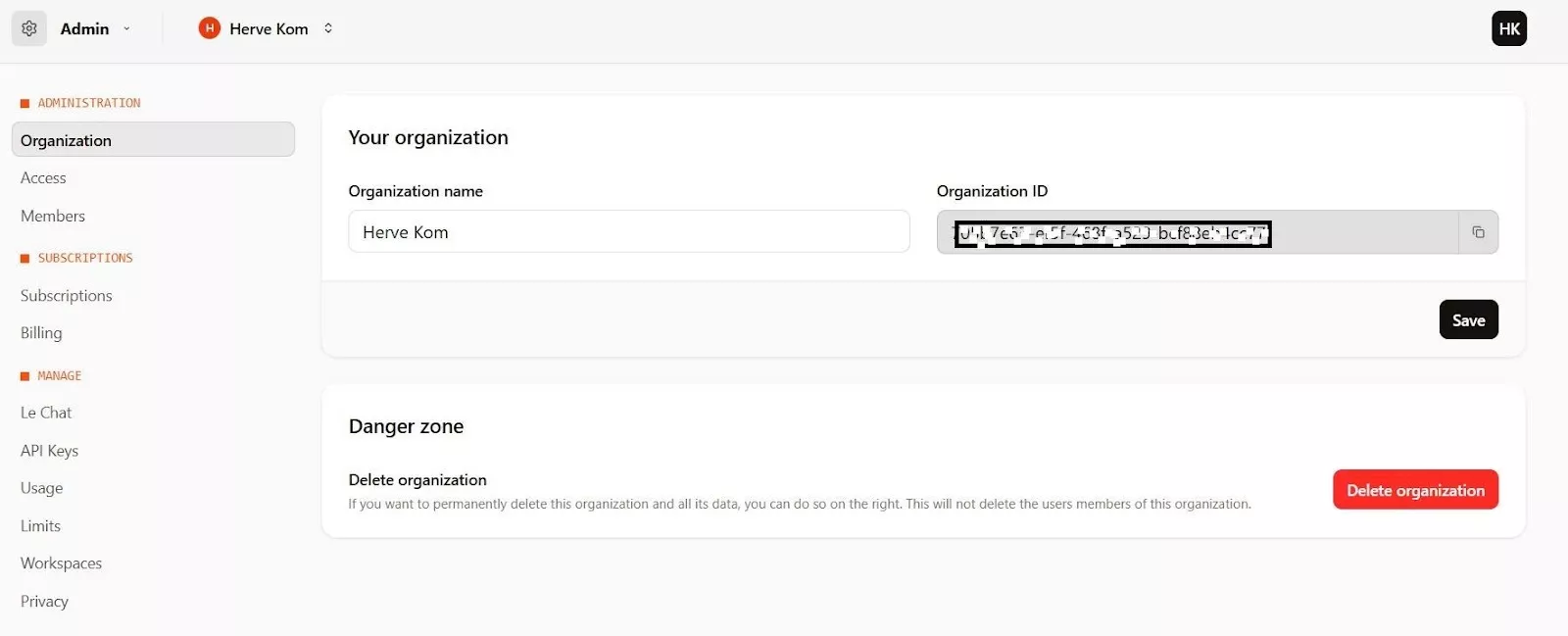

1. Google Gemini

Google cung cấp quyền truy cập miễn phí rộng rãi vào các mô hình Gemini, giúp Gemini trở thành một lựa chọn mạnh mẽ và phù hợp để tích hợp với OpenClaw.

Các bước cấu hình:

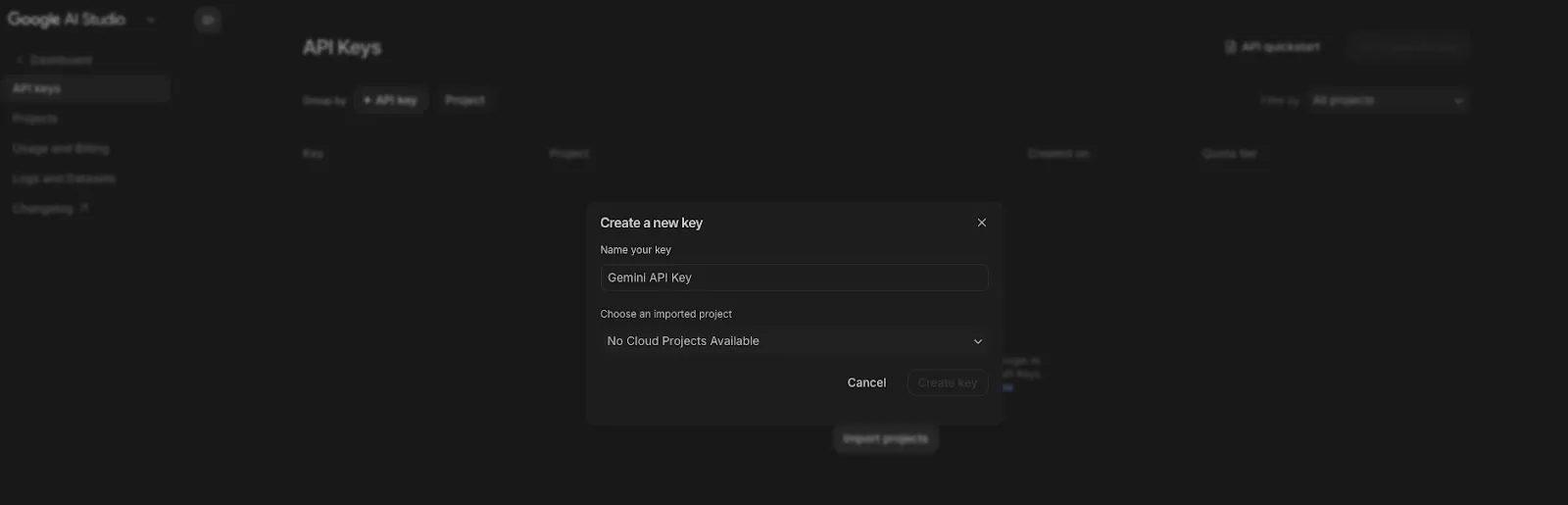

- Tạo khóa API: Truy cập Google AI Studio, đăng nhập bằng tài khoản Google của bạn và tạo một khóa API mới.

- Cập nhật cấu hình: Mở file cấu hình của OpenClaw và thêm các biến sau:

GOOGLE_API_KEY=your_gemini_api_key

MODEL=gemini-1.5-flash![]() Lưu ý

Lưu ý

Thay thế your_gemini_api_key_here bằng khóa API bạn vừa tạo.

Giới hạn gói miễn phí của Gemini:

- 15 yêu cầu mỗi phút.

- 1.000.000 token mỗi phút.

- 1.500 yêu cầu mỗi ngày.

Những giới hạn này cung cấp dung lượng sử dụng miễn phí rất lớn cho OpenClaw.

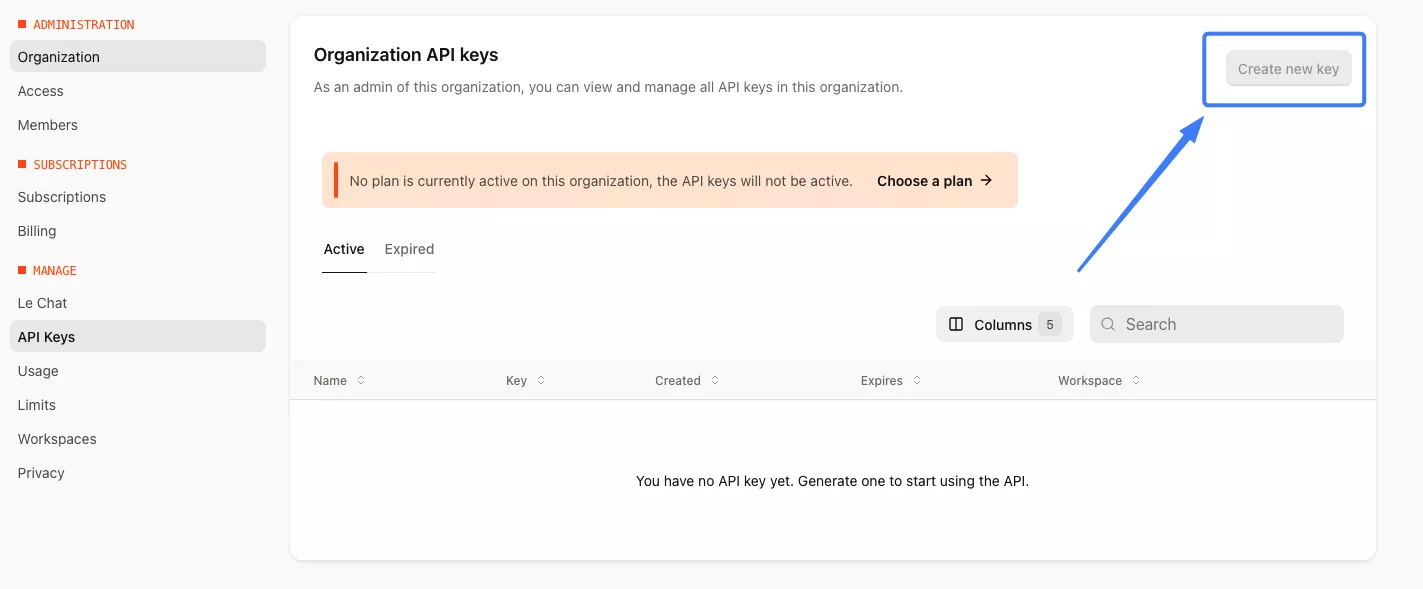

2. Mistral AI

Mistral cung cấp một gói miễn phí phù hợp cho các tác vụ lập trình và các nhu cầu chung của OpenClaw.

Các bước cấu hình:

- Tạo khóa API: Đăng ký tài khoản miễn phí và tạo khóa API tại console.mistral.ai.

- Cập nhật cấu hình: Thêm các biến sau vào tệp cấu hình của bạn:

MISTRAL_API_KEY=your_mistral_api_key

MODEL=mistral-small-latest![]() Lưu ý

Lưu ý

Thay thế your_mistral_api_key_here bằng khóa API của bạn.

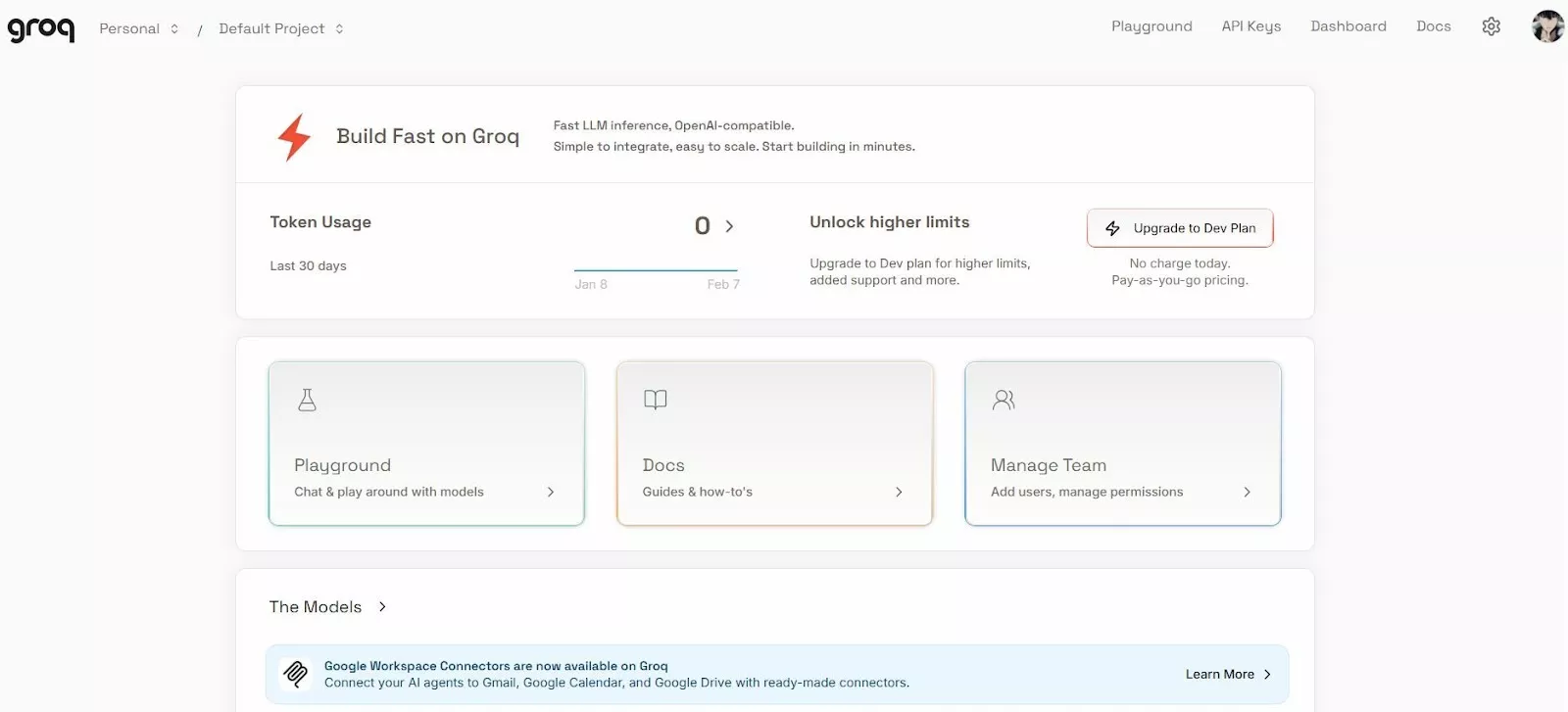

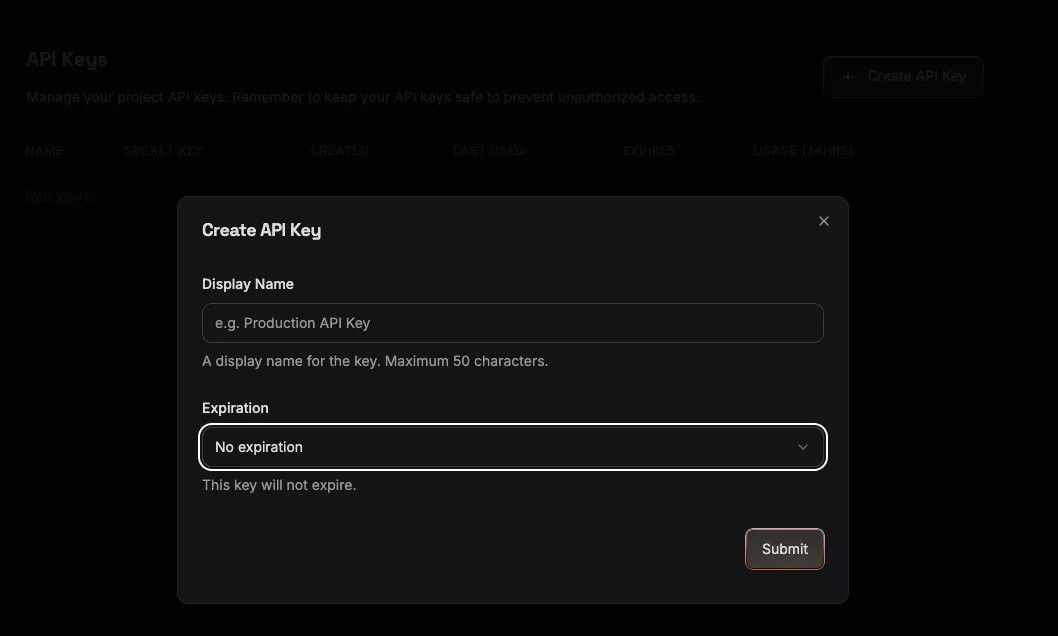

3. Groq

Groq cung cấp khả năng suy luận cực nhanh, lý tưởng để OpenClaw có phản hồi tức thì.

Các bước cấu hình:

- Tạo khóa API: Đăng ký tài khoản tại console.groq.com và tạo một khóa API mới.

- Cập nhật cấu hình: Thêm các biến sau vào file cấu hình của bạn:

GROQ_API_KEY=your_groq_api_key_here

MODEL=llama-3.1-70b-versatile![]() Lưu ý

Lưu ý

Thay thế your_groq_api_key_here bằng khóa API của bạn.

Giới hạn gói miễn phí của Groq:

- 30 yêu cầu mỗi phút.

- 14.400 yêu cầu mỗi ngày.

- Quyền truy cập vào Llama 3.1 70B và các mô hình khác.

Tốc độ vượt trội của Groq giúp OpenClaw phản hồi gần như tức thì.

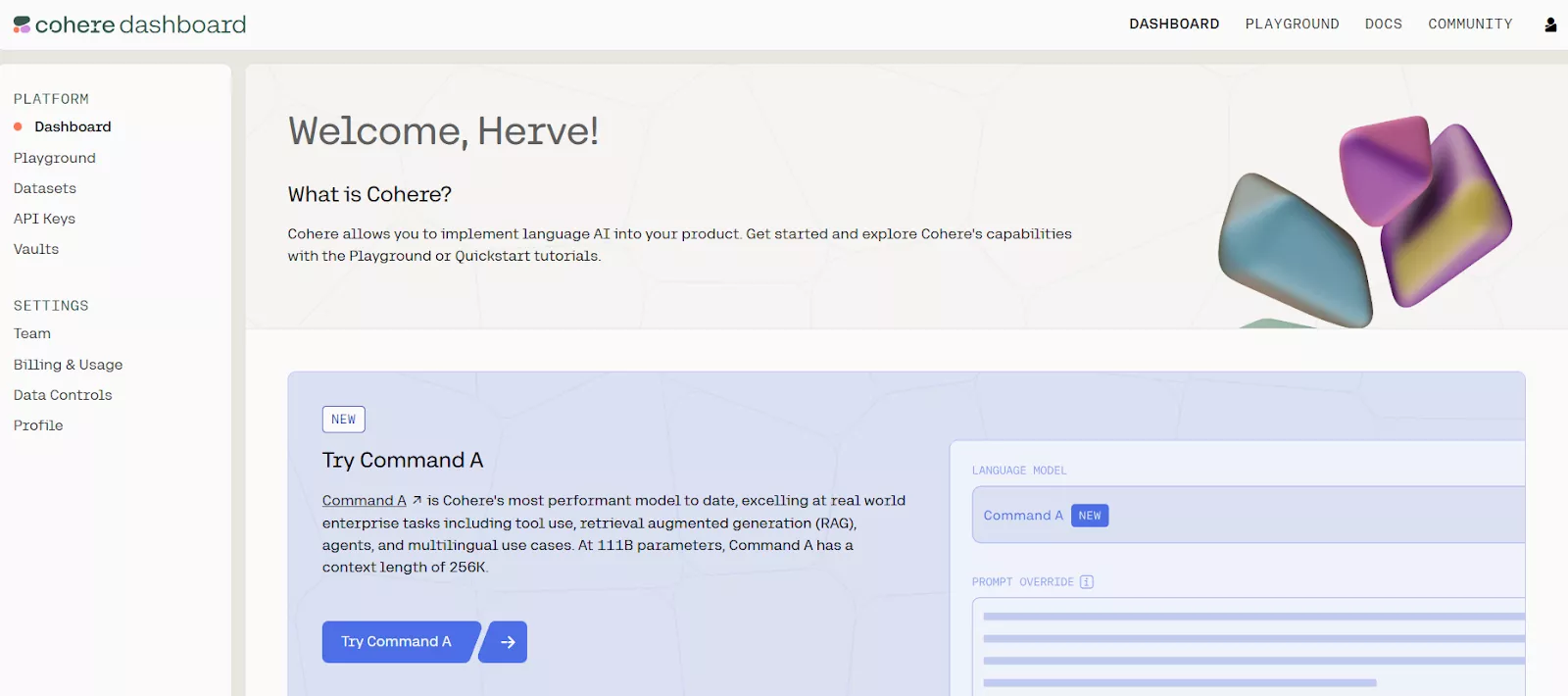

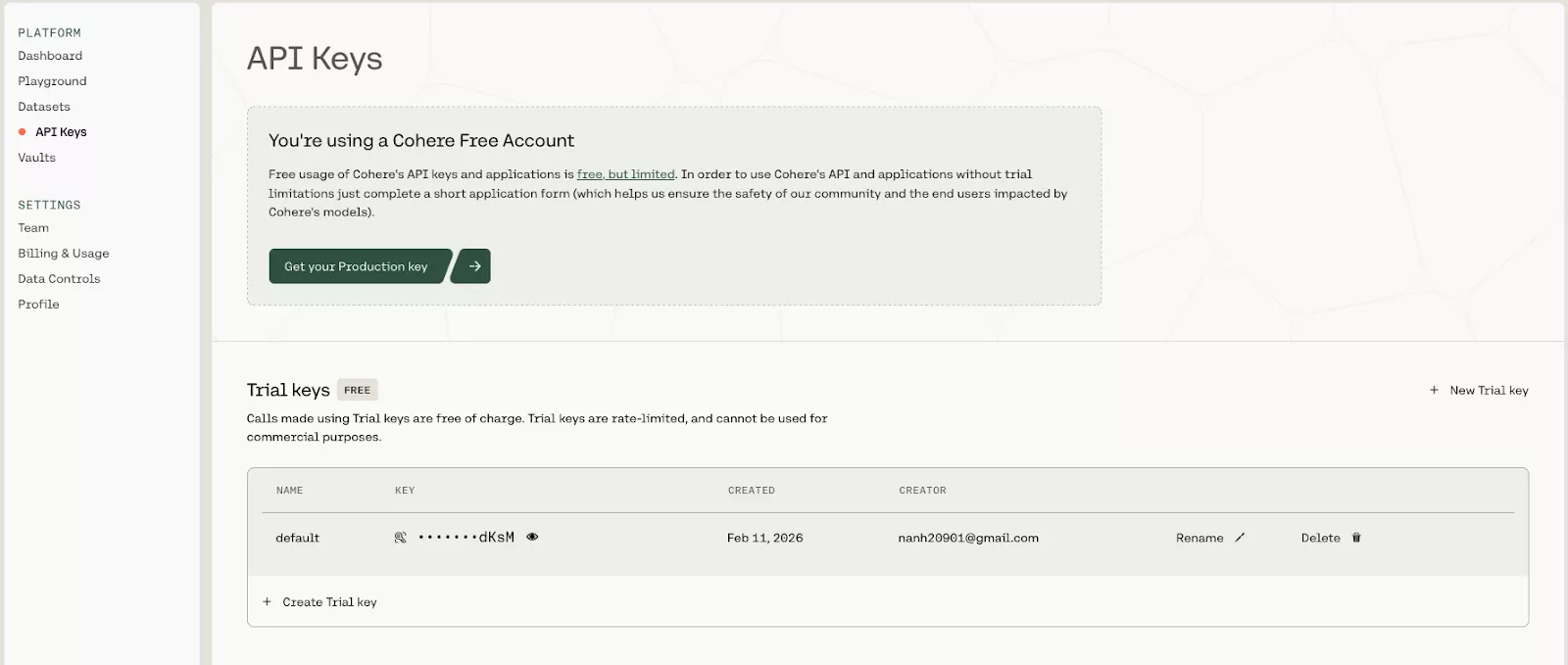

4. Cohere

Cohere cũng cung cấp một gói API miễn phí tương thích tốt với OpenClaw.

Các bước cấu hình:

- Tạo khóa API: Đăng ký tài khoản và lấy khóa API miễn phí của bạn tại dashboard.cohere.com.

- Cập nhật cấu hình: Thêm các biến sau vào file cấu hình của bạn:

COHERE_API_KEY=your_cohere_api_key_here

MODEL=command-r![]() Lưu ý

Lưu ý

Thay thế your_cohere_api_key_here bằng khóa API của bạn.

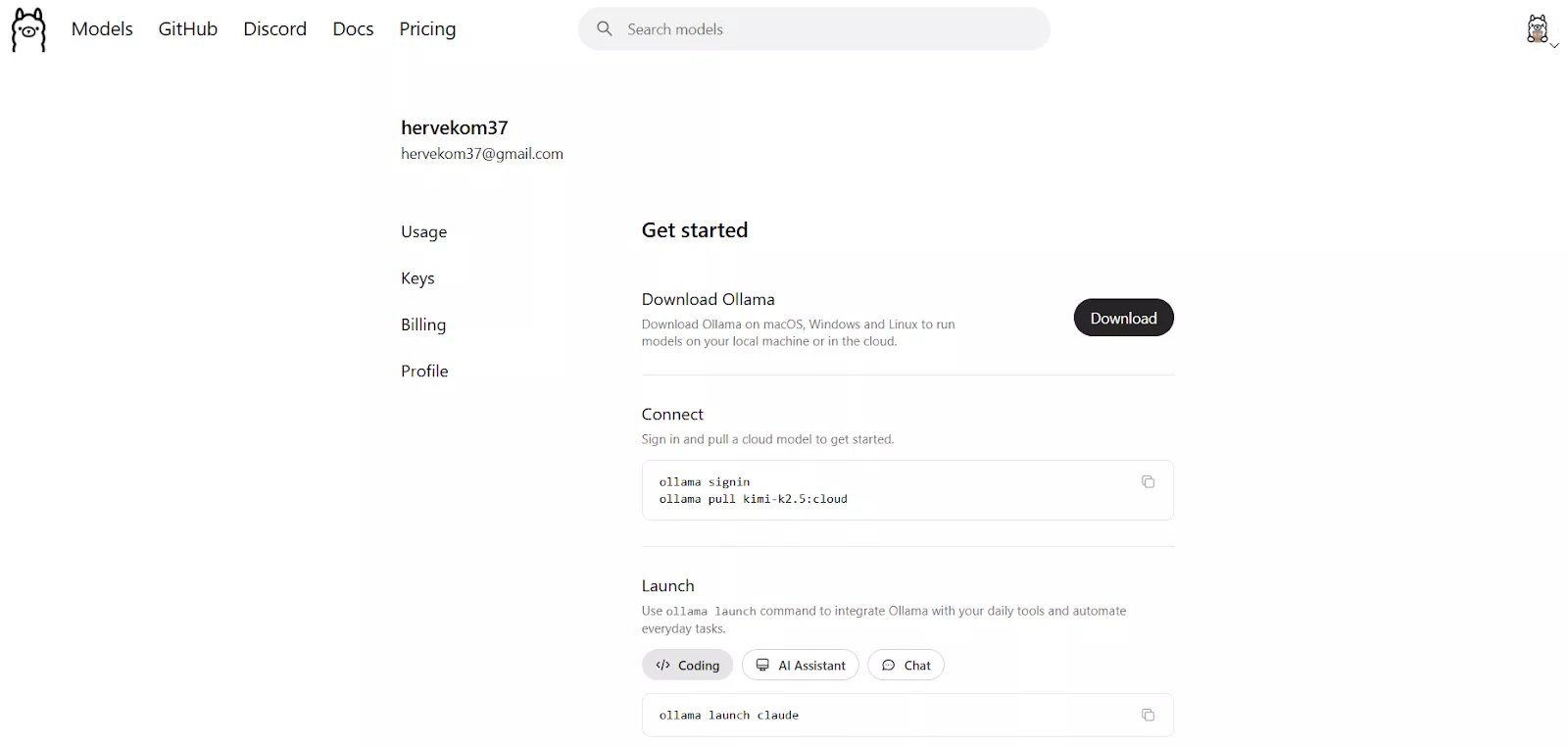

Cách 3: Chạy OpenClaw với Ollama (LLM cục bộ miễn phí)

Cách tiết kiệm chi phí nhất để chạy OpenClaw là sử dụng các mô hình AI cục bộ miễn phí thông qua Ollama, giúp hệ thống hoạt động mà không cần trả phí API.

Ưu điểm khi kết hợp Ollama với OpenClaw/Clawdbot:

- Không tốn chi phí API: Có thể vận hành OpenClaw lâu dài mà không phát sinh phí sử dụng mô hình.

- Bảo mật cao: Toàn bộ dữ liệu được xử lý trực tiếp trên máy, không cần gửi ra dịch vụ bên ngoài.

- Không bị giới hạn tốc độ: Có thể sử dụng OpenClaw thoải mái mà không bị giới hạn số lượng request.

- Hoạt động offline: Hệ thống vẫn có thể chạy ngay cả khi không có kết nối internet.

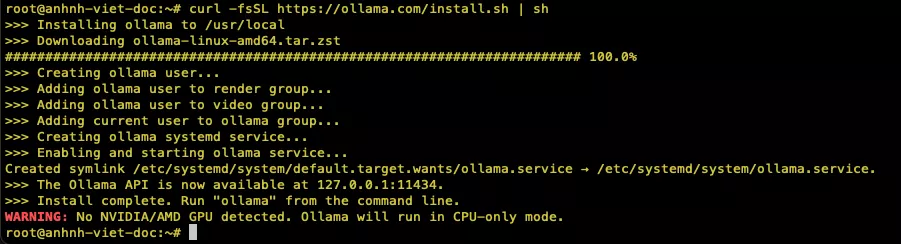

Bước 1: Cài đặt Ollama

Windows:

- Tải Ollama từ ollama.com

- Chạy trình cài đặt.

- Ollama sẽ sẵn sàng cho OpenClaw/Clawdbot.

macOS:

brew install ollamaLinux:

curl -fsSL https://ollama.com/install.sh | sh

Bước 2: Tải mô hình

Tiếp theo, bạn cần tải các mô hình AI phù hợp để sử dụng cùng OpenClaw thông qua Ollama. Dưới đây là một số mô hình phổ biến và hoạt động ổn định:

# Mô hình tổng thể tốt nhất cho OpenClaw

ollama pull llama3.2

# Mô hình tập trung vào lập trình cho OpenClaw

ollama pull codellama

# Mô hình nhỏ hơn, nhanh hơn cho OpenClaw

ollama pull phi3

# Mô hình mạnh mẽ cho OpenClaw (yêu cầu RAM 16GB trở lên)

ollama pull llama3.1:70bTùy vào cấu hình máy và nhu cầu sử dụng, bạn có thể lựa chọn mô hình phù hợp để tối ưu hiệu suất khi chạy OpenClaw.

Bước 3: Cấu hình OpenClaw để kết nối với Ollama

Đây là bước cuối cùng để thiết lập OpenClaw chạy hoàn toàn trên máy tính của bạn.

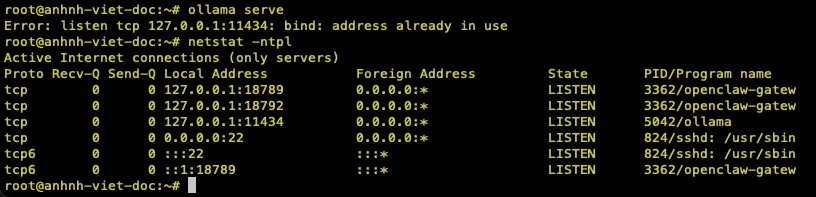

Khởi chạy máy chủ Ollama: Đầu tiên, bạn cần đảm bảo dịch vụ Ollama đang chạy ở chế độ nền để lắng nghe các yêu cầu từ OpenClaw. Mở một cửa sổ dòng lệnh mới và chạy lệnh sau:

ollama serve

Cập nhật file cấu hình: Mở file cấu hình của OpenClaw và thiết lập các biến sau để trỏ đến máy chủ Ollama cục bộ của bạn:

OPENAI_API_BASE=http://localhost:11434/v1

OPENAI_API_KEY=ollama

MODEL=llama3.2Khởi động lại OpenClaw/Clawdbot:

Lưu lại file cấu hình và khởi động lại ứng dụng OpenClaw để các thay đổi có hiệu lực. Phiên bản OpenClaw của bạn giờ đây đã hoạt động hoàn toàn cục bộ, không tốn chi phí API và đảm bảo riêng tư.

Lưu ý bảo mật khi chạy OpenClaw miễn phí

Việc chạy OpenClaw miễn phí rất hấp dẫn, nhưng đừng vì thế mà lơ là bảo mật. Với kinh nghiệm của mình, bạn nên lưu ý những điều sau để vận hành OpenClaw một cách bền vững và an toàn:

- Không để hệ thống truy cập công khai trên internet: Đã có hơn 21.000 máy chủ OpenClaw bị phát hiện bị lộ do cấu hình public.

- Ưu tiên sử dụng mô hình cục bộ cho dữ liệu nhạy cảm: Khi chạy với Ollama, toàn bộ dữ liệu sẽ được xử lý trên máy, giúp đảm bảo quyền riêng tư.

- Bảo vệ API key: Tuyệt đối không chia sẻ hoặc đưa khóa API của OpenClaw lên các kho mã nguồn công khai như GitHub.

Tóm tắt đánh giá các cách chạy OpenClaw miễn phí

Dựa trên trải nghiệm thực tế khi thử nghiệm và triển khai OpenClaw với nhiều nguồn LLM khác nhau, mỗi phương pháp đều có những ưu điểm riêng tùy theo nhu cầu sử dụng như tốc độ, chi phí hay mức độ dễ triển khai.

Dưới đây là bảng so sánh đánh giá cá nhân của mình, hy vọng sẽ giúp bạn chọn được phương án phù hợp nhất với nhu cầu.

| Phương pháp | Đánh giá từ trải nghiệm thực tế |

|---|---|

| OpenRouter | Dễ thiết lập nhất vì chỉ cần một API là có thể truy cập nhiều mô hình miễn phí khác nhau. Phù hợp cho người mới bắt đầu. |

| Gemini | Chất lượng phản hồi khá tốt và ổn định khi xử lý các tác vụ tổng quát hoặc nội dung dài. |

| Groq | Tốc độ phản hồi rất nhanh khi chạy các mô hình lớn như Llama, phù hợp cho các hệ thống cần phản hồi gần như real-time. |

| Ollama | Miễn phí hoàn toàn khi chạy LLM cục bộ, đồng thời đảm bảo tính riêng tư vì dữ liệu không rời khỏi máy. Phù hợp cho môi trường cần bảo mật cao. |

Thuê VPS để chạy OpenClaw ổn định và lâu dài

Trong quá trình thử nghiệm thực tế, việc chạy OpenClaw trên máy cá nhân phù hợp để test nhanh hoặc trải nghiệm ban đầu. Tuy nhiên, nếu bạn muốn triển khai OpenClaw hoạt động 24/7, kết nối với nhiều nền tảng chat hoặc chạy các mô hình AI lớn hơn, việc thuê VPS sẽ là lựa chọn ổn định và hiệu quả hơn.

Khi sử dụng VPS, OpenClaw có thể hoạt động liên tục mà không phụ thuộc vào máy cá nhân, đồng thời giúp bạn dễ dàng quản lý hệ thống, triển khai automation hoặc tích hợp thêm các dịch vụ AI khác.

Nếu bạn đang tìm giải pháp thuê VPS để chạy OpenClaw, Vietnix cung cấp hạ tầng máy chủ với cấu hình mạnh, băng thông ổn định và khả năng mở rộng linh hoạt. Điều này giúp hệ thống AI agent hoạt động mượt mà, đặc biệt khi cần xử lý nhiều request hoặc kết nối với các mô hình LLM cục bộ.

Ngoài ra, khi thuê VPS OpenClaw tại Vietnix, bạn còn được hỗ trợ kỹ thuật trong quá trình triển khai, giúp việc cài đặt OpenClaw hoặc các dịch vụ AI trở nên đơn giản và nhanh chóng hơn. Đây là lựa chọn phù hợp nếu bạn muốn xây dựng AI agent chạy 24/7 trên server riêng mà vẫn đảm bảo hiệu suất và tính ổn định.

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

Giữa Gemini, Groq, và Ollama, phương án nào là tốt nhất để chạy OpenClaw miễn phí?

Không có phương án nào “tốt nhất” tuyệt đối, lựa chọn phương án nào còn phụ thuộc hoàn toàn vào ưu tiên của bạn:

– Ưu tiên chất lượng câu trả lời: Chọn Gemini.

– Ưu tiên tốc độ phản hồi siêu nhanh: Chọn Groq.

– Ưu tiên bảo mật, quyền riêng tư và miễn phí 100%: Chọn Ollama (nếu máy bạn đủ mạnh).

Chạy OpenClaw miễn phí bằng Ollama có yêu cầu cấu hình máy tính cao không?

Có, việc chạy OpenClaw miễn phí bằng Ollama đòi hỏi cấu hình máy tính tương đối cao, đặc biệt là về bộ nhớ RAM. Để có trải nghiệm mượt mà với các mô hình phổ biến như Llama 3 8B, máy tính của bạn nên có ít nhất 16GB RAM. Ngoài ra, nếu máy có card đồ họa (GPU) với dung lượng VRAM lớn, tốc độ xử lý và phản hồi sẽ được cải thiện đáng kể. Nhìn chung, mô hình AI bạn chọn càng lớn và phức tạp thì yêu cầu về phần cứng càng cao.

Có thể chạy OpenClaw miễn phí trên Windows mà không cần cài WSL không?

Có, bạn hoàn toàn có thể chạy OpenClaw miễn phí trên Windows mà không cần cài WSL. Khi bạn sử dụng các API miễn phí như của Gemini hay Groq, OpenClaw chỉ đóng vai trò gửi và nhận dữ liệu nên không phụ thuộc vào WSL. Đối với phương án tự host bằng Ollama thì Ollama hiện đã có phiên bản preview chạy trực tiếp trên Windows, giúp bạn không cần phải cài đặt môi trường Linux phức tạp nữa. Vì vậy, cả hai cách tiếp cận phổ biến đều khả thi trên môi trưng Windows gốc.

OpenClaw mang đến một cách tiếp cận mới để xây dựng AI agent cá nhân hóa, giúp bạn tự động hóa nhiều công việc hằng ngày mà không phụ thuộc vào các dịch vụ AI trả phí. Hãy bắt đầu thử nghiệm ngay trên máy cá nhân hoặc VPS để trải nghiệm sức mạnh của OpenClaw trong thực tế.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày