Pytorch là gì? Hướng dẫn sử dụng PyTorch trong AI hiện nay

Đã kiểm duyệt nội dung

Đánh giá

PyTorch là một framework Deep Learning mã nguồn mở, được sử dụng rộng rãi để xây dựng và triển khai các mô hình trí tuệ nhân tạo trong nhiều lĩnh vực như thị giác máy tính, xử lý ngôn ngữ tự nhiên hay học tăng cường. Trong bài viết này, dựa trên kinh nghiệm trực tiếp hỗ trợ khách hàng triển khai các mô hình AI trên hạ tầng VPS tại Vietnix, mình sẽ giúp bạn hiểu rõ hơn về PyTorch là gì, các tính năng cơ bản, cách xây dựng mô hình cho đến những ứng dụng thực tế.

Những điểm chính

- Quan điểm của mình: Điểm mạnh nhất khiến PyTorch vượt mặt các đối thủ chính là triết lý đồ thị tính toán động (Dynamic Computational Graph), giúp việc debug mô hình AI trở nên trực quan như viết code Python thông thường. Qua quá trình hỗ trợ triển khai thực tế, mình thấy đây là công cụ tối ưu để rút ngắn khoảng cách từ ý tưởng nghiên cứu đến sản phẩm hoàn chỉnh nhờ khả năng tùy biến cực cao.

- Khái niệm PyTorch: Giới thiệu khái niệm PyTorch là một framework Deep Learning mã nguồn mở, nêu rõ vai trò của nó trong việc xây dựng và triển khai mô hình AI.

- Các tính năng cơ bản của PyTorch: Trình bày những tính năng cốt lõi như tensor, tính toán trên GPU, autograd và đồ thị tính toán động.

- Lịch sử hình thành của PyTorch: Tóm tắt quá trình ra đời và phát triển của PyTorch từ 2016, quá trình sáp nhập Caffe2 đến khi chuyển sang PyTorch Foundation.

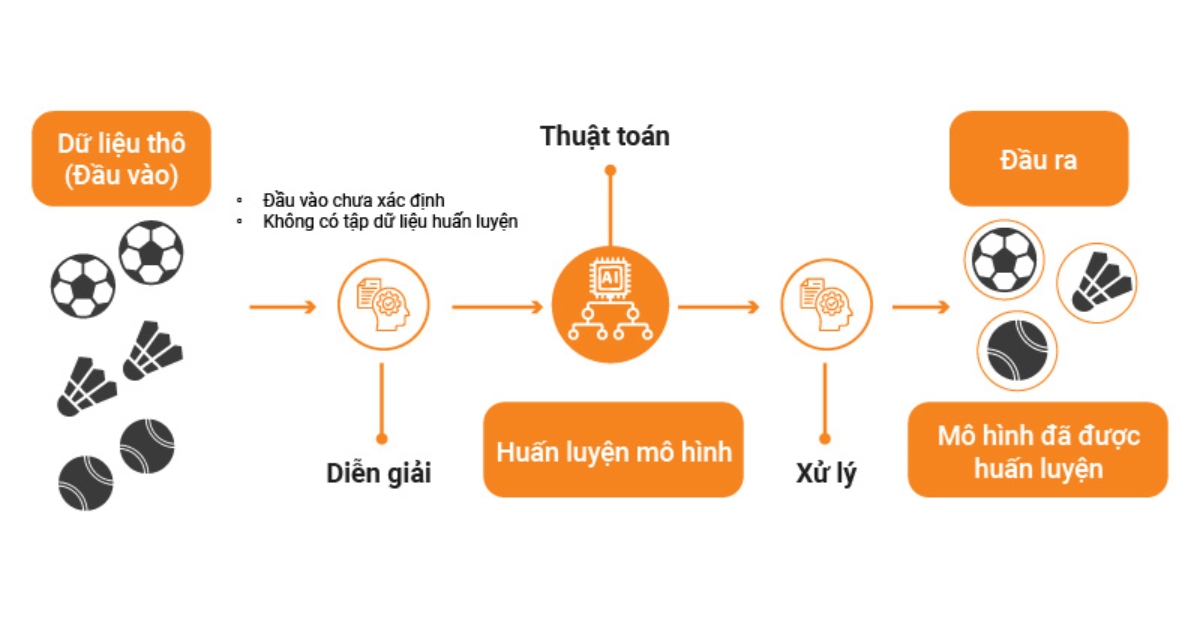

- Các khái niệm cơ bản của PyTorch: Giải thích các khái niệm nền tảng như Tensor, đồ thị tính toán động, Autograd và Module tạo nên cách PyTorch biểu diễn dữ liệu và xây dựng mô hình.

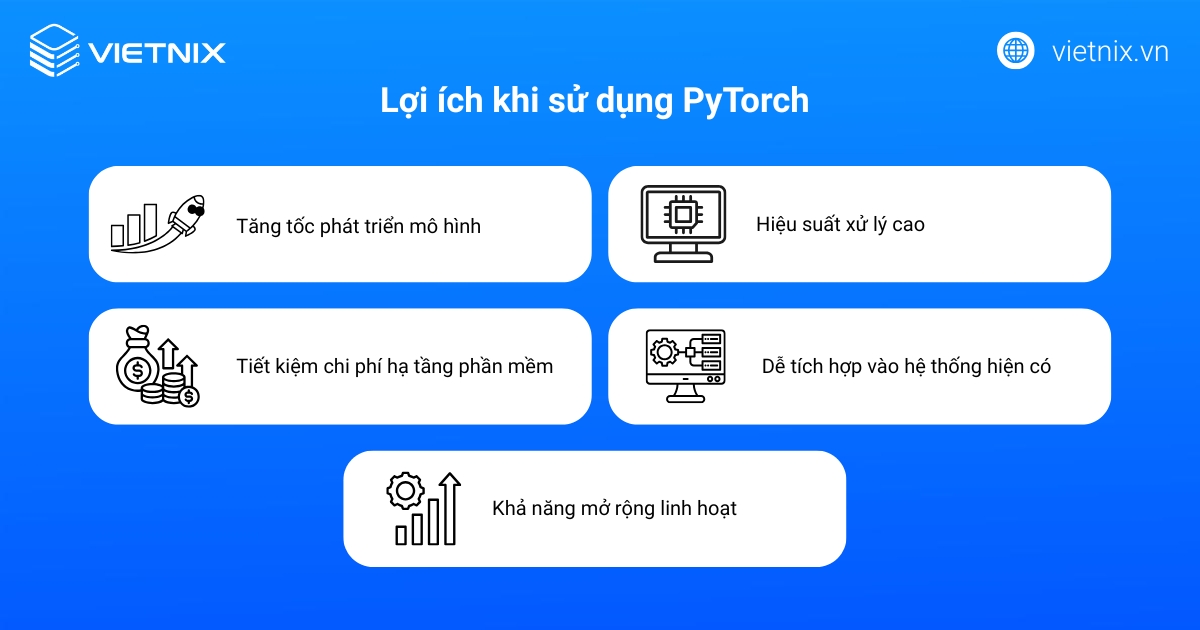

- Lợi ích khi sử dụng PyTorch: Tập trung vào những lợi ích PyTorch mang lại cho doanh nghiệp như tăng tốc phát triển mô hình, tiết kiệm chi phí, hiệu suất cao và khả năng mở rộng.

- Hướng dẫn sử dụng PyTorch trong AI: Cung cấp hướng dẫn thực hành như tạo tensor, thao tác tensor, xây dựng model, tạo Dataset/Dataloader, huấn luyện và đánh giá mô hình, sử dụng GPU, lựa chọn hàm loss và hàm tối ưu

- So sánh giữa PyTorch và TensorFlow: So sánh PyTorch và TensorFlow theo các tiêu chí như đồ thị tính toán, API, triển khai, ứng dụng và cộng đồng.

- Ưu nhược điểm của PyTorch: Tổng hợp rõ ràng các điểm mạnh và hạn chế để bạn thấy rõ bức tranh cân bằng hơn khi cân nhắc dùng PyTorch.

- Các ứng dụng của PyTorch: Minh hoạ các ứng dụng thực tế của PyTorch trong thị giác máy tính, NLP và robotics/học tăng cường.

- Giới thiệu Vietnix cung cấp giải pháp VPS phù hợp để triển khai các ứng dụng AI xây dựng bằng PyTorch với hạ tầng ổn định, tốc độ cao và tài nguyên tối ưu,…

- Giải đáp thắc mắc: Trả lời các câu hỏi liên quan đến PyTorch.

PyTorch là gì?

PyTorch là một framework Deep Learning mã nguồn mở do Facebook AI Research (FAIR) phát triển và ngày càng được sử dụng rộng rãi nhờ tính linh hoạt, dễ dùng và hiệu năng tốt. Dựa trên nền tảng Torch, PyTorch cung cấp bộ công cụ mạnh để xây dựng và huấn luyện mô hình Deep Learning, đặc biệt hữu ích trong các bài toán Thị giác máy tính (Computer Vision) và Xử lý ngôn ngữ tự nhiên (Natural Language Processing – NLP).

Để huấn luyện các mô hình AI phức tạp và tận dụng tối đa đồ thị tính toán động của PyTorch, bạn cần một hạ tầng máy chủ có hiệu năng xử lý mạnh mẽ và ổn định. Dịch vụ VPS OpenClaw tại Vietnix chính là giải pháp tối ưu, cung cấp tài nguyên phần cứng chuyên dụng giúp tăng tốc quá trình training và triển khai các dự án Deep Learning. Với khả năng khởi tạo nhanh chóng và băng thông không giới hạn, nền tảng này đảm bảo môi trường phát triển của bạn luôn mượt mà, sẵn sàng đáp ứng mọi nhu cầu tính toán hiệu năng cao.

Các tính năng cơ bản của PyTorch

PyTorch cho phép thực hiện các phép tính trên mảng và ma trận dưới dạng tensor một cách hiệu quả, tương tự như NumPy nhưng có thể tận dụng GPU để tăng tốc xử lý. Bên cạnh đó, PyTorch còn cung cấp nhiều công cụ và module hỗ trợ xây dựng, huấn luyện và vận hành mô hình Deep Learning nhờ cơ chế tự động tính đạo hàm và đồ thị tính toán động giúp việc thiết kế, chỉnh sửa kiến trúc mạng nơ-ron trở nên linh hoạt hơn.

Lịch sử hình thành của PyTorch

PyTorch được giới thiệu vào năm 2016 với mục tiêu xây dựng một framework Deep Learning có giao diện gần gũi với Python và phù hợp với thói quen của cộng đồng khoa học dữ liệu. Được FAIR hỗ trợ, PyTorch nhanh chóng trở nên phổ biến trong giới nghiên cứu nhờ cú pháp tự nhiên, linh hoạt và dễ tiếp cận với người dùng Python.

Năm 2018, Facebook sáp nhập Caffe2 vào PyTorch để framework này không chỉ phục vụ cho việc nghiên cứu mà còn dần hoàn thiện cho môi trường sản xuất. Đến năm 2022, PyTorch được chuyển giao cho PyTorch Foundation dưới Linux Foundation, tiếp tục mở rộng cộng đồng và hiện đóng vai trò quan trọng trong nhiều ứng dụng AI.

Các khái niệm cơ bản của PyTorch

Tensor

Tensor là một cấu trúc dữ liệu đa chiều tương tự mảng trong NumPy nhưng được tối ưu cho các phép toán số học và có thể chạy hiệu quả trên GPU. Đây là kiểu dữ liệu cơ bản trong PyTorch dùng để biểu diễn nhiều dạng dữ liệu như ảnh, video, văn bản hay bảng số liệu và tận dụng khả năng xử lý song song của GPU nhằm giải các bài toán Deep Learning phức tạp một cách hiệu quả hơn.

Đồ thị tính toán động

Khác với đồ thị tĩnh, đồ thị tính toán động (define-by-run) cho phép thay đổi cấu trúc mạng nơ-ron ngay trong quá trình huấn luyện, nhờ đó việc thử nghiệm ý tưởng mới, tinh chỉnh mô hình và xử lý dữ liệu không đồng nhất như trong NLP trở nên linh hoạt hơn, hạn chế phải dùng padding. Khi xảy ra lỗi, PyTorch sẽ di chuyển ra ngoại lệ Python ngay tại dòng code gặp vấn đề nhằm hỗ trợ lập trình viên dễ dàng gỡ lỗi.

Autograd

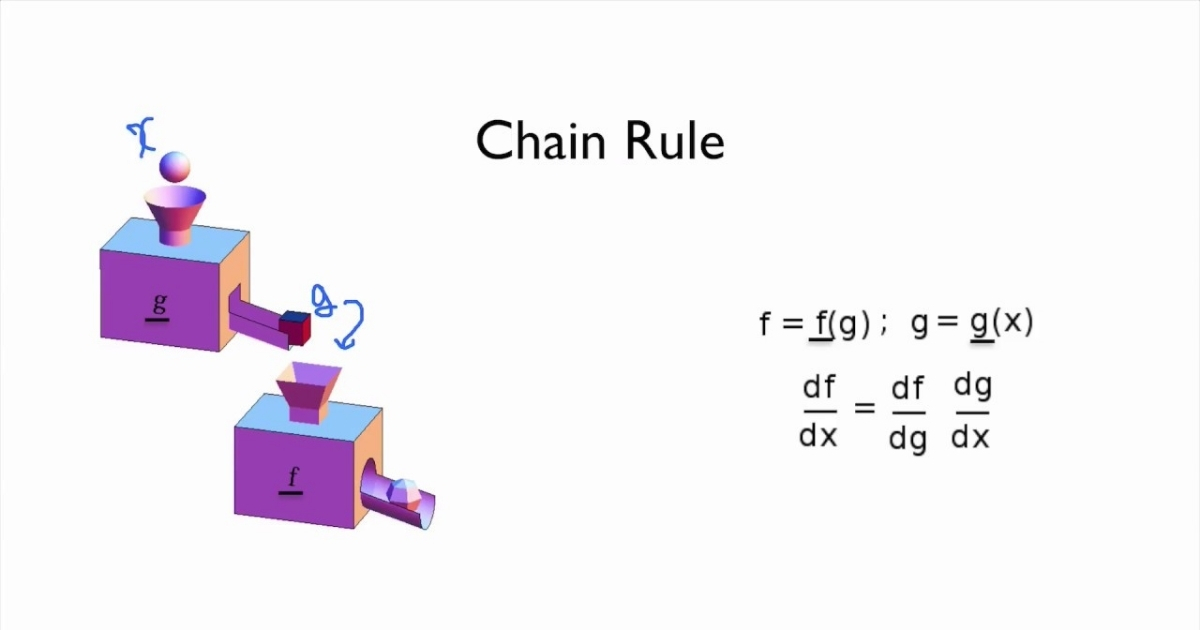

Autograd là tính năng tự động tính gradient (đạo hàm) cho các phép toán trên tensor, cho phép đơn giản hóa quá trình xây dựng và huấn luyện mô hình Deep Learning vì không cần tự viết các công thức đạo hàm phức tạp theo quy tắc chuỗi. Nhờ hỗ trợ mô hình động, Autograd cũng giúp người dùng PyTorch dễ dàng thử nghiệm kiến trúc mới và thay đổi luồng tính toán theo dữ liệu mà không phải định nghĩa lại toàn bộ đồ thị.

Module

Module trong PyTorch là các khối xây dựng cơ bản của kiến trúc mô hình. Nhờ các module được cung cấp sẵn như lớp mạng nơ-ron, hàm mất mát và thuật toán tối ưu, người dùng có thể dễ dàng lắp ráp các lớp, cấu hình mô hình, tái sử dụng code và rút ngắn thời gian phát triển AI.

Lợi ích khi sử dụng PyTorch

Trong bối cảnh doanh nghiệp ngày càng cạnh tranh nhờ khả năng khai thác AI, PyTorch mang lại nhiều lợi ích thiết thực cho quá trình xây dựng và triển khai giải pháp trí tuệ nhân tạo. Dưới đây là những điểm nổi bật mà doanh nghiệp có thể tận dụng:

- Tăng tốc phát triển mô hình: Giúp đội ngũ kỹ thuật nhanh chóng xây dựng, huấn luyện và thử nghiệm mô hình, rút ngắn thời gian đưa sản phẩm AI ra thị trường.

- Tiết kiệm chi phí hạ tầng phần mềm: Là nền tảng mã nguồn mở, hỗ trợ giảm chi phí bản quyền và tận dụng hiệu quả tài nguyên phần cứng như GPU để tối ưu hiệu năng xử lý.

- Hiệu suất xử lý cao: Hỗ trợ xử lý theo lô (batch processing) và huấn luyện song song trên nhiều GPU, phù hợp với các bài toán cần khối lượng tính toán lớn.

- Dễ tích hợp vào hệ thống hiện có: Có thể gắn kết linh hoạt với các pipeline dữ liệu và hệ thống sản xuất, hỗ trợ doanh nghiệp đưa mô hình vào vận hành thực tế.

- Khả năng mở rộng linh hoạt: Phù hợp cho cả startup đang thử nghiệm mô hình lẫn doanh nghiệp lớn triển khai hệ thống AI quy mô lớn, đảm bảo tính ổn định và hiệu quả khi mở rộng.

Ý kiến từ chuyên gia: Mình đánh giá cao PyTorch ở khả năng gỡ lỗi (debug) cực kỳ minh bạch, giúp tiết kiệm hàng giờ đồng hồ so với các framework khác khi mô hình gặp lỗi hội tụ. Tuy nhiên, lợi ích lớn nhất đối với doanh nghiệp chính là hệ sinh thái cộng đồng khổng lồ; bạn có thể dễ dàng tìm thấy các mô hình tiền huấn luyện (pre-trained) chất lượng cao để tùy chỉnh lại, giúp tối ưu hóa nguồn lực và đảm bảo tính bền vững cho dự án dài hạn.

Hướng dẫn sử dụng PyTorch trong AI

Tensor Trong PyTorch

Create Tensor

Tensor có thể được tạo theo nhiều cách khác nhau chẳng hạn chuyển đổi từ list Python hoặc mảng NumPy, tùy thuộc vào dữ liệu sẵn có và nhu cầu sử dụng. Dưới đây là một số phương pháp cơ bản thường được người dùng PyTorch áp dụng:

#Tạo một Tensor từ list cho trước sử dụng torch.Tensort = torch.Tensor([[1,2,3],[3,4,5]])#Tạo một Tensor với kích thước (2, 3) cho trước và có giá trị ngẫu nhiên tuân theo phân phối chuẩn với trung vị bằng 0 và phương sai bằng 1t = torch.randn(2, 3)# Tạo một Tensor với kích thước (2, 3) cho trước và tất cả phần tử có giá trị đều bằng 1t = torch.ones(2, 3)# Tạo một Tensor với kích thước (2, 3) cho trước và tất cả phần tử có giá trị đều bằng 0t = torch.zeros(2, 3)#Tạo một tensor có kích thước (2,3) với giá trị nằm trong khoảng từ 0->10t = torch.randint(low = 0,high = 10,size = (2,3))#Sử dụng torch.from_numpy để chuyển đổi từ Numpy array sang Tensora = np.array([[1,2,3],[3,4,5]])t = torch.from_numpy(a)# Sử dụng .numpy() để chuyển đổi từ Tensor sang Numpy arrayt = t.numpy()Tensor Operations

Là một trong những thành phần cốt lõi của PyTorch, tensor hỗ trợ rất nhiều cách thao tác khác nhau. Dưới đây là một số cách sử dụng đơn giản mà bạn có thể bắt đầu áp dụng:

A = torch.randn(2,4)W = torch.randn(4,3)#Nhân 2 ma trận sử dụng .mmt = A.mm(W)print(t)#Ma trận chuyển vịt = t.t()print(t.shape)#Bình phương mỗi giá trị trong Tensort = t**2print(t)#Trả về size của Tensort_size = t.size()print(t_size)#Duỗi Tensor có kích thước (a,b) thành (1,a*b)t = t.flatten()print(t)#Thêm 1 chiều với dim bằng 0 cho Tensort = t.unsqueeze(0)print(t.shape)#Giảm 1 chiều với dim bằng 0 cho Tensort = t.squeeze(0)print(t.shape)#hàm transpose có tác dụng đổi chiều dữ liệu ví dụ dữ liệu đang có shape=(224,224,3), sau khi thực hiện câu lệnh dưới sẽ thành (3,224,224)t = t.transpose(2,0,1)#hàm view có tác dụng giảm chiều dữ liệu ví dụ dữ liệu đang có shape = (3,224,224), sau khi thực hiện câu lệnh dưới sẽ thành (3,224*224)t = t.view(t.size(0),-1)Tạo một model bằng PyTorch

Khi xây dựng mô hình Deep Learning trong PyTorch, bạn có thể tạo mô hình dưới dạng một lớp với hai hàm quan trọng là init và forward:

- init: Dùng để khai báo và khởi tạo các thành phần của mô hình như các layer, backbone pretrained hoặc các biến, hàm cần dùng. Vì lớp mô hình kế thừa từ nn.Module nên trong hàm này bạn luôn cần gọi hàm super().init() để khởi tạo đúng lớp cha.

- forward: Hàm này có nhiệm vụ nhận dữ liệu đầu vào, truyền lần lượt qua các layer đã khai báo trong mô hình và trả về kết quả đầu ra sau cùng.

class MySkipCModel(nn.Module):def __init__(self):super().__init__()# Định nghĩa các layersself.layer1 = nn.Linear(256, 128)self.layer2 = nn.Linear(128, 256)self.layer3 = nn.Linear(128, 10)def forward(self, x):#Kết nối các layer lại với nhaux_out1 = self.layer1(x)x_out2 = x + self.layer2(x_out1)x_out2 = self.layer1(x_out2)x = self.layer3(x_out2)return xTạo Dataset theo Batch Size trong PyTorch

Dataset

Để huấn luyện mô hình hiệu quả, bạn nên chuẩn bị dữ liệu và chia thành ba phần: huấn luyện (train), kiểm định (validation) và kiểm tra (test). Sau đó, bạn đưa dữ liệu vào mô hình theo từng batch để tiến hành huấn luyện. Trước khi tự xây dựng Dataset riêng, bạn có thể tận dụng các tiện ích có sẵn như torchvision.datasets.ImageFolder với lưu ý là dữ liệu cần được sắp xếp theo đúng cấu trúc thư mục mà ImageFolder yêu cầu:

Data/├── Train/│ ├── Image_train1│ ├── Image_train2│ ├── …│ └── Image_train1000├── Val/│ ├── Image_val1│ ├── Image_val2│ └── …└── Test/├── Image_test1├── Image_test2└── …Sau khi sắp xếp dữ liệu đúng cấu trúc thư mục, bạn có thể dùng torchvision.datasets.ImageFolder để tạo dataset theo mẫu sau:

from torchvision import transformsfrom torchvision.datasets import ImageFoldertraindir = “data/train/”t = transforms.Compose([transforms.Resize(size=256),transforms.CenterCrop(size=224),transforms.ToTensor()])train_dataset = ImageFolder(root=traindir,transform=t)print(“Num Images in Dataset:”, len(train_dataset))print(“Example Image and Label:”, train_dataset[2])Từ dataset đã tạo ở bước trước, bạn có thể nhận được kết quả đầu ra với số lượng ảnh trong tập dữ liệu và một ví dụ minh họa gồm tensor ảnh kèm nhãn tương ứng như dưới đây:

Num Images in Dataset: 847Example Image and Label: (tensor([[[0.1882, 0.2118, 0.2118, …, 0.1686, 0.1569, 0.1725],[0.1882, 0.2039, 0.2275, …, 0.1882, 0.1765, 0.1961],[0.1725, 0.1529, 0.1843, …, 0.1020, 0.1176, 0.1569],…[0.1451, 0.1412, 0.1333, …, 0.1176, 0.1137, 0.1059],[0.1255, 0.1216, 0.1137, …, 0.0980, 0.0980, 0.0980],[0.1333, 0.1294, 0.1255, …, 0.0980, 0.0980, 0.0941]],[[0.4784, 0.4902, 0.4863, …, 0.4941, 0.4902, 0.4980],[0.4980, 0.5020, 0.5216, …, 0.4901, 0.4824, 0.5020],[0.5020, 0.4863, 0.5098, …, 0.4549, 0.4588, 0.4902],…[0.4588, 0.4549, 0.4471, …, 0.4078, 0.4000, 0.3922],[0.4353, 0.4314, 0.4235, …, 0.3961, 0.3843, 0.3804],[0.4431, 0.4353, 0.4314, …, 0.3961, 0.3882, 0.3843]],[[0.8157, 0.8235, 0.8118, …, 0.8314, 0.8314, 0.8784],[0.8627, 0.8627, 0.8706, …, 0.8118, 0.8118, 0.8471],[0.8667, 0.8588, 0.8667, …, 0.7922, 0.8000, 0.8431],…[0.7451, 0.7333, 0.7333, …, 0.7216, 0.7059],[0.7216, 0.7176, 0.7098, …, 0.7020, 0.7020, 0.6941],[0.7373, 0.7294, 0.7294, …, 0.7020, 0.6902, 0.6824]]]), 0)Trong quá trình xây dựng pipeline dữ liệu, việc tự định nghĩa (customize) dataset là bước quan trọng và thường được triển khai dưới dạng một lớp riêng từ torch.utils.data.Dataset với ba phương thức cơ bản sau:

- init: Hàm khởi tạo, nhận các tham số đầu vào như đường dẫn dữ liệu, danh sách file, các phép biến đổi và lưu lại để dùng về sau.

- len: Trả về số lượng phần tử trong dataset giúp DataLoader biết được tổng số mẫu dữ liệu.

- getitem: Nhận vào một chỉ số index, đọc và xử lý dữ liệu cùng nhãn tương ứng, sau đó trả về mẫu đã được chuẩn hóa sẵn sàng để đưa vào model.

Dataloader

Khi muốn đưa dữ liệu vào mô hình theo từng lô (batch), bạn có thể sử dụng lớp torch.utils.data.DataLoader với một số tham số thường dùng như sau:

- dataset: Nhận vào đối tượng Dataset đã được khởi tạo trước đó và quy định nguồn dữ liệu mà DataLoader sẽ đọc.

- batch_size: Xác định số mẫu dữ liệu trong mỗi batch được lấy ra ở một lần lặp.

- num_workers: Chỉ định số tiến trình chạy song song để tải và xử lý dữ liệu, giúp tận dụng tốt hơn phần cứng.

- collate_fn: Định nghĩa cách gom, sắp xếp và kết hợp các mẫu cùng nhãn trong một batch thành dạng phù hợp để đưa vào mô hình.

trans = A.Compose([A.RandomCrop(width=256, height=256),A.HorizontalFlip(p=0.5),A.RandomBrightnessContrast(p=0.2),ToTensorV2(),])train_dataset = myDataset(data_dict=data_dict,trans=trans)train_dataloader = DataLoader(train_dataset,batch_size = 64, shuffle=True, num_workers=10)Cách Traning mô hình

num_epochs = 10for epoch in range(num_epochs):#Thiết lập trạng thái huấn luyện cho mô hìnhmodel.train()for x_batch,y_batch in train_dataloader:#xóa gradientsoptimizer.zero_grad()# Cho dữ liệu qua model và trả về output cần tìmpred = model(x_batch)# Tính toán giá trị lỗi và backpropagationloss = loss_criterion(pred, y_batch)loss.backward()# Cập nhật trọng sốoptimizer.step()#Thiết lập trạng thái đánh giá cho mô hình, ở bước này thì mô hình không backward và cập nhật trọng sốmodel.eval()for x_batch,y_batch in valid_dataloader:pred = model(x_batch)val_loss = loss_criterion(pred, y_batch)Khi huấn luyện mô hình với PyTorch, bạn thường lặp qua nhiều epoch và mỗi epoch sẽ gồm hai giai đoạn chính là huấn luyện trên tập train và đánh giá trên tập validation. Dưới đây là các bước cơ bản trong quy trình đó:

- Thiết lập chế độ huấn luyện: Đặt mô hình về trạng thái train bằng model.train() để bật các cơ chế như dropout hay batch normalization trong quá trình học.

- Xử lý dữ liệu theo batch: Chia dữ liệu thành từng lô (batch) và lần lượt đưa từng batch vào mô hình để tối ưu hiệu quả tính toán.

- Forward qua mô hình: Với mỗi batch, truyền dữ liệu vào mô hình model(x_batch) để nhận đầu ra (output) tương ứng.

- Tính toán hàm mất mát: Dùng loss function so sánh output với nhãn thực tế, mục tiêu là làm giảm dần giá trị hao phí này qua các bước học.

- Lan truyền ngược: Gọi loss.backward() để tính toán gradient cho các tham số mô hình, phục vụ cho việc cập nhật trọng số.

- Cập nhật trọng số: Sử dụng optimizer.step() để điều chỉnh các tham số mô hình dựa trên gradient vừa tính.

- Chuyển sang giai đoạn đánh giá: Sau khi hoàn thành huấn luyện trên tập train, sử dụng tập validation để kiểm tra chất lượng mô hình.

- Thiết lập chế độ đánh giá: Đặt mô hình sang trạng thái eval bằng model.eval() để tắt các cơ chế chỉ dùng khi train như dropout.

- Đánh giá trên tập validation: Chạy từng batch dữ liệu kiểm định chỉ với forward pass, tính loss nhưng không backpropagation và không cập nhật trọng số.

Nếu có GPU, bạn có thể chuyển mô hình và dữ liệu sang GPU bằng các lệnh model.cuda(), x_batch.cuda() và y_batch.cuda() để tăng tốc quá trình huấn luyện so với chạy trên CPU.

Hàm Loss và hàm tối ưu trong PyTorch

Trong PyTorch, bạn có thể lựa chọn nhiều hàm loss khác nhau cho các bài toán như hồi quy hoặc phân loại, tiêu biểu là nn.MSELoss(), nn.CrossEntropyLoss(), nn.KLDivLoss(), nn.BCELoss hay nn.NLLLoss(). Ngoài ra, các hàm loss này cũng có thể được kết hợp linh hoạt với nhau để xây dựng hàm Loss phù hợp hơn với từng bài toán cụ thể:

def calc_loss(pred, target, metrics, bce_weight=0.5):bce = F.binary_cross_entropy( pred, target)dice = dice_loss(pred, target)loss = bce * bce_weight + dice * (1 – bce_weight)metrics[‘bce’] += bce.data.cpu().numpy() * target.size(0)metrics[‘dice’] += dice.data.cpu().numpy() * target.size(0)metrics[‘loss’] += loss.data.cpu().numpy() * target.size(0)return lossTương tự như hàm loss, PyTorch cung cấp nhiều thuật toán tối ưu như torch.optim.Adadelta, torch.optim.Adagrad hay torch.optim.RMSprop để cập nhật trọng số mô hình. Trong thực tế, torch.optim.Adam là một trong những bộ hàm tối ưu được sử dụng phổ biến nhất khi huấn luyện mạng nơ-ron.

So sánh giữa PyTorch và TensorFlow

Để dễ so sánh sự khác nhau giữa PyTorch và TensorFlow, bạn có thể tham khảo bảng dưới đây:

| Tiêu chí | PyTorch | TensorFlow |

|---|---|---|

| Đồ thị tính toán | Đồ thị động (define-by-run) được xây dựng trong lúc chạy, linh hoạt và dễ debug. | Đồ thị tĩnh (define-and-run) là nền tảng ban đầu. |

| API | Giao diện Pythonic, cú pháp gần với Python cơ bản, dễ tiếp cận cho người mới. | Cung cấp Keras làm API cấp cao nhưng các API cấp thấp có thể phức tạp hơn. |

| Triển khai | Hỗ trợ TorchScript, TorchServe và ONNX, phù hợp nghiên cứu và sản xuất. | Hệ sinh thái triển khai phát triển với các công cụ TensorFlow Serving, TensorFlow Lite, TensorFlow.js, hỗ trợ nhiều nền tảng từ server đến mobile và web. |

| Ứng dụng | Được ưa chuộng trong nghiên cứu, thử nghiệm nhanh, phát triển mô hình linh hoạt. | Phổ biến trong các sản phẩm lớn và hệ thống doanh nghiệp, phù hợp bài toán cần mở rộng và triển khai quy mô lớn. |

| Cộng đồng | Cộng đồng mạnh về học thuật và nghiên cứu. | Cộng đồng rộng trong lĩnh vực sản xuất. |

Quan điểm của mình: Mặc dù TensorFlow đã bổ sung Eager Execution để hỗ trợ đồ thị động, PyTorch vẫn duy trì lợi thế về cú pháp tối ưu cho ngôn ngữ Python, giúp việc lập trình trở nên trực quan hơn. Qua thực tế triển khai tại Vietnix, mình nhận thấy PyTorch là lựa chọn hiệu quả cho các giai đoạn nghiên cứu và phát triển cần tốc độ thử nghiệm nhanh. Trong khi đó, TensorFlow vẫn thể hiện ưu thế vượt trội trong việc tối ưu hóa hiệu suất trên các thiết bị đầu cuối và hệ thống sản xuất quy mô lớn.

Ưu nhược điểm của PyTorch

PyTorch sở hữu nhiều ưu điểm nhưng cũng tồn tại một số hạn chế cần cân nhắc khi lựa chọn cho dự án thực tế. Dưới đây là các điểm nổi bật và hạn chế:

Kiểm soát luồng tính toán linh hoạt: Đồ thị tính toán động giúp bạn dễ dàng xử lý các loại dữ liệu biến đổi theo thời gian như trong NLP hoặc RNN.

Thân thiện và dễ gỡ lỗi: Cú pháp gần với Python thuần, dễ sử dụng và dễ debug bằng các công cụ quen thuộc như pdb, print() hay breakpoint().

Tích hợp tốt với hệ sinh thái Python: Hỗ trợ thao tác tensor tương tự NumPy và hoạt động tốt với nhiều thư viện khoa học dữ liệu khác.

Hỗ trợ GPU linh hoạt: Cho phép chuyển đổi đơn giản giữa CPU và GPU bằng các phương thức như .to(device) để tăng tốc tính toán.

Cộng đồng và tài nguyên phong phú: Sở hữu lượng lớn tutorial, mô hình pretrained và hỗ trợ tích cực qua diễn đàn, GitHub.

Hệ sinh thái mở rộng: Có nhiều thư viện bổ trợ như TorchVision, TorchText, TorchAudio, PyTorch Lightning hay Hugging Face Transformers phục vụ đa dạng bài toán.

Hiệu suất chưa tối ưu trong mọi kịch bản: Ở một số ứng dụng sản xuất, đặc biệt trên mobile hoặc hệ thống nhúng, hiệu năng có thể kém hơn TensorFlow.

Ít tối ưu hóa tự động đồ thị: Do sử dụng đồ thị động nên để tối ưu hiệu suất khi triển khai thường cần thêm bước chuyển đổi như dùng TorchScript.

Triển khai trên mobile/embedded còn phức tạp: Dù đã có TorchMobile nhưng trải nghiệm vẫn chưa trực quan như khi dùng TensorFlow Lite.

Tài liệu về triển khai sản phẩm còn hạn chế: Tài liệu chính thức tập trung nhiều vào nghiên cứu và thử nghiệm hơn là hướng dẫn triển khai ở quy mô lớn.

Cần chú ý quản lý bộ nhớ GPU: Nếu không kiểm soát tốt kích thước batch hoặc cache, mô hình dễ gặp lỗi “CUDA out of memory”.

Quan điểm của mình: Nhược điểm lớn nhất về quản lý bộ nhớ GPU thực chất có thể khắc phục thông qua việc kiểm soát tốt vòng đời của tensor và sử dụng torch.cuda.empty_cache(). Tuy nhiên, PyTorch vẫn là lựa chọn ưu tiên nhờ khả năng chuyển đổi linh hoạt giữa nghiên cứu và sản xuất qua TorchScript. Đối với các dự án đòi hỏi sự cân bằng giữa tốc độ phát triển và hiệu suất vận hành, đây là công cụ mang lại giá trị thực tế cao nhất.

Các ứng dụng của PyTorch

Thị giác máy tính

PyTorch được sử dụng để xây dựng các mô hình phân loại ảnh với các kiến trúc CNN như ResNet, VGG hay EfficientNet nhằm nhận diện nội dung trong ảnh. Ngoài ra, PyTorch còn hỗ trợ tốt các mô hình phát hiện đối tượng như Faster R-CNN hoặc YOLO để xác định vị trí và loại đối tượng trong ảnh.

Trong các bài toán phân đoạn ảnh, chẳng hạn trong y tế hoặc xe tự lái, PyTorch thường được dùng với những kiến trúc như UNet hay DeepLabV3 để dự đoán nhãn cho từng điểm ảnh. Bên cạnh đó, framework này cũng là nền tảng cho nhiều mô hình sinh ảnh như GANs và Diffusion Models nhằm phục vụ việc tạo ra hình ảnh mới, chân thực cho các ứng dụng nghệ thuật và quảng cáo.

NLP

Trong lĩnh vực xử lý ngôn ngữ tự nhiên, PyTorch là nền tảng cho nhiều mô hình hiện đại như BERT, GPT hay LLaMA để phân tích cảm xúc, dịch máy và tóm tắt văn bản,… Bên cạnh đó, PyTorch cũng được sử dụng rộng rãi trong các hệ thống chuyển giọng nói thành văn bản (ASR) và tổng hợp giọng nói (TTS) với những mô hình như Wav2Vec2, Tacotron hay FastSpeech, hỗ trợ nhiều ứng dụng thực tế như trợ lý ảo, tổng đài chăm sóc khách hàng tự động và công cụ đọc văn bản bằng giọng nói.

Robotics và học tăng cường

PyTorch cũng được sử dụng nhiều trong các bài toán học tăng cường, tác nhân học cách tương tác với môi trường để tối đa hóa phần thưởng thông qua các thư viện như Stable-Baselines3 hoặc RLlib. Các ứng dụng thực tế bao gồm robot điều hướng, cánh tay máy tự động và những hệ thống điều khiển thông minh trong môi trường công nghiệp.

Vietnix – Đơn vị cung cấp nền tảng VPS hiệu năng cao cho các dự án PyTorch

Để vận hành các mô hình Deep Learning trên PyTorch, hạ tầng máy chủ cần đáp ứng được khả năng tính toán lớn và tốc độ truy xuất dữ liệu liên tục. Vietnix tự hào là đơn vị cung cấp giải pháp. VPS chuyên dụng, tạo môi trường lý tưởng để triển khai các ứng dụng trí tuệ nhân tạo từ giai đoạn huấn luyện đến vận hành thực tế.

Những ưu điểm nổi bật khi sử dụng VPS Vietnix cho PyTorch:

- Tốc độ xử lý vượt trội: Sử dụng 100% ổ cứng NVMe chuyên dụng cùng dòng CPU thế hệ mới, giúp tăng tốc quá trình xử lý Tensor và giảm thiểu độ trễ khi thực thi mô hình.

- Toàn quyền cấu hình: Bạn có quyền quản trị cao nhất để thiết lập môi trường Python, cài đặt thư viện CUDA và các phiên bản PyTorch phù hợp theo yêu cầu riêng của dự án.

- Băng thông tốc độ cao: Đảm bảo việc truyền tải dữ liệu và kết nối API giữa mô hình AI với người dùng cuối luôn diễn ra mượt mà, không bị nghẽn mạch.

- Hỗ trợ kỹ thuật 24/7: Đội ngũ chuyên gia am hiểu hạ tầng luôn sẵn sàng hỗ trợ, đảm bảo hệ thống vận hành ổn định với cam kết uptime lên đến 99,9%.

Với nền tảng VPS mạnh mẽ, Vietnix đồng hành cùng doanh nghiệp tối ưu hóa nguồn lực, giúp đưa các sản phẩm AI vào thực tế một cách nhanh chóng và hiệu quả nhất.

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

ChatGPT có được xây trực tiếp trên PyTorch?

Không, ChatGPT được xây dựng trên GPT architecture của OpenAI và sử dụng framework nội bộ dựa trên PyTorch, không phải TensorFlow. OpenAI đã chuyển hoàn toàn sang PyTorch từ GPT-3 trở đi cho training và inference.

PyTorch có hoàn toàn miễn phí không?

Có, PyTorch hoàn toàn miễn phí dưới BSD License (open source), cho phép sử dụng cá nhân/doanh nghiệp mà không tốn phí license hay subscription. Bạn chỉ trả tiền cho cloud GPU hoặc dịch vụ liên quan nếu cần scale lớn.

PyTorch GitHub là gì?

PyTorch license là gì?

PyTorch license là BSD 3-Clause License, cho phép sử dụng miễn phí trong dự án thương mại, sửa đổi và phân phối mà chỉ cần giữ nguyên thông báo bản quyền gốc.

PyTorch là C++ hay Python?

PyTorch kết hợp cả hai. Giao diện người dùng chính của nó được viết bằng Python, giúp việc xây dựng mô hình trở nên trực quan và dễ dàng. Tuy nhiên, phần lõi xử lý hiệu năng cao (tính toán tensor, tối ưu hóa) được viết bằng C++ và CUDA để đảm bảo tốc độ và hiệu quả, đặc biệt khi chạy trên GPU.

PyTorch và TensorFlow khác nhau như thế nào?

Có. OpenAI, công ty tạo ra ChatGPT, đã chuẩn hóa việc sử dụng PyTorch làm framework chính để nghiên cứu và phát triển các mô hình ngôn ngữ lớn của họ, bao gồm cả các mô hình GPT nền tảng cho ChatGPT.

PyTorch cung cấp nền tảng vững chắc từ tensor, autograd cho đến module, dataset, dataloader và các công cụ huấn luyện để bạn có thể phát triển từ những mô hình đơn giản đến các hệ thống AI phức tạp. Chính vì vậy, PyTorch rất phù hợp để mở rộng, tối ưu hiệu năng và tích hợp vào hạ tầng sản phẩm khi đưa mô hình vào ứng dụng thực tế.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày