Hướng dẫn các bước kết nối Kimi K -2.5 với OpenClaw chi tiết nhất

Đã kiểm duyệt nội dung

Đánh giá

Việc kết nối Kimi K-2.5 với Openclaw mở ra khả năng xử lý dữ liệu vượt trội nhờ sự kết hợp giữa trí tuệ nhân tạo mạnh mẽ và hệ thống quét dữ liệu tự động. Những hướng dẫn này được mình biên soạn từ thực tiễn triển khai cho hàng nghìn khách hàng tại Vietnix, giúp bạn tránh khỏi những sai sót kỹ thuật đáng tiếc. Hãy bắt đầu thực hiện theo các bước chi tiết dưới đây để tối ưu hóa công việc của bạn ngay hôm nay.

Những điểm chính

- Quan điểm của mình: Trong năm 2026, việc tự lưu trữ các AI Agent như Openclaw kết hợp với API tương thích từ Kimi K-2.5 là giải pháp tối ưu nhất để cân bằng giữa sức mạnh AI, tính bảo mật dữ liệu và chi phí vận hành.

- Lợi ích khi kết hợp Kimi K-2.5 và OpenClaw: Là giải pháp tối ưu giúp cân bằng giữa sức mạnh AI đa phương thức, tính bảo mật dữ liệu và chi phí vận hành trong năm 2026.

- Các phương thức sử dụng miễn phí: Gồm việc tận dụng hạn mức API từ Moonshot Moonshot hoặc triển khai suy luận cục bộ hoàn toàn thông qua tệp trọng số GGUF từ Hugging Face.

- Cấu hình môi trường vận hành: Yêu cầu thiết lập WSL2 trên Windows để tạo môi trường Linux chuyên dụng, giúp tăng tốc hiệu năng và hạn chế lỗi xung đột thư viện.

- Quy trình thiết lập hệ thống: Thực hiện qua các bước cài đặt framework, xác thực khóa API bằng công cụ kiểm tra độc lập và cập nhật tệp cấu hình JSON để kích hoạt AI agent.

- Khắc phục sự cố và tối ưu: Bao gồm xử lý lỗi xác thực, kiểm tra nhật ký vận hành và điều chỉnh nhiệt độ sáng tạo của AI phù hợp với từng mục đích công việc cụ thể.

- Giải pháp hạ tầng từ Vietnix: Cung cấp dịch vụ VPS chuyên dụng với ổ cứng NVMe và hạ tầng mạng tốc độ cao, đảm bảo trợ lý AI cá nhân hoạt động xuyên suốt 24/7.

- Giải đáp thắc mắc thường gặp khi sử dụng Kimi K -2.5 miễn phí với Openclaw.

Lợi ích khi kết nối Kimi K -2.5 với OpenClaw

Sự kết hợp giữa hai nền tảng này mang đến khả năng truy cập AI chất lượng cao với chi phí tối ưu nhờ những yếu tố sau:

- Khả năng xử lý đa phương thức gốc: Kimi K-2.5 có thể xử lý tốt văn bản, hình ảnh, ảnh chụp màn hình giao diện và cả các khung video ngắn. Cửa sổ ngữ cảnh khổng lồ 256K token cho phép mô hình đọc hiểu toàn bộ kho mã nguồn hoặc tài liệu dài chỉ trong một lần gửi.

- Quản lý tác vụ thông minh: Kimi K-2.5 có khả năng tạo ra các tác tử phụ để thực hiện nhiệm vụ con song song. Trong các bài kiểm tra thực tế, mô hình này cho thấy năng lực tương đương Claude 3.5 Sonnet hoặc GPT-4o trong việc lập trình và suy luận, nhưng chi phí trên mỗi token lại thấp hơn đáng kể.

- Biến AI thành trợ lý hành động: OpenClaw đóng vai trò là “cánh tay” của LLM, giúp hệ thống quản lý trạng thái hội thoại, định tuyến tin nhắn và tự động gọi các công cụ cần thiết dựa trên bộ nhớ liên tục.

- Tối ưu chi phí: Người dùng có thể sử dụng hoàn toàn miễn phí thông qua gói API của Moonshot (hỗ trợ khoảng 1,5 triệu token/ngày) hoặc chạy mô hình suy luận hoàn toàn cục bộ bằng các file trọng số GGUF từ cộng đồng Hugging Face.

Nếu bạn muốn vận hành hệ thống trợ lý AI cá nhân 24/7 mà không muốn treo máy tính liên tục, dịch vụ VPS OpenClaw tại Vietnix chính là giải pháp lý tưởng. Đây là máy chủ ảo chuyên dụng được cấu hình sẵn để tối ưu hóa vận hành OpenClaw, trang bị ổ cứng NVMe Enterprise cho tốc độ đọc/ghi dữ liệu nhanh gấp 10 lần SSD. Với CPU AMD EPYC xử lý đa nhiệm mượt mà và hạ tầng Tier III tại Việt Nam, hệ thống đảm bảo trợ lý AI của bạn hoạt động xuyên suốt, phản hồi tức thì và bảo mật tuyệt đối.

CHO AI AGENT

- Uptime 99.9% – Kết nối ổn định

- CPU AMD EPYC , RAM 4GB+

- Data Safe: Tự động sao lưu định kỳ

Các phương án sử dụng Kimi K-2.5 miễn phí

Hiện tại có 2 cách để tận dụng Kimi K-2.5 tích hợp với OpenClaw:

- Sử dụng API miễn phí: Dùng gói miễn phí của Moonshot API (hỗ trợ khoảng 1,5 triệu token/ngày tùy khu vực).

- Suy luận nội bộ: Sử dụng các trọng số GGUF được lượng tử hóa bởi cộng đồng chia sẻ trên Hugging Face.

Bảng so sánh phương thức API và Local

| Đặc điểm | Suy luận qua API (Moonshot API) | Suy luận cục bộ (Local GGUF) |

|---|---|---|

| Yêu cầu phần cứng | Rất thấp (Máy tính cơ bản) | Rất cao (Cần GPU mạnh, nhiều RAM) |

| Độ trễ | Phụ thuộc vào tốc độ Internet | Phụ thuộc vào phần cứng máy tính |

| Tính bảo mật | Dữ liệu được gửi qua máy chủ API | An toàn 100% (Dữ liệu không rời khỏi máy) |

| Chi phí | Miễn phí (Giới hạn 1,5 triệu token/ngày) | Miễn phí hoàn toàn (Không giới hạn) |

Lựa chọn của chuyên gia: Dựa trên các bài test hiệu năng thực tế tại Vietnix, nếu bạn đang xây dựng một chatbot hỗ trợ cộng đồng thông thường (như bot Telegram, Discord giải trí, tra cứu thông tin), mình khuyên bạn nên dùng phương án Moonshot API để tận dụng tối đa cửa sổ ngữ cảnh 256K và tốc độ phản hồi nhanh chóng. Ngược lại, nếu bạn sử dụng OpenClaw để phân tích dữ liệu nội bộ, code bảo mật của doanh nghiệp, hãy đầu tư máy chủ cấu hình cao và chọn Suy luận GGUF cục bộ để loại bỏ hoàn toàn rủi ro rò rỉ dữ liệu.

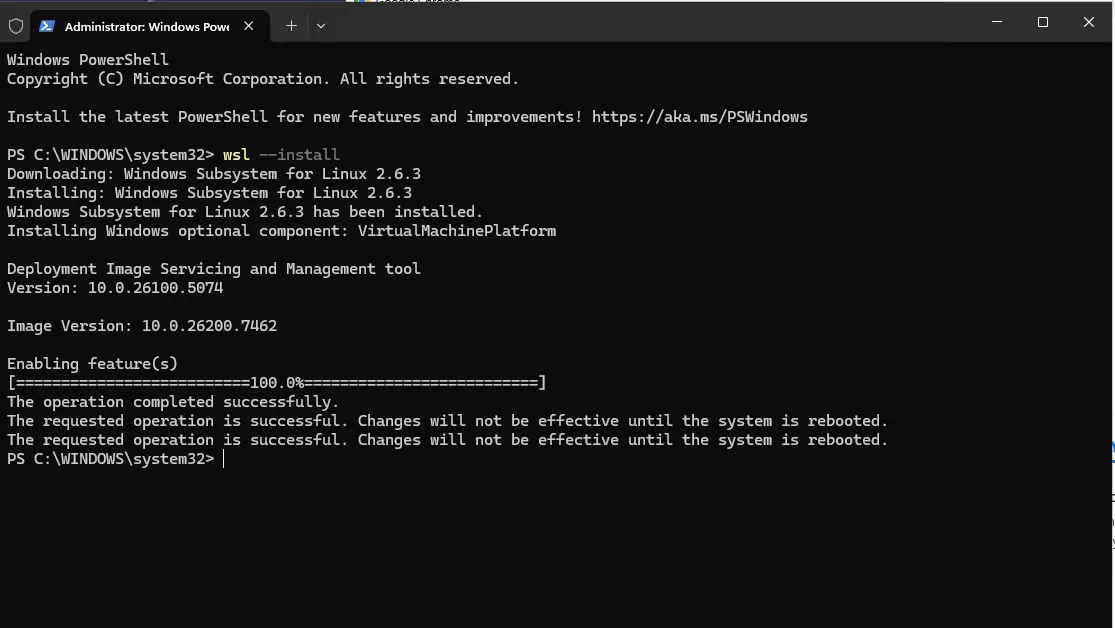

Hướng dẫn thiết lập môi trường WSL2 trên Windows cho OpenClaw

OpenClaw hoạt động ổn định nhất trong môi trường hệ điều hành Linux. Do đó, đối với người dùng Windows, giải pháp bắt buộc trong năm 2026 là thiết lập WSL2 (Windows Subsystem for Linux 2). Môi trường này cung cấp một nhân Linux đầy đủ, hỗ trợ tăng tốc GPU qua NVIDIA CUDA và cho phép chia sẻ tệp liền mạch với Windows.

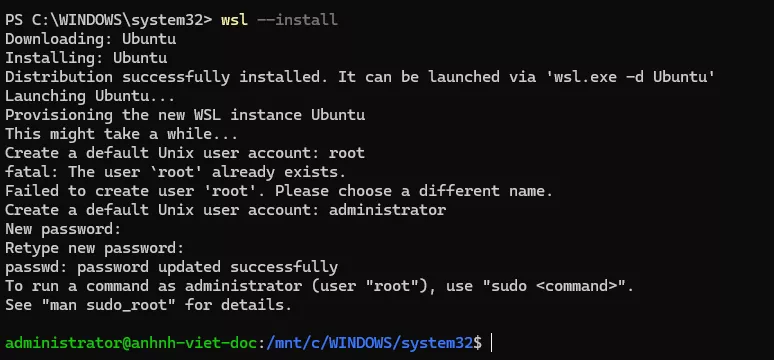

Cài đặt WSL2 và Ubuntu trên Windows

Bạn mở ứng dụng PowerShell hoặc Windows Terminal với quyền Quản trị viên (Run as Administrator) và chạy lệnh cài đặt duy nhất sau đây:

wsl --installLệnh này sẽ tự động bật các tính năng cần thiết, tải kernel WSL mới nhất và cài đặt bản phân phối Ubuntu mặc định.

Lựa chọn của chuyên gia: Mặc dù nền tảng WSL hỗ trợ nhiều bản phân phối khác nhau, nhưng mình khuyên bạn nên giữ nguyên bản Ubuntu mặc định. Đây là hệ điều hành có độ tương thích hoàn hảo nhất với các script cài đặt của OpenClaw và thư viện Node.js, giúp hạn chế lỗi thư viện so với việc dùng Debian hay Alpine.

Bạn khởi động lại máy tính khi hệ thống yêu cầu. Sau khi khởi động lại, cửa sổ terminal của Ubuntu sẽ tự động mở. Bạn hãy chờ vài phút để quá trình thiết lập hoàn tất, sau đó tạo Tên người dùng (Username) và Mật khẩu (Password) cho hệ điều hành Linux của mình.

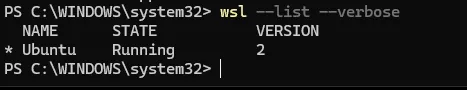

Để kiểm tra WSL2 đã hoạt động chuẩn chưa, bạn mở lại PowerShell và chạy lệnh:

wsl --list --verboseNếu kết quả hiển thị trạng thái Running và phiên bản 2, bạn đã cài đặt thành công.

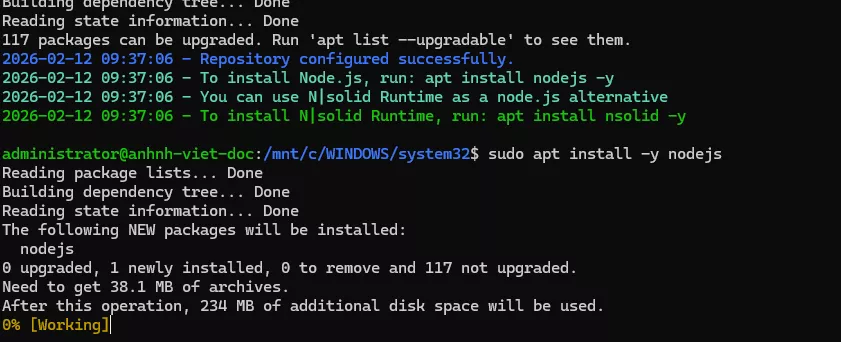

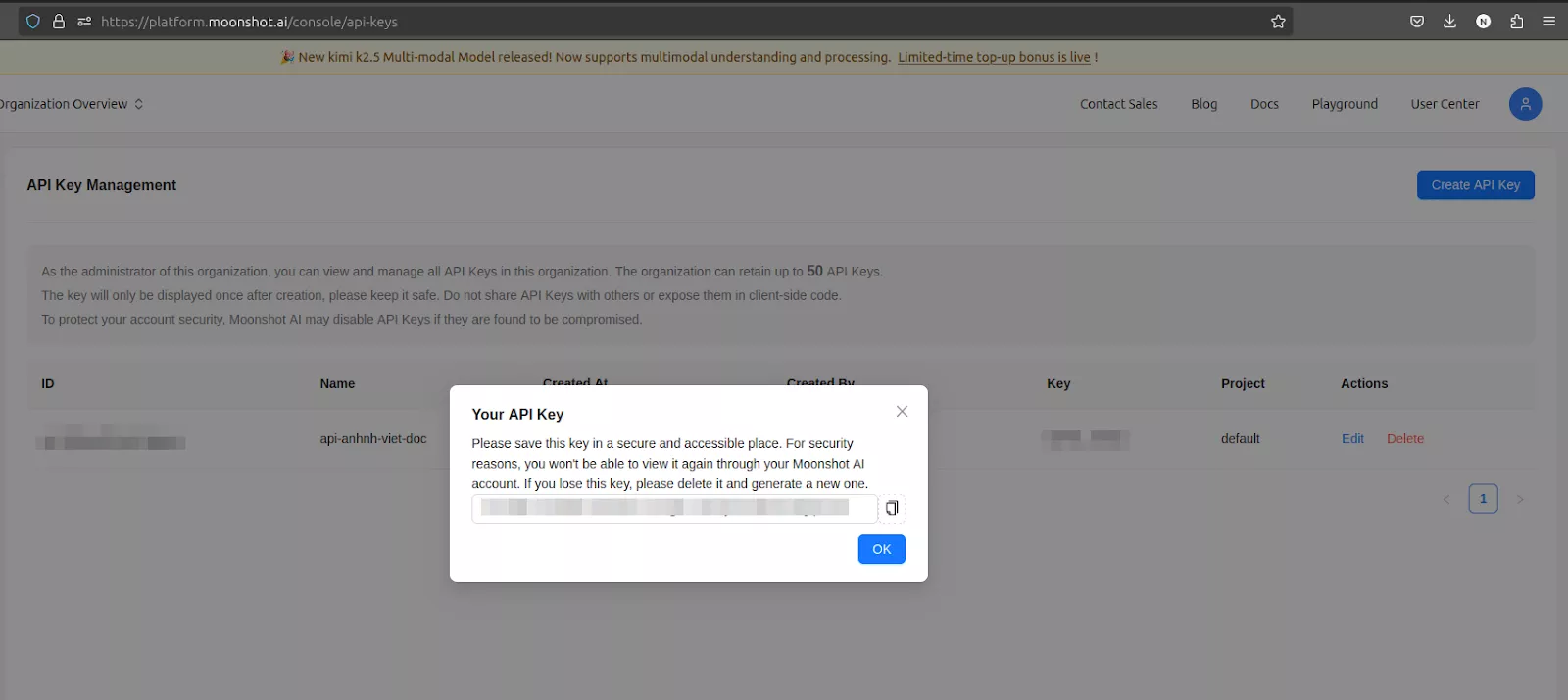

Cài đặt Node.js và pnpm trên Ubuntu

OpenClaw yêu cầu phiên bản Node.js từ 24 trở lên. Bạn mở terminal Ubuntu và thực hiện tuần tự các lệnh sau.

Tải và cài đặt Node.js:

curl -fsSL https://deb.nodesource.com/setup_24.x | sudo -E bash -

sudo apt install -y nodejs

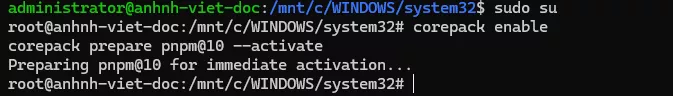

Bật Corepack và thiết lập pnpm phiên bản 10:

corepack enable

corepack prepare pnpm@10 --activate

Mẹo từ chuyên gia: Ở bước cài Node.js này, mình khuyên bạn tuyệt đối không dùng phiên bản Node.js v22 vì bản này đang gây xung đột với các gói phụ thuộc mới nhất của OpenClaw trong năm 2026. Hãy tuân thủ việc dùng bản v24 để đảm bảo tính ổn định lâu dài.

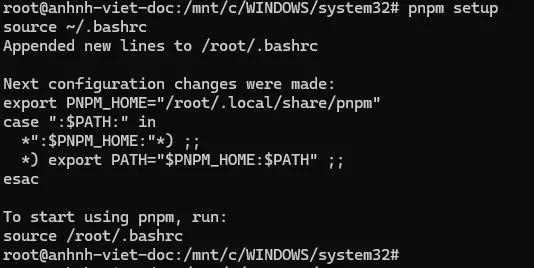

Thiết lập đường dẫn và xác minh:

pnpm setup

source ~/.bashrc

Cuối cùng bạn kiểm tra lại phiên bản để đảm bảo cài đặt thành công:

node -v # Kết quả phải hiển thị >= 24

pnpm -v # Kết quả phải hiển thị 10.x

echo $PATH # Kết quả phải bao gồm ~/.local/share/pnpm

Các bước kết nối Kimi K -2.5 với Openclaw

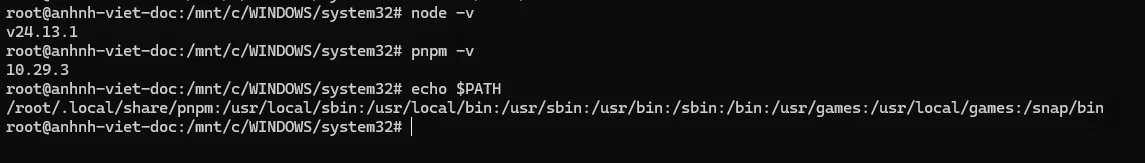

Bước 1: Cài đặt OpenClaw

Để cài đặt OpenClaw, bạn không nên sử dụng các gói npm cũ. Thay vào đó, bạn hãy sử dụng trình cài đặt chính thức thông qua lệnh sau trong terminal Ubuntu:

curl -fsSL https://openclaw.ai/install.sh | bashSau khi cài đặt xong, bạn tải lại shell để cập nhật các biến môi trường:

source ~/.bashrcSau khi quá trình hoàn tất, bạn có thể kiểm tra xem công cụ đã được nhận diện hay chưa bằng lệnh:

command -v openclaw

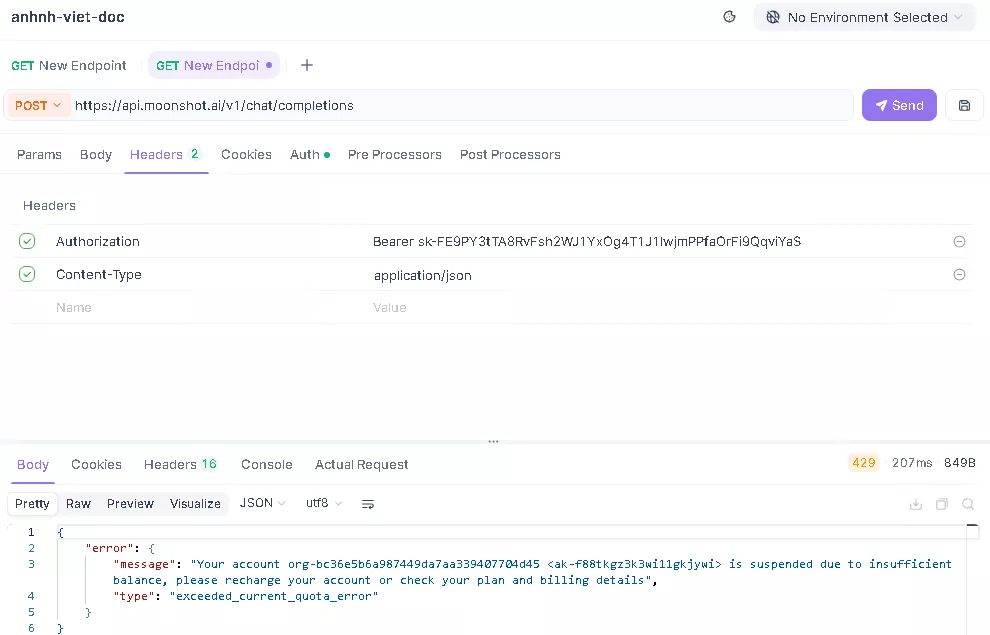

Bước 2: Kiểm tra Endpoint Kimi K-2.5 bằng Apidog

Để tránh mất thời gian gỡ lỗi sau này, bạn nên xác thực quyền truy cập API của Kimi K-2.5 trước khi cấu hình vào OpenClaw. Bạn có thể sử dụng công cụ Apidog trên Windows để kiểm tra bằng cách mở Apidog và tạo một yêu cầu POST mới đến URL: https://api.moonshot.ai/v1/chat/completions.

Trong phần Headers, bạn cấu hình:

- Authorization: Bearer sk-your-moonshot-key (Thay bằng API key của bạn).

- Content-Type: application/json.

Trong phần Body, bạn dán đoạn mã JSON sau:

{

"model": "kimi-k2.5",

"messages":[

{

"role": "user",

"content": "Confirm you are Kimi K-2.5 and describe three key capabilities."

}

],

"temperature": 0.7,

"max_tokens": 256

}Sau đó bạn nhấn Send. Nếu hệ thống trả về mã 200 OK kèm nội dung phản hồi từ AI, khóa API của bạn đã hoạt động hoàn hảo.

Mẹo từ chuyên gia: Bạn bắt buộc phải thực hiện bước test API độc lập này. Thực tế hỗ trợ cho thấy 90% lỗi “OpenClaw không phản hồi” trên Telegram/Discord xuất phát từ việc cấu hình sai API Key hoặc tài khoản Moonshot đã hết hạn mức token miễn phí, chứ không phải do lỗi của hệ thống OpenClaw.

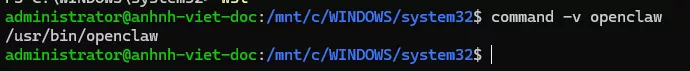

Bước 3: Tích hợp cấu hình vào OpenClaw

Bạn tạo một tài khoản tại trang chủ của Moonshot API (platform.moonshot.ai) và tạo một khóa API mới (sk-…).

Sau đó bạn sử dụng trình soạn thảo văn bản để chỉnh sửa file cấu hình ~/.openclaw/openclaw.json bên trong Ubuntu với nội dung như sau (thay sk-your-moonshot-key bằng khóa API của bạn):

{

"agent": {

"model": { "primary": "moonshot/kimi-k2.5" }

},

"models": {

"providers": {

"moonshot": {

"baseUrl": "https://api.moonshot.ai/v1",

"apiKey": "sk-your-moonshot-key",

"api": "openai-completions",

"models":[

{

"id": "kimi-k2.5",

"name": "Kimi K-2.5 API 256K",

"contextWindow": 262144,

"maxTokens": 8192

}

]

}

}

}

}Bạn lưu file và khởi động lại dịch vụ bằng lệnh sau để áp dụng cấu hình:

openclaw restartBước 4: Triển khai Kimi K-2.5 cục bộ (tùy chọn)

Nếu máy tính của bạn có GPU mạnh và bạn muốn sử dụng mô hình hoàn toàn miễn phí, không giới hạn thì có thể chạy mô hình trực tiếp trên máy Local bằng llama.cpp.

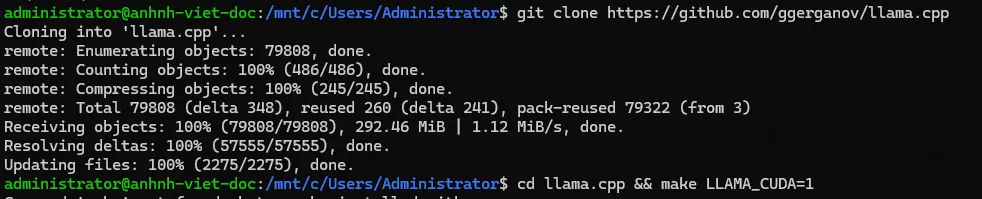

Đầu tiên bạn cài đặt các công cụ cần thiết và clone mã nguồn llama.cpp:

sudo apt install build-essential cmake git

git clone https://github.com/ggerganov/llama.cpp

cd llama.cpp && make LLAMA_CUDA=1

Để cài đặt và tải trọng số mô hình Kimi K-2.5 GGUF từ Hugging Face:

pip install -U huggingface_hub # Cài đặt huggingface-hub

huggingface-cli download unsloth/Kimi-K2.5-GGUF --local-dir ./kimi-ggufBạn khởi động máy chủ ảo tương thích với OpenAI API:

./llama-server -m ./kimi-gguf/kimi-k2.5-UD-IQ2_XXS.gguf --port 8080 --ctx-size 32768 --n-gpu-layers 99 --host 0.0.0.0 --flash-attnCuối cùng, bạn cập nhật lại file openclaw.json để trỏ baseUrl về http://127.0.0.1:8080/v1:

{

"agent": { "model": { "primary": "local-kimi/kimi-k2.5" } },

"models": {

"providers": {

"local-kimi": {

"baseUrl": "http://127.0.0.1:8080/v1",

"apiKey": "sk-no-key-required",

"api": "openai-completions",

"models": [

{ "id": "kimi-k2.5-local", "name": "Kimi K-2.5 Local GGUF", "contextWindow": 32768, "maxTokens": 4096 }

]

}

}

}

}Khởi động lại OpenClaw bằng lệnh openclaw restart.

Khắc phục sự cố và tối ưu hóa hiệu suất

Trong quá trình vận hành nền tảng, bạn có thể gặp một số lỗi thông thường. Dưới đây là phương pháp giúp bạn xử lý ngay lập tức:

- Lỗi 401 Unauthorized: Thông báo này xuất hiện khi API Key sai hoặc hết hạn. Bạn cần xác thực lại khóa trong Apidog và cập nhật lại file JSON.

- Sự cố tràn ngữ cảnh: Bạn cần lập trình tính năng tự động tóm tắt lại lịch sử hội thoại khi đoạn chat quá dài để giải phóng dung lượng cho bộ nhớ Token.

- Bot không phản hồi trong nhóm chat: Kiểm tra nhật ký lỗi bằng cách gõ lệnh

openclaw logsđể tìm nguyên nhân từ nhà cung cấp API, sau đó khởi động lại dịch vụ. - Tối ưu nhiệt độ AI: Để tối ưu chất lượng câu trả lời của Kimi K-2.5 trong OpenClaw, bạn nên chủ động điều chỉnh thông số temperature xuống mức 0.6 – 0.8 trong cấu hình. Điều này giúp AI hạn chế sáng tạo lan man, từ đó đưa ra các câu trả lời mang tính logic, ngắn gọn và có độ chính xác cao.

Thuê VPS tốc độ cao – máy chủ ảo giá rẻ tại Vietnix

Khi tích hợp AI vào quy trình làm việc chuyên nghiệp, việc sử dụng máy tính cá nhân sẽ gặp nhiều rủi ro về độ ổn định mạng và điện. Dịch vụ thuê VPS của Vietnix là giải pháp hoàn hảo để triển khai các dự án mạnh mẽ. Với 100% ổ cứng NVMe/SSD Enterprise, CPU AMD EPYC/Intel Xeon cùng hạ tầng mạng lên tới 400 Mbps, VPS Vietnix đảm bảo tốc độ phản hồi vượt trội. Đặc biệt, khách hàng còn được cấp toàn quyền quản trị, hỗ trợ kỹ thuật 24/7 và hệ thống backup dữ liệu định kỳ 1 lần/tuần.

Câu hỏi thường gặp

Tôi có cần máy tính cấu hình cao để chạy Openclaw không?

Không. Bản thân framework Openclaw rất nhẹ và tiêu tốn ít RAM. Nếu bạn sử dụng Kimi K-2.5 qua API, máy tính văn phòng thông thường hoặc một VPS cấu hình cơ bản là đã đủ để vận hành.

Dữ liệu của tôi có bị rò rỉ khi sử dụng API tương thích không?

Khi dùng API miễn phí của Moonshot, các truy vấn của bạn sẽ được gửi đến máy chủ của họ. Mặc dù Openclaw bảo vệ cấu trúc hệ thống của bạn, nhưng nếu xử lý dữ liệu nhạy cảm của doanh nghiệp, bạn nên cân nhắc phương án tải file GGUF về chạy hoàn toàn cục bộ.

Tôi có thể sử dụng OpenClaw trên thiết bị macOS (Macbook) không?

Có, OpenClaw hoạt động rất mượt mà trên môi trường macOS. Do macOS bản chất là hệ điều hành nền UNIX, bạn không cần cài đặt WSL2. Bạn chỉ cần cài đặt Node.js và Git thông qua công cụ Homebrew là có thể chạy OpenClaw trực tiếp qua terminal.

Gói API miễn phí của Moonshot có an toàn tuyệt đối cho dữ liệu doanh nghiệp không?

Khi sử dụng API (dù trả phí hay miễn phí), dữ liệu prompt của bạn vẫn được gửi đến máy chủ của nhà cung cấp mô hình Nếu bạn đang xử lý mã nguồn đóng hoặc dữ liệu y tế, tài chính nhạy cảm, bạn bắt buộc phải tải file GGUF và chạy suy luận cục bộ hoàn toàn trên máy chủ của chính bạn để đảm bảo dữ liệu không bị rò rỉ ra bên ngoài.

Tôi có thể sử dụng Kimi K-2.5 để tự động lấy dữ liệu từ website không?

Được. OpenClaw cung cấp các quyền điều khiển trình duyệt. Bạn có thể ra lệnh cho Kimi K-2.5 tự động mở trang web, tìm kiếm thông tin và xuất dữ liệu về định dạng file văn bản theo yêu cầu.

Sự kết hợp giữa OpenClaw và nền tảng Kimi K-2.5 đang mang lại cơ hội trải nghiệm hệ thống trợ lý AI tự động hóa vô cùng mạnh mẽ mà không cần phải bỏ ra chi phí hàng tháng. Bằng cách thiết lập đúng môi trường WSL2 trên Windows theo bài viết trên, bạn hoàn toàn có thể triển khai quy trình làm việc an toàn, chủ động và theo kịp xu hướng công nghệ mới nhất.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày