Decision Tree là gì? Các thuật toán và ứng dụng Decision Tree phổ biến

Đã kiểm duyệt nội dung

Đánh giá

Decision Tree là mô hình học máy có giám sát dùng cho cả bài toán phân loại và hồi quy, biểu diễn quá trình ra quyết định dưới dạng cây. Từ trải nghiệm áp dụng Decision Tree trong các bài toán thực tế, mình thấy điểm mạnh nhất của mô hình này là dễ đọc, dễ giải thích nhưng cũng rất dễ overfitting nếu không kiểm soát độ sâu và số nhánh. Trong bài viết này, mình sẽ giúp bạn nắm vững mô hình này để áp dụng vào thực tế.

Những điểm chính

- Quan điểm của mình: Nắm vững Decision Tree là bước đệm bắt buộc trước khi bạn muốn tiến lên các mô hình Ensemble mạnh mẽ hơn như Random Forest hay XGBoost.

- Khái niệm Decision Tree: Hiểu rõ đây là mô hình học máy dạng cây dùng cho phân loại và hồi quy, giúp biểu diễn quy tắc ra quyết định dưới dạng chuỗi logic if-then dễ giải thích.

- Thành phần chính: Nắm vững cấu trúc gồm nút gốc, nút quyết định, nhánh và nút lá, giúp hình dung cách dữ liệu được phân luồng và gán nhãn dự đoán cuối cùng.

- Nguyên lý hoạt động: Biết quy trình chia để trị dựa trên việc chọn thuộc tính tách tối ưu, giúp hiểu cách mô hình xây dựng cây từ dữ liệu thô đến khi đạt độ thuần nhất.

- Các thuật toán phổ biến: Phân biệt được đặc điểm của ID3, C4.5, CART, CHAID và MARS, giúp lựa chọn thuật toán phù hợp với kiểu dữ liệu và yêu cầu bài toán cụ thể.

- Tiêu chí đánh giá: Hiểu vai trò của Entropy, Information Gain và Gini Index trong việc đo lường độ tốt của phép tách, giúp tối ưu hóa quá trình huấn luyện mô hình.

- Kiểm soát Overfitting: Nắm được các kỹ thuật Pruning (cắt tỉa) và đặt ngưỡng dừng sớm, giúp tăng khả năng tổng quát hóa và độ ổn định của mô hình trên dữ liệu mới.

- Ứng dụng thực tế: Nhận diện các trường hợp sử dụng tiêu biểu như chấm điểm tín dụng, phát hiện gian lận và phân loại khách hàng, giúp áp dụng hiệu quả vào kinh doanh.

- Giới thiệu Vietnix: Vietnix cung cấp hạ tầng VPS NVMe hiệu năng cao, giúp tăng tốc độ huấn luyện mô hình và vận hành hệ thống dự đoán thời gian thực.

- Câu hỏi thường gặp: Được giải đáp các thắc mắc liên quan đến Decision Tree.

Decision Tree là gì?

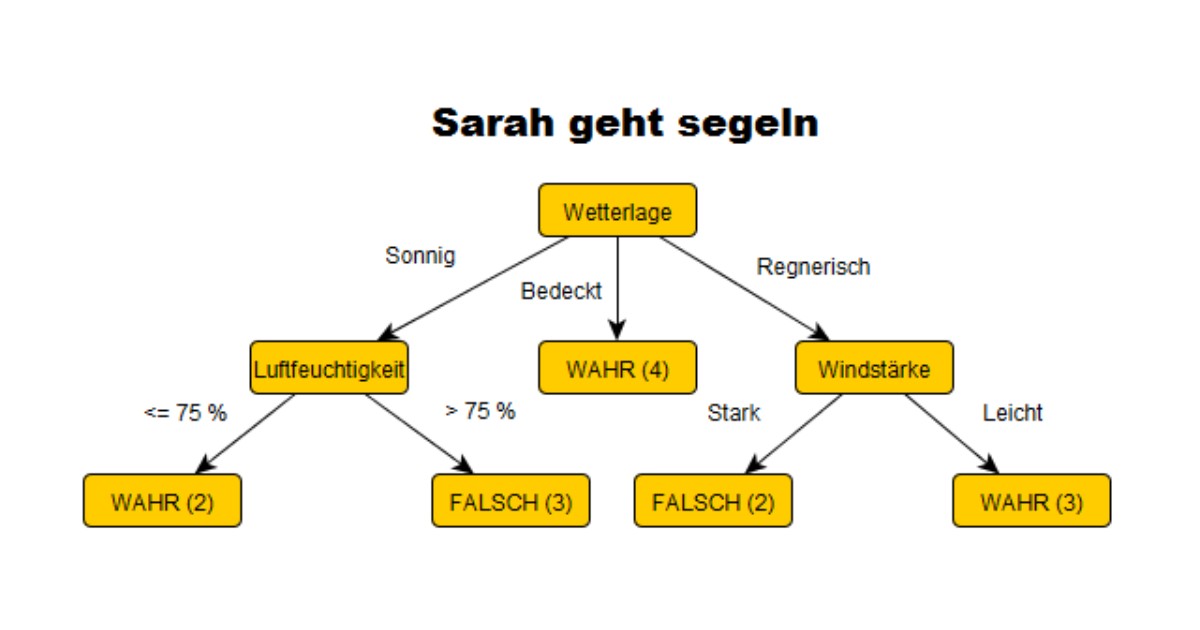

Decision Tree (cây quyết định) là một mô hình học máy có giám sát dùng cho cả bài toán phân loại và hồi quy, trong đó quá trình ra quyết định được tổ chức dưới dạng cấu trúc cây gồm các nút và nhánh. Thuật toán này mô phỏng chân thực quá trình tư duy của con người dưới dạng một sơ đồ phân cấp.

Tại mỗi bước xử lý, thuật toán Decision Tree sẽ đặt ra một câu hỏi về một thuộc tính cụ thể của dữ liệu, sau đó hệ thống tiến hành phân chia dữ liệu thành các nhóm nhỏ hơn dựa trên kết quả trả lời. Quá trình phân tách này lặp đi lặp lại liên tục cho đến khi mô hình xác định được kết luận cuối cùng. Nhờ sở hữu tính trực quan cao, mô hình Decision Tree giúp các chuyên gia dễ dàng giải thích các quyết định phân tích dữ liệu phức tạp mà không đòi hỏi người nghe phải có kiến thức sâu về toán học.

Để huấn luyện các mô hình Decision Tree trên tập dữ liệu lớn một cách nhanh chóng, hạ tầng phần cứng đóng vai trò quyết định. VPS NVMe Vietnix là giải pháp tối ưu với ổ cứng NVMe có tốc độ đọc ghi vượt trội và CPU mạnh mẽ, giúp rút ngắn thời gian xử lý dữ liệu và tuning mô hình. Với sự hỗ trợ từ hạ tầng hiện đại, các kỹ sư dữ liệu có thể thực hiện nhiều lần thử nghiệm mà không lo ngại về độ trễ hệ thống, từ đó nâng cao độ chính xác cho mô hình Machine Learning.

Website nhanh hơn – Bán được nhiều hàng hơn

- Chiếm lĩnh TOP Google, hút traffic.

- Mua sắm mượt mà, tăng tỷ lệ chốt đơn.

- Chuyên gia kỹ thuật đồng hành 24/7.

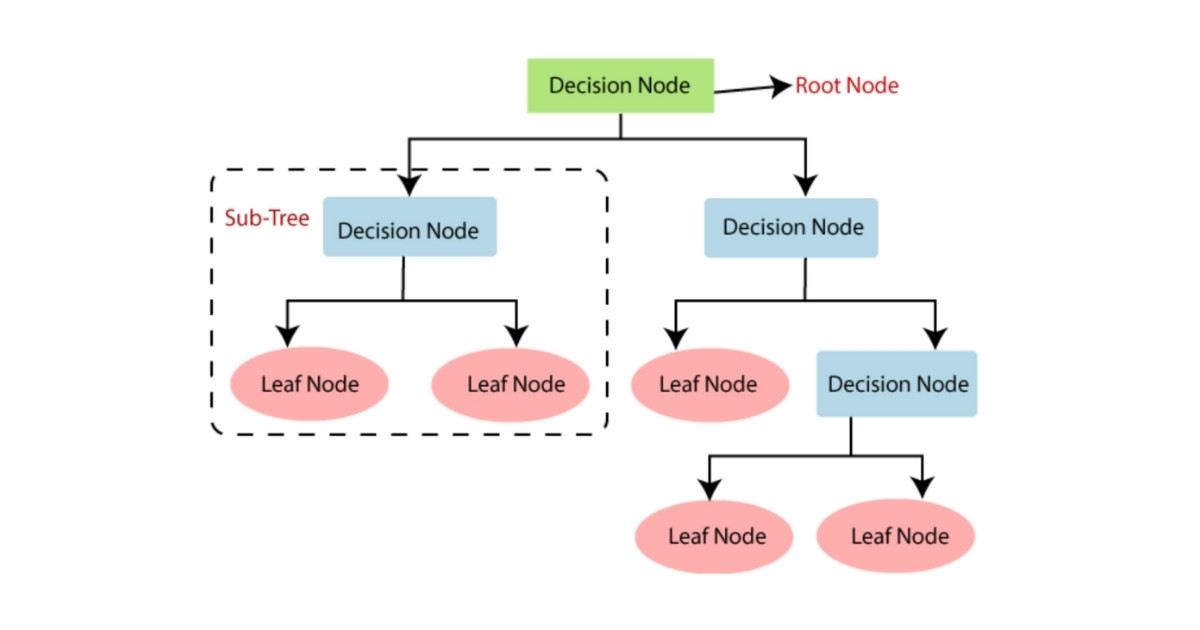

Thành phần chính của Decision Tree

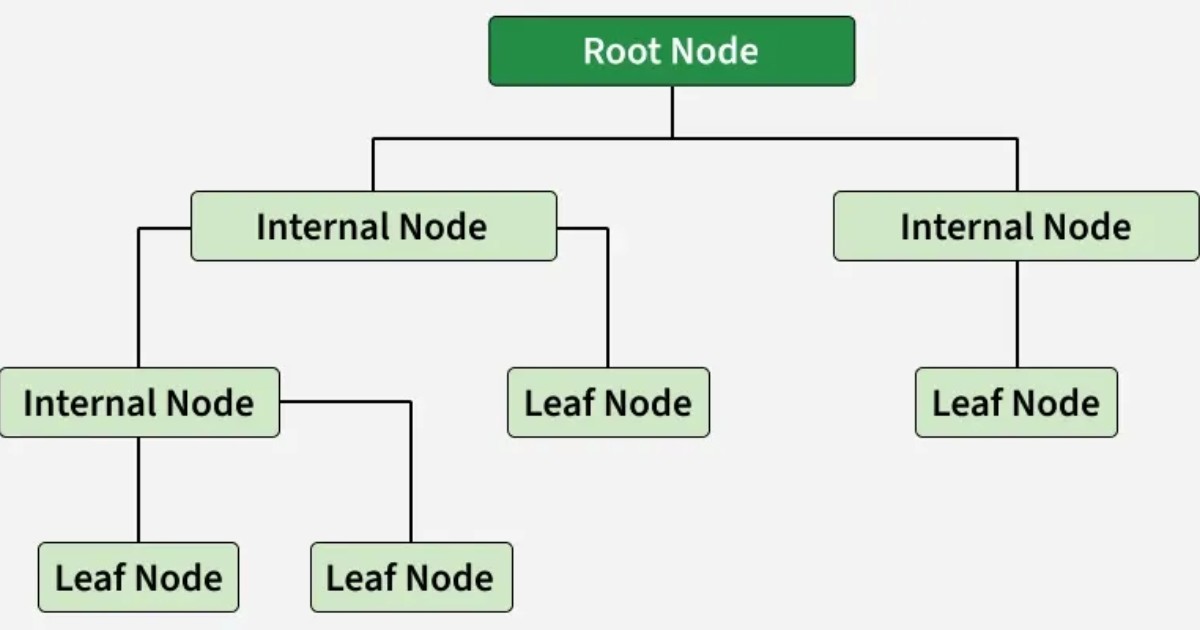

Trong một Decision Tree, mỗi dự đoán được hình thành bằng cách đi qua các nút và nhánh từ gốc tới lá. Dưới đây là các thành phần chính trong một cây quyết định:

- Node gốc (Root node): Đây là điểm khởi đầu của cây, đại diện cho toàn bộ tập dữ liệu huấn luyện. Tại đây, thuộc tính quan trọng nhất sẽ được chọn để thực hiện phép chia đầu tiên.

- Các nhánh (Branches): Là các đường nối liên kết giữa các nút, thể hiện kết quả của phép kiểm tra tại nút cha (ví dụ: True/False, <= ngưỡng hoặc > ngưỡng) và dẫn dữ liệu sang nút con tương ứng.

- Node nội bộ / Node quyết định (Internal / Decision nodes): Là các nút trung gian, tại đó mô hình áp dụng một điều kiện trên thuộc tính dữ liệu để tiếp tục chia nhỏ tập mẫu, mỗi node luôn có ít nhất một node con ở phía dưới.

- Node lá (Leaf nodes): Là các nút cuối cùng trên mỗi nhánh, không còn phép tách tiếp theo, lưu trữ nhãn lớp trong bài toán phân loại hoặc giá trị dự báo trong bài toán hồi quy và chính là kết quả mô hình trả về cho một mẫu dữ liệu khi đi đến nút này.

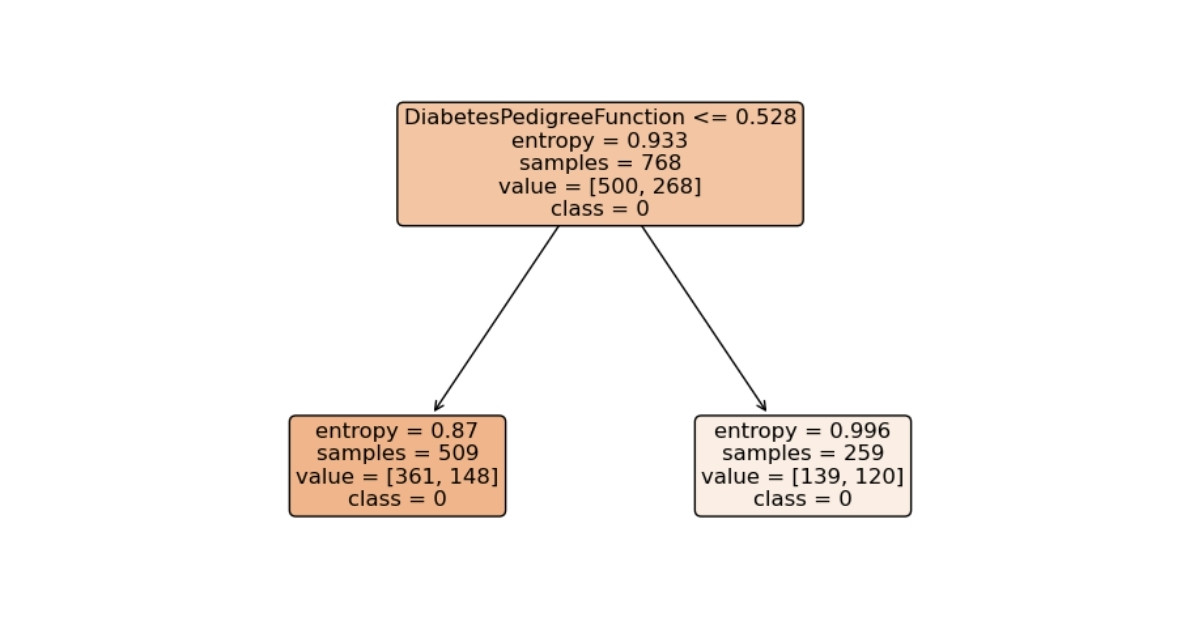

Nguyên lý hoạt động của Decision Tree

Decision Tree hoạt động dựa trên nguyên tắc chia để trị, thuật toán liên tục tách tập dữ liệu thành các nhóm nhỏ hơn cho đến khi các nhóm đủ thuần nhất để dự đoán ổn định. Dưới đây là quy trình cơ bản:

- Chọn thuộc tính và ngưỡng tách tối ưu: Ở mỗi node, thuật toán duyệt qua các thuộc tính và ngưỡng nếu thuộc tính liên tục, sau đó tính các tiêu chí như Information Gain, Gain Ratio hoặc Gini impurity để tìm phép tách giúp các node con thuần hơn về nhãn so với node cha.

- Chia dữ liệu thành các node con: Sau khi chọn được thuộc tính và ngưỡng tách, tập dữ liệu tại node đó được chia thành các phần tương ứng với từng kết quả của phép tách, mỗi phần trở thành một nhánh con trong cây và giữ lại các mẫu rơi vào nhánh đó để xử lý tiếp.

- Lặp lại việc tách trên từng node con: Với mỗi node con, thuật toán lặp lại quy trình chọn thuộc tính, tìm ngưỡng, tính độ tốt của phép tách và tiếp tục chia nhỏ cho đến khi đạt điều kiện dừng như node chỉ chứa một lớp, không còn thuộc tính phù hợp, số mẫu quá ít hoặc cây đạt độ sâu tối đa.

- Gán nhãn cho node lá: Khi không tách tiếp, node trở thành node lá và được gán nhãn dự đoán, với bài toán phân loại, nhãn thường là lớp xuất hiện nhiều nhất trong node và với bài toán hồi quy, giá trị thường là trung bình hoặc trung vị của các giá trị mục tiêu trong node đó.

- Cắt tỉa (Pruning) để giảm overfitting: Sau khi cây được xây, có thể áp dụng pre-pruning bằng cách giới hạn độ sâu, số mẫu tối thiểu hoặc post-pruning bằng cách xây cây đầy đủ rồi lược bỏ các nhánh ít đóng góp để giảm phức tạp và cải thiện khả năng tổng quát hóa trên dữ liệu mới.

Mẹo từ chuyên gia: Ở bước cấu hình 5, thay vì để cây phát triển tự do theo mặc định của thư viện (ví dụ như Scikit-learn) thì bạn bắt buộc phải thiết lập tham số max_depth (độ sâu tối đa) hoặc min_samples_leaf (số mẫu tối thiểu ở node lá). Nếu bỏ qua bước này, cây sẽ học thuộc lòng tập dữ liệu huấn luyện và dự đoán cực kỳ kém khi gặp dữ liệu thực tế ngoài môi trường.

Các loại Decision Tree phổ biến

Các loại Decision Tree phổ biến thường được chia theo dạng đầu ra của bài toán, gồm hai nhóm chính là cây phân loại và cây hồi quy.

- Cây phân loại (Classification Tree): Dùng cho bài toán dự đoán nhãn rời rạc như “spam/không spam”, “churn/không churn” hoặc phân loại nhóm khách hàng. Mỗi node lá lưu một lớp và các phép tách trong cây được chọn để tăng độ thuần lớp thông qua giảm entropy hoặc Gini, giúp mô hình gán khách hàng vào nhóm thích hợp dựa trên đặc trưng như độ tuổi, thu nhập và hành vi.

- Cây hồi quy (Regression Tree): Dùng cho bài toán dự đoán giá trị liên tục như giá nhà, doanh thu dự kiến hoặc nhiệt độ. Thay vì tối ưu độ thuần lớp, cây hồi quy chọn phép tách để giảm sai số dự đoán, thường sử dụng MSE và node lá lưu một giá trị số đại diện như giá thuê trung bình cho các căn hộ có diện tích, vị trí và số phòng ngủ thuộc cùng một vùng trong không gian đặc trưng.

Ưu nhược điểm của Decision Tree

Dễ hiểu và dễ giải thích: Cấu trúc cây phân tách theo từng điều kiện giúp mô hình dễ đọc, dễ trình bày cho đội kỹ thuật và đội kinh doanh.

Dễ trực quan hóa: Cấu trúc phân nhánh cho phép vẽ sơ đồ Decision Tree để phân tích luồng quyết định và điểm chia quan trọng trong dữ liệu.

Linh hoạt về bài toán: Hỗ trợ cả phân loại và hồi quy, phù hợp cho nhiều use case như phân nhóm khách hàng và dự báo doanh thu.

Xử lý được quan hệ phi tuyến tính: Các phép tách theo ngưỡng tại nhiều tầng giúp Decision Tree mô hình hóa quan hệ đặc trưng phức tạp mà không cần biến đổi đặc trưng thủ công.

Không cần feature scaling: Mô hình không đòi hỏi kỹ sư phải chuẩn hóa dữ liệu phức tạp và thuật toán có thể xử lý tốt cả dữ liệu số lẫn dữ liệu phân loại.

Xử lý dữ liệu thiếu: Có thể dùng chiến lược như gán nhánh phổ biến hoặc surrogate split (thuộc tính thay thế có hành vi phân tách tương tự) để giảm mất mát dữ liệu huấn luyện.

Bỏ qua các tính năng dư thừa: Thuật toán tự động chọn lọc các thuộc tính quan trọng, giúp hệ thống tự động loại bỏ các biến số không mang lại giá trị phân loại.

Overfitting: Cây sâu và nhiều nhánh dễ học cả nhiễu trong dữ liệu, làm giảm khả năng tổng quát trên dữ liệu mới.

Không ổn định (Instability): Thay đổi nhỏ trong tập huấn luyện có thể dẫn đến cây có cấu trúc hoàn toàn khác, gây khó khăn khi tái lập và giám sát mô hình qua nhiều phiên bản.

Thiên vị đặc trưng có nhiều nhóm: Đặc trưng có nhiều giá trị phân loại dễ được chọn làm điểm tách, gây thiên lệch và góp phần tạo thêm overfitting.

Khó nắm bắt tương tác phức tạp: Cây đơn lẻ thường không nắm được các tương tác giữa nhiều đặc trưng, hiệu quả thấp hơn so với các mô hình ensemble hoặc mô hình phi tuyến nâng cao trong các bài toán dữ liệu phức tạp.

Chi phí tính toán cao trên dữ liệu lớn: Huấn luyện và cắt tỉa cây trên tập dữ liệu lớn với nhiều đặc trưng tốn CPU và RAM, đặc biệt khi cần thử nhiều cấu hình độ sâu, số mẫu tối thiểu ở node lá.

Các thuật toán Decision Tree phổ biến

Các thuật toán Decision Tree phổ biến thường khác nhau ở tiêu chí chọn thuộc tính tách, cách xử lý dữ liệu liên tục và chiến lược cắt tỉa. Khi xây dựng pipeline, bạn chọn thuật toán dựa trên kiểu dữ liệu, kích thước tập dữ liệu và yêu cầu giải thích mô hình.

ID3 (Iterative Dichotomiser 3)

ID3 được dùng để xây dựng cây quyết định cho bài toán phân loại dựa trên hai khái niệm chính là Information Gain và Entropy. Ở mỗi node, thuật toán tính Entropy trước và sau khi tách dữ liệu theo từng thuộc tính, sau đó chọn thuộc tính mang lại Information Gain cao nhất để tách và tạo ra các nhánh tương ứng với từng giá trị của thuộc tính. Cách chọn như vậy giúp cây phân loại dần dần tạo ra các node con có phân phối nhãn thuần hơn, phù hợp cho các bài toán dùng thuộc tính phân loại và dữ liệu đã được rời rạc hóa.

Đặc điểm kỹ thuật:

- Phù hợp với thuộc tính phân loại.

- Thuộc tính liên tục thường cần rời rạc hóa trước khi huấn luyện.

- Thường sinh cây lớn và cần cắt tỉa để giảm overfitting.

C4.5

C4.5 được phát triển để kế thừa ID3 và khắc phục các hạn chế về thiên lệch thuộc tính có nhiều giá trị, xử lý dữ liệu liên tục và dữ liệu thiếu. Thuật toán sử dụng Gain Ratio, là phiên bản chuẩn hóa của Information Gain theo thông tin phân chia, nhằm giảm xu hướng ưu tiên thuộc tính có nhiều giá trị khác nhau nhưng không thực sự mang lại nhiều thông tin.

C4.5 cũng hỗ trợ tìm ngưỡng tách tối ưu cho thuộc tính liên tục và xử lý giá trị thiếu trong quá trình xây dựng cây, nhờ vậy mô hình phù hợp hơn với dữ liệu thực tế nhiều nhiễu và nhiều kiểu thuộc tính.

Đặc điểm kỹ thuật:

- Tự động xử lý thuộc tính liên tục bằng ngưỡng tách.

- Có cơ chế xử lý giá trị thiếu.

- Hỗ trợ cắt tỉa cây dựa trên tiêu chí thống kê để giảm overfitting.

CART (Classification And Regression Tree)

CART được thiết kế để xây dựng cây nhị phân cho cả bài toán phân loại và bài toán hồi quy, giúp sử dụng một khung thuật toán thống nhất cho nhiều trường hợp khác nhau. Đối với phân loại, CART dùng Gini Index để đánh giá mức độ thuần của nhãn tại mỗi node và chọn thuộc tính cùng ngưỡng tách giúp giảm Gini nhiều nhất, từ đó tạo ra hai nhánh con theo dạng tách nhị phân.

Đối với hồi quy, CART chọn phép tách dựa trên việc giảm sai số như MSE hoặc RSS, và mỗi node lá sẽ lưu một giá trị dự đoán là trung bình mục tiêu của các mẫu thuộc về node đó. Nhờ vậy mô hình có thể áp dụng cho cả dữ liệu nhãn rời rạc lẫn nhãn liên tục.

Đặc điểm kỹ thuật:

- Mọi node tách nhị phân, cấu trúc cây nhất quán và dễ triển khai.

- Hỗ trợ dữ liệu số và phân loại.

- Phù hợp để làm nền tảng cho các mô hình ensemble như Random Forest, Gradient Boosting.

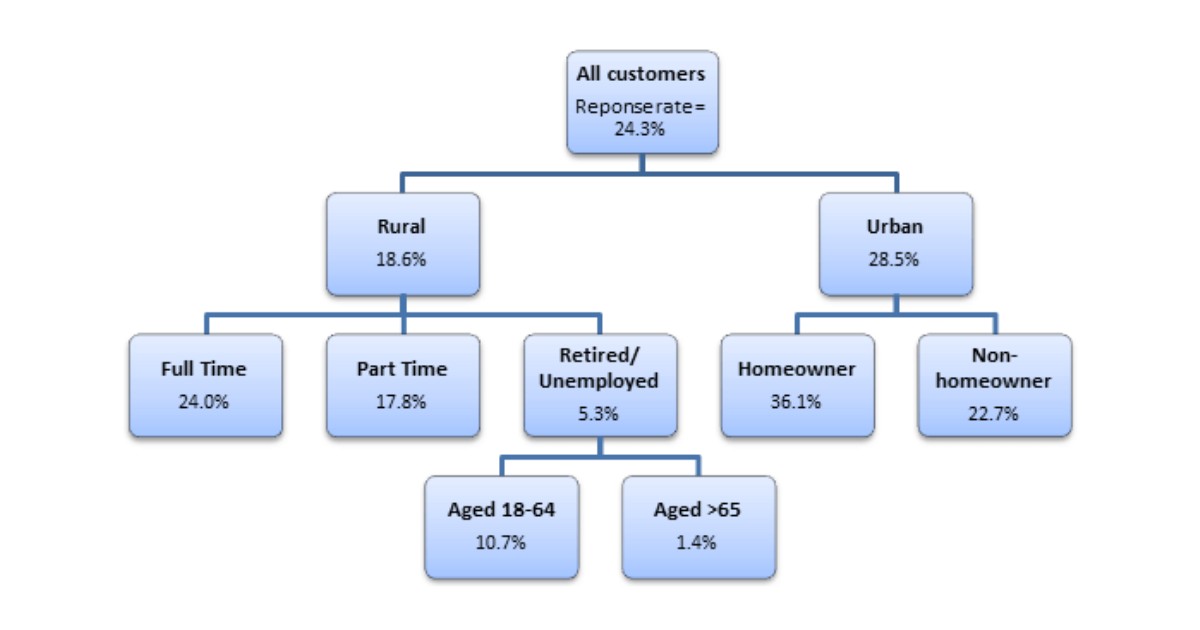

CHAID (Chi-squared Automatic Interaction Detection)

CHAID được sử dụng chủ yếu cho bài toán phân loại với dữ liệu phân loại, tập trung vào việc phát hiện tương tác giữa thuộc tính và nhãn dựa trên kiểm định Chi-bình phương (χ2).

Tại mỗi node, thuật toán dùng kiểm định χ2 để đánh giá mức độ phụ thuộc giữa thuộc tính và biến mục tiêu, sau đó gộp các nhóm không khác biệt có ý nghĩa thống kê và tách các nhóm khác biệt dựa trên ngưỡng p-value đã định. Cách tiếp cận này giúp cây CHAID biểu diễn các phân nhóm có ý nghĩa thống kê rõ ràng, phù hợp cho phân đoạn khách hàng và các báo cáo phân tích trong môi trường kinh doanh.

Đặc điểm kỹ thuật:

- Thường tạo cây multi-way với node có nhiều nhánh.

- Phù hợp cho phân tích marketing và phân đoạn khách hàng.

MARS (Multivariate Adaptive Regression Splines)

MARS được sử dụng cho bài toán hồi quy đa biến, nhằm mô hình hóa quan hệ phi tuyến giữa nhiều biến độc lập và biến mục tiêu mà không cần giả định tuyến tính toàn cục. Thuật toán xây dựng mô hình bằng các splines dạng nhiều đoạn tuyến tính ghép nối tại các knots.

Trong đó giai đoạn đầu thêm dần các hàm cơ sở để giảm sai số và giai đoạn sau thực hiện backward pruning để loại bỏ những thành phần ít đóng góp vào chất lượng dự đoán. Nhờ cấu trúc này, MARS có thể mô tả quan hệ thay đổi theo từng vùng giá trị của biến độc lập và biểu diễn cả tương tác giữa nhiều biến trong cùng một hàm hồi quy.

Đặc điểm kỹ thuật:

- Xử lý tốt quan hệ phi tuyến và tương tác giữa nhiều biến.

- Hữu ích cho bài toán hồi quy trên dữ liệu phức tạp với nhiều chiều.

Lựa chọn của chuyên gia: Mặc dù có rất nhiều thuật toán, nhưng nếu bạn đang xây dựng Pipeline bằng Python (như thư viện Scikit-Learn), mình khuyên bạn nên tập trung tìm hiểu và sử dụng CART. Thuật toán CART mang tính nhất quán cao, cấu trúc nhị phân dễ lập trình và nó chính là nền tảng cốt lõi cho các thuật toán siêu việt như Random Forest hay Gradient Boosting sau này.

Ứng dụng của Decision Tree

Decision Tree được ứng dụng rộng trong các hệ thống ra quyết định dựa trên dữ liệu do mô hình dễ giải thích, dễ triển khai và hỗ trợ cả phân loại lẫn hồi quy. Dưới đây là một số ứng dụng tiêu biểu trong doanh nghiệp và sản phẩm số:

- Tài chính – Ngân hàng: Duyệt hồ sơ vay vốn dựa trên các yếu tố như thu nhập, lịch sử tín dụng, tình trạng công việc, từ đó dự đoán khả năng được phê duyệt hoặc rủi ro vỡ nợ.

- Phát hiện gian lận: Phát hiện gian lận thẻ tín dụng hoặc thanh toán trực tuyến bằng cách phân tích mẫu giao dịch bất thường so với lịch sử chi tiêu của khách hàng và gắn cờ giao dịch nghi ngờ để kiểm tra thêm.

- Y tế: Hỗ trợ chẩn đoán bệnh dựa trên chỉ số lâm sàng như glucose, BMI, huyết áp, giúp phân loại bệnh nhân có nguy cơ tiểu đường hoặc bệnh tim để can thiệp sớm.

- Giáo dục: Dự đoán kết quả thi hoặc nguy cơ học sinh trượt dựa trên dữ liệu chuyên cần, điểm kiểm tra, bài tập, giúp giáo viên nhận diện nhóm học sinh cần hỗ trợ thêm.

- Kinh doanh – Marketing: Dự đoán customer churn (khách hàng rời bỏ dịch vụ) dựa trên lịch sử sử dụng, số lần khiếu nại, mức độ tương tác, từ đó kích hoạt ưu đãi hoặc chiến dịch giữ chân phù hợp.

- Bán lẻ và thương mại điện tử: Phân đoạn khách hàng theo hành vi mua sắm và nhân khẩu học, dùng để xây dựng chiến dịch cá nhân hóa và gợi ý sản phẩm.

- Quản lý chuỗi cung ứng: Cây quyết định hỗ trợ các nhà quản lý đánh giá hiệu quả việc trưng bày sản phẩm tại cửa hàng và lựa chọn chiến lược sắp xếp tối ưu nhất.

Đường biên phân chia của Decision Tree

Đường biên phân chia của Decision Tree được tạo ra từ các ngưỡng tách của từng thuộc tính và có dạng các đoạn thẳng (hoặc siêu phẳng) song song với trục tọa độ, chia không gian đặc trưng thành nhiều vùng dự đoán riêng biệt. Nhờ cấu trúc này, Decision Tree thuộc nhóm white box model vì có thể truy vết rõ ràng lý do đầu vào thuộc về một nhánh và một vùng dự đoán cụ thể.

Đặc điểm đường biên phân chia:

- Đường biên dựa trên ngưỡng phân chia (threshold): Mỗi node trong cây gắn với một điều kiện dạng feature <= threshold, tương ứng với một đường thẳng hoặc siêu phẳng vuông góc với trục của feature đó trong không gian dữ liệu.

- Chia không gian thành các hình chữ nhật/khối trục song song: Trong không gian 2 chiều, các ngưỡng tách liên tiếp tạo thành các hình chữ nhật trục song song, còn trong không gian nhiều chiều sẽ tạo thành các khối hyper-rectangle (siêu hình chữ nhật).

- Mọi điểm trong cùng một vùng có chung dự đoán: Mỗi vùng hình chữ nhật tương ứng với một node lá, mọi điểm nằm trong vùng này nhận cùng một nhãn hoặc cùng một giá trị dự báo, nên đường biên phân chia là tập hợp các cạnh bao quanh các vùng đó.

Các tiêu chí phân chia và thước đo đánh giá

Entropy

Entropy đo mức độ hỗn loạn hoặc không chắc chắn của phân phối nhãn trong một node, node càng lẫn nhiều lớp thì Entropy càng lớn. Một tập dữ liệu chứa các điểm mẫu phân bố cực kỳ đồng đều cho tất cả các lớp sẽ tạo ra chỉ số Entropy cao nhất. Trái lại, một tập dữ liệu hoàn toàn đồng nhất về bản chất sẽ có Entropy bằng 0. Thuật toán luôn cố gắng chia cắt dữ liệu sao cho mức Entropy của các nút lá giảm dần về mốc 0.

Hàm tin thu (Information Gain)

Information Gain là thước đo sự giảm thiểu tính bất định của một tập dữ liệu sau khi hệ thống phân chia dữ liệu bởi một thuộc tính. Mức độ Information Gain càng cao thì chứng tỏ thuộc tính đó có khả năng phân loại dữ liệu càng xuất sắc. Thuật toán Decision Tree sẽ luôn ưu tiên chọn lọc thuộc tính đem lại lượng Information Gain lớn nhất để đặt làm nút quyết định.

Chỉ số Gini (Gini Index)

Gini Index đo xác suất sai nhãn nếu chọn ngẫu nhiên một mẫu trong node và gán nhãn theo phân phối xác suất của node đó, giá trị thấp thể hiện node thuần hơn. Chỉ số Gini sở hữu giá trị dao động từ 0 đến 0.5. Nếu Gini Impurity bằng 0, điều đó có nghĩa là nút đó đã hoàn toàn thuần khiết (mọi điểm dữ liệu lọt vào nhánh đều thuộc cùng một lớp). Thuật toán CART đặc biệt ưa chuộng sử dụng chỉ số này để giảm thiểu độ vẩn đục.

Overfitting và Pruning

Overfitting

Khi tiếp tục phân chia Decision Tree đến độ sâu lớn, số lượng quan sát ở mỗi node lá giảm dần và có thể chỉ còn vài mẫu, dự đoán tại các node này không còn đại diện tốt cho phân phối dữ liệu tổng thể nên hiện tượng overfitting xuất hiện. Để tránh mô hình quá phức tạp và giảm chi phí tính toán, bạn có thể áp dụng các điều kiện dừng sau ngay trong quá trình huấn luyện:

- Giới hạn độ sâu của cây: Đặt max_depth để cây không vượt quá một số tầng nhất định, tránh tạo nhiều nhánh chỉ phục vụ một số rất ít quan sát.

- Ngưỡng số mẫu tối thiểu tại node lá: Đặt min_samples_leaf hoặc quy ước số quan sát tối thiểu cho mỗi node lá, ví dụ yêu cầu ít nhất 30 quan sát cho bài toán phân loại nhị phân để quyết định phân lớp đủ tin cậy.

- Ngưỡng số mẫu để tách: Dùng min_samples_split để đảm bảo chỉ tách node khi có đủ số mẫu, tránh tách trên tập dữ liệu quá nhỏ.

- Node lá thuần nhất: Khi node lá đã chứa toàn bộ mẫu thuộc một lớp, có thể dừng tách vì các phép chia tiếp theo không cải thiện độ thuần.

- Giới hạn số node hoặc số node lá: Dùng tham số như max_leaf_nodes để giới hạn tổng số node lá, từ đó giới hạn kích thước cây và ngăn mô hình trở nên quá phức tạp.

- Ngưỡng giảm Information Gain rất nhỏ: Nếu mức giảm Entropy hoặc Gini sau tách dưới một ngưỡng nhỏ, có thể bỏ qua phép tách vì lợi ích không đáng kể so với chi phí tăng thêm.

Pruning

Khi cây đã được huấn luyện đủ sâu, có thể dùng pruning (cắt tỉa) để loại bỏ các nhánh ít đóng góp vào độ chính xác, từ đó giảm overfitting mà không cần huấn luyện lại từ đầu. Có hai nhóm kỹ thuật chính là post-pruning dựa trên dữ liệu kiểm định và cost-complexity pruning dựa trên hàm mất mát có thêm thành phần phạt độ phức tạp.

Reduced Error Pruning:

- Huấn luyện cây đầy đủ trên tập train để phân loại đúng tối đa, sau đó dùng tập validation để đánh giá.

- Lần lượt loại bỏ các node lá và biến node cha trực tiếp thành node lá, giữ lại các bước cắt tỉa giúp độ chính xác trên validation giữ nguyên hoặc cải thiện.

- Dừng khi không còn thao tác cắt tỉa nào giúp cải thiện hoặc giữ vững hiệu năng trên validation.

Cost-Complexity Pruning (CCP):

- Định nghĩa hàm mất mát gồm hai phần: tổng sai số (hoặc tổng impurity có trọng số của các node lá) cộng thêm α × số lượng node lá, trong đó α là hệ số phạt độ phức tạp.

- Với mỗi giá trị α, thuật toán tạo một cây đã cắt tỉa tương ứng bằng cách loại bỏ các nhánh làm giảm nhiều nhất hàm mất mát, đồng thời giảm dần số node lá.

- Sử dụng cross-validation để chọn α tối ưu, tại đó cây có sự cân bằng tốt giữa độ chính xác và số lượng node.

Kết hợp pre-pruning và post-pruning: Bạn có thể áp dụng pre-pruning nhẹ bằng các tham số như min_samples_leaf để tránh cây quá cực đoan, sau đó dùng post-pruning như CCP để tinh chỉnh cấu trúc cuối cùng.

Lỗi thường gặp: Rất nhiều bạn mới làm Machine Learning thường dùng luôn tập Test để thực hiện cắt tỉa Reduced Error Pruning. Điều này là sai nguyên tắc. Bạn bắt buộc phải chia dữ liệu thành 3 phần (Train, Validation, Test) và chỉ được dùng tập Validation để cắt tỉa, nhằm giữ cho tập Test khách quan nhất trong khâu đánh giá cuối cùng.

Dịch vụ thuê VPS Vietnix – Nền tảng ổn định cho triển khai mô hình AI

Khi mô hình Decision Tree đã được huấn luyện xong, việc triển khai chúng vào môi trường thực tế yêu cầu một nền tảng máy chủ ổn định và linh hoạt. Dịch vụ thuê VPS tại Vietnix cung cấp nhiều gói cấu hình đa dạng, phù hợp cho từ các ứng dụng web tích hợp AI đến các hệ thống phân tích dữ liệu thời gian thực. Với sự hỗ trợ kỹ thuật tận tâm và hiệu năng xử lý mạnh mẽ, bạn hoàn toàn có thể yên tâm vận hành các mô hình học máy của mình một cách mượt mà, đảm bảo khả năng phản hồi nhanh chóng cho người dùng cuối.

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

Decision Tree có cần chuẩn hóa dữ liệu (feature scaling) không?

Không bắt buộc, vì Decision Tree dựa trên so sánh ngưỡng của từng thuộc tính nên không phụ thuộc vào độ lớn tuyệt đối của giá trị như các mô hình tuyến tính hoặc mô hình dùng khoảng cách. Tuy nhiên, chuẩn hóa có thể vẫn hữu ích khi kết hợp Decision Tree với các mô hình khác trong cùng pipeline hoặc khi trực quan hóa dữ liệu đầu vào.

Khi nào không nên dùng Decision Tree?

Decision Tree không phù hợp khi dữ liệu có nhiễu cao, ít mẫu nhưng nhiều đặc trưng hoặc khi cần bề mặt quyết định trơn tru thay vì các vùng phân mảnh dạng bậc thang, vì mô hình dễ overfitting và không khái quát tốt. Trong các bài toán như nhận dạng hình ảnh hoặc xử lý ngôn ngữ tự nhiên với đặc trưng rất cao chiều, các mô hình như CNN, RNN, Transformer hoặc các mô hình tuyến tính regularization mạnh thường hiệu quả hơn.

Decision Tree có phù hợp làm mô hình cho hệ thống thời gian thực không?

Decision Tree thường cho tốc độ suy luận rất nhanh vì mỗi mẫu chỉ cần so sánh một chuỗi ngưỡng từ gốc đến lá, nên phù hợp cho hệ thống thời gian thực nếu cây không quá sâu và hạ tầng được tối ưu. Tuy nhiên, với bài toán có dữ liệu thay đổi liên tục, cần theo dõi hiện tượng drift và tái huấn luyện định kỳ để giữ chất lượng dự đoán ổn định.

Decision Tree là một công cụ mạnh mẽ, trực quan và là điểm khởi đầu hoàn hảo cho bất kỳ ai muốn bước chân vào thế giới Machine Learning. Bằng cách kết hợp giữa việc hiểu sâu thuật toán và sở hữu hạ tầng tính toán mạnh mẽ, bạn có thể biến dữ liệu thành những quyết định kinh doanh đột phá.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày