Feature Engineering là gì? Vai trò của Feature Engineering trong xây dựng mô hình học máy

Đã kiểm duyệt nội dung

Đánh giá

Feature Engineering là quá trình biến đổi và thiết kế lại các đặc trưng từ dữ liệu thô thành các biến đầu vào phù hợp, giúp mô hình học máy học được quy luật tốt hơn và dự đoán chính xác hơn. Bài viết này được mình đúc kết từ kinh nghiệm trực tiếp triển khai và tối ưu pipeline Machine Learning trên dữ liệu thực tế, tập trung vào khái niệm, vai trò, các kỹ thuật thường dùng và những thách thức khi áp dụng Feature Engineering để bạn có thể tránh các sai lầm phổ biến và xây dựng mô hình ổn định hơn.

Những điểm chính

- Quan điểm của mình: Ở đa số dự án Machine Learning thực tế mà mình từng triển khai, chất lượng Feature Engineering thường quyết định hiệu quả mô hình nhiều hơn việc đổi sang một thuật toán phức tạp hơn, nên đầu tư thời gian vào bước này mang lại lợi ích dài hạn rõ rệt cho cả độ chính xác lẫn khả năng vận hành mô hình.

- Khái niệm Feature Engineering: Hiểu rõ Feature Engineering là quá trình biến đổi và thiết kế lại các đặc trưng từ dữ liệu thô, giúp mô hình học máy học tốt hơn và dự đoán chính xác hơn.

- Ý nghĩa và tầm quan trọng: Nắm được ý nghĩa và vai trò then chốt của Feature Engineering trong khoa học dữ liệu, giúp nhận biết đây là một giai đoạn không thể thiếu để xây dựng các mô hình hiệu quả.

- Các đặc trưng: Biết được các loại đặc trưng (thô, phát sinh) và cách chúng được biểu diễn trong học máy, giúp hiểu rõ nền tảng dữ liệu đầu vào cho các thuật toán.

- Các kỹ thuật: Nắm vững các kỹ thuật chính như chuyển đổi, lựa chọn và chuẩn hóa đặc trưng, giúp bạn áp dụng các phương pháp phù hợp để cải thiện chất lượng dữ liệu.

- Thách thức: Nhận biết các thách thức ở các bước trích xuất, gắn nhãn và lưu trữ đặc trưng, giúp chuẩn bị và có kế hoạch đối phó để triển khai Feature Engineering một cách hiệu quả.

- Biết thêm Vietnix: Tìm hiểu về dịch vụ VPS của Vietnix, giúp có thêm lựa chọn hạ tầng cho các dự án học máy.

- Câu hỏi thường gặp: Được giải đáp các thắc mắc về các khái niệm quan trọng như feature vector, lag features và các ví dụ thực tế, giúp củng cố kiến thức và làm rõ các vấn đề kỹ thuật.

Feature Engineering là gì?

Feature Engineering là bước tiền xử lý dữ liệu, là quá trình sử dụng kiến thức chuyên môn để lựa chọn, biến đổi và tạo ra các đặc trưng từ dữ liệu thô. Mục đích chính là làm cho dữ liệu phù hợp hơn để các thuật toán Machine Learning có thể hoạt động hiệu quả và chính xác hơn.

Về bản chất, các mô hình học máy không thể làm việc trực tiếp với dữ liệu thô. Do đó, Feature Engineering đóng vai trò cầu nối, chuyển đổi dữ liệu ở các định dạng phức tạp như văn bản, hình ảnh thành các vector đặc trưng dạng số mà mô hình có thể hiểu được.

Quá trình Feature Engineering, đặc biệt với các tập dữ liệu lớn, đòi hỏi tài nguyên tính toán mạnh mẽ để thực hiện các phép biến đổi và tính toán phức tạp. Sử dụng dịch vụ VPS NVMe của Vietnix với ổ cứng NVMe tốc độ cao và CPU mạnh mẽ sẽ giúp tăng tốc đáng kể các tác vụ xử lý dữ liệu. Điều này cho phép các nhà khoa học dữ liệu thử nghiệm nhiều kỹ thuật và xây dựng các đặc trưng phức tạp một cách nhanh chóng, tối ưu hóa thời gian và hiệu quả làm việc.

Website nhanh hơn – Bán được nhiều hàng hơn

- Chiếm lĩnh TOP Google, hút traffic.

- Mua sắm mượt mà, tăng tỷ lệ chốt đơn.

- Chuyên gia kỹ thuật đồng hành 24/7.

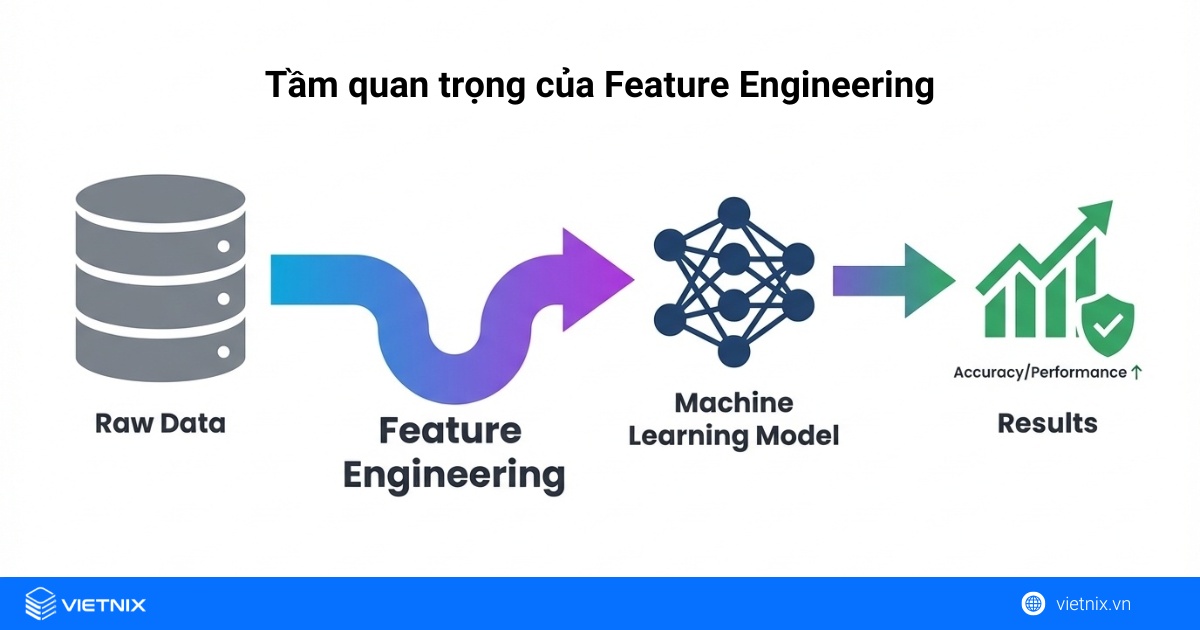

Tầm quan trọng của Feature Engineering

Feature Engineering là một trong những bước quan trọng nhất trong quy trình phát triển mô hình Machine Learning. Việc đầu tư thời gian và công sức vào giai đoạn này thường mang lại hiệu quả cao hơn so với việc chỉ tập trung tinh chỉnh các thuật toán phức tạp trên dữ liệu kém chất lượng.

- Cải thiện hiệu suất và độ chính xác của mô hình: Các đặc trưng chất lượng cao, chứa thông tin liên quan, sẽ giúp thuật toán nhận diện các mẫu và mối quan hệ trong dữ liệu tốt hơn, từ đó đưa ra dự đoán chính xác hơn.

- Giảm độ phức tạp và thời gian huấn luyện: Bằng cách tạo ra các đặc trưng giàu thông tin hơn hoặc loại bỏ các đặc trưng không cần thiết, Feature Engineering giúp giảm số chiều của dữ liệu. Điều này không chỉ làm đơn giản hóa mô hình mà còn rút ngắn thời gian huấn luyện, tiết kiệm tài nguyên tính toán.

- Hạn chế hiện tượng quá khớp (Overfitting): Việc chọn lọc các biến số quan trọng giúp thuật toán không bị “học vẹt” trên tập dữ liệu mẫu. Điều này đảm bảo mô hình vẫn dự đoán đúng khi gặp các dữ liệu mới trong tương lai.

- Tăng tính diễn giải: Những đặc trưng được sắp xếp logic giúp các nhà phân tích dễ dàng hiểu được lý do tại sao mô hình lại đưa ra một quyết định cụ thể.

Các đặc trưng trong học máy

Trong học máy, đặc trưng là một biến đầu vào riêng lẻ, có thể đo lường được và được sử dụng để tạo ra các dự đoán. Các chuyên gia dữ liệu thường phân loại đặc trưng thành các nhóm cơ bản sau:

- Đặc trưng phân loại: Dữ liệu này đại diện cho các nhóm hoặc nhãn cụ thể. Ví dụ điển hình là giới tính (nam, nữ) hoặc màu sắc (xanh, đỏ, vàng).

- Đặc trưng dạng số: Đây là các biến thể hiện dưới dạng con số liên tục hoặc rời rạc (ví dụ: tuổi tác, nhiệt độ, mức lương). Máy tính có thể trực tiếp thực hiện các phép toán trên những đặc trưng này.

- Đặc trưng thời gian: Loại dữ liệu này mang tính chất chu kỳ hoặc phụ thuộc vào lịch trình. Ví dụ như ngày, tháng, năm hoặc thời gian khách hàng lưu lại trên website.

- Đặc trưng văn bản: Dữ liệu này tồn tại dưới dạng ngôn ngữ tự nhiên của con người. Các kỹ sư sẽ sử dụng các kỹ thuật phân tích để chuyển đổi văn bản thành các ma trận số liệu nhằm phục vụ quá trình huấn luyện AI.

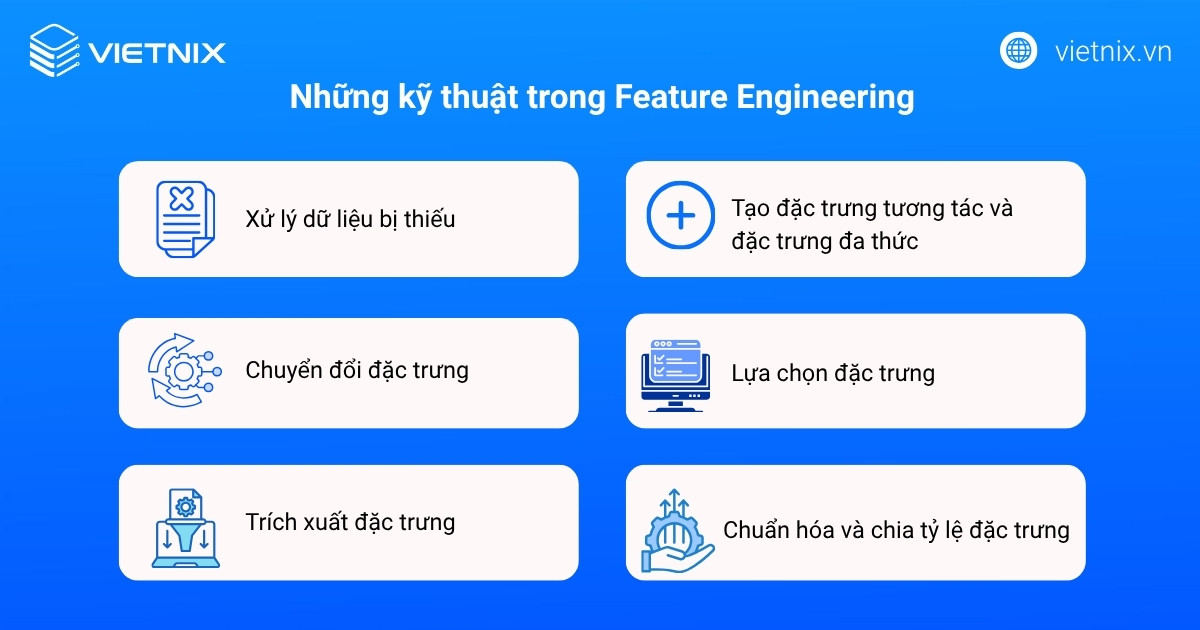

Những kỹ thuật trong Feature Engineering

Xử lý dữ liệu bị thiếu

Dữ liệu trong thực tế thường bị thiếu hoặc khuyết ở một số vị trí. Hầu hết các thuật toán học máy không thể xử lý được dữ liệu bị thiếu, do đó bạn sẽ cần phải xử lý chúng.

- Gán giá trị trung bình/trung vị/yếu vị: Một cách tiếp cận đơn giản là thay thế các giá trị bị thiếu trong một cột bằng giá trị trung bình, trung vị hoặc yếu vị của cột đó.

- Sử dụng mô hình dự đoán: Một cách phức tạp hơn là xây dựng một mô hình học máy khác để dự đoán các giá trị bị thiếu dựa trên các đặc trưng còn lại.

Tạo đặc trưng tương tác và đặc trưng đa thức

- Đặc trưng tương tác: Là việc kết hợp hai hoặc nhiều đặc trưng lại với nhau để tạo ra một đặc trưng mới. Ví dụ, trong bài toán dự đoán giá nhà, việc kết hợp “số phòng ngủ” và “số phòng tắm” có thể tạo ra một đặc trưng mới hữu ích.

- Đặc trưng đa thức: Là việc tạo ra các đặc trưng mới bằng cách lấy lũy thừa của các đặc trưng số hiện có (ví dụ: x², x³) hoặc tích của chúng (ví dụ: x1*x2). Kỹ thuật này giúp mô hình học được các mối quan hệ phức tạp hơn.

Chuyển đổi đặc trưng

Đây là quá trình biến đổi một loại đặc trưng sang dạng khác để phù hợp hơn với yêu cầu của mô hình. Chuyển đổi đặc trưng có thể bao gồm việc chuyển dữ liệu liên tục thành dữ liệu phân loại hoặc chuyển dữ liệu phân loại sang dạng số.

Phân nhóm (Binning)

Chuyển các giá trị số liên tục thành các nhóm (bin) rời rạc, tạo ra đặc trưng phân loại từ dữ liệu số. Mỗi giá trị được gán vào một nhóm dựa trên khoảng giá trị xung quanh, sau đó có thể làm mịn nhóm bằng trung bình, trung vị hoặc giá trị biên để giảm nhiễu cục bộ trong dữ liệu.

Ví dụ, thay vì sử dụng đặc trưng “tuổi” với các giá trị liên tục, bạn có thể chia tuổi thành các khoảng (bin) như “Thanh niên”, “Trung niên”, “Người cao tuổi”. Kỹ thuật này có thể giúp mô hình nắm bắt được các mối quan hệ phi tuyến tính.

Mã hóa

Các mô hình học máy yêu cầu đầu vào là số, do đó các biến phân loại cần được chuyển đổi.

- Mã hóa One-Hot: Kỹ thuật này tạo ra các cột nhị phân mới (chỉ chứa giá trị 0 hoặc 1) cho mỗi giá trị duy nhất của đặc trưng phân loại. Đây là phương pháp phổ biến khi các giá trị trong biến phân loại không có mối quan hệ thứ bậc.

- Mã hóa nhãn: Kỹ thuật này gán một giá trị số nguyên duy nhất cho mỗi danh mục. Phương pháp này phù hợp khi các danh mục có một thứ tự tự nhiên (ví dụ: “Thấp”, “Trung bình”, “Cao”).

Trích xuất đặc trưng

Việc kết hợp, biến đổi các biến ban đầu để tạo không gian đặc trưng mới, thường có số chiều thấp hơn nhưng vẫn giữ được thông tin quan trọng. Trích xuất đặc trưng hữu ích khi số lượng đặc trưng lớn trong khi số mẫu hạn chế, giúp giảm chiều và hỗ trợ mô hình hồi quy hoặc phân loại.

Lựa chọn đặc trưng

Lựa chọn đặc trưng sẽ chọn một tập con các đặc trưng có mức độ liên quan cao nhất đối với nhiệm vụ dự đoán. Từ đó sẽ giúp bạn giảm chiều dữ liệu, hạn chế dư thừa và có thể cải thiện khả năng khái quát của mô hình nhờ loại bỏ đặc trưng nhiễu hoặc ít thông tin.

Phân tích thành phần chính (PCA)

Phân tích thành phần chính là kỹ thuật trích xuất đặc trưng, biến đổi các đặc trưng ban đầu thành các thành phần chính mới. Điều này sẽ chọn ra một tập biến sao cho phần lớn phương sai của dữ liệu gốc được bảo toàn, sau đó chiếu dữ liệu lên không gian mới xác định bởi các thành phần này.

Phân tích phân biệt tuyến tính (LDA)

Tương tự PCA ở chỗ chiếu dữ liệu lên không gian chiều thấp hơn, nhưng có sử dụng thông tin nhãn lớp. Thay vì tối đa hóa phương sai toàn cục như PCA, LDA tạo ra các trục mới sao cho khoảng cách giữa các lớp được phân tách tốt nhất trong không gian đặc trưng.

Chuẩn hóa và chia tỷ lệ đặc trưng

Chuẩn hóa và chia tỷ lệ đặc trưng nhắm tới việc điều chỉnh thang đo và phân bố của các đặc trưng, đặc biệt khi dữ liệu có biên giá trị rất rộng. Điều này giúp giữ nguyên kiểu dữ liệu gốc nhưng đưa các đặc trưng về phạm vi và phân bố thuận lợi hơn cho mô hình, giảm ảnh hưởng tiêu cực của thang đo lớn.

Chia tỷ lệ Min – Max

Chia tỷ lệ Min – Max đưa các giá trị của một đặc trưng về trong một khoảng xác định (thường là 0 đến 1). Mỗi giá trị được chuẩn hóa dựa trên giá trị nhỏ nhất và lớn nhất của đặc trưng, giúp các đặc trưng có cùng miền giá trị trước khi đưa vào mô hình.

Chia tỷ lệ Z – score

Chia tỷ lệ Z – score còn gọi là chuẩn hóa theo phương sai, đưa đặc trưng về trung bình 0 và độ lệch chuẩn 1. Mỗi giá trị được trừ đi trung bình và chia cho độ lệch chuẩn. Cách này đặc biệt hữu ích với các kỹ thuật như PCA và LDA, vốn yêu cầu các đặc trưng có thang đo tương đồng.

Quan điểm của mình: Khi triển khai trên dữ liệu thực tế, mình thấy hiệu quả mô hình thường đến từ việc áp dụng đúng vài kỹ thuật cốt lõi (xử lý thiếu, mã hóa, chọn và chuẩn hóa đặc trưng) một cách nhất quán hơn là cố gắng dùng thật nhiều kỹ thuật phức tạp khác nhau, nên ưu tiên sự rõ ràng và ổn định của pipeline Feature Engineering sẽ giúp bạn dễ bảo trì và cải thiện kết quả lâu dài.

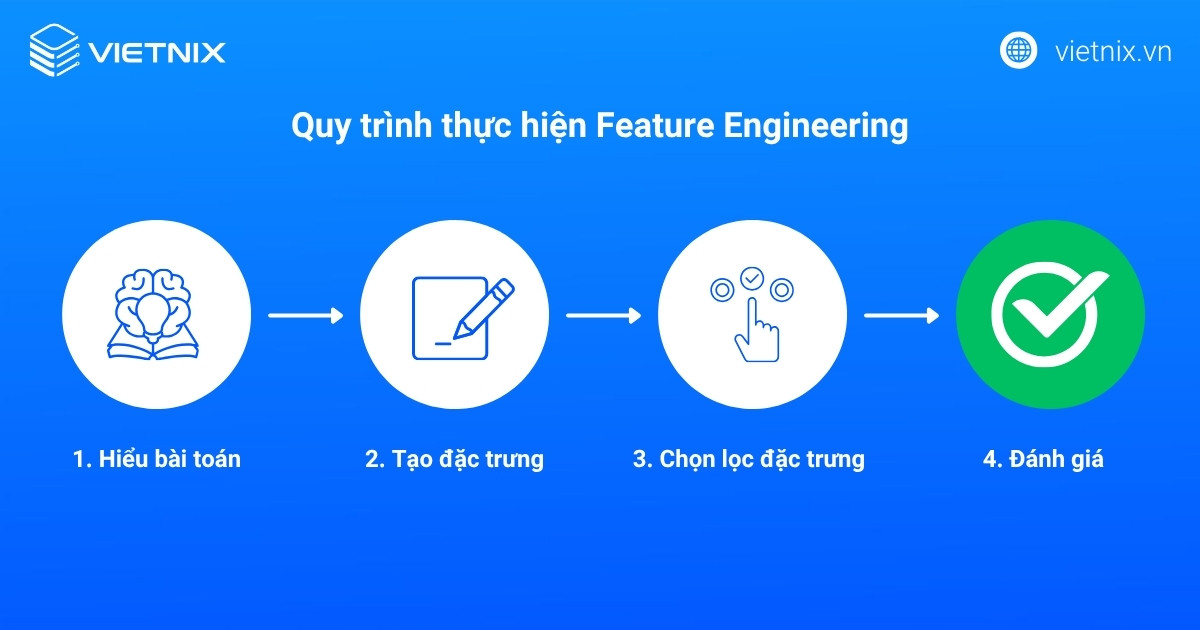

Quy trình thực hiện Feature Engineering

Để đảm bảo tính khoa học và tối ưu, một chu trình Feature Engineering tiêu chuẩn thường bao gồm 4 bước liền mạch:

- Bước 1 – Hiểu bài toán: Các chuyên gia sẽ tiến hành phân tích mục tiêu của doanh nghiệp và đặc thù của bộ dữ liệu thô.

- Bước 2 – Tạo đặc trưng: Dựa trên kiến thức chuyên ngành, người thực hiện tiến hành làm sạch, mã hóa, chuẩn hóa và tổng hợp các biến mới từ các biến đã có.

- Bước 3 – Chọn lọc đặc trưng: Người dùng áp dụng các thuật toán thống kê để giữ lại những tính năng mang lại giá trị cao nhất và loại bỏ các tính năng gây nhiễu.

- Bước 4 – Đánh giá: Cuối cùng, tập dữ liệu mới được đưa vào mô hình học máy để chạy thử nghiệm. Nếu độ chính xác chưa đạt yêu cầu, quy trình này sẽ được lặp lại từ bước đầu tiên.

Các thách thức trong kỹ thuật Feature Engineering

Mặc dù có vai trò quan trọng nhưng quá trình Feature Engineering cũng đối mặt với nhiều thách thức:

- Yêu cầu kiến thức chuyên môn: Để tạo ra các đặc trưng thực sự có ý nghĩa, người thực hiện cần có hiểu biết sâu sắc về lĩnh vực của bài toán.

- Nguy cơ rò rỉ dữ liệu: Đây là một lỗi nghiêm trọng có thể xảy ra khi thông tin từ tập kiểm tra vô tình được sử dụng trong quá trình tạo đặc trưng, dẫn đến việc mô hình có hiệu suất cao ảo tưởng.

- Khó hệ thống hóa: Đôi khi, việc tìm ra các đặc trưng tốt nhất cần dựa nhiều vào kinh nghiệm, trực giác của nhà khoa học dữ liệu hơn là một quy trình cứng nhắc.

- Chi phí thời gian và nguồn lực: Việc phân tích, kết hợp và thử nghiệm các tính năng mới đòi hỏi rất nhiều thời gian. Các nghiên cứu chỉ ra rằng các kỹ sư dữ liệu thường mất tới 80% thời gian làm việc chỉ dành cho việc chuẩn bị và xử lý dữ liệu.

Quan điểm của mình: Trong các dự án mình từng làm, những thách thức như rò rỉ dữ liệu và chi phí thời gian cho việc xử lý, thiết kế đặc trưng chỉ được kiểm soát tốt khi team coi Feature Engineering là quy trình lặp lại có kiểm thử rõ ràng (validation, kiểm tra leakage, logging pipeline) thay vì làm ad‑hoc theo cảm tính từng lần, nhờ đó mô hình triển khai thật ổn định hơn so với kết quả trên notebook.

Xây dựng môi trường AI ổn định với VPS Vietnix

Để triển khai các thuật toán học máy hiệu quả, bạn cần một hạ tầng máy chủ ảo độc lập và mạnh mẽ. Dịch vụ thuê VPS Vietnix cung cấp đa dạng cấu hình, hỗ trợ linh hoạt hệ điều hành Windows và Linux. Mỗi gói máy chủ đều cấp toàn quyền quản trị, sử dụng ổ cứng SSD hoặc NVMe giúp truy xuất dữ liệu cực nhanh. Đặc biệt, Vietnix cam kết uptime 99.9%, sao lưu tự động hàng tuần và đội ngũ kỹ thuật luôn túc trực hỗ trợ 24/7.

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

Feature Engineering trong machine learning là gì?

Feature Engineering là quá trình chọn lọc, tạo mới và biến đổi các biến đầu vào (feature) từ dữ liệu thô để mô hình học máy có thể học được quy luật tốt hơn và dự đoán chính xác hơn. Quy trình này thường bao gồm các bước như xử lý giá trị thiếu, mã hóa biến phân loại, chuẩn hóa/scale dữ liệu số và tạo thêm các đặc trưng phát sinh từ đặc trưng gốc.

Một số ví dụ về feature engineering là gì?

Một số ví dụ phổ biến gồm: tạo biến chênh lệch giá (giá bán – giá nhập), tính tổng/đếm/số lần xuất hiện trong một khoảng thời gian, phân nhóm (binning) dữ liệu số thành các khoảng, mã hóa one-hot cho biến phân loại hoặc tạo đặc trưng khoảng cách từ tọa độ địa lý. Trong chuỗi thời gian, có thể tạo các đặc trưng như trung bình trượt 7 ngày, tổng bán hàng 30 ngày gần nhất, hay biến cờ đánh dấu cuối tuần/ngày lễ.

Feature vector là gì?

Feature vector là một vector n chiều gồm các giá trị số biểu diễn đầy đủ các đặc trưng của một điểm dữ liệu (một quan sát) trong không gian đặc trưng. Mỗi phần tử trong feature vector tương ứng với một feature cụ thể, và các mô hình học máy sẽ sử dụng vector này làm đầu vào để huấn luyện, phân loại, phân cụm hoặc dự đoán.

Feature trong machine learning là gì?

Feature là một thuộc tính hoặc biến đầu vào mô tả đối tượng mà mô hình cần học, ví dụ như độ tuổi, thu nhập, số lượt truy cập, vị trí địa lý hay nội dung văn bản đã được mã hóa. Mỗi feature nắm giữ một khía cạnh thông tin của dữ liệu, và tập hợp tất cả các feature sẽ quyết định mức độ thông tin mà mô hình có thể khai thác để đưa ra dự đoán.

Lag features là gì?

Lag features là các đặc trưng được tạo từ những giá trị quá khứ của chính biến mục tiêu hoặc các biến đầu vào khác trong bài toán chuỗi thời gian. Ví dụ, với một chuỗi theo ngày, ta có thể dùng giá trị của ngày hôm qua (lag – 1), 7 ngày trước (lag – 7) hoặc 30 ngày trước (lag – 30) làm feature để mô hình nắm bắt được quan hệ tự tương quan (autoregressive) trong dữ liệu.

Feature Engineering là bước xử lý quan trọng trong quy trình xây dựng mô hình máy học. Khi đặc trưng được thiết kế tốt, mô hình học được cấu trúc dữ liệu quan trọng hơn, dự đoán chính xác hơn, hạn chế overfitting và sử dụng tài nguyên huấn luyện hiệu quả hơn. Dù thuật toán và công cụ thay đổi theo thời gian, đầu tư cho Feature Engineering vẫn là cách bền vững để nâng cao chất lượng mô hình học máy và khai thác tối đa giá trị từ dữ liệu.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày