PCA là gì? Tổng quan kiến thức về Principal Component Analysis

Đã kiểm duyệt nội dung

Đánh giá

PCA là kỹ thuật giảm chiều dữ liệu tuyến tính, biến tập dữ liệu nhiều biến ban đầu thành một tập biến mới có số chiều nhỏ hơn nhưng vẫn giữ lại phần lớn phương sai quan trọng và loại bớt thông tin trùng lặp. Bài viết này được mình đúc kết từ quá trình xử lý hàng triệu dòng dữ liệu và triển khai thực tế các pipeline Machine Learning để giúp bạn hiểu rõ cơ chế hoạt động và các trường hợp nên sử dụng PCA tối ưu nhất.

Những điểm chính

- Quan điểm của mình: Với các bài toán dữ liệu nhiều chiều và nhiều nhiễu, PCA nên được xem là bước tiền xử lý mặc định để làm sạch và cô đọng thông tin trước khi đưa vào các mô hình học máy phức tạp hơn.

- Khái niệm PCA: Hiểu rõ PCA là kỹ thuật giảm chiều dữ liệu giúp biến đổi tập dữ liệu nhiều biến thành các thành phần chính ít chiều hơn, giữ lại phần lớn thông tin quan trọng và loại bỏ nhiễu.

- Lợi ích khi sử dụng: Nhận biết các lợi ích như thu gọn không gian đặc trưng, loại bỏ thông tin trùng lặp, tăng hiệu quả mô hình học máy và hỗ trợ trực quan hóa dữ liệu dễ dàng.

- Cơ chế hoạt động: Nắm vững quy trình 5 bước gồm chuẩn hóa, tính ma trận hiệp phương sai, phân rã trị riêng, chọn thành phần chính và chiếu dữ liệu để thực hiện PCA hiệu quả.

- Biến thể mở rộng: Phân biệt được Kernel PCA, Sparse PCA, Robust PCA để áp dụng cho các trường hợp dữ liệu phi tuyến, nhiều nhiễu hoặc yêu cầu tính thưa.Ưu nhược điểm: Nhận diện rõ điểm mạnh về tốc độ tính toán, khả năng giảm nhiễu so với hạn chế về việc mất mát thông tin và khó giải thích ý nghĩa các thành phần chính mới.

- So sánh với kỹ thuật khác: Hiểu sự khác nhau giữa PCA với t-SNE và UMAP để chọn đúng công cụ cho từng bài toán.

- Ứng dụng thực tế: Biết cách áp dụng PCA vào nén ảnh, trích xuất đặc trưng, phát hiện gian lận và hỗ trợ chẩn đoán y tế để tối ưu hóa quy trình phân tích dữ liệu.

- Trường hợp nên dùng: Xác định đúng thời điểm áp dụng PCA khi dữ liệu có tương quan tuyến tính mạnh, số chiều quá lớn gây quá tải tính toán hoặc cần xử lý đa cộng tuyến cho mô hình hồi quy.

- Giới thiệu Vietnix: Vietnix cung cấp hạ tầng VPS hiệu năng cao, hỗ trợ tốt cho việc triển khai các pipeline xử lý dữ liệu lớn và chạy mô hình học máy.

- Câu hỏi thường gặp: Được giải đáp các thắc mắc liên quan đến PCA.

PCA là gì?

PCA (Principal Component Analysis) là một kỹ thuật giảm chiều dữ liệu dùng để biến đổi tập dữ liệu nhiều biến thành một tập biến mới có số chiều nhỏ nhưng vẫn giữ lại phần lớn phương sai quan trọng. Về bản chất, PCA tìm các tổ hợp tuyến tính trực giao của các biến gốc sao cho các phương mới này giải thích được nhiều biến thiên nhất của dữ liệu, nhờ đó loại bỏ được thông tin trùng lặp và nhiễu.

Trong không gian đại số tuyến tính, PCA tương ứng với một phép biến đổi trực giao đưa dữ liệu từ không gian nhiều chiều ban đầu sang một không gian mới ít chiều hơn, thường là 2 hoặc 3 chiều để dễ trực quan hóa, nhưng vẫn bảo toàn tối đa cấu trúc chính của dữ liệu. Qua quá trình triển khai các pipeline phân tích dữ liệu và mô hình học máy cho khách hàng doanh nghiệp, PCA thường được sử dụng như một bước tiền xử lý quan trọng giúp giảm số chiều, giảm đa cộng tuyến, hỗ trợ mô hình hội tụ nhanh hơn và dễ quan sát cấu trúc dữ liệu hơn.

Để thuật toán PCA xử lý mượt mà các tập dữ liệu Big Data khổng lồ, việc trang bị hệ thống máy chủ tốc độ cao là bắt buộc. Dịch vụ VPS NVMe tại Vietnix với 100% phần cứng ổ NVMe U.2 Enterprise và CPU AMD EPYC 7002 giúp truy xuất dữ liệu cực nhanh, độ trễ thấp. Nhờ đó, thời gian tính toán ma trận hay huấn luyện mô hình được rút ngắn tối đa, đồng thời đảm bảo an toàn tuyệt đối nhờ hệ thống sao lưu tự động định kỳ hàng tuần cùng sự hỗ trợ kỹ thuật chuyên nghiệp 24/7.

Website nhanh hơn – Bán được nhiều hàng hơn

- Chiếm lĩnh TOP Google, hút traffic.

- Mua sắm mượt mà, tăng tỷ lệ chốt đơn.

- Chuyên gia kỹ thuật đồng hành 24/7.

Lợi ích khi sử dụng PCA trong phân tích dữ liệu

PCA mang lại nhiều lợi ích khi làm việc với dữ liệu nhiều chiều, đặc biệt trong các dự án phân tích và học máy ở quy mô lớn. Dưới đây là các lợi ích chính khi sử dụng PCA trong pipeline xử lý dữ liệu:

- Khắc phục hiện tượng đa cộng tuyến: Trong các mô hình hồi quy, nếu các biến độc lập tương quan mạnh với nhau sẽ gây nhiễu kết quả. PCA tạo ra các thành phần chính hoàn toàn độc lập (không tương quan), giúp mô hình ổn định hơn.

- Giảm thông tin nhiễu: PCA tập trung vào các hướng có phương sai lớn (thông tin quan trọng) và loại bỏ các hướng có phương sai cực thấp (thường là nhiễu), giúp dữ liệu sạch hơn.

- Tăng cường hiệu quả mô hình: Giảm chiều dữ liệu giúp rút ngắn thời gian huấn luyện và suy luận, giảm chi phí tính toán, đặc biệt hữu ích khi dùng các thuật toán có độ phức tạp theo số chiều như k-NN, SVM hoặc clustering.

- Hỗ trợ trực quan hóa dữ liệu: Con người chỉ có thể quan sát biểu đồ trong không gian 2D hoặc 3D. PCA giúp đưa dữ liệu hàng nghìn chiều về 2-3 chiều để chúng ta có thể nhìn thấy các cụm hoặc xu hướng một cách trực quan.

- Giảm thiểu chi phí và thời gian tính toán: Việc ép số lượng biến đầu vào giảm đi đáng kể, giúp mô hình Machine Learning tiêu tốn ít tài nguyên CPU/RAM để tính toán hơn và giảm mạnh chi phí vận hành hạ tầng.

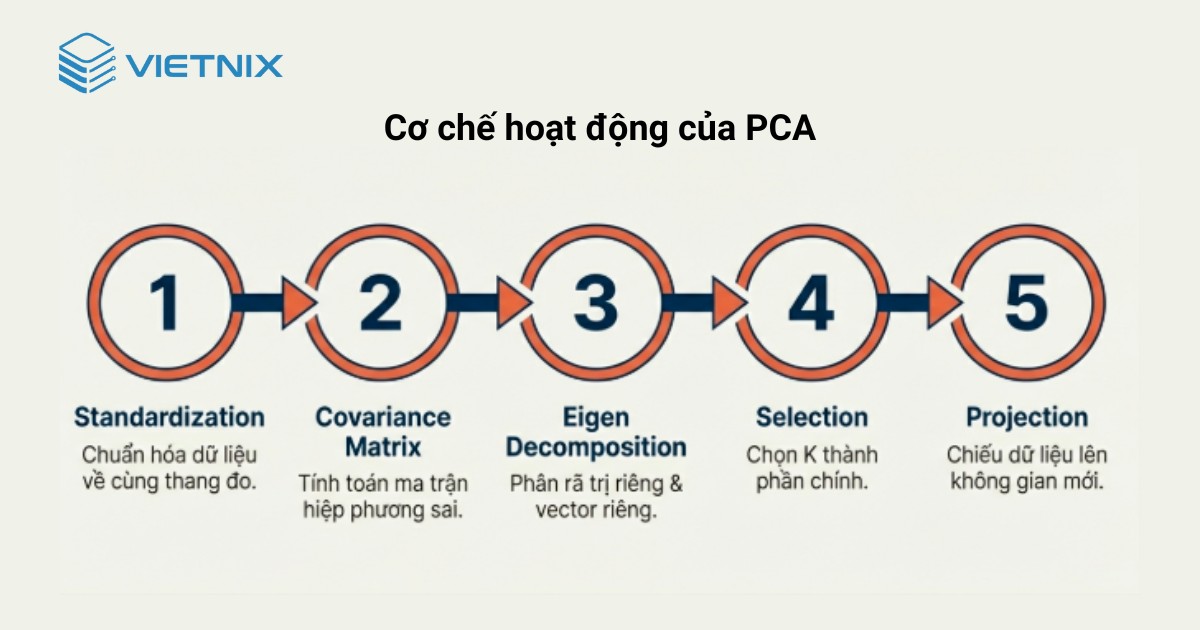

Cơ chế hoạt động của PCA

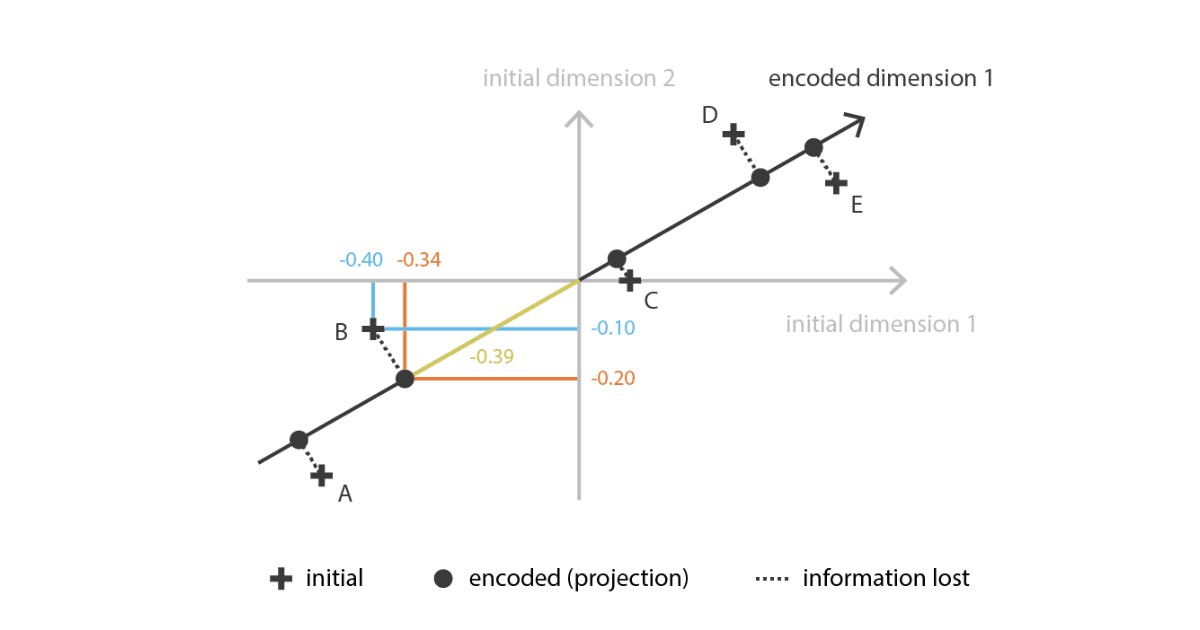

Cơ chế hoạt động của PCA dựa trên đại số tuyến tính: PCA tìm các trục tọa độ mới là tổ hợp tuyến tính của các biến gốc sao cho phương sai dữ liệu theo các trục này là lớn nhất và các trục mới trực giao với nhau. Quy trình gồm các bước sau:

Bước 1: Chuẩn hóa dữ liệu

Ở bước đầu, PCA đưa dữ liệu về dạng có kỳ vọng bằng 0 để loại bỏ ảnh hưởng của vị trí trong không gian. Thông thường, bạn trừ từng điểm dữ liệu cho vector kỳ vọng (giá trị trung bình theo từng chiều), sau đó có thể chia cho độ lệch chuẩn để các thuộc tính nằm trên cùng thang đo và không còn biến nào chi phối do đơn vị đo lớn hơn.

Mẹo từ chuyên gia: Ở bước chuẩn hóa này, theo kinh nghiệm của mình, bạn bắt buộc phải sử dụng hàm StandardScaler (trong thư viện Scikit-Learn) thay vì MinMaxScaler. PCA cực kỳ nhạy cảm với phương sai, nếu bạn không chuẩn hóa đúng cách, thành phần chính đầu tiên sẽ bị bóp méo hoàn toàn bởi biến có dải giá trị lớn nhất.

Bước 2: Tính ma trận hiệp phương sai

Tiếp theo, PCA tính ma trận hiệp phương sai giữa các biến đã chuẩn hóa để đo mức độ biến thiên chung và tương quan tuyến tính giữa từng cặp biến. Ma trận này phản ánh cấu trúc phân tán của dữ liệu: nếu hai biến tương quan cao, hiệp phương sai lớn, từ đó cho thấy tồn tại thông tin trùng lặp có thể gom lại trên một trục mới.

Bước 3: Phân rã trị riêng và vector riêng

Từ ma trận hiệp phương sai, PCA thực hiện phân rã trị riêng – vector riêng để tìm các cặp eigenvalue (trị riêng) và eigenvector (vector riêng). Mỗi vector riêng xác định một hướng trong không gian dữ liệu, còn trị riêng tương ứng cho biết lượng phương sai dữ liệu khi chiếu lên hướng đó, trị riêng càng lớn thì hướng đó càng quan trọng vì chứa nhiều thông tin hơn.

Bước 4: Chọn các thành phần chính

Sau khi có toàn bộ vector riêng và trị riêng, PCA sắp xếp các vector riêng theo thứ tự giảm dần của trị riêng rồi chọn K vector riêng đầu tiên để tạo thành ma trận chuyển đổi các thành phần chính. Tập K thành phần này tối đa hóa tổng phương sai được giữ lại, giúp giảm số chiều nhưng vẫn bảo toàn phần lớn cấu trúc biến thiên quan trọng của dữ liệu gốc.

Mẹo từ chuyên gia: Làm sao để biết nên chọn bao nhiêu K? Mình thường sử dụng biểu đồ Scree Plot kết hợp với phương pháp Cumulative Explained Variance. Hãy chọn số lượng K sao cho tổng phương sai tích lũy đạt từ 80% đến 95% thông tin của dữ liệu gốc là tối ưu nhất.

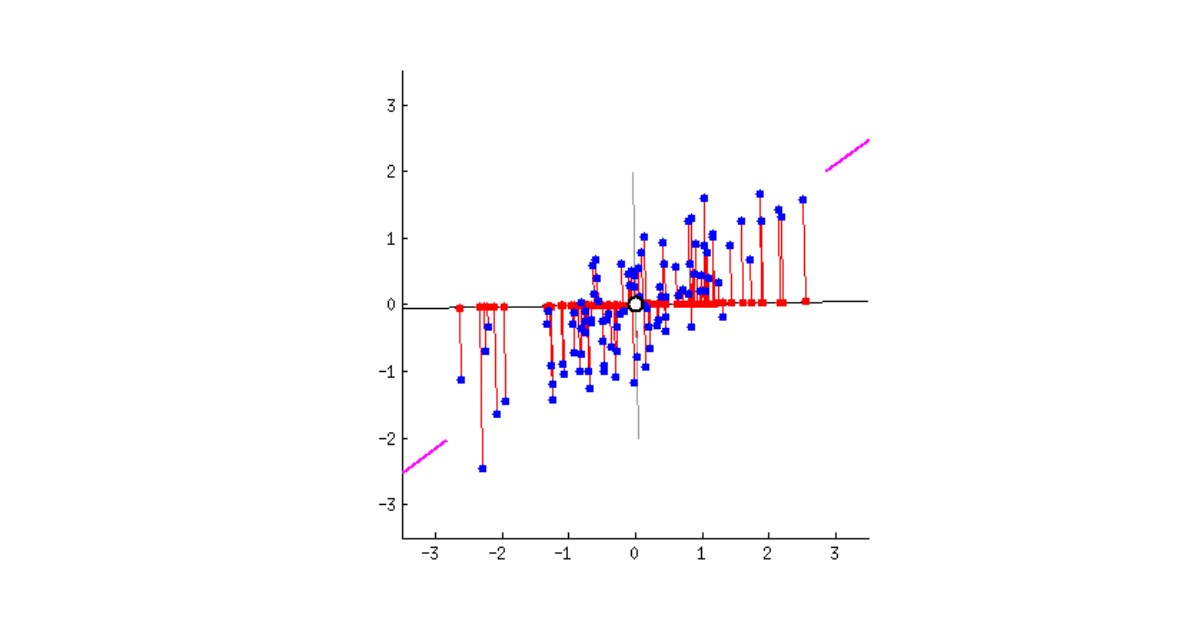

Bước 5: Chiếu dữ liệu lên không gian mới

Cuối cùng, PCA chiếu dữ liệu đã chuẩn hóa lên không gian mới sinh bởi K vector riêng, thu được ma trận dữ liệu Z có số chiều thấp hơn. Mỗi hàng trong Z là biểu diễn mới của một mẫu dữ liệu theo các thành phần chính, có thể dùng trực tiếp cho mô hình học máy hoặc trực quan hóa 2D/3D mà vẫn nắm được phần lớn thông tin quan trọng của tập dữ liệu ban đầu.

Biến thể mở rộng của PCA

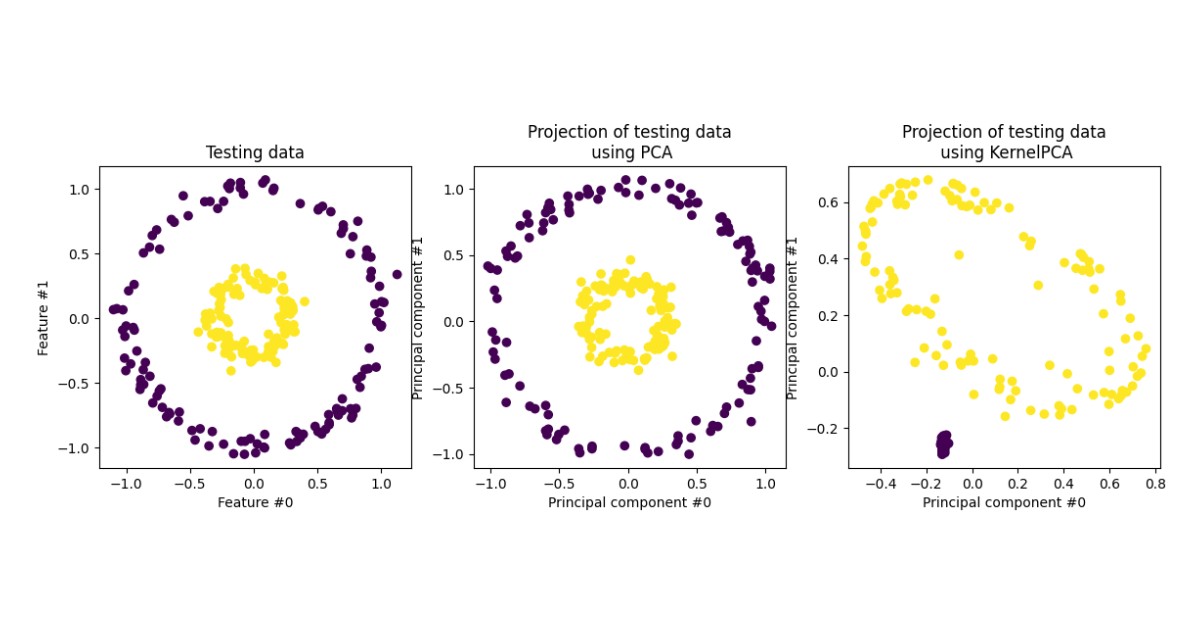

Kernel PCA (KPCA)

Kernel PCA mở rộng PCA tuyến tính bằng cách áp dụng kernel trick để ánh xạ dữ liệu từ không gian gốc sang một không gian đặc trưng có chiều cao hơn, tại đó các quan hệ phi tuyến có thể trở thành tuyến tính. PCA được thực hiện trong không gian đặc trưng này thông qua ma trận kernel, giúp trích xuất các thành phần chính phản ánh cấu trúc phi tuyến của dữ liệu, hữu ích trong các bài toán như nhận diện khuôn mặt, xử lý ảnh và phân cụm dữ liệu phức tạp.

Sparse PCA (SPCA)

Sparse PCA thêm ràng buộc sparsity lên vector thành phần chính, sao cho mỗi thành phần chỉ phụ thuộc vào một số nhỏ biến gốc, thay vì kết hợp tất cả biến như PCA chuẩn. Cách tiếp cận này làm cho thành phần chính dễ diễn giải hơn và giúp mô hình ổn định hơn trong bối cảnh dữ liệu rất nhiều chiều như dữ liệu gen hoặc văn bản, nơi việc chọn ra ít biến quan trọng là cần thiết để giảm nhiễu và giảm nguy cơ quá khớp.

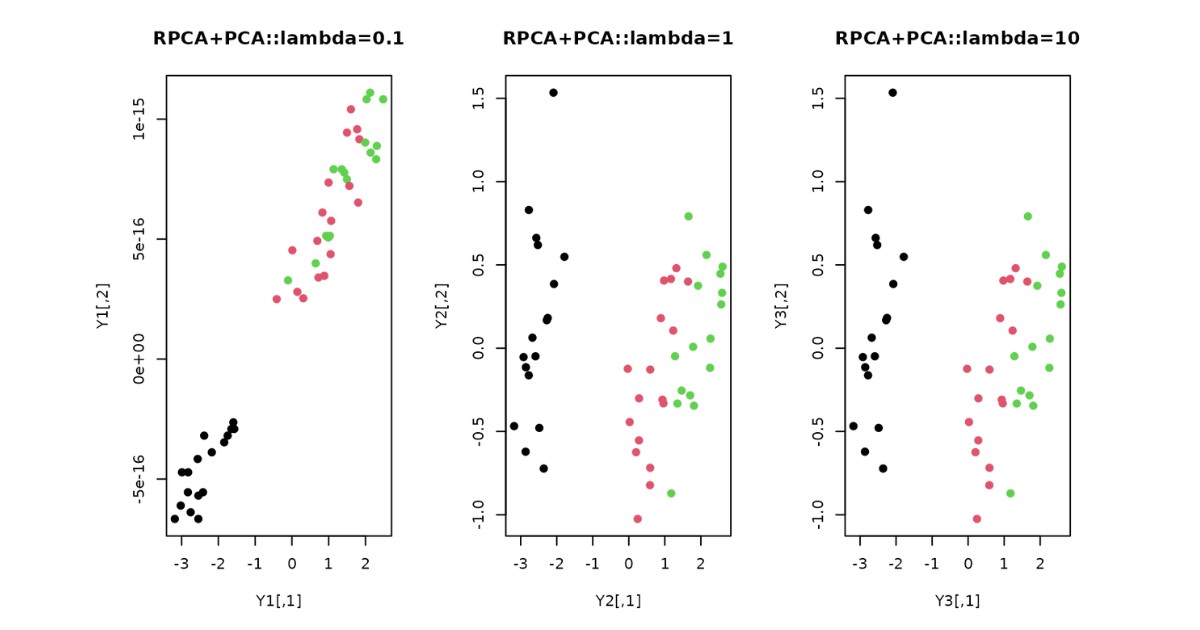

Robust PCA (RPCA)

Robust PCA được thiết kế để xử lý dữ liệu chứa nhiều nhiễu hoặc nhiều điểm ngoại lai bằng cách phân tách ma trận dữ liệu thành hai phần: một ma trận hạng thấp biểu diễn cấu trúc chính và một ma trận thưa chứa các sai lệch hoặc outlier. Nhờ phân rã này, RPCA có thể giữ lại phần cấu trúc ổn định của dữ liệu trong khi cô lập các phần bất thường, phù hợp cho các bài toán như phát hiện gian lận, loại nền trong video giám sát hoặc phân tích dữ liệu cảm biến có nhiều lỗi đo.

Incremental PCA (IPCA)

Incremental PCA giải quyết vấn đề bộ nhớ của PCA truyền thống bằng cách ước lượng các thành phần chính theo từng lô dữ liệu nhỏ thay vì tải toàn bộ dữ liệu vào bộ nhớ cùng một lúc. Phương pháp này đặc biệt phù hợp với Big Data hoặc streaming data, ví dụ như log hệ thống và dữ liệu thời gian thực, khi cần cập nhật mô hình PCA dần theo dòng dữ liệu mà vẫn giữ chi phí bộ nhớ và thời gian xử lý ở mức chấp nhận được.

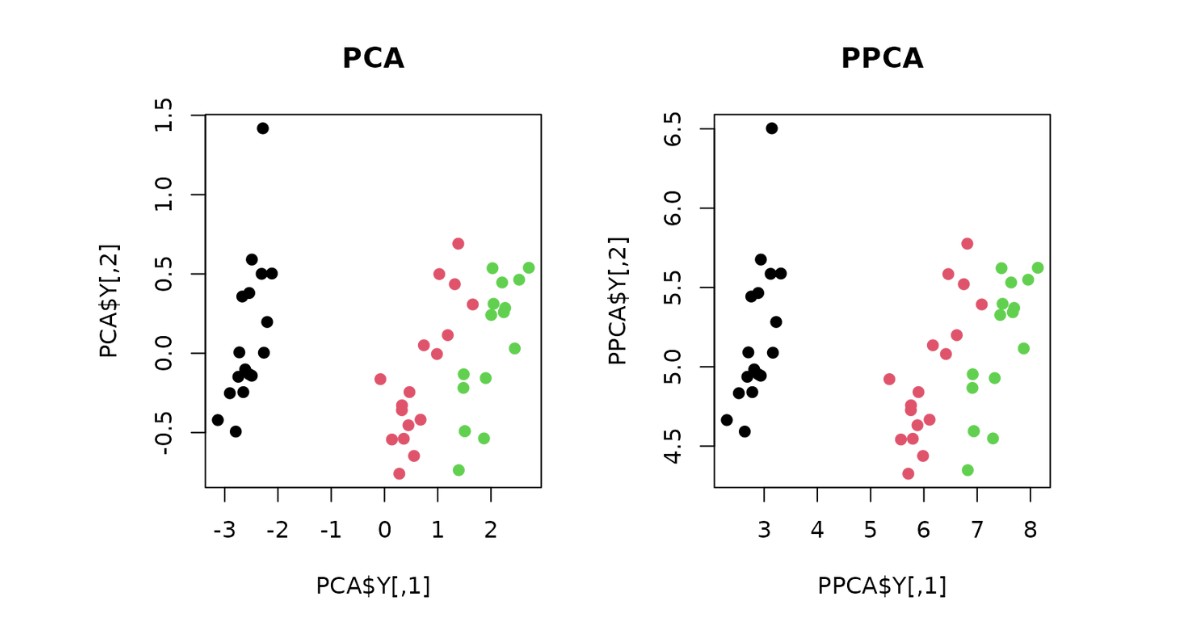

Probabilistic PCA (PPCA)

Probabilistic PCA đưa PCA vào khuôn khổ mô hình xác suất, giả định rằng dữ liệu được sinh ra từ một tập biến tiềm ẩn tuyến tính cộng với nhiễu Gaussian. Cách mô hình hóa này cho phép PCA xử lý tốt dữ liệu thiếu thông qua suy diễn xác suất, đồng thời cung cấp ước lượng về độ không chắc chắn của các tham số và điểm dữ liệu, hữu ích cho các bài toán thống kê suy diễn và mô hình hóa bayesian.

Ưu và nhược điểm của PCA

Xử lý đa cộng tuyến: Tạo ra các biến mới không tương quan bằng cách chiếu dữ liệu lên các trục trực giao, giúp giảm vấn đề đa cộng tuyến trong hồi quy và các mô hình tuyến tính.

Giảm nhiễu: Loại bỏ các thành phần có phương sai rất thấp, thường chứa ít thông tin và chủ yếu là nhiễu, giúp tín hiệu dữ liệu rõ ràng hơn cho mô hình.

Nén dữ liệu và tăng tốc xử lý: Biểu diễn dữ liệu bằng ít chiều hơn nhưng vẫn giữ phần lớn phương sai, từ đó giảm dung lượng lưu trữ và rút ngắn thời gian huấn luyện, suy luận của mô hình học máy.

Hỗ trợ phát hiện điểm ngoại lai: Chiếu dữ liệu xuống không gian thành phần chính giúp các điểm bất thường lệch xa cụm dữ liệu chính dễ quan sát và dễ tách hơn, hỗ trợ các thuật toán phát hiện outlier hoạt động hiệu quả hơn.

Nguy cơ mất thông tin: Khi chọn số lượng thành phần chính K quá nhỏ, PCA có thể loại bỏ cả những chiều chứa thông tin quan trọng, làm giảm hiệu suất mô hình ở các bài toán nhạy với chi tiết dữ liệu.

Khó giải thích (Interpretability): Mỗi thành phần chính là tổ hợp tuyến tính của nhiều biến gốc nên khó gán ý nghĩa rõ ràng cho từng thành phần, đặc biệt khi số biến ban đầu lớn và phức tạp.

Nhạy cảm với tỉ lệ và chuẩn hóa dữ liệu: Kết quả PCA phụ thuộc mạnh vào việc chuẩn hóa, nếu không chuẩn hóa đúng cách thì các biến có thang đo lớn sẽ chi phối phương sai và làm lệch hướng thành phần chính.

Giả định tính tuyến tính: PCA giả định cấu trúc dữ liệu chủ yếu là tuyến tính, do đó hoạt động kém trên dữ liệu có quan hệ phi tuyến phức tạp trừ khi kết hợp với kỹ thuật mở rộng như Kernel PCA.

So sánh PCA với các kỹ thuật khác

PCA thường được dùng cùng hoặc song song với các kỹ thuật khác nên cần hiểu rõ điểm giống và khác để chọn công cụ phù hợp cho từng bài toán. Bảng dưới đây tóm tắt điểm khác biệt giữa PCA, K-means, t-SNE và UMAP:

| Tiêu chí | PCA | K-means clustering | t-SNE | UMAP |

|---|---|---|---|---|

| Loại kỹ thuật | Học không giám sát, giảm chiều dữ liệu. | Học không giám sát, phân cụm dữ liệu thành K nhóm. | Học không giám sát, giảm chiều phi tuyến. | Học không giám sát, giảm chiều phi tuyến. |

| Mục tiêu chính | Tạo các thành phần chính là tổ hợp tuyến tính của biến gốc để giữ tối đa phương sai toàn cục. | Gán mỗi điểm vào một cụm sao cho khoảng cách đến tâm cụm gần nhất là nhỏ nhất. | Biểu diễn dữ liệu cao chiều xuống 2D/3D tối ưu hóa khoảng cách cục bộ giữa các điểm. | Bảo tồn cấu trúc cục bộ và một phần cấu trúc toàn cục khi chiếu dữ liệu xuống chiều thấp. |

| Tuyến tính / phi tuyến | Tuyến tính, dựa trên eigenvector của ma trận hiệp phương sai. | Không phải kỹ thuật giảm chiều, dùng khoảng cách Euclid trong không gian gốc. | Phi tuyến, mô hình hóa phân bố xác suất cục bộ giữa các điểm. | Phi tuyến, dựa trên lý thuyết đa tạp và đồ thị lân cận. |

| Bảo tồn thông tin | Bảo tồn phương sai toàn cục tốt, phù hợp khi quan tâm cấu trúc tổng thể. | Không bảo tồn phương sai, tập trung vào cấu trúc cụm. | Tập trung bảo tồn cấu trúc cục bộ, đôi khi bóp méo cấu trúc toàn cục. | Cân bằng giữa cấu trúc cục bộ và toàn cục, thường ổn định hơn t-SNE. |

| Kết quả đầu ra | Dữ liệu trong không gian mới có số chiều thấp hơn, mỗi chiều là một thành phần chính. | Nhãn cụm cho từng điểm và tọa độ tâm cụm. | Tọa độ 2D/3D chủ yếu dùng để trực quan hóa. | Tọa độ 2D/3D hoặc vài chiều, dùng cho trực quan hóa và tiền xử lý. |

| Khả năng ứng dụng | Giảm chiều, xử lý đa cộng tuyến, tiền xử lý cho mô hình ML. | Phân đoạn khách hàng, phân cụm ảnh, phát hiện nhóm hành vi. | Khám phá cấu trúc dữ liệu phức tạp, trực quan hóa embedding. | Trực quan hóa và giảm chiều dữ liệu rất lớn, embedding cho downstream tasks. |

| Hiệu năng và dữ liệu lớn | Tính toán nhanh, ma trận lớn có thể dùng SVD và các biến thể incremental. | Tính toán tương đối nhanh, mở rộng tốt với số chiều vừa phải. | Tốn tài nguyên, khó mở rộng cho tập dữ liệu cực lớn. | Hiệu quả hơn t-SNE cho dữ liệu lớn nhưng vẫn nặng hơn PCA. |

Lựa chọn của chuyên gia: Mặc dù t-SNE và UMAP cho ra các biểu đồ 2D/3D trực quan cực kỳ sắc nét và phân cụm đẹp mắt, nhưng nếu bạn cần tạo ra các biến mới để đưa vào huấn luyện mô hình dự đoán trong hệ thống thực tế, mình khuyên dùng PCA. Nguyên nhân là do PCA có công thức biến đổi toán học nhất quán cho dữ liệu mới, điều mà t-SNE không thể làm được.

Ứng dụng của PCA

PCA được dùng như một bước tiền xử lý quan trọng trong nhiều dự án phân tích và học máy, đặc biệt khi dữ liệu có số chiều lớn và khó khai thác trực tiếp. Dưới đây là các ứng dụng tiêu biểu của PCA:

- Trực quan hóa dữ liệu: Giảm dữ liệu nhiều chiều xuống 2D hoặc 3D giúp quan sát xu hướng, cụm dữ liệu và điểm ngoại lai dễ hơn trên biểu đồ, hỗ trợ tốt cho giai đoạn khám phá dữ liệu và trình bày kết quả.

- Tiền xử lý cho mô hình Machine Learning: Dùng PCA để giảm chiều giúp rút ngắn thời gian huấn luyện, giảm nguy cơ overfitting và xử lý đa cộng tuyến trước khi áp dụng các mô hình như hồi quy tuyến tính, logistic regression, SVM hay k-NN.

- Trích xuất đặc trưng: Biến đổi các biến đầu vào tương quan cao thành tập thành phần chính không tương quan, giúp mô hình tập trung vào cấu trúc quan trọng của dữ liệu trong các bài toán như xử lý văn bản, tín hiệu, dữ liệu cảm biến.

- Nén dữ liệu và hình ảnh: Biểu diễn dữ liệu bằng ít thành phần hơn nhưng vẫn giữ phần lớn thông tin, từ đó giảm dung lượng lưu trữ và tăng tốc độ truyền tải, đặc biệt hữu ích với ảnh, video hoặc các ma trận đặc trưng lớn.

- Lọc nhiễu và phát hiện bất thường: Giữ lại các thành phần có phương sai cao và loại bỏ thành phần phương sai thấp giúp giảm nhiễu, đồng thời các điểm ngoại lai thường xuất hiện lệch xa trong không gian thành phần chính nên dễ phát hiện hơn.

- Ứng dụng trong y tế và chẩn đoán: PCA thường được kết hợp với logistic regression hoặc các mô hình phân loại khác để chẩn đoán bệnh, ví dụ trong các nghiên cứu dự đoán ung thư vú trên bộ dữ liệu Wisconsin nhằm giảm số đặc trưng, cải thiện độ chính xác và giảm thời gian suy luận.

- Thị giác máy tính: Đặc biệt là nhận diện khuôn mặt (phương pháp Eigenfaces). Thay vì phân tích hàng triệu pixel dư thừa, PCA nén ảnh lại thành các đường nét, khối màu chính để AI quét nhanh qua hệ thống camera.

- Tài chính và chấm điểm tín dụng: Ngân hàng dùng PCA để tổng hợp hàng trăm thói quen chi tiêu, thu nhập của khách hàng thành 2-3 “Chỉ số rủi ro” tổng quát nhằm duyệt hồ sơ vay vốn.

Trường hợp nên sử dụng PCA

PCA phù hợp nhất khi mục tiêu là giảm chiều dữ liệu và trích xuất đặc trưng tuyến tính một cách hiệu quả, đặc biệt với bộ dữ liệu lớn và nhiều biến có tương quan. Bạn có thể cân nhắc dùng PCA trong các trường hợp sau:

- Dữ liệu có quan hệ chủ yếu tuyến tính: PCA là kỹ thuật tuyến tính, hiệu quả khi mối quan hệ giữa các biến gần tuyến tính và bạn muốn giữ lại cấu trúc phương sai toàn cục của dữ liệu.

- Số chiều lớn, cần giảm độ phức tạp và chi phí tính toán: PCA dùng phép toán ma trận nên xử lý khá tốt dữ liệu nhiều chiều ở quy mô lớn, phù hợp làm bước tiền xử lý trước khi đưa vào mô hình học máy hoặc thuật toán phân cụm.

- Cần xử lý đa cộng tuyến giữa các biến: Khi các đặc trưng đầu vào tương quan mạnh và gây bất ổn cho hồi quy hoặc mô hình tuyến tính, PCA giúp chuyển sang bộ biến mới không tương quan, cải thiện độ ổn định của ước lượng.

- Muốn bảo tồn phương sai và xác định đặc trưng quan trọng: PCA ưu tiên giữ các hướng có phương sai lớn nhất, nhờ đó hỗ trợ nhận diện trục phương sai chính và nhóm đặc trưng đóng góp nhiều vào biến thiên của dữ liệu.

- Cần tạo đặc trưng mới cho mô hình, không chỉ trực quan hóa: Khác với t-SNE hoặc UMAP vốn chủ yếu phục vụ trực quan hóa, PCA tạo ra các biến mới có thể dùng trực tiếp làm input cho mô hình học máy trong pipeline sản xuất.

Giải pháp hạ tầng mạnh mẽ khi thuê VPS tại Vietnix cho dự án Data Science

Khi ứng dụng thuật toán PCA vào các dự án Machine Learning hay Data Science có quy mô lớn, tính ổn định của nền tảng máy chủ là ưu tiên hàng đầu. Dịch vụ thuê máy chủ ảo VPS Vietnix mang đến đa dạng cấu hình, đáp ứng hoàn hảo mọi mức độ tính toán ma trận phức tạp. Với cam kết uptime lên tới 99.9%, lưu lượng truyền tải không giới hạn và toàn quyền quản trị máy chủ linh hoạt, hệ thống AI của bạn sẽ luôn vận hành mượt mà, liên tục. Đi kèm với đó là đội ngũ kỹ thuật tận tâm túc trực 24/7, sẵn sàng xử lý sự cố mọi lúc bạn cần.

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

PCA dùng để làm gì?

PCA dùng để giảm chiều dữ liệu, tóm tắt nhiều biến thành một số ít thành phần chính nhưng vẫn giữ phần lớn mẫu hình và phương sai quan trọng trong dữ liệu. PCA thường được dùng để tiền xử lý cho mô hình học máy, trực quan hóa dữ liệu cao chiều, nén dữ liệu và giảm nhiễu trong các bài toán ảnh, tín hiệu, tài chính hay dữ liệu cảm biến.

PCA trong SPSS là gì?

Trong SPSS, PCA là một lựa chọn trong nhóm Dimension Reduction / Factor Analysis giúp biến đổi tập biến ban đầu thành các principal components không tương quan, dùng để rút gọn số biến và khám phá cấu trúc ẩn của dữ liệu.

PCA có hỗ trợ xử lý dữ liệu thiếu không?

PCA chuẩn yêu cầu dữ liệu đầy đủ nên thường cần xử lý thiếu trước, tuy nhiên các biến thể như Probabilistic PCA (PPCA) cho phép mô hình hóa dữ liệu dưới dạng mô hình xác suất với nhiễu Gaussian và có thể ước lượng thành phần chính ngay cả khi có missing value. Trong thực tế, thường kết hợp các bước như imputation (trung bình, KNN, mô hình hóa) với PCA hoặc dùng PPCA, tùy vào mức độ thiếu và yêu cầu chính xác.

PCA là một công cụ dùng để giảm chiều, xử lý đa cộng tuyến và nén dữ liệu, đồng thời hỗ trợ trực quan hóa và trích xuất đặc trưng cho nhiều bài toán phân tích và học máy. Khi hiểu rõ cơ chế, ưu nhược điểm, các biến thể mở rộng và cách kết hợp PCA với các kỹ thuật khác, bạn có thể thiết kế pipeline xử lý dữ liệu phù hợp hơn cho từng dự án và khai thác hiệu quả các tập dữ liệu nhiều chiều.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày