Attention Mechanism là gì? Vai trò của Attention trong công nghệ Deep Learning và xử lý ngôn ngữ tự nhiên

Đã kiểm duyệt nội dung

Đánh giá

Attention Mechanism là một kỹ thuật trong Deep Learning cho phép mô hình AI phân bổ sự tập trung khác nhau vào các phần dữ liệu đầu vào khi xử lý một tác vụ. Dựa trên quá trình trực tiếp hỗ trợ vận hành hệ thống cho hàng nghìn khách hàng tại Vietnix, trong bài viết dưới đây, mình sẽ cùng bạn tìm hiểu chi tiết về nguyên lý hoạt động, vai trò và các ứng dụng phổ biến nhất của Attention Mechanism.

Những điểm chính

- Quan điểm của mình: Sự ra đời của Attention Mechanism đã giải quyết triệt để giới hạn ghi nhớ của các mô hình Deep Learning truyền thống. Qua thực tế hỗ trợ vận hành hạ tầng cho nhiều khách hàng tại Vietnix, mình nhận thấy cơ chế này tuy thông minh nhưng đòi hỏi năng lực tính toán phần cứng rất lớn. Để xử lý các ma trận trọng số phức tạp mà không bị nghẽn cổ chai, hệ thống cần một hạ tầng máy chủ có băng thông bộ nhớ cao và độ trễ cực thấp. Vì vậy, hiệu quả của Attention Mechanism không chỉ nằm ở thuật toán mà còn phụ thuộc vào sự phối hợp nhịp nhàng với tài nguyên máy chủ vật lý.

- Khái niệm: Hiểu rõ kỹ thuật Attention Mechanism cho phép mô hình AI tập trung vào thông tin quan trọng nhất để xử lý dữ liệu chính xác và hiệu quả hơn.

- Bối cảnh ra đời: Biết được cách cơ chế Attention Mechanism giải quyết được các hạn chế về nút thắt cổ chai và mất dữ liệu trên câu dài của các kiến trúc RNN truyền thống.

- Nguyên lý vận hành: Nắm vững quy trình tính toán thông qua bộ ba vectơ Query, Key, Value để xác định mối liên hệ logic giữa các phần tử dữ liệu.

- Phân loại biến thể: Phân biệt rõ các dạng Self-Attention, Cross-Attention, Soft và Hard Attention để lựa chọn phương thức tiếp cận phù hợp cho từng tác vụ.

- Tối ưu hiệu năng: Biết cách ứng dụng Flash Attention và FlexAttention để tăng tốc độ xử lý và tiết kiệm bộ nhớ khi làm việc với các chuỗi dữ liệu cực dài.

- Ứng dụng thực tế: Khám phá vai trò của Attention trong các mô hình ngôn ngữ lớn như GPT, BERT,… nhận diện hình ảnh và nghiên cứu y sinh hiện đại.

- Giới thiệu: Biết thêm Vietnix là nhà cung cấp hạ tầng máy chủ uy tín, chất lượng, nền tảng vững chắc cho các ứng dụng trí tuệ nhân tạo.

- Câu hỏi thường gặp: Giải đáp các thắc mắc liên quan đến Attention Mechanism.

Attention Mechanism là gì?

Attention Mechanism là một kỹ thuật tiên tiến trong lĩnh vực Machine Learning, được thiết kế để cho phép các mô hình Deep Learning có khả năng tập trung có chọn lọc vào những phần dữ liệu quan trọng nhất trong đầu vào, thay vì xử lý toàn bộ thông tin với mức độ ưu tiên như nhau. Đây là nền tảng cốt lõi đã tạo nên sự thành công của kiến trúc Transformer và các mô hình ngôn ngữ lớn hiện đại như GPT hay BERT.

Về mặt toán học, đây là một hàm ánh xạ dựa trên sự tương tác giữa ba thành phần: Query (Truy vấn), Key (Khóa) và Value (Giá trị). Khác với các trọng số cứng cố định trong các mạng nơ-ron truyền thống, các trọng số trong cơ chế Attention là trọng số mềm, có khả năng thay đổi liên tục và linh hoạt theo từng bước xử lý dữ liệu. Điều này giúp website tích hợp AI hoặc các ứng dụng dịch thuật có thể hiểu được từ nào trong câu đầu vào đang có ảnh hưởng lớn nhất đến từ sắp được tạo ra ở đầu ra.

Việc tính toán các trọng số mềm và ma trận Query, Key, Value trong cơ chế Attention đòi hỏi năng lực xử lý song song cực lớn cùng băng thông bộ nhớ vượt trội. Để đáp ứng yêu cầu khắt khe này của các mô hình Deep Learning hiện đại, Vietnix cung cấp dòng VPS OpenClaw – giải pháp hạ tầng chuyên dụng cho kỷ nguyên AI. Với cấu hình mạnh mẽ và khả năng tối ưu hóa tài nguyên, VPS OpenClaw đảm bảo các phép toán ma trận phức tạp của Attention Mechanism diễn ra ổn định, giảm thiểu độ trễ và tăng tốc độ phản hồi cho các ứng dụng AI của doanh nghiệp.

Bối cảnh ra đời của Attention Mechanism

Trước khi có sự xuất hiện của Attention, các mô hình ngôn ngữ dựa trên kiến trúc cũ thường gặp khó khăn khi đối mặt với dữ liệu có độ dài lớn.

1. Những giới hạn của mạng nơ-ron hồi quy và Seq2Seq

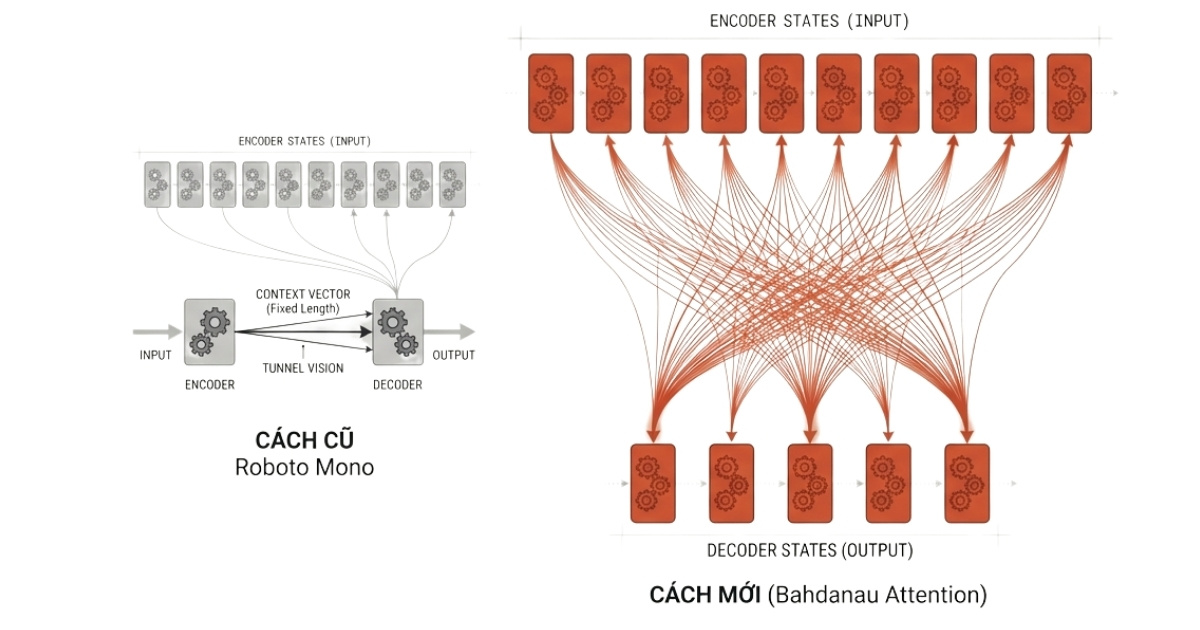

Trước năm 2014, các hệ thống dịch máy tự động chủ yếu dựa trên kiến trúc Seq2Seq với hai thành phần chính là Encoder và Decoder. Cấu trúc này thường sử dụng các mạng nơ-ron hồi quy như RNN hoặc LSTM. Tuy nhiên, kiến trúc này bộc lộ ba điểm yếu cốt lõi:

- Nút thắt cổ chai thông tin:

Encodercó nhiệm vụ nén toàn bộ thông tin của một câu đầu vào thành một vector duy nhất có độ dài cố định, gọi là vector ngữ cảnh. Việc cố gắng nén quá nhiều thông tin vào một không gian hạn hẹp dẫn đến tình trạng mất dữ liệu đối với các câu dài. - Vấn đề bộ nhớ ngắn hạn: Các mạng

RNNhoạt động theo cơ chế tuần tự, nghĩa là thông tin được truyền từ bước này sang bước sau. Điều này khiến mô hình thường có xu hướng quên các thông tin ở đầu chuỗi khi câu quá dài. - Thách thức trong huấn luyện: Các mạng

RNNthường khó đào tạo do hiện tượng biến mất đạo hàm. Khi chuỗi dữ liệu quá dài, các tín hiệu cập nhật trọng số sẽ trở nên cực kỳ nhỏ.

2. Sự xuất hiện của giải pháp Attention Mechanism

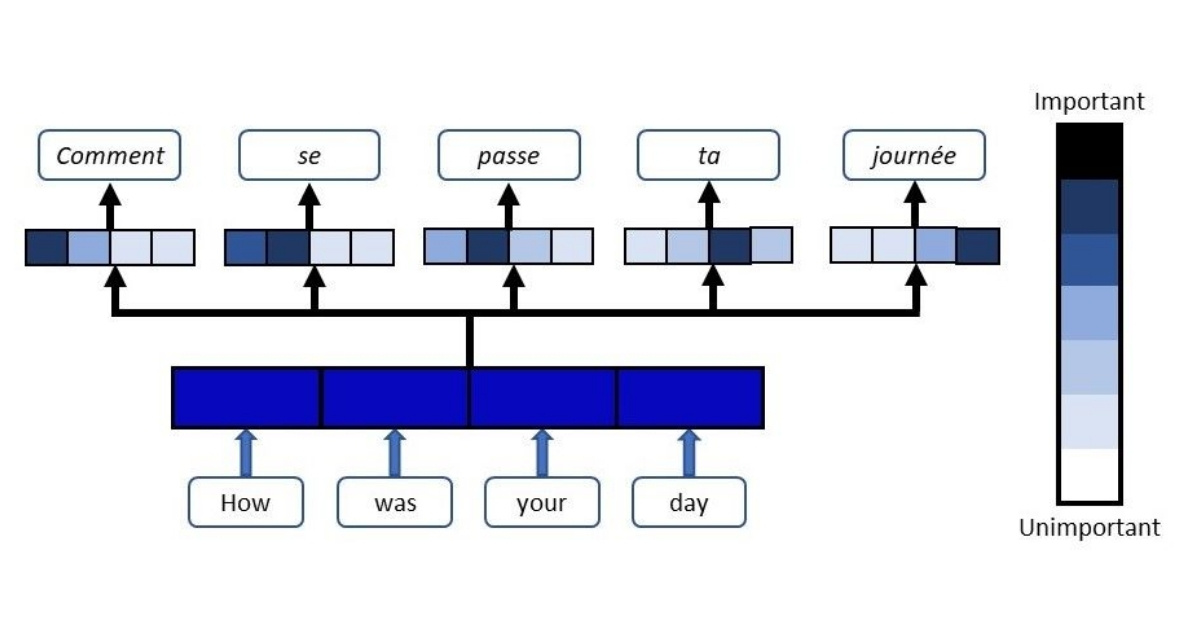

Để giải quyết triệt để những vấn đề này, năm 2014, nhóm nghiên cứu của Bahdanau đã giới thiệu một kỹ thuật đột phá. Thay vì chỉ sử dụng duy nhất một vector nén cuối cùng, cơ chế này cho phép Decoder duy trì kết nối với tất cả các trạng thái ẩn (Hidden States) của Encoder trong suốt quá trình tạo đầu ra.

Tại mỗi bước tạo từ mới, Decoder thực hiện các phép toán để đánh giá mức độ liên quan của từng từ trong câu đầu vào. Nhờ đó, hệ thống tự động xác định được trọng tâm dữ liệu cần xử lý tại từng thời điểm, loại bỏ hoàn toàn tình trạng nút thắt cổ chai truyền thống.

Nguyên lý vận hành của Attention Mechanism

Sự ra đời của bộ ba vectơ Query (Q), Key (K) và Value (V) đã chuẩn hóa cơ chế Attention, giúp cụ thể hóa cách thức các thực thể thông tin tương tác với nhau. Quy trình tính toán để chuyển hóa các vectơ này diễn ra qua ba giai đoạn:

- Bước 1 – Tính điểm căn chỉnh (Alignment Score): Hệ thống xác định mức độ tương đồng giữa Query (thông tin đang cần xử lý) và các Key (thông tin mô tả dữ liệu đầu vào). Phép toán tích vô hướng (Dot Product) thường được sử dụng để đo lường độ khớp giữa các vectơ. Điểm số cao cho thấy từ đầu vào đó mang ý nghĩa quan trọng đối với ngữ cảnh hiện tại.

- Bước 2 – Chuẩn hóa trọng số (Scaling & Softmax): Các điểm số thô được đưa qua hàm Softmax để chuyển đổi thành phân phối xác suất từ 0 đến 1, với tổng trọng số bằng 1. Kết quả này chính là “trọng số chú ý”, xác định tỷ lệ phần trăm sự tập trung mà mô hình dành cho mỗi phần dữ liệu đầu vào.

- Bước 3 – Tổng hợp thông tin (Weighted Sum): Hệ thống nhân các trọng số chú ý với các vectơ Value (giá trị thực tế của thông tin) tương ứng và cộng gộp lại. Kết quả thu được là một vectơ ngữ cảnh (Context Vector) chứa đựng những thông tin quan trọng nhất để phục vụ cho các bước xử lý tiếp theo.

Phân loại các biến thể phổ biến của Attention Mechanism

Việc phân loại các biến thể này thường dựa trên ba tiêu chí chính gồm: Phương thức tính toán điểm số, phạm vi dữ liệu và mức độ tập trung của mô hình:

1. Phân loại theo cách tính điểm tương đồng

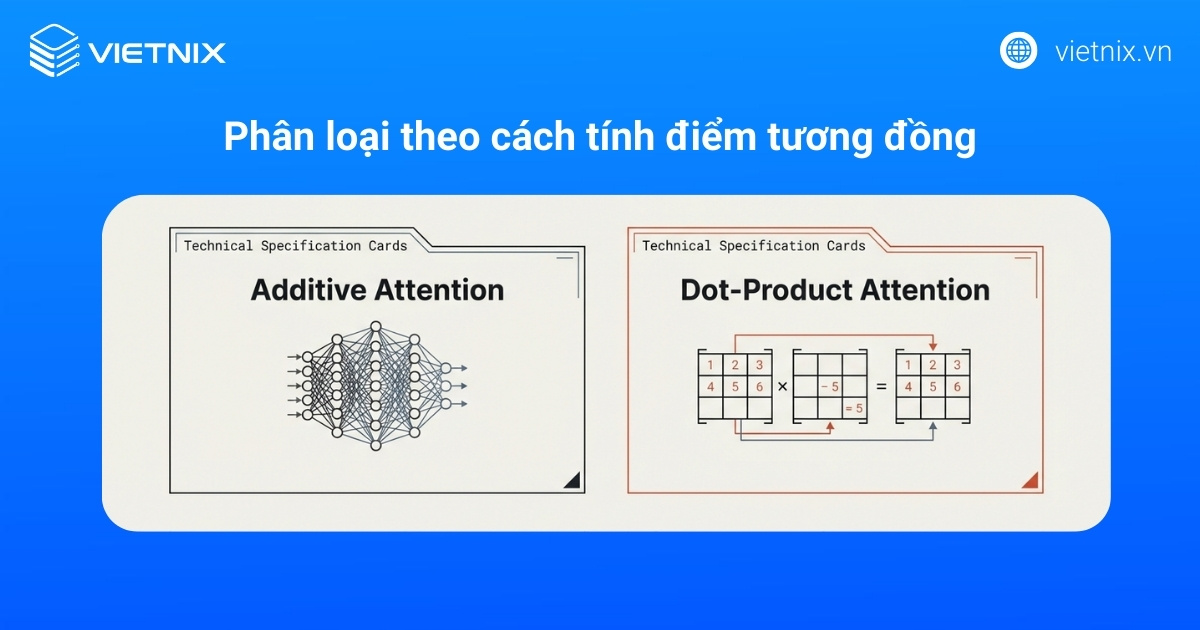

Đây là cách phân loại dựa trên phép toán được sử dụng để xác định mối quan hệ giữa các vectơ Query và Key:

- Additive Attention: Đây là phiên bản sử dụng một mạng nơ-ron truyền thẳng kết hợp với hàm kích hoạt để tính toán điểm số. Ưu điểm của phương pháp này là linh hoạt, có khả năng xử lý tốt ngay cả khi kích thước của các vectơ Query và Key không đồng nhất.

- Dot-Product Attention: Biến thể này thay thế mạng nơ-ron phức tạp bằng phép nhân vô hướng giữa các vectơ. Nhờ cấu trúc toán học đơn giản hơn, Dot-Product Attention mang lại tốc độ xử lý nhanh vượt trội và tiết kiệm đáng kể tài nguyên tính toán. Đây là nền tảng quan trọng giúp website tích hợp AI có thể phản hồi người dùng gần như tức thì.

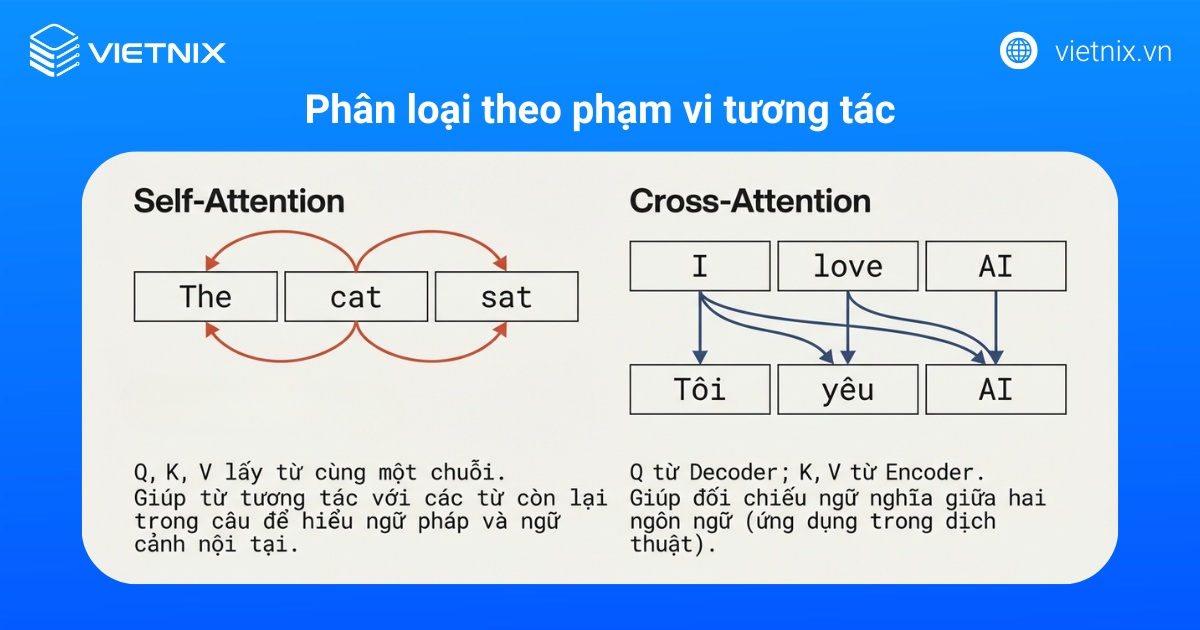

2. Phân loại theo phạm vi tương tác của dữ liệu

Tiêu chí này xác định nguồn gốc của các vectơ Query, Key và Value trong quá trình xử lý:

- Cross-Attention: Trong biến thể này, các vectơ đến từ hai nguồn dữ liệu khác nhau. Ví dụ điển hình nhất là trong các hệ thống dịch thuật, Query thường đến từ phía Decoder, trong khi Key và Value đến từ phía Encoder. Sự tương tác này giúp mô hình đối chiếu chính xác ngữ nghĩa giữa hai ngôn ngữ.

- Self-Attention: Tại đây, Query, Key và Value đều được trích xuất từ cùng một chuỗi đầu vào duy nhất. Cơ chế này cho phép mỗi từ trong câu tự tương tác với tất cả các từ còn lại, giúp mô hình hiểu sâu sắc các mối quan hệ ngữ pháp và ngữ cảnh phức tạp trong cùng một câu văn.

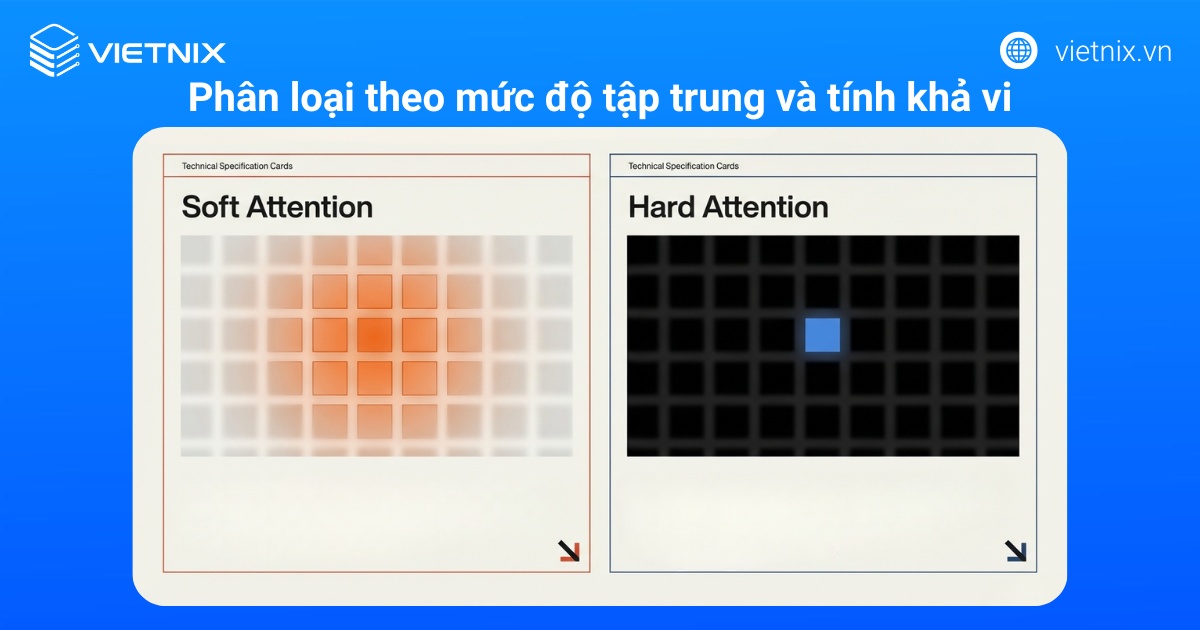

3. Phân loại theo mức độ tập trung và tính khả vi

Dựa trên cách thức mô hình lựa chọn các vùng thông tin để chú ý, chúng ta có hai hướng tiếp cận chính:

- Soft Attention: Mô hình sẽ tính toán trọng số trên toàn bộ chuỗi đầu vào. Đây là phương pháp phổ biến nhất vì có tính khả vi, cho phép hệ thống học hỏi và cập nhật thông tin dễ dàng thông qua quá trình lan truyền ngược.

- Hard Attention: Thay vì nhìn vào toàn bộ chuỗi, Hard Attention chỉ tập trung vào một vùng cục bộ duy nhất hoặc chọn mẫu ngẫu nhiên tại một thời điểm. Mặc dù giúp tiết kiệm tài nguyên tính toán trong một số trường hợp, nhưng Hard Attention không có tính khả vi, đòi hỏi các kỹ thuật học tăng cường phức tạp để huấn luyện, do đó ít phổ biến hơn trong các ứng dụng thương mại thông thường.

Cách tối ưu bộ nhớ và tốc độ xử lý khi sử dụng Attention Mechanism

Hạn chế lớn nhất của cơ chế Attention truyền thống là độ phức tạp trong việc tính toán tăng theo bình phương độ dài của chuỗi đầu vào. Để cải thiện, bạn tham khảo các giải pháp sau:

- Flash Attention: Đây là một kỹ thuật đột phá giúp tối ưu hóa việc đọc/ghi dữ liệu trên bộ nhớ GPU. Bằng cách chia nhỏ các ma trận attention lớn thành các khối dữ liệu nhỏ hơn để xử lý tuần tự, Flash Attention giúp giảm đáng kể nhu cầu lưu trữ trung gian. Kết quả là mô hình có thể xử lý các đoạn văn bản dài hơn gấp nhiều lần mà vẫn duy trì tốc độ cực nhanh.

- FlexAttention: Kỹ thuật này cho phép các lập trình viên can thiệp và sửa đổi linh hoạt các điểm số attention trước khi đưa qua hàm Softmax. Sự linh hoạt này giúp tinh chỉnh khả năng tập trung của mô hình cho các tác vụ đặc thù, giúp website tích hợp AI hoạt động thông minh và nhạy bén hơn với các yêu cầu phức tạp từ người dùng.

- Sparse Attention: Thay vì tính toán sự liên kết giữa tất cả các từ, kỹ thuật này chỉ tập trung vào một số vị trí quan trọng hoặc lân cận. Điều này giúp giảm đáng kể số lượng phép tính ma trận mà vẫn giữ được độ chính xác cần thiết cho mô hình.

Ứng dụng của Attention Mechanism

Khả năng chắt lọc thông tin chọn lọc đã giúp cơ chế Attention vượt ra ngoài phạm vi của ngôn ngữ để thống trị nhiều lĩnh vực công nghệ khác:

- Xử lý ngôn ngữ tự nhiên: Attention là nền tảng cốt lõi tạo nên các mô hình ngôn ngữ lớn như BERT, GPT-4 hay T5. Những mô hình này giúp cải thiện chất lượng của dịch máy, chatbot thông minh, tóm tắt văn bản và phân tích cảm xúc khách hàng.

- Thị giác máy tính: Thông qua kiến trúc Vision Transformers, cơ chế Attention đã được áp dụng hiệu quả cho hình ảnh. Thay vì nhìn vào từng pixel, mô hình chia ảnh thành các mảng và sử dụng sự chú ý để hiểu mối quan hệ giữa các bộ phận trong ảnh, giúp nhận diện vật thể và phân đoạn hình ảnh với độ chính xác vượt trội.

- Sinh học và Y tế: Một trong những ứng dụng hữu ích nhất của Attention chính là mô hình AlphaFold của Google DeepMind. Bằng cách sử dụng sự chú ý để hiểu các tương tác giữa các axit amin, AlphaFold đã giải quyết được bài toán dự đoán cấu trúc protein kéo dài 50 năm, mở ra kỷ nguyên mới cho nghiên cứu vắc xin, thuốc và điều trị bệnh.

- AI tạo sinh: Cơ chế Attention (đặc biệt là Cross-Attention) đóng vai trò điều hướng trong các mô hình khuếch tán (diffusion models) như Stable Diffusion hay Midjourney, giúp chuyển đổi các yêu cầu văn bản thành hình ảnh và âm thanh chất lượng cao bằng cách duy trì sự nhất quán giữa mô tả chi tiết và kết quả hiển thị. Sự phối hợp nhịp nhàng giữa ngữ cảnh và chi tiết giúp các tác phẩm do AI tạo ra ngày càng sống động và tự nhiên.

Vietnix – Giải pháp hạ tầng tối ưu cho kỷ nguyên trí tuệ nhân tạo

Để hiện thực hóa các mô hình AI phức tạp dựa trên cơ chế Attention, doanh nghiệp cần một nền tảng hạ tầng có năng lực tính toán và tốc độ truy xuất dữ liệu ở mức cao nhất. Vietnix mang đến các giải pháp cho thuê máy chủ ảo chuyên dụng với hiệu năng vượt trội, được thiết kế để đáp ứng mọi yêu cầu khắt khe của kỷ nguyên trí tuệ nhân tạo.

Hệ thống VPS tại Vietnix sử dụng các bộ vi xử lý thế hệ mới cùng công nghệ lưu trữ NVMe tốc độ cao, giúp đảm bảo sự ổn định cho các phép toán ma trận phức tạp và rút ngắn tối đa thời gian huấn luyện mô hình. Với sự đồng hành 24/7 của đội ngũ chuyên gia kỹ thuật, Vietnix cung cấp một hệ sinh thái hạ tầng vững chắc, giúp doanh nghiệp hoàn toàn yên tâm bứt phá và khẳng định vị thế dẫn đầu trong cuộc đua công nghệ.

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

Tại sao cơ chế Attention lại giúp AI xử lý văn bản dài tốt hơn RNN?

Trong các mô hình cũ như RNN, thông tin từ đầu câu phải đi qua rất nhiều bước trung gian để tới được cuối câu, dẫn đến việc thông tin có thể bị pha loãng hoặc mất. Khi đó, cơ chế Attention giải quyết hiệu quả vấn đề, cho phép mô hình truy cập chính xác dữ liệu cần thiết mà không phụ thuộc vào khoảng cách giữa các từ.

Sự khác biệt lớn nhất giữa Self-Attention và Cross-Attention là gì?

Sự khác biệt lớn nhất nằm ở nguồn của Query, Key, Value:

- Với Self-Attention: Query, Key và Value đều được lấy từ cùng một chuỗi, giúp mô hình học quan hệ nội tại giữa các phần tử trong chính chuỗi đó.

– Với Cross-Attention: Query đến từ một chuỗi, còn Key và Value đến từ một chuỗi khác. Điều này giúp mô hình canh hàng và liên kết thông tin giữa hai chuỗi khác nhau, ví dụ giữa câu nguồn và câu đích trong dịch máy.

Triển khai các mô hình Attention cần cấu hình máy chủ như thế nào?

Cơ chế Attention thực hiện song song khối lượng khổng lồ các phép tính ma trận, đòi hỏi năng lực xử lý vượt trội từ phần cứng. Để vận hành ổn định, doanh nghiệp nên ưu tiên sử dụng các dòng VPS có dung lượng RAM lớn, băng thông bộ nhớ cao và ổ cứng NVMe tốc độ cao. Những yếu tố này giúp giảm thiểu tối đa độ trễ khi nạp dữ liệu và đảm bảo các trọng số Attention được tính toán tức thì.

Cơ chế Attention có thể ứng dụng cho website doanh nghiệp không?

Hoàn toàn có thể. Đây là nền tảng của chatbot thông minh, tìm kiếm ngữ nghĩa và tóm tắt tài liệu tự động, giúp website phản hồi tự nhiên và hiểu đúng ý định người dùng.

Tổng kết lại, Attention Mechanism đóng vai trò nền tảng trong sự phát triển của trí tuệ nhân tạo hiện đại nhờ khả năng mô phỏng tính tập trung chọn lọc của con người trên các tập dữ liệu phức tạp. Giải pháp kỹ thuật này giúp khắc phục hoàn toàn những khó khăn về khả năng xử lý ngữ cảnh của các kiến trúc truyền thống, đồng thời mở ra kỷ nguyên mới cho các mô hình ngôn ngữ lớn và website tích hợp AI thông minh. Việc nắm vững nguyên lý vận hành cũng như các phương pháp tối ưu hóa bộ nhớ sẽ giúp các nhà phát triển xây dựng những ứng dụng đột phá với tốc độ phản hồi ấn tượng.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày