Groq là gì? Công nghệ cốt lõi và kiến trúc của Groq

Đã kiểm duyệt nội dung

Đánh giá

Groq là nền tảng hạ tầng suy luận AI/LLM tập trung vào tốc độ, độ trễ thấp và hành vi thực thi ổn định, dựa trên kiến trúc LPU (Language Processing Unit) chuyên dụng cho inference. Trong bài viết này, mình sẽ cùng bạn tìm hiểu cách kiến trúc LPU hoạt động, cách GroqCloud vận hành, Groq đang hỗ trợ những mô hình nào và khi nào nên cân nhắc dùng Groq cho hệ thống AI/LLM của bạn.

Những điểm chính

- Khái niệm: Hiểu rõ Groq là nền tảng hạ tầng suy luận AI sử dụng chip LPU chuyên dụng, giúp tăng tốc độ xử lý và giảm độ trễ cho các mô hình ngôn ngữ lớn (LLM).

- Lịch sử phát triển: Biết được quá trình hình thành từ nhóm kỹ sư Google, các thương vụ mua lại chiến lược và lộ trình mở rộng toàn cầu, khẳng định vị thế vững chắc của Groq trong ngành AI.

- Công nghệ cốt lõi: Tìm hiểu sâu về kiến trúc LPU, thiết kế phần cứng GroqChip tối ưu cho suy luận và nền tảng GroqCloud cung cấp sức mạnh tính toán dưới dạng dịch vụ API dễ tiếp cận.

- Kiến trúc Groq LPU: Nắm vững các đặc điểm kỹ thuật như thiết kế software-first, lập lịch tĩnh và sử dụng SRAM băng thông cao, giúp hệ thống đạt hiệu năng ổn định và dự đoán chính xác.

- Ưu nhược điểm: Cân nhắc kỹ lưỡng giữa tốc độ suy luận vượt trội, chi phí thấp và danh sách model hỗ trợ còn hạn chế để đưa ra quyết định đầu tư phù hợp.

- Mô hình hỗ trợ: Cập nhật danh sách các model AI phổ biến chạy trên Groq như Llama 3, Mixtral, Gemma và khả năng tương thích cao với API của OpenAI, giúp chuyển đổi hệ thống linh hoạt.

- Ứng dụng thực tế: Nhận diện các trường hợp sử dụng tối ưu như chatbot thời gian thực, trợ lý giọng nói và phân tích dữ liệu nhanh, giúp doanh nghiệp khai thác tối đa lợi thế tốc độ của Groq.

- Giới thiệu Vietnix: Vietnix cung cấp hạ tầng VPS hiệu năng cao, là môi trường lý tưởng để triển khai các ứng dụng kết nối với Groq API, đảm bảo độ trễ thấp và tính ổn định cho hệ thống AI.

- Câu hỏi thường gặp: Được giải đáp các thắc mắc liên quan đến Groq.

Groq là gì?

Groq là một công ty trí tuệ nhân tạo của Mỹ tập trung vào mảng AI inference (chạy mô hình đã huấn luyện trong môi trường thực tế) với mục tiêu cung cấp hạ tầng suy luận tốc độ cao, chi phí thấp và dễ dự đoán. Công ty này tự thiết kế vi mạch chuyên dụng ASIC (Application-specific integrated circuit) gọi là LPU (Language Processing Unit) để tăng tốc xử lý các mô hình lớn như LLM, phân loại hình ảnh, phân tích dự đoán, kèm theo nền tảng GroqCloud cho phép truy cập hạ tầng LPU qua API.

Khác với GPU đa dụng, LPU của Groq được xây dựng xoay quanh tính chất deterministic (thực thi có thể dự đoán chính xác) và luồng tensor tuyến tính, giúp giảm độ trễ, tăng throughput và tối ưu năng lượng cho workload suy luận, đặc biệt với mô hình ngôn ngữ lớn. Groq định vị mình như một lớp hạ tầng suy luận AI chuyên dụng, nơi developer có thể chạy LLM và các mô hình sinh nội dung theo kiểu “AI inference as a service” trên phần cứng LPU thay vì tự quản lý cụm GPU truyền thống.

Để tận dụng triệt để tốc độ suy luận đáng kinh ngạc từ Groq, ứng dụng của bạn cũng cần một nền tảng đủ mạnh để không trở thành nút thắt cổ chai. Việc triển khai trên một gói VPS NVMe hiệu năng cao từ Vietnix sẽ đảm bảo ứng dụng của bạn có tốc độ xử lý và truy xuất dữ liệu tương xứng, mang lại trải nghiệm AI real-time mượt mà nhất.

Lịch sử hình thành và phát triển Groq

Groq được thành lập năm 2016 bởi nhóm cựu kỹ sư Google do Jonathan Ross dẫn dắt, người từng tham gia thiết kế Google TPU. Giai đoạn đầu, công ty tập trung xây dựng kiến trúc tăng tốc suy luận dựa trên ASIC và mô hình xử lý luồng dữ liệu chuyên dụng cho AI.

- 03/2022 – Mua lại Maxeler Technologies: Groq mua lại Maxeler Technologies để tận dụng kinh nghiệm và công nghệ dataflow computing, củng cố nền tảng phần cứng cho LPU.

- 08/2023 – Hợp tác sản xuất chip 4nm: Groq chọn Samsung Foundry tại Texas để sản xuất thế hệ chip 4nm, nhằm nâng hiệu năng và mật độ tích hợp cho các thế hệ LPU tiếp theo.

- 2024 – Ra mắt GroqCloud và mở rộng mảng doanh nghiệp: Công ty giới thiệu GroqCloud để cung cấp hạ tầng LPU qua API cho developer, đồng thời mua lại Definitive Intelligence nhằm tăng năng lực giải pháp dữ liệu và analytics cho khách hàng doanh nghiệp.

- 2025 – Mở rộng hạ tầng toàn cầu: Groq công bố kế hoạch triển khai thêm nhiều cụm hạ tầng suy luận AI và nhận cam kết đầu tư lớn từ các quỹ và đối tác Trung Đông để phát triển trung tâm dữ liệu tại khu vực này.

Công nghệ của Groq

LPU (Language Processing Unit)

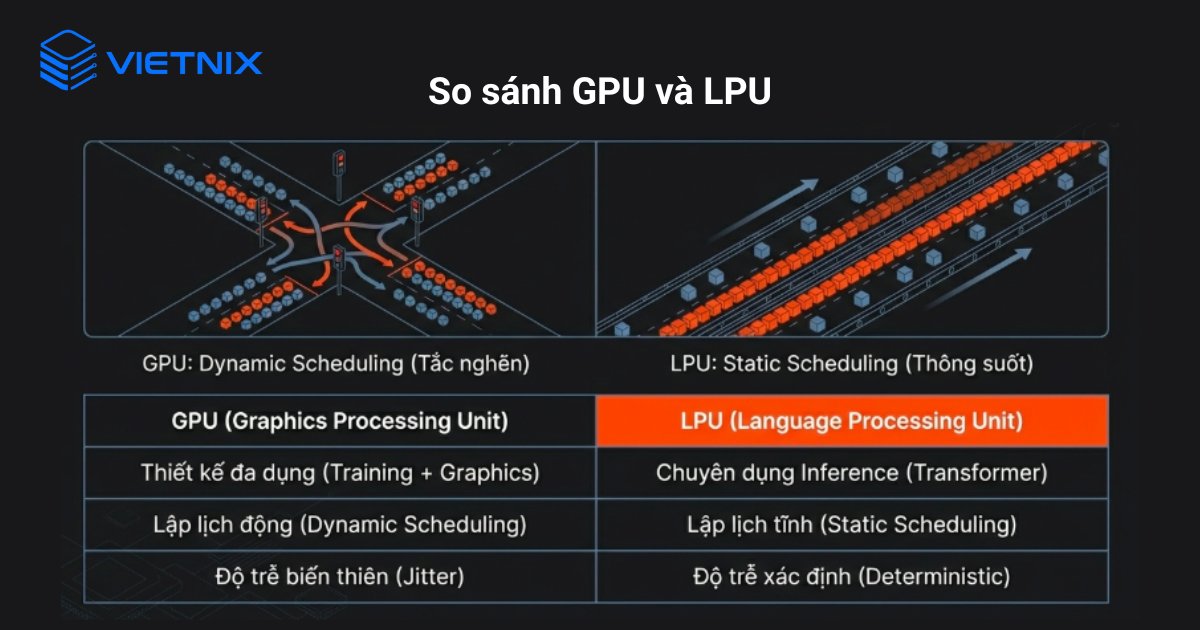

LPU là kiến trúc chip chuyên dụng cho suy luận AI, tối ưu cho các workload dựa trên transformer như LLM, embedding, vision, speech. So với GPU (thiết kế đa dụng, phục vụ đồ hoạ và training song song) hay TPU (tối ưu training/inference nói chung), LPU tập trung vào suy luận tuyến tính cho mô hình ngôn ngữ với mục tiêu tốc độ cao, độ trễ thấp và hiệu năng ổn định.

LPU sử dụng mô hình thực thi deterministic và lập lịch tĩnh, cho phép compiler sắp xếp luồng dữ liệu và lệnh cố định trên nhiều chip, thay vì phụ thuộc lịch động như trên GPU. Nhờ đó, hệ thống giảm biến thiên độ trễ, tăng throughput và thuận lợi khi mở rộng quy mô phục vụ LLM cho nhiều người dùng.

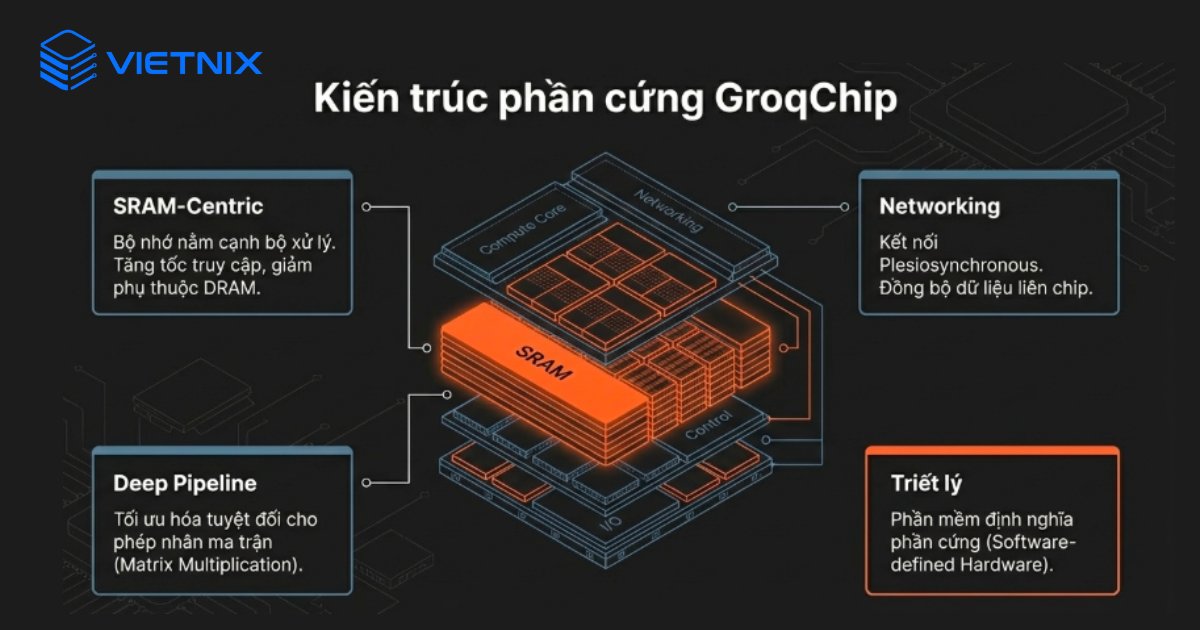

GroqChip và kiến trúc phần cứng bên dưới

GroqChip là chip nền để xây dựng LPU, được thiết kế theo hướng software-first: nhóm thiết kế xuất phát từ nhu cầu của compiler và toán học linear algebra trong mô hình AI, sau đó mới ánh xạ xuống phần cứng. Nhiều logic điều khiển phức tạp được đưa lên tầng phần mềm, giúp phần cứng giữ cấu trúc đều, dễ lập lịch tĩnh và dễ kiểm định.

Một số đặc điểm kỹ thuật nổi bật:

- Pipeline sâu, vector rộng: Tập trung vào phép toán vector/matrix cho transformer, giúp đạt throughput cao với khối lượng nhân ma trận lớn.

- Thiết kế ưu tiên SRAM: Bố trí SRAM dung lượng lớn gần cụm tính toán để truy cập trọng số nhanh, giảm phụ thuộc DRAM và giảm độ trễ bộ nhớ.

- Kết nối liên chip có tính quyết định: Hệ thống networking plesiosynchronous đồng bộ nhiều LPU như một không gian thực thi thống nhất, giúp compiler dự đoán chính xác thời điểm dữ liệu di chuyển giữa các chip.

GroqCloud: Hạ tầng LPU dưới dạng dịch vụ

GroqCloud là nền tảng đám mây cung cấp hạ tầng LPU thông qua API và dashboard, cho phép nhà phát triển sử dụng LLM và các mô hình khác mà không cần tự triển khai phần cứng. Nền tảng hỗ trợ các workload phổ biến như chat LLM, text completion, embedding, speech-to-text, image/vision, tuỳ theo danh mục model được cung cấp ở từng thời điểm.

GroqCloud được định hướng cung cấp “fast, low-latency inference” với time-to-first-token thấp, throughput cao và chi phí trên mỗi đơn vị token ở mức cạnh tranh, đồng thời giữ hiệu năng ổn định khi mở rộng số lượng yêu cầu. Cách tiếp cận này cho phép đội ngũ phát triển tích hợp API và tập trung vào ứng dụng, trong khi hạ tầng suy luận ở tầng dưới do LPU đảm nhận.

Kiến trúc Groq LPU

Kiến trúc Groq LPU xoay quanh mục tiêu suy luận nhanh, độ trễ ổn định và khả năng mở rộng tuyến tính, dựa trên cách Groq ưu tiên thiết kế từ lớp phần mềm xuống phần cứng.

- Thiết kế software‑first và static scheduling: Compiler của Groq điều khiển chi tiết luồng dữ liệu và lịch thực thi trên LPU, thay cho cơ chế lập lịch động phức tạp thường thấy trên GPU.

- Static scheduling và tính determinism: Lịch thực thi được cố định trước, giúp suy luận deterministic, độ trễ và throughput dễ dự đoán, phù hợp hệ thống cần SLA rõ ràng.

- SRAM‑centric và băng thông bộ nhớ cao: LPU sử dụng nhiều SRAM on‑chip băng thông cao để lưu trọng số và kích hoạt gần cụm tính toán, giảm nhu cầu truy cập DRAM/HBM trong nhiều kịch bản suy luận.

- Tác động đến tốc độ token và mô hình lớn: Bố trí bộ nhớ này giúp tăng tốc độ sinh token, trong khi các mô hình rất lớn sẽ cần sharding hợp lý trên nhiều LPU để tận dụng tổng tài nguyên bộ nhớ.

- Streaming tensor và pipeline kiểu assembly line: Kiến trúc LPU hỗ trợ tensor streaming liên tục qua các khối tính toán trên chip và giữa các chip, hạn chế thời gian chờ I/O trung gian.

- Pipeline liên tục, hạn chế nghẽn cổ chai: Các stage trong pipeline được tổ chức để mô hình luôn có dữ liệu, giảm idle time tại những bước nặng như attention hoặc phép nhân ma trận lớn.

- Mở rộng nhiều chip với RealScale: RealScale mô tả cách nhiều LPU vận hành như một thực thể logic thống nhất, được đồng bộ bằng mạng plesiosynchronous có tính quyết định cao.

- So sánh với cụm GPU truyền thống: Thay vì phụ thuộc nhiều vào lập lịch động và kết nối phân tán trong cụm GPU, RealScale cho phép compiler nhìn cụm LPU như một không gian tài nguyên phẳng để tối ưu luồng dữ liệu và giảm overhead đồng bộ.

Ưu điểm và hạn chế của Groq

Latency thấp, throughput cao: Kiến trúc LPU và lập lịch tĩnh giúp Groq đạt thời gian phản hồi ngắn và tốc độ sinh token cao cho ứng dụng thời gian thực và batch lớn.

Hành vi suy luận deterministic: Cơ chế thực thi deterministic giúp độ trễ và throughput ổn định, thuận tiện đặt và kiểm soát SLA.

Thiết kế chuyên cho inference: LPU được tối ưu riêng cho suy luận LLM, giảm overhead không cần thiết và đơn giản hóa việc tối ưu pipeline inference.

Hiệu quả chi phí với khối lượng lớn: Với workload nhiều request và token, Groq thường có tokens per watt và chi phí trên mỗi triệu token cạnh tranh so với cụm GPU.

Giới hạn dung lượng bộ nhớ mỗi chip: SRAM on‑chip có dung lượng hạn chế, buộc phải sharding mô hình lớn trên nhiều LPU và tăng độ phức tạp triển khai.

Yêu cầu kỹ năng về sharding và hạ tầng: Đội ngũ cần hiểu cách chia trọng số, KV cache và activation trên nhiều LPU để khai thác tốt mô hình hàng chục tỷ tham số.

Hệ sinh thái và tooling còn nhỏ: So với hệ sinh thái GPU/CUDA, công cụ chuyên dụng và cộng đồng quanh Groq vẫn ít hơn.

Tập trung vào inference, ít hỗ trợ training: Groq hiện chủ yếu phục vụ inference as a service, chưa phù hợp cho bài toán huấn luyện hoặc fine‑tune trực tiếp trên LPU.

Groq trong hệ sinh thái công cụ AI và LLM

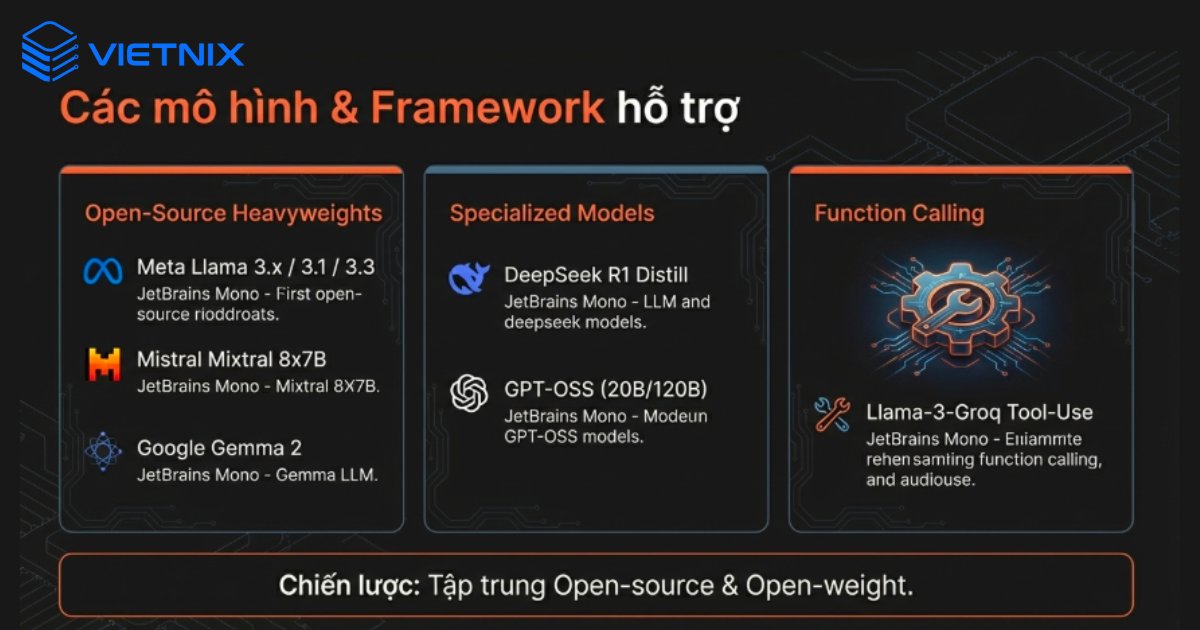

Các mô hình và framework Groq đang hỗ trợ

- Nhóm mô hình LLM chính: GroqCloud hỗ trợ các model Llama 3.x/3.1/3.3/Guard, Llama 4, Mixtral 8x7B, Gemma 2, DeepSeek R1 Distill, cùng các model GPT‑OSS 20B/120B và biến thể Llama‑3‑Groq Tool‑Use chuyên cho function calling.

- Khả năng tương thích API: Groq API được thiết kế tương thích phần lớn với OpenAI client, chỉ cần đổi base_url sang https://api.groq.com/openai/v1 và dùng GROQ_API_KEY là có thể tái sử dụng thư viện OpenAI chính thức.

- SDK và tích hợp hệ sinh thái: Groq cung cấp SDK Python và TypeScript, đồng thời đã được tích hợp trong các công cụ như TypingMind, Otoroshi LLM Gateway, nhiều app so sánh LLM giúp chuyển đổi model chạy trên Groq qua cấu hình endpoint.

Tích hợp Groq với Voiceflow và nền tảng xây chatbot

Groq được sử dụng làm provider inference để tăng tốc phản hồi cho chatbot voice và web, đặc biệt trong các kịch bản cần xử lý nhiều lượt hội thoại liên tiếp. Voiceflow cho phép cấu hình Groq trực tiếp trong mục Integrations, kết nối dự án với Groq thông qua API key và một số tham số cơ bản.

Trong luồng hội thoại, developer chỉ định Groq làm nguồn model cho các bước AI trong flow, sau đó mọi request từ bot sẽ được gửi tới API Groq dựa trên endpoint đã cấu hình. Cách làm này giúp đội sản phẩm tận dụng tốc độ của LPU cho trải nghiệm chat thời gian thực, trong khi vẫn thiết kế kịch bản hội thoại bằng giao diện kéo‑thả quen thuộc của Voiceflow.

Trường hợp sử dụng Groq trong thực tế

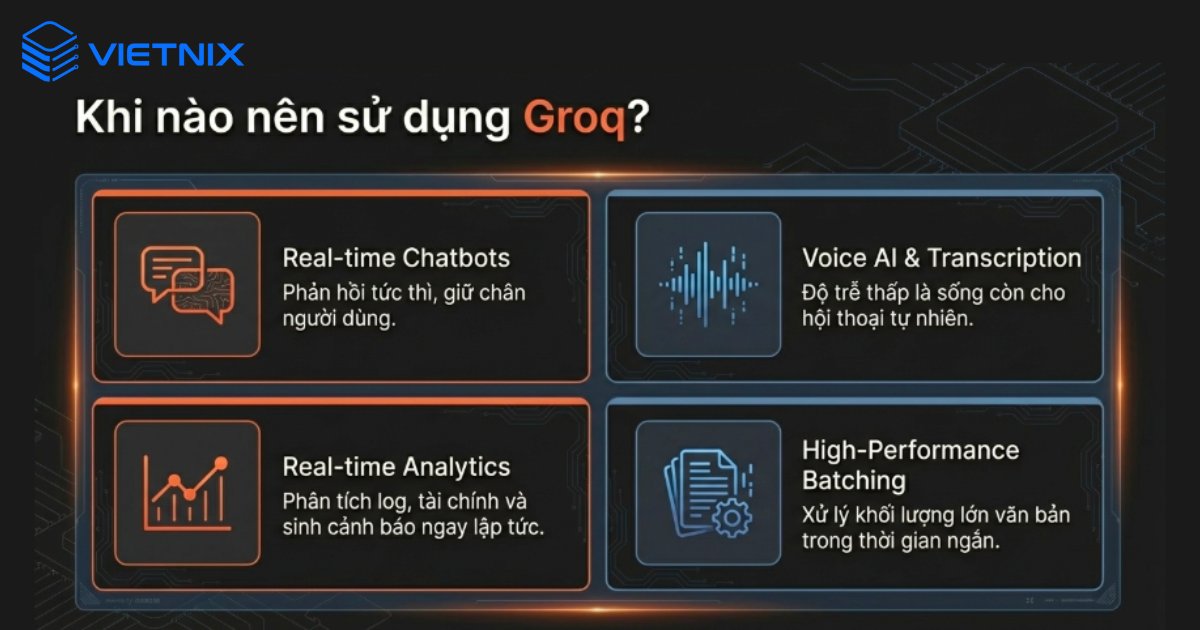

Trong thực tế, Groq phù hợp nhất với các bài toán cần suy luận nhanh, độ trễ thấp và lưu lượng request lớn theo thời gian thực. Các nhóm ứng dụng tiêu biểu gồm:

- Chatbot, trợ lý AI và agent thời gian thực: Groq phù hợp cho hệ thống chat hỗ trợ khách hàng, trợ lý nội bộ và agent nhiều bước, nơi yêu cầu phản hồi nhanh trong khung thời gian ngắn ngay cả khi lưu lượng truy cập tăng cao.

- Voice assistant, transcription và dịch gần real‑time: Hạ tầng LPU xử lý được chuỗi speech‑to‑text, LLM và text‑to‑speech với độ trễ thấp, hỗ trợ tốt cho voice bot, tổng đài ảo và ứng dụng dịch giọng nói theo thời gian gần thực.

- Phân tích dữ liệu và hệ thống cảnh báo trực tuyến: Groq có thể dùng để phân tích log, sự kiện bảo mật hoặc dữ liệu thị trường theo thời gian gần thực, kết hợp LLM cho truy vấn ngôn ngữ tự nhiên và sinh cảnh báo tự động.

- Batch inference hiệu suất cao: Nhờ throughput lớn, Groq phù hợp cho các job batch như tóm tắt tài liệu, phân loại nội dung, gắn nhãn dữ liệu hoặc sinh embedding cho kho dữ liệu lớn trong thời gian giới hạn.

Hạ tầng VPS phù hợp triển khai Groq và LLM tại Vietnix

Khi triển khai LLM, chatbot, agent hay các dịch vụ AI cần độ trễ thấp, bạn cần hạ tầng VPS mạnh, ổn định, I/O nhanh để kết nối tới Groq hoặc các backend suy luận khác một cách nhất quán. Dịch vụ VPS Vietnix sử dụng CPU AMD EPYC và ổ cứng NVMe, băng thông cao trong nước, phù hợp triển khai API, gateway, ứng dụng trung gian, RAG service hoặc các microservice AI quanh Groq.

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

Groq có cung cấp mô hình riêng hay chỉ chạy model của bên thứ ba?

Groq tập trung chạy model open‑source/open‑weight (Llama, Mixtral, Gemma, DeepSeek R1 Distill, GPT‑OSS,…) và một số biến thể do Groq tinh chỉnh như Llama‑3‑Groq Tool‑Use. Một số model có thể được tối ưu riêng cho LPU, nhưng chiến lược trọng tâm vẫn là cung cấp hạ tầng suy luận cho nhiều loại model khác nhau.

Groq có hỗ trợ xây hệ thống đa vùng (multi‑region) và failover không?

GroqCloud được triển khai trên nhiều cụm hạ tầng để giảm độ trễ khu vực và tăng độ sẵn sàng cho ứng dụng sản xuất. Việc thiết kế chiến lược multi‑region, failover và cân bằng tải vẫn là trách nhiệm của đội ngũ triển khai, dựa trên cách sử dụng endpoint và routing trong kiến trúc ứng dụng.

Khi đã dùng OpenAI API, có khó để chuyển một phần traffic sang Groq không?

Do Groq cung cấp API tương thích OpenAI, việc chuyển hoặc chia traffic thường chỉ cần đổi endpoint và API key ở tầng cấu hình, kèm điều chỉnh nhỏ về tên model. Các thư viện client chính thức của OpenAI có thể tái sử dụng cho Groq, giúp giảm chi phí tích hợp lại toàn bộ codebase.

Groq dùng phần cứng chuyên dụng LPU và kiến trúc software‑first để tối ưu tốc độ, độ trễ và tính ổn định cho inference ở quy mô lớn. Khi hiểu rõ đặc điểm công nghệ, mô hình hỗ trợ và giới hạn hiện tại, bạn có thể xác định Groq phù hợp nhất với những hệ thống chatbot, voice, phân tích dữ liệu hay batch inference nào trong lộ trình AI của mình. Groq không thay thế toàn bộ stack GPU truyền thống, nhưng là mảnh ghép đáng cân nhắc nếu trọng tâm của bạn là suy luận LLM nhanh, ổn định và dễ dự đoán chi phí.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày