LLaMA là gì? Tổng quan kiến thức về mô hình ngôn ngữ lớn của Meta

Đã kiểm duyệt nội dung

Đánh giá

LLaMA là mô hình ngôn ngữ lớn do Meta phát triển, có khả năng hiểu và sinh văn bản, mã lập trình trên nhiều quy mô tham số khác nhau, phù hợp máy cá nhân đến hạ tầng doanh nghiệp. Bài viết này được mình đúc kết từ hơn 3 năm kinh nghiệm triển khai thực tế các công cụ AI hỗ trợ lập trình cho đội ngũ kỹ thuật tại Vietnix, mình sẽ cùng bạn tìm hiểu khái niệm LLaMA, cơ chế hoạt động, các phiên bản chính, ưu nhược điểm, ứng dụng thực tế, so sánh với các mô hình khác và xu hướng phát triển trong thời gian tới.

Những điểm chính

- Quan điểm của mình: LLaMA là bước ngoặt của AI mã nguồn mở, giúp dân chủ hóa mô hình ngôn ngữ lớn. Điểm mạnh nhất nằm ở hiệu quả vận hành: tham số nhỏ nhưng năng lực tương đương các mô hình đóng khổng lồ. Điều này cho phép doanh nghiệp tự triển khai trên hạ tầng riêng để bảo mật dữ liệu mà vẫn đảm bảo hiệu suất vượt trội.

- Khái niệm LLaMA: Hiểu LLaMA là dòng mô hình ngôn ngữ lớn dạng open-weight của Meta, giúp người dùng tự chủ triển khai các ứng dụng AI linh hoạt và bảo mật trên hạ tầng riêng.

- Cơ chế hoạt động: Nắm vững kiến trúc Transformer tự hồi quy và quy trình dự đoán token, giúp hiểu cách mô hình xử lý ngôn ngữ tự nhiên và sinh nội dung mạch lạc.

- Các phiên bản phát triển: Phân biệt được lộ trình từ LLaMA 1 đến LLaMA 4 với các quy mô tham số khác nhau, giúp lựa chọn phiên bản phù hợp nhất với tài nguyên phần cứng và nhu cầu dự án.

- Ưu nhược điểm: Nhận diện rõ khả năng tùy biến cao và yêu cầu khắt khe về hạ tầng, giúp cân nhắc kỹ lưỡng bài toán chi phí và hiệu năng trước khi triển khai.

- Ứng dụng thực tế: Biết các ứng dụng phổ biến như chatbot, hỗ trợ lập trình, dịch thuật và phân tích dữ liệu, giúp áp dụng mô hình vào thực tế để tối ưu quy trình làm việc.

- So sánh với đối thủ: Phân biệt sự khác nhau giữa LLaMA và các mô hình đóng như GPT-4 hay PaLM, giúp ra quyết định chính xác giữa việc tự vận hành hệ thống hay sử dụng dịch vụ API.

- Xu hướng phát triển: Cập nhật hướng đi về xử lý đa phương thức và tích hợp sâu vào hệ sinh thái Meta, giúp định hướng chiến lược công nghệ dài hạn cho doanh nghiệp.

- Giới thiệu Vietnix: Vietnix cung cấp hạ tầng MaxSpeed Hosting hiệu năng cao, giúp đảm bảo môi trường vận hành ổn định và tốc độ tối ưu cho các ứng dụng tích hợp AI.

- Câu hỏi thường gặp: Giải đáp các thắc mắc liên quan đến LLaMA.

LLaMA là gì?

LLaMA (Large Language Model Meta AI) là dòng mô hình ngôn ngữ lớn do Meta phát triển, có khả năng hiểu và sinh văn bản, mã lập trình với nhiều cấu hình từ khoảng 7B đến hơn 70B tham số, thậm chí lớn hơn ở các thế hệ mới. Mô hình được huấn luyện trên tập dữ liệu rất lớn và được tối ưu để đạt hiệu suất cao, dùng ít tài nguyên hơn so với nhiều LLM khác và có thể triển khai cục bộ để tăng mức kiểm soát và bảo mật dữ liệu.

Về kiến trúc, LLaMA là mô hình Transformer tự hồi quy: nhận chuỗi đầu vào và dự đoán token tiếp theo để sinh văn bản hoặc mã nguồn. Meta phát hành nhiều phiên bản với số tham số khác nhau để phù hợp từ môi trường máy cá nhân đến hạ tầng doanh nghiệp, giúp linh hoạt trong lựa chọn tài nguyên và kịch bản sử dụng.

Khác với nhiều mô hình thương mại đóng, LLaMA được phân phối theo dạng open-weight, cho phép tải trọng số về, fine-tune và triển khai trên hạ tầng riêng khi tuân thủ giấy phép của Meta. Nhờ đó, nhóm nghiên cứu, doanh nghiệp và tổ chức có thể xây dựng chatbot, hệ thống tóm tắt tài liệu, hỏi đáp, sinh code và nhiều ứng dụng xử lý ngôn ngữ tự nhiên khác mà không phụ thuộc hoàn toàn vào dịch vụ AI đám mây của bên thứ ba.

Để khai thác tối đa tiềm năng của các mô hình Open-weight như LLaMA, việc sở hữu một hạ tầng có tốc độ xử lý dữ liệu và băng thông vượt trội là yếu tố then chốt. Dịch vụ VPS OpenStack tại Vietnix cung cấp môi trường ảo hóa hiện đại, giúp bạn dễ dàng triển khai, fine-tune và vận hành LLaMA cục bộ với hiệu suất ổn định và tính bảo mật cao nhất cho dữ liệu doanh nghiệp.

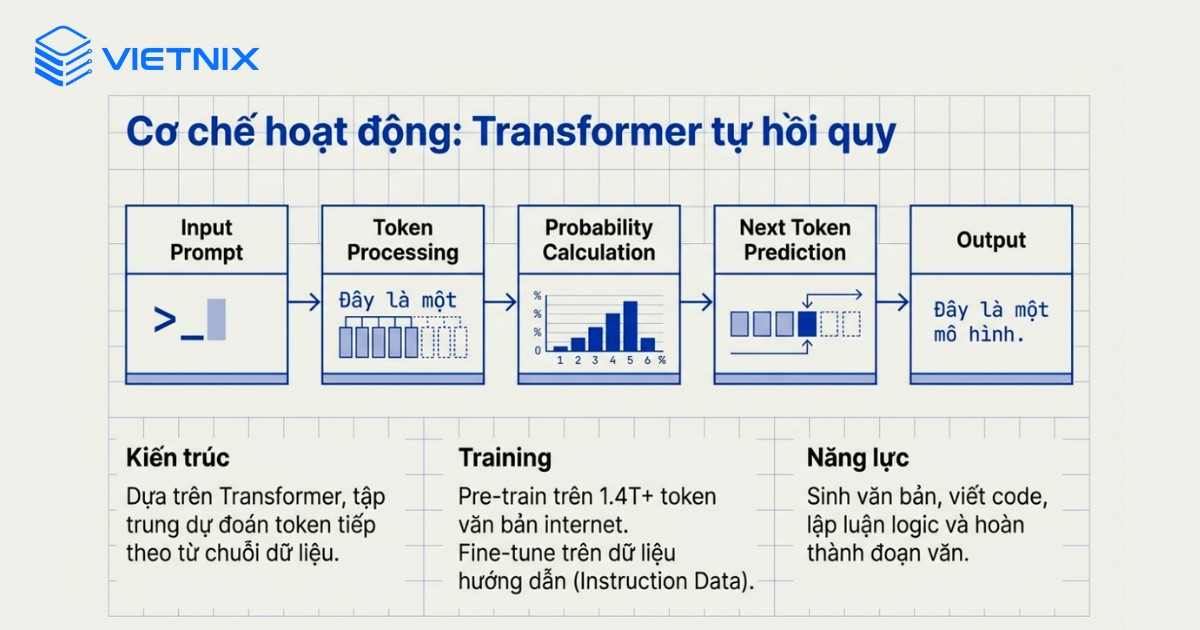

Cơ chế hoạt động của LLaMA

LLaMA hoạt động như một mô hình ngôn ngữ tự hồi quy dựa trên kiến trúc Transformer, tập trung vào nhiệm vụ dự đoán token tiếp theo dựa trên chuỗi token đã có. Nói ngắn gọn, mô hình nhận prompt đầu vào, tính xác suất cho từng token có thể xuất hiện tiếp theo và chọn ra chuỗi token có xác suất cao để sinh văn bản liên tục, mạch lạc theo ngữ cảnh.

Về quy trình, LLaMA được huấn luyện trước (pre-train) trên lượng lớn văn bản internet và tài liệu công khai nhiều ngôn ngữ, giúp mô hình học cấu trúc ngôn ngữ, kiến thức nền và các mẫu câu hỏi – trả lời phổ biến. Sau đó, các phiên bản phục vụ hội thoại hoặc tác vụ cụ thể được tinh chỉnh (fine-tune) thêm trên dữ liệu hướng dẫn, giúp mô hình trả lời câu hỏi, tóm tắt, dịch thuật hoặc sinh code sát với yêu cầu hơn.

Trong quá trình suy luận (inference), LLaMA có thể thực hiện nhiều tác vụ khác nhau dựa trên cùng một cơ chế dự đoán token:

- Sinh văn bản: Tạo bài viết, mô tả sản phẩm, báo cáo ngắn gọn dựa trên vài dòng gợi ý.

- Hoàn thành văn bản: Nhận một đoạn dở dang và tiếp tục phần còn lại sao cho phù hợp ngữ cảnh.

- Hỏi đáp và trợ lý ảo: Nhận câu hỏi và sinh câu trả lời dựa trên tri thức học được trong quá trình huấn luyện.

- Dịch và chuyển đổi phong cách: Chuyển văn bản giữa các ngôn ngữ được hỗ trợ hoặc chuyển đổi giọng điệu, độ dài, định dạng.

Do trọng số được công khai (open-weight), nhiều nhóm đã tối ưu LLaMA để chạy trên máy cá nhân, edge server hoặc hạ tầng on-premise, miễn là đủ RAM và tài nguyên GPU/CPU. Qua kinh nghiệm triển khai các mô hình tương tự cho khách hàng, Vietnix nhận thấy việc chuẩn bị hạ tầng máy chủ hoặc hosting có I/O nhanh, băng thông ổn định và tài nguyên mở rộng linh hoạt là yếu tố quan trọng nếu bạn muốn đưa LLaMA vào môi trường sản xuất hoặc thử nghiệm lâu dài.

LLaMA 1

LLaMA 1 ra mắt tháng 02/2023 với các kích thước 7B, 13B, 33B, 65B tham số, được huấn luyện trên khoảng 1.4 nghìn tỷ token. Phiên bản này tập trung vào khoảng 20 ngôn ngữ dùng bảng chữ cái Latinh, hướng đến mô hình gọn, hiệu quả, có thể chạy trên hạ tầng tính toán không quá lớn.

LLaMA 2

LLaMA 2 được giới thiệu tháng 07/2023, mở rộng quy mô lên tối đa 70B tham số với tập huấn luyện khoảng 2 nghìn tỷ token, tăng khoảng 40% so với thế hệ đầu. Meta cho phép sử dụng thương mại theo giấy phép riêng và cung cấp hai dòng chính: LLaMA 2 pretrained và LLaMA 2-Chat dành cho hội thoại.

LLaMA 3

LLaMA 3 bao gồm các kích thước 8B và 70B, được huấn luyện trên khoảng 15 nghìn tỷ token và hỗ trợ ngữ cảnh khoảng 8.000 token cho văn bản dài và hội thoại nhiều lượt. Dữ liệu huấn luyện trải rộng khoảng 30 ngôn ngữ, tăng khả năng xử lý đa ngôn ngữ trong nhiều kịch bản ứng dụng khác nhau.

LLaMA 4

LLaMA 4 được định hướng sử dụng kiến trúc Mixture of Experts (MoE), trong đó từng lượt suy luận chỉ kích hoạt một tập con “expert” để tối ưu chi phí tính toán. Một số tài liệu kỹ thuật đề cập các biến thể quy mô lớn như Scout ~109B tham số và Maverick ~400B tham số, phục vụ nhu cầu lập luận và xử lý tác vụ phức tạp trên hạ tầng phù hợp.

Ưu nhược điểm của LLaMA

Hiệu suất cao với ít tham số hơn: LLaMA đạt chất lượng tốt trong khi dùng ít tham số hơn nhiều mô hình cùng tầm, nhờ chiến lược huấn luyện và chọn dữ liệu tối ưu.

Mô hình mở / open-weight: Trọng số được công khai, cho phép tải về, tinh chỉnh và triển khai trên hạ tầng riêng, giảm chi phí phụ thuộc vào API bên ngoài.

Chạy được trên phần cứng phổ thông: Các bản 7B, 8B, 13B có thể chạy trên một GPU hoặc cụm nhỏ, phù hợp cho doanh nghiệp vừa và nhỏ hoặc nhóm R&D.

Hỗ trợ nhiều tác vụ: LLaMA xử lý tốt sinh văn bản, hỗ trợ lập trình, lý luận thường thức, dịch thuật và tóm tắt khi được tinh chỉnh đúng dữ liệu.

Thiên kiến từ dữ liệu huấn luyện: Mô hình có thể sinh nội dung lệch lạc hoặc nhạy cảm, nên cần lớp kiểm duyệt và đánh giá đầu ra trong môi trường thực tế.

Huấn luyện lại từ đầu rất tốn kém: Pre-train quy mô LLaMA đòi hỏi cụm GPU lớn và chi phí cao, đa số tổ chức chỉ nên tập trung fine-tune.

Hỗ trợ tiếng Việt chưa tối ưu: Khả năng xử lý tiếng Việt còn hạn chế so với tiếng Anh, thường cần fine-tune thêm trên corpora tiếng Việt.

Không có hiểu biết cảm xúc thực: LLaMA chỉ dự đoán token theo thống kê, không có nhận thức, nên với chủ đề nhạy cảm vẫn cần quy tắc và kiểm soát nội dung rõ ràng.

Quan điểm từ chuyên gia: LLaMA là nền tảng tối ưu giúp doanh nghiệp tự chủ công nghệ AI thay vì chỉ là một mô hình ngôn ngữ thông thường. Việc vận hành tốt trên phần cứng phổ thông giúp tiết kiệm chi phí, đồng thời tính chất “mở” cho phép tùy biến sâu và bảo mật dữ liệu tuyệt đối—giá trị mà các dịch vụ Cloud AI đóng khó lòng đáp ứng được.

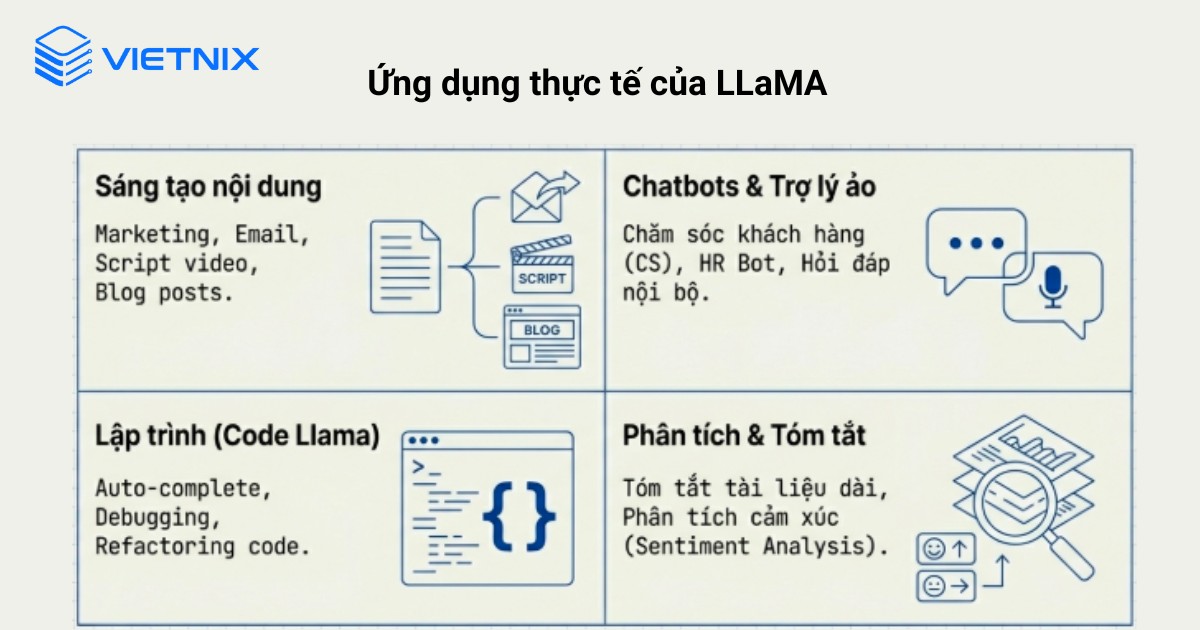

Ứng dụng thực tế của LLaMA

LLaMA được dùng rộng rãi trong các hệ thống cần xử lý ngôn ngữ tự nhiên, sinh nội dung và hỗ trợ lập trình tự động. Dưới đây là các nhóm ứng dụng phổ biến:

- Sáng tạo nội dung: Sinh bài viết, email, mô tả sản phẩm, kịch bản video và tóm tắt văn bản dài thành nội dung ngắn, dễ đọc, phục vụ marketing hoặc tài liệu nội bộ.

- Chatbot và trợ lý ảo: Làm nền tảng cho chatbot chăm sóc khách hàng, trợ lý hỗ trợ nhân viên nội bộ, trả lời câu hỏi dựa trên tài liệu sẵn có theo kiểu hội thoại nhiều lượt.

- Lập trình và hỗ trợ code: Dùng các biến thể như Code Llama để sinh code, gợi ý auto-complete, tìm lỗi cơ bản và giải thích đoạn mã cho lập trình viên.

- Dịch thuật đa ngôn ngữ: Dịch tài liệu, email, báo cáo giữa nhiều ngôn ngữ với khả năng giữ ngữ cảnh, phù hợp cho tài liệu kỹ thuật hoặc nội dung hỗ trợ khách hàng.

- Hỗ trợ nghiên cứu và phân tích: Ứng dụng trong phân tích tài liệu khoa học, gợi ý ý tưởng nghiên cứu, tóm tắt bài báo hoặc hỗ trợ các mô hình chuyên sâu hơn trong sinh học, tài chính, y tế.

- Phân tích cảm xúc và ý kiến: Tận dụng LLaMA để xây dựng mô hình phân loại cảm xúc, đánh giá tích cực/tiêu cực trong phản hồi khách hàng, bình luận mạng xã hội hoặc review sản phẩm.

Để vận hành hiệu quả các ứng dụng AI chuyên sâu này, doanh nghiệp cần một nền tảng phần cứng có năng lực tính toán cực mạnh. Vietnix cung cấp hệ sinh thái hạ tầng toàn diện từ Máy chủ vật lý, Enterprise Cloud Server đến bán VPS, mang lại tài nguyên CPU/RAM dồi dào và băng thông tốc độ cao. Đây là nền tảng lý tưởng giúp bạn triển khai LLaMA cục bộ ổn định, đảm bảo tốc độ phản hồi nhanh và bảo mật dữ liệu tuyệt đối cho mọi dự án AI.

So sánh LLaMA với các đối thủ

LLaMA thường được đặt cạnh các mô hình như GPT-3/GPT-4, PaLM, Chinchilla, Gopher khi đánh giá về hiệu năng, quy mô và mức độ “mở” của mô hình. Bảng dưới sẽ tóm tắt một số tiêu chí quan trọng:

| Tiêu chí | LLaMA | GPT-3 / GPT-4 (OpenAI) | PaLM / PaLM 2 (Google) | Chinchilla, Gopher (DeepMind) |

| Quy mô tham số tiêu biểu | 7B–70B, có bản >100B. | ~175B (GPT-3), GPT-4 lớn hơn, không công bố chi tiết. | Tới 540B tham số. | ~70B (Chinchilla), ~280B (Gopher). |

| Dữ liệu huấn luyện (ước tính) | 1.4T–2T+ token, đa ngôn ngữ. | Dữ liệu web rất lớn, chi tiết không công bố. | Tập hỗn hợp lớn, tối ưu theo luật scaling. | Chinchilla tối ưu theo ratio tham số/token. |

| Hiệu năng lý luận / QA | Mạnh ở lý luận thường thức, đọc hiểu, QA; bản 13B/65B đạt kết quả tốt so với mô hình lớn hơn. | GPT-4 vẫn dẫn đầu ở nhiều benchmark suy luận phức tạp. | Điểm cao trên nhiều bộ đánh giá như MMLU, QA. | Hiệu năng tốt với chi phí tính toán hợp lý. |

| Toán học và mã lập trình | Có Code Llama cho lập trình, mạnh ở sinh code; toán nâng cao kém hơn mô hình chuyên biệt. | Rất mạnh ở coding và toán nâng cao. | Có biến thể cho code, toán nhưng không mở trọng số. | Một số bản cho toán/lý luận, ít phổ biến. |

| Mức độ “mở” | Open-weight, tải weight, fine-tune, tự host được. | Closed-weight, chỉ dùng qua API/nền tảng. | Closed-weight, cung cấp qua Google Cloud. | Closed-weight, chủ yếu dùng nội bộ. |

| Chi phí và triển khai | Chạy local/on-premise với bản 7B–13B trên 1 GPU; bản lớn cần cụm GPU nhưng chủ động hạ tầng. | Không cần phần cứng, trả phí theo API. | Gắn với chi phí dịch vụ cloud. | Không phù hợp tự triển khai cho doanh nghiệp. |

Thực tế, LLaMA là giải pháp then chốt cho những ai muốn tự chủ công nghệ. Nếu ưu tiên tính năng mạnh mẽ nhất và không ngại phụ thuộc bên thứ ba, GPT-4 vẫn dẫn đầu. Tuy nhiên, nếu doanh nghiệp cần bảo mật dữ liệu tuyệt đối và tối ưu chi phí vận hành trên hạ tầng riêng, LLaMA là lựa chọn tối ưu nhờ khả năng tùy biến sâu và triển khai linh hoạt.

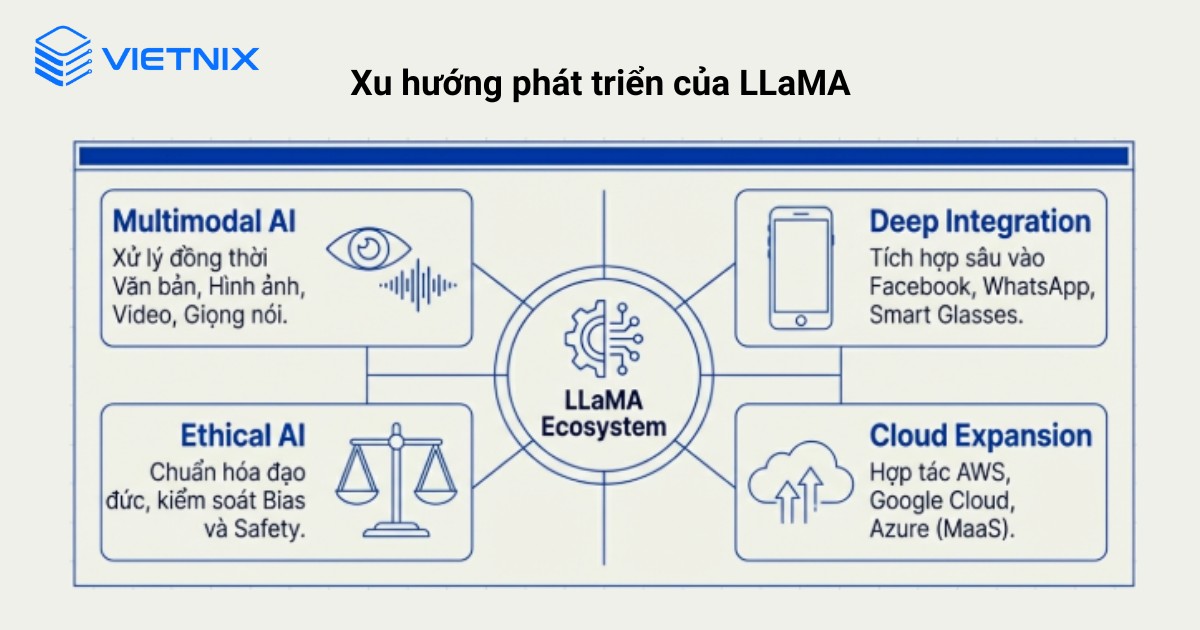

Xu hướng phát triển của LLaMA

LLaMA đang được Meta định hướng như nền tảng AI lõi, mở rộng cả về năng lực mô hình lẫn cách tích hợp vào sản phẩm và hạ tầng. Một số xu hướng chính có thể thấy rõ như:

- Tăng cường suy luận và đa phương thức: Meta tập trung nâng khả năng suy luận, xử lý ngữ cảnh dài, đồng thời mở rộng sang giọng nói và video với các thế hệ như LLaMA 3.x và LLaMA 4 đa phương thức (text + hình ảnh + video).

- Tích hợp sâu vào hệ sinh thái Meta: Meta AI dùng LLaMA đã được đưa vào Facebook, Instagram, Messenger, WhatsApp và Ray-Ban Meta glasses, giúp người dùng chat, tìm kiếm, tạo nội dung và tương tác bằng giọng nói/ngữ cảnh thực tế.

- Mở rộng qua các đối tác cloud lớn: Meta hợp tác với AWS, Azure, Google Cloud để cung cấp LLaMA (bao gồm bản 405B) dưới dạng dịch vụ, cho phép doanh nghiệp truy cập mô hình mạnh mà không cần tự xây cụm GPU.

- Gia tăng tranh luận và chuẩn đạo đức AI: Việc phát hành LLaMA 3.x dạng open-weight và sử dụng tập dữ liệu lớn đã tạo ra nhiều tranh luận về bản quyền, quyền riêng tư và rủi ro lạm dụng, buộc cộng đồng và nhà phát triển phải xây dựng quy trình sử dụng có trách nhiệm hơn.

- Mở rộng khả năng tiếp cận AI: Thông qua việc công bố trọng số, cung cấp mô hình qua nhiều nền tảng và hạ tầng cloud, LLaMA giúp nhiều nhóm nghiên cứu, doanh nghiệp nhỏ và tổ chức công dễ triển khai mô hình ngôn ngữ mạnh trên hạ tầng riêng hoặc dịch vụ đám mây phù hợp ngân sách.

Nhận định từ chuyên gia: Xu hướng của LLaMA cho thấy AI mã nguồn mở đang trực tiếp cạnh tranh sòng phẳng với các mô hình đóng qua việc chuyển dịch sang đa phương thức và quy mô tham số cực lớn. Khả năng linh hoạt giữa hạ tầng đám mây và tự vận hành (self-hosting) giúp doanh nghiệp tối ưu chi phí, đảm bảo tính bảo mật và quyền tự chủ công nghệ mà không bị phụ thuộc vào một nhà cung cấp duy nhất.

Hạ tầng tối ưu để triển khai LLaMA cùng Vietnix

Khi triển khai LLaMA hoặc các mô hình AI chuyên sâu, hạ tầng máy chủ cần đáp ứng các tiêu chuẩn khắt khe về sức mạnh CPU, tốc độ truy xuất dữ liệu (I/O) và băng thông ổn định. Vietnix cung cấp hệ sinh thái hạ tầng toàn diện, từ, Web hosting, Máy chủ vật lý, Cloud Server đến các dòng VPS chuyên dụng, đảm bảo khả năng tính toán vượt trội cho các workload AI.

Với thế mạnh về công nghệ ảo hóa hiện đại và phần cứng cao cấp như CPU AMD EPYC, ổ cứng NVMe, Vietnix giúp tối ưu hóa thời gian phản hồi (latency) và duy trì sự ổn định cho các hệ thống suy luận (inference) hay dashboard nội bộ tích hợp AI. Đội ngũ kỹ thuật chuyên môn cao của Vietnix luôn sẵn sàng tư vấn cấu hình tối ưu 24/7, giúp doanh nghiệp linh hoạt mở rộng tài nguyên và bảo mật dữ liệu tuyệt đối trong suốt quá trình vận hành mô hình.

Khám phá ngay các giải pháp hạ tầng từ Vietnix để nhận tư vấn cấu hình tối ưu và triển khai mô hình LLaMA của bạn với hiệu suất cao nhất ngay hôm nay!

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

LLaMA có được dùng thương mại hay không?

Có, nhiều phiên bản LLaMA (như LLaMA 2, LLaMA 3.x và 3.1) cho phép sử dụng thương mại theo giấy phép Community License, với một số ràng buộc như việc ghi “Built with Llama” và giới hạn đối với ứng dụng có trên 700 triệu người dùng/tháng.

LLaMA hỗ trợ tốt những ngôn ngữ nào?

Các bản LLaMA đầu tập trung vào tiếng Anh, nhưng LLaMA 3.1 trở đi hỗ trợ đa ngôn ngữ tốt hơn, với nhiều mô hình được tinh chỉnh cho nhóm 8–30 ngôn ngữ khác nhau; hiệu năng tiếng Anh vẫn thường cao nhất.

LLaMA có lưu hay gửi dữ liệu của tôi về Meta không?

Khi bạn tự triển khai LLaMA trên hạ tầng của mình hoặc qua bên thứ ba không thuộc Meta, việc lưu trữ và truy cập dữ liệu do bạn hoặc nhà cung cấp dịch vụ quyết định. Meta không mặc định truy cập vào input/output trừ khi bạn gửi trực tiếp cho Meta.

Qua bài viết trên có thể thấy LLaMA là một họ mô hình ngôn ngữ lớn linh hoạt, hỗ trợ từ nghiên cứu đến ứng dụng thực tế, với lợi thế trọng số mở và nhiều lựa chọn cấu hình. Nắm rõ cơ chế hoạt động, các phiên bản, ưu nhược điểm và xu hướng phát triển sẽ giúp bạn chọn được cách triển khai LLaMA phù hợp cho hệ thống, từ thử nghiệm R&D đến các sản phẩm AI phục vụ người dùng cuối.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày