Kafka Kubernetes là gì? Đặc điểm và thành phần chính của Kafka Kubernetes

Đã kiểm duyệt nội dung

Đánh giá

Khi triển khai hệ thống streaming trên Kubernetes, mình nhận thấy việc đảm bảo tính ổn định và khả năng mở rộng khi xử lý dữ liệu real-time là vấn đề vô cùng quan trọng. Trong đó việc ứng dụng Apache Kafka trên Kubernetes giúp quản lý broker, scale và đảm bảo độ sẵn sàng cao trở nên rõ ràng và dễ kiểm soát hơn. Trong bài viết này, mình sẽ chia sẻ lại cách Kafka Kubernetes hoạt động cùng các đặc điểm và thành phần chính để bạn có thể áp dụng vào hệ thống thực tế.

Những điểm chính

Xét từ góc độ kiến trúc hệ thống dữ liệu, Kafka Kubernetes đóng vai trò là nền tảng cốt lõi giúp chuẩn hóa quy trình xử lý luồng dữ liệu trên quy mô lớn. Để giúp bạn hiểu rõ về quá trình này, bài viết sau sẽ cung cấp các thông tin gồm:

- Khái niệm Kafka Kubernetes: Đây là nền tảng giúp bạn hiểu cách Kafka được triển khai và vận hành trong môi trường Kubernetes.

- Khái niệm Apache Kafka: Nắm được khái niệm và vai trò của Kafka trong việc xử lý dữ liệu streaming.

- Những thành phần chính: Hiểu rõ các thành phần cốt lõi để vận hành hệ thống Kafka hiệu quả.

- Lý do cần triển khai Apache Kafka trên Kubernetes: Nắm được lý do kết hợp hai công nghệ để tăng khả năng mở rộng và quản lý.

- Hướng dẫn triển khai: Đây là phần thực hành giúp bạn xây dựng và triển khai hệ thống Kafka cụ thể.

- Giám sát và quản lý Kafka trên Kubernetes: Hiểu cách theo dõi và duy trì hệ thống hoạt động ổn định.

- Biết thêm Vietnix là nhà cung cấp dịch vụ hosting, VPS và Enterprise Cloud tốc độ cao, support nhiệt tình.

- Câu hỏi thường gặp: Giải đáp các thắc mắc liên quan đến Kafka Kubernetes.

Kafka Kubernetes là gì?

Kafka Kubernetes là quá trình triển khai và quản lý nền tảng Apache Kafka trên một môi trường Kubernetes để tự động hóa vận hành, mở rộng quy mô và tăng tính sẵn sàng cao của các cụm Kafka phức tạp. Việc này giúp khối dữ liệu thời gian thực được xử lý liên tục và tin cậy trong môi trường đám mây hoặc hạ tầng containerized.

Khi triển khai Apache Kafka trên Kubernetes, hạ tầng bên dưới đóng vai trò quan trọng trong việc đảm bảo hiệu suất xử lý và độ ổn định của hệ thống. Với các workload yêu cầu xử lý dữ liệu real-time và khả năng scale linh hoạt, việc lựa chọn một nền tảng phù hợp là yếu tố cần thiết. Hiểu được điều đó, Vietnix cung cấp dịch vụ Server Cloud với hiệu năng cao, khả năng mở rộng linh hoạt và đáp ứng tốt các yêu cầu vận hành hệ thống hiện đại. Liên hệ để được tư vấn chi tiết về dịch vụ!

Apache Kafka là gì?

Apache Kafka là một nền tảng mã nguồn mở phân tán chuyên xử lý và lưu trữ luồng dữ liệu thời gian thực dưới dạng các bản ghi sự kiện. Apache Kafka cho phép các ứng dụng xuất bản và đăng ký nhận tin nhắn, vượt trội hơn hệ thống hàng đợi thông thường nhờ khả năng chịu lỗi cao và mở rộng quy mô lớn. Hệ thống này vận hành thông qua các cụm broker để điều phối và trung chuyển dữ liệu hiệu quả giữa các dịch vụ.

Những thành phần chính của Kafka

1. Topics và Partition

Một Topic trong Kafka đóng vai trò như một danh mục để phân loại và lưu trữ thông điệp. Mỗi Topic được nhận diện duy nhất bởi tên gọi và tạo thành các luồng dữ liệu. Ở cấp độ vật lý, một Topic được chia nhỏ thành một hoặc nhiều Partition. Các Partition này thực chất là các tệp tin nhật ký nối tiếp.

Partition là chìa khóa để Kafka đạt được hiệu suất song song hóa. Các tin nhắn gửi vào Topic sẽ được phân phối vào các Partition thông qua Partition Key để đảm bảo thứ tự, hoặc sử dụng cơ chế Round-robin nếu tin nhắn không có khóa nhằm cân bằng tải.

2. Producers

Các Producer là ứng dụng đóng vai trò đẩy dữ liệu đầu vào cho Kafka. Chúng đóng gói thông điệp, thực hiện tuần tự hoá và gửi đến các Topic tương ứng. Khi gửi dữ liệu, Producer là thành phần chủ động quyết định tin nhắn sẽ được ghi vào Partition nào (thường dựa trên việc băm Partition Key hoặc phân phối mặc định).

3. Consumers

Các Consumer là ứng dụng đăng ký nhận, đọc và xử lý dữ liệu từ các Topic. Chúng thường được gom lại thành các Consumer Groups để chia sẻ khối lượng công việc. Quy tắc cốt lõi của Kafka là trong cùng một Consumer Group, mỗi Partition chỉ được gán cho một Consumer duy nhất để xử lý (nhưng một Consumer có thể đọc nhiều Partition). Kafka sử dụng cơ chế Offset để theo dõi chính xác tiến độ đọc của từng Consumer Group. Nhờ đó, cùng một luồng dữ liệu, Kafka có thể phân phối đồng thời cho nhiều Consumer Group khác nhau để phục vụ các mục đích nghiệp vụ độc lập.

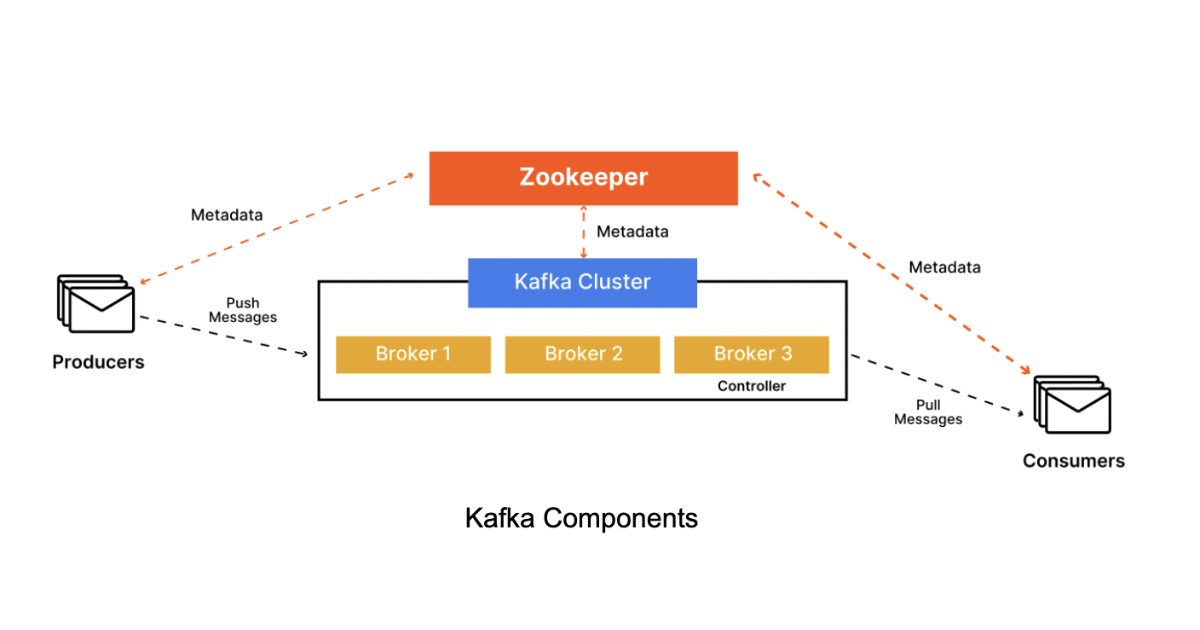

4. Brokers

Broker là các máy chủ vật lý (hoặc ảo) lưu trữ dữ liệu và xử lý các yêu cầu đọc/ghi của Client. Nhiều Broker liên kết với nhau tạo thành một Kafka Cluster. Để đảm bảo khả năng chịu lỗi, dữ liệu của mỗi Partition sẽ được sao chép ra nhiều Broker khác nhau. Đối với mỗi Partition, hệ thống sẽ bầu ra một bản sao làm Leader để trực tiếp xử lý mọi yêu cầu đọc/ghi; trong khi các bản sao nằm trên các Broker khác sẽ đóng vai trò Follower, liên tục đồng bộ dữ liệu từ Leader để dự phòng khi có sự cố.

Tại sao cần triển khai Apache Kafka trên Kubernetes?

Apache Kafka hiện nay đang có xu hướng được vận hành trực tiếp trên Kubernetes – Nền tảng tự động hóa triển khai và quản lý container hàng đầu. Sự kết hợp này biến Kafka thành lựa chọn lý tưởng cho các kiến trúc ứng dụng Cloud Native thế hệ mới. Dù việc chuyển đổi toàn bộ hạ tầng sang một nền tảng mới luôn tốn kém thời gian và nguồn lực, nhưng nếu doanh nghiệp của bạn đã có sẵn hệ sinh thái Kubernetes, đây sẽ là một con đường tiếp cận tối ưu hơn hẳn:

- Thứ nhất, tối ưu nguồn lực nhân sự: Đội ngũ IT không cần học thêm cách quản lý một hạ tầng máy chủ vật lý mới mà có thể tận dụng ngay các kỹ năng K8s sẵn có để vận hành và xử lý sự cố Kafka.

- Thứ hai, tối ưu chi phí đầu tư: Việc thuyết phục ban lãnh đạo tận dụng các cụm K8s hiện hữu để chạy Kafka (thông qua các K8s Operators như Strimzi) sẽ dễ dàng được phê duyệt hơn nhiều so với việc xin ngân sách xây dựng một hệ thống hạ tầng độc lập.

Đặc biệt, ngoài lợi ích về chi phí, Kafka trên Kubernetes còn giải quyết triệt để một bài toán hóc búa ở các doanh nghiệp lớn là Multi-cluster. Khi tổ chức cần hàng chục cụm Kafka cho nhiều môi trường khác nhau, khả năng mở rộng và quản lý tập trung của K8s sẽ phát huy sức mạnh tối đa.

Hướng dẫn triển khai Kafka trên Kubernetes

Việc triển khai Apache Kafka trên Kubernetes khác biệt hoàn toàn so với các ứng dụng web thông thường. Vì Kafka là một hệ thống dữ liệu Stateful, bạn không thể sử dụng Deployment thông thường mà bắt buộc phải dùng StatefulSet kết hợp ổ cứng bền vững. Để đơn giản hóa và tối ưu hóa quá trình này, mình sẽ hướng dẫn bạn sử dụng Strimzi kết hợp với kiến trúc KRaft hiện đại:

1. Yêu cầu ban đầu

Trước khi bắt đầu, bạn hãy đảm bảo đã đáp ứng các điều kiện sau:

- Một cụm Kubernetes đang hoạt động (có thể dùng Minikube cho môi trường test hoặc Azure AKS, Amazon EKS, Google GKE cho môi trường thực tế).

- Công cụ CLI kubectl đã được cài đặt và kết nối thành công với cụm.

- Cụm Kubernetes có hỗ trợ cấp phát ổ cứng tự động.

2. Cài đặt Strimzi Operator

Thay vì tự cấu hình hàng tá file YAML phức tạp, bạn sẽ cài đặt Strimzi Operator. Strimzi sẽ đóng vai trò như một người quản trị tự động giúp tạo, cấu hình và tự động phục hồi cụm Kafka cho bạn. Bạn chạy các lệnh sau để cài đặt Strimzi vào một namespace mới có tên là kafka:

kubectl create namespace kafka

kubectl create -f 'https://strimzi.io/install/latest?namespace=kafka' -n kafka![]() Lưu ý

Lưu ý

Quá trình tải các tài nguyên của Strimzi có thể mất khoảng 1-2 phút.

3. Cấu hình và triển khai cụm Kafka

Bạn hãy tạo một file có tên kafka-cluster.yml với nội dung sau:

# Cấu hình Node Pool (Định nghĩa các server đóng vai trò Broker và Controller)

apiVersion: kafka.strimzi.io/v1beta2

kind: KafkaNodePool

metadata:

name: dual-role

labels:

strimzi.io/cluster: my-cluster

spec:

replicas: 3

roles:

- controller

- broker

storage:

type: jbod

volumes:

- id: 0

type: persistent-claim

size: 10Gi

deleteClaim: false

---

# Cấu hình Cụm Kafka chính

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

name: my-cluster

annotations:

strimzi.io/node-pools: enabled

strimzi.io/kraft: enabled

spec:

kafka:

version: 3.7.0

listeners:

- name: plain

port: 9092

type: internal

tls: false

entityOperator:

topicOperator: {}

userOperator: {}Giải thích cấu hình:

- KafkaNodePool (replicas: 3): Chạy 3 Pod hoạt động song song. Kiến trúc KRaft cho phép các node này vừa làm broker (nhận/gửi dữ liệu) vừa làm controller (quản lý cụm).

- Storage (persistent-claim): Strimzi sẽ tự động tạo các StatefulSet và yêu cầu Kubernetes cấp phát cho mỗi Kafka Node một ổ cứng độc lập dung lượng 10GB. Ngay cả khi Pod bị xóa và tạo lại, dữ liệu trên ổ cứng vẫn còn nguyên.

- Annotations (kraft: enabled): Kích hoạt chế độ KRaft hiện đại, bỏ qua hoàn toàn việc cài đặt Zookeeper.

- listeners (port 9092): Mở cổng 9092 để các ứng dụng khác trong cùng cụm Kubernetes có thể kết nối đến Kafka.

Áp dụng file cấu hình này vào cụm:

kubectl apply -f kafka-cluster.yml -n kafka4. Kiểm tra trạng thái hoạt động

Bạn có thể theo dõi quá trình khởi tạo các Pod Kafka (chúng sẽ có dạng my-cluster-dual-role-0, 1, 2):

kubectl get pods -n kafka -wKhi tất cả các Pod chuyển sang trạng thái Running và Ready (1/1), cụm Kafka của bạn đã sẵn sàng hoạt động. Để kiểm tra các Service đã được tự động tạo ra, bạn chạy lệnh:

kubectl get svc -n kafkaỨng dụng của bạn giờ đây có thể kết nối với cụm Kafka thông qua địa chỉ nội bộ:

my-cluster-kafka-bootstrap.kafka.svc.cluster.local:9092.Giám sát và quản lý Kafka trên Kubernetes

Giám sát giúp nắm bắt tình trạng sức khỏe của hệ thống và tối ưu hóa vận hành. Khi chạy trên K8s, bạn nên tích hợp Kafka với Prometheus và Grafana. Các chỉ số quan trọng cần theo dõi trong môi trường KRaft bao gồm:

- ActiveControllerCount: Tổng trên toàn bộ cụm luôn phải bằng 1 (chỉ có 1 node làm Leader Controller tại một thời điểm).

- UnderReplicatedPartitions: Số lượng phân vùng chưa được đồng bộ đầy đủ. Chỉ số này phải luôn bằng 0. Nếu lớn hơn 0, nghĩa là một hoặc nhiều Broker đang gặp sự cố.

- Disk Usage: Vì Kafka lưu trữ dữ liệu vĩnh viễn (hoặc theo thời gian cấu hình) trên ổ cứng, bạn cần thiết lập cảnh báo khi ổ đĩa đạt 80% dung lượng để tránh crash hệ thống.

- RequestsPerSec: Giám sát lưu lượng giao tiếp giữa các Producer, Consumer và nội bộ các node để đảm bảo không xảy ra thắt nút cổ chai về băng thông mạng.

Vietnix – Nhà cung cấp dịch vụ hosting, VPS và Enterprise Cloud tốc độ cao, support nhiệt tình

Để tối ưu hạ tầng công , doanh nghiệp không chỉ cần một kiến trúc hệ thống chuẩn mà còn cần nền tảng hạ tầng ổn định, bảo mật và dễ mở rộng. Tại Vietnix, bạn có thể triển khai các ứng dụng, dịch vụ và hệ thống streaming trên nền tảng hosting chất lượng cao tại chuyên mục web hosting, sử dụng tài nguyên linh hoạt với dịch vụ thuê máy chủ ảo hiệu năng mạnh mẽ, hoặc làm chủ hạ tầng đám mây riêng thông qua giải pháp Enterprise Cloud Server thế hệ mới. Các dịch vụ này được thiết kế để đáp ứng nhu cầu vận hành những workload thời gian thực, giúp hệ thống của bạn luôn hoạt động mượt mà và sẵn sàng mở rộng khi lưu lượng tăng cao.

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

Kafka trên Kubernetes có hỗ trợ KRaft mode không?

Có, Kafka từ phiên bản 3.3+ hỗ trợ KRaft (Kafka Raft) thay thế Zookeeper, giảm độ phức tạp. Trên K8s, dùng Strimzi Operator để triển khai KRaft với StatefulSet, đảm bảo metadata quorum qua Raft protocol. Cấu hình process.roles=broker,controller trong broker config.

Làm sao scale Kafka cluster trên Kubernetes an toàn?

Tuyệt đối không dùng HorizontalPodAutoscaler cho Kafka Brokers vì việc hệ thống tự động xóa Pod có thể gây mất mát dữ liệu. Để scale an toàn, bạn thay đổi số lượng replicas trong file cấu hình của Strimzi. Lưu ý: Kafka không tự động phân bổ lại dữ liệu khi có node mới. Bạn bắt buộc phải tích hợp Cruise Control để tự động tính toán và điều hướng các partitions sang node mới một cách an toàn mà không gây gián đoạn.

Persistent storage nào tốt nhất cho Kafka trên K8s?

Yêu cầu bắt buộc là mỗi broker cần một PVC riêng biệt và cấu hình volumeBindingMode=WaitForFirstConsumer để tránh lỗi sai vùng khi K8s lập lịch Pod. Hệ điều hành nên dùng định dạng đĩa XFS. Để đạt hiệu năng I/O tốt nhất, nên ưu tiên sử dụng Local Persistent Volumes thay vì các giải pháp lưu trữ mạng phân tán (như Ceph) để tránh tình trạng nhân bản kép, tận dụng trực tiếp Replication Factor (≥3) của chính Kafka để bảo vệ dữ liệu.

Backup Kafka topics trên Kubernetes ra sao?

Bạn sử dụng Velero với PVC snapshots hoặc kafka-connect-s3-sink connector stream data ra S3. Topic-level backup bằng kafka-dump-log, kết hợp consumer offsets export. Test restore với Chaos Engineering tools như Litmus.

Kafka Kubernetes mang đến cách tiếp cận hiện đại cho hệ thống dữ liệu thời gian thực với khả năng mở rộng linh hoạt, tự động hóa cao và vận hành ổn định. Khi hiểu rõ kiến trúc và các thành phần cốt lõi, bạn sẽ dễ dàng triển khai và tối ưu hệ thống hiệu quả hơn. Lựa chọn hạ tầng phù hợp ngay từ đầu cũng là yếu tố quan trọng giúp Kafka Kubernetes hoạt động bền vững. Cảm ơn bạn đã theo dõi bài viết!

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày