Cách khắc phục lỗi Volume Node Affinity Conflict trong Kubernetes chi tiết

Đã kiểm duyệt nội dung

Đánh giá

Lỗi Volume Node Affinity Conflict là một cảnh báo thường gặp trong Kubernetes, xuất hiện khi PersistentVolume bị ràng buộc với một nhóm node nhất định nhưng Pod lại được scheduler đặt lên node không thỏa các quy tắc nodeAffinity đó. Bài viết này được mình đúc kết từ kinh nghiệm xử lý các sự cố Pod kẹt ở trạng thái Pending trên cụm Kubernetes thực tế, tập trung vào cách nhận diện nguyên nhân, quy trình chẩn đoán và các phương án khắc phục Volume Node Affinity Conflict mà bạn có thể áp dụng trực tiếp cho cluster hiện tại.

Những điểm chính

- Quan điểm của mình: Với các cụm Kubernetes chạy workload sản xuất, hiểu rõ cơ chế Volume Node Affinity và lỗi Volume Node Affinity Conflict quan trọng không kém việc tối ưu tài nguyên, vì chỉ cần cấu hình sai một nhãn node hoặc StorageClass là cả một nhóm Pod có thể bị kẹt ở trạng thái Pending trong thời gian dài.

- Khái niệm Volume Node Affinity: Hiểu rõ đây là một tập ràng buộc, giúp bạn nhận biết vai trò của nó trong việc quy định volume chỉ có thể được gắn lên các node cụ thể.

- Khái niệm lỗi Volume Node Affinity Conflict: Hiểu rõ đây là lỗi xung đột giữa ràng buộc của volume và vị trí của Pod, giúp bạn nhanh chóng xác định nguyên nhân khiến Pod bị kẹt ở trạng thái Pending.

- Dấu hiệu nhận biết: Nhận biết các dấu hiệu như Pod bị kẹt và thông báo lỗi cụ thể, giúp bạn nhanh chóng khoanh vùng và xác nhận chính xác sự cố đang xảy ra.

- Nguyên nhân gây lỗi: Nắm vững các nguyên nhân phổ biến từ việc volume và Pod nằm ở các zone khác nhau đến cấu hình StorageClass không phù hợp, giúp bạn có một danh sách kiểm tra hiệu quả để chẩn đoán sự cố.

- Cách chẩn đoán: Nắm vững các lệnh kubectl cần thiết, giúp bạn thu thập thông tin và đối chiếu giữa ràng buộc của volume và label của node để tìm ra điểm xung đột.

- Cách khắc phục: Tìm hiểu các giải pháp hiệu quả, đặc biệt là việc chuyển volumeBindingMode sang WaitForFirstConsumer, giúp bạn giải quyết triệt để sự cố và đảm bảo volume được tạo ở đúng vị trí.

- Giới thiệu Vietnix: Biết thêm Vietnix là nhà cung cấp Cloud Server mạnh mẽ, giúp bạn có một nền tảng hạ tầng đáng tin cậy cho mọi giải pháp Kubernetes và lưu trữ.

- Câu hỏi thường gặp: Giải đáp các thắc mắc liên quan đến lỗi Volume Node Affinity Conflict.

Volume Node Affinity là gì?

Volume node affinity trong Kubernetes là một bộ quy tắc dùng để giới hạn các Node cụ thể mà một Persistent Volume (PV) có thể gắn kết vào, thường dựa trên label như zone, region hoặc thuộc tính phần cứng của node.

Kubernetes sử dụng cơ chế này nhằm đảm bảo rằng các Pod khi cần truy cập vào một ổ đĩa cụ thể sẽ luôn được hệ thống ưu tiên lập lịch chạy trên đúng Node đang kết nối trực tiếp với ổ đĩa đó. Cơ chế volume node affinity thường áp dụng cho local storage hoặc các loại storage bị ràng buộc theo vùng địa lý nhằm duy trì tính nhất quán và bảo đảm hiệu năng truy xuất.

Lỗi Volume Node Affinity Conflict là gì?

Lỗi Volume Node Affinity Conflict trong Kubernetes là cảnh báo xuất hiện khi một Pod được lập lịch chạy trên một Node, nhưng Node đó không đáp ứng được các điều kiện ràng buộc vị trí của Persistent Volume mà Pod đang yêu cầu. Nói cách khác, Pod và ổ đĩa lưu trữ bị hệ thống đặt ở các phân vùng hoặc Node hoàn toàn khác nhau.

Sự sai lệch vị trí vật lý này khiến Pod không thể truy cập vào dữ liệu, từ đó bị hệ thống treo ở trạng thái “Pending”. Thông thường, lỗi này đi kèm message trong phần Events khi chạy lệnh kubectl describe pod với nội dung “1 node(s) had volume node affinity conflict”.

Để vận hành hệ thống Kubernetes chuyên nghiệp, Vietnix Enterprise Cloud là giải pháp IaaS tối ưu dành cho doanh nghiệp. Nền tảng này cho phép bạn toàn quyền tạo lập và quản lý các cụm máy chủ ảo trên một nguồn tài nguyên độc lập. Được trang bị CPU AMD EPYC và 100% ổ cứng NVMe Enterprise, hệ thống mang lại hiệu năng cực đỉnh, khả năng mở rộng linh hoạt cùng mức chi phí cố định minh bạch, hoàn toàn không phát sinh chi phí ẩn.

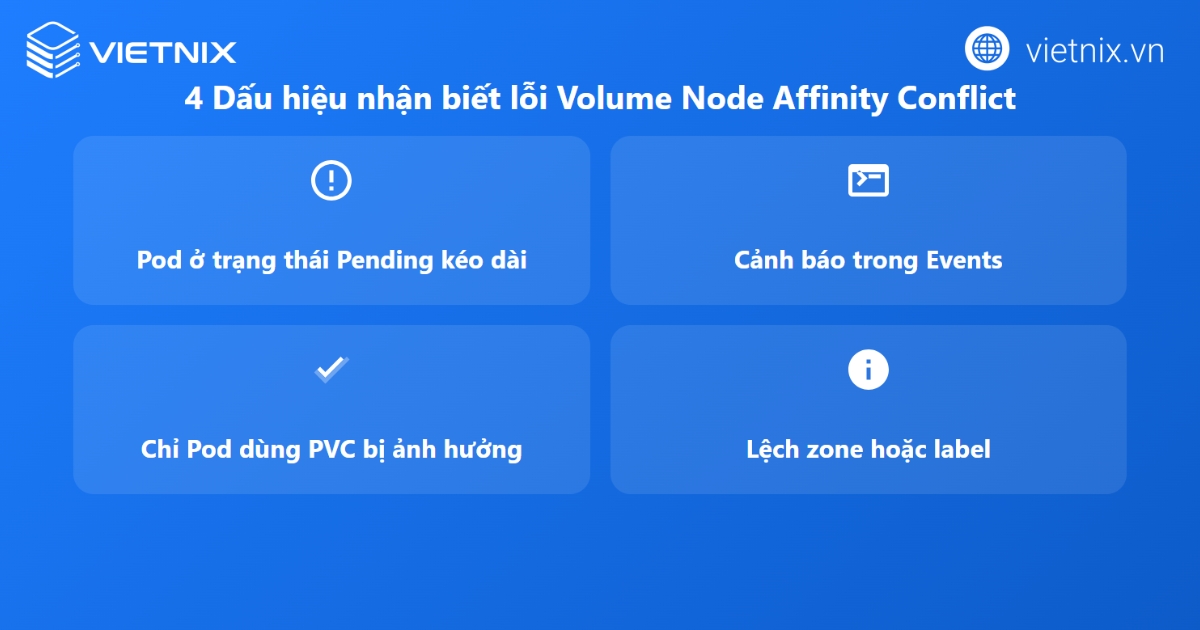

Dấu hiệu nhận biết lỗi Volume Node Affinity Conflict

Dấu hiệu nhận biết lỗi Volume Node Affinity Conflict thường thể hiện rõ qua trạng thái Pod Pending và các cảnh báo trong phần Events như:

- Pod ở trạng thái Pending kéo dài: Pod gắn với PersistentVolume không chuyển sang trạng thái Running mà giữ trạng thái Pending sau khi tạo hoặc rollout, dù container image không gặp lỗi pull hay crash.

- Cảnh báo trong Events: Lệnh

kubectl describe pod <pod-name>hiển thị cảnh báo dạng “1 node(s) had volume node affinity conflict” (hoặcN node(s) had volume node affinity conflict) trong phần Events. - Chỉ Pod dùng PVC bị ảnh hưởng: Các Pod khác không sử dụng cùng PersistentVolume hoặc PVC vẫn được schedule bình thường, trong khi Pod gắn volume có nodeAffinity conflict bị Pending kèm cảnh báo trên.

- Log thể hiện sự lệch zone/label: Mô tả chi tiết trong Events hoặc mô tả PV cho thấy volume ràng buộc với node có label hoặc zone cụ thể, còn node mà Pod được cố gắng schedule lại nằm ở zone hoặc không có label tương ứng.

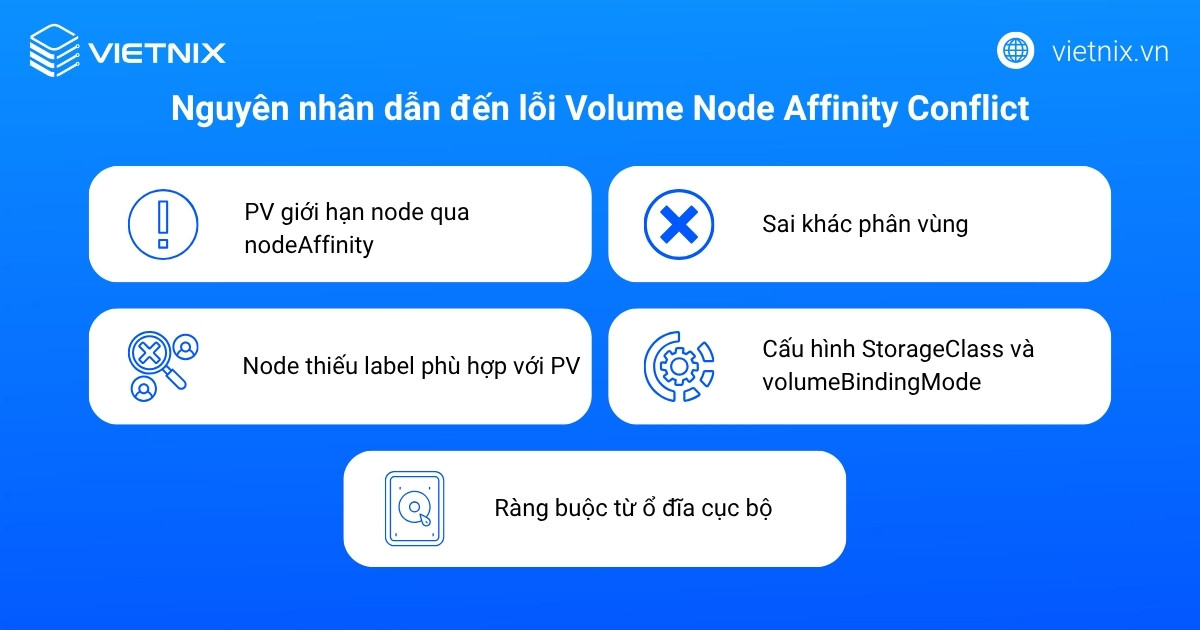

Nguyên nhân dẫn đến lỗi Volume Node Affinity Conflict

PV giới hạn node qua nodeAffinity

Nguyên nhân phổ biến là PersistentVolume được cấu hình spec.nodeAffinity chỉ cho phép attach lên một tập node cụ thể, thường dựa trên các label như kubernetes.io/hostname hoặc label tùy chỉnh. Khi Pod được scheduler chọn chạy trên node nằm ngoài tập node này, điều kiện nodeAffinity không được thỏa mãn nên volume không thể gắn vào node đó. Kết quả là Kubernetes ghi nhận cảnh báo volume node affinity conflict và giữ Pod ở trạng thái Pending.

Node thiếu label phù hợp với PV

Một số PV định nghĩa nodeAffinity dựa trên các label cụ thể như disktype=ssd hoặc topology.kubernetes.io/zone=zone-a, nhưng node trong cluster lại không được gán đúng các label tương ứng. Việc thiếu hoặc sai label khiến các matchExpressions trong nodeAffinity không khớp với bất kỳ node nào có thể chạy Pod. Điều này tạo ra khoảng cách giữa yêu cầu vị trí của volume và khả năng đáp ứng của node, dẫn đến cảnh báo conflict khi scheduler xử lý Pod.

Sai khác phân vùng

Trong các môi trường điện toán đám mây như AWS, GCP hay Azure, các ổ đĩa mạng (EBS, Persistent Disk) thường bị giới hạn trong một vùng khả dụng cụ thể. Nếu Pod được yêu cầu chạy ở Zone A (do cấu hình hoặc do tài nguyên các nút ở Zone B đã hết), nhưng Persistent Volume lại được khởi tạo và nằm ở Zone B, Kubernetes sẽ không thể gắn ổ đĩa đó vào Pod, dẫn đến xung đột về vị trí địa lý và gây lỗi.

Cấu hình StorageClass và volumeBindingMode

Nếu StorageClass của cụm đang được cài đặt với thuộc tính volumeBindingMode: Immediate thì hệ thống sẽ tự động tạo Persistent Volume ngay lập tức khi PVC được gửi lên mà không cần chờ Pod. Việc cấp phát quá sớm này thường dẫn đến tình trạng Volume bị đặt ở một Node hoặc Zone ngẫu nhiên. Sau đó, khi Pod chính thức được lập lịch vào một Node khác, sự xung đột về vị trí truy cập sẽ chắc chắn xảy ra.

Ràng buộc từ ổ đĩa cục bộ

Khi bạn sử dụng Local PV, dữ liệu được lưu trữ trực tiếp trên ổ cứng vật lý của một nút cụ thể. Do đó, PV sẽ mang một ràng buộc Affinity cứng nhắc là chỉ được phép chạy trên đúng nút đó. Nếu nút này bị lỗi, bị đầy tải về tài nguyên hoặc bị gắn các Taints ngăn cản Pod mới, Pod sẽ không thể chạy ở bất kỳ đâu khác vì ổ đĩa không thể di chuyển sang nút mới.

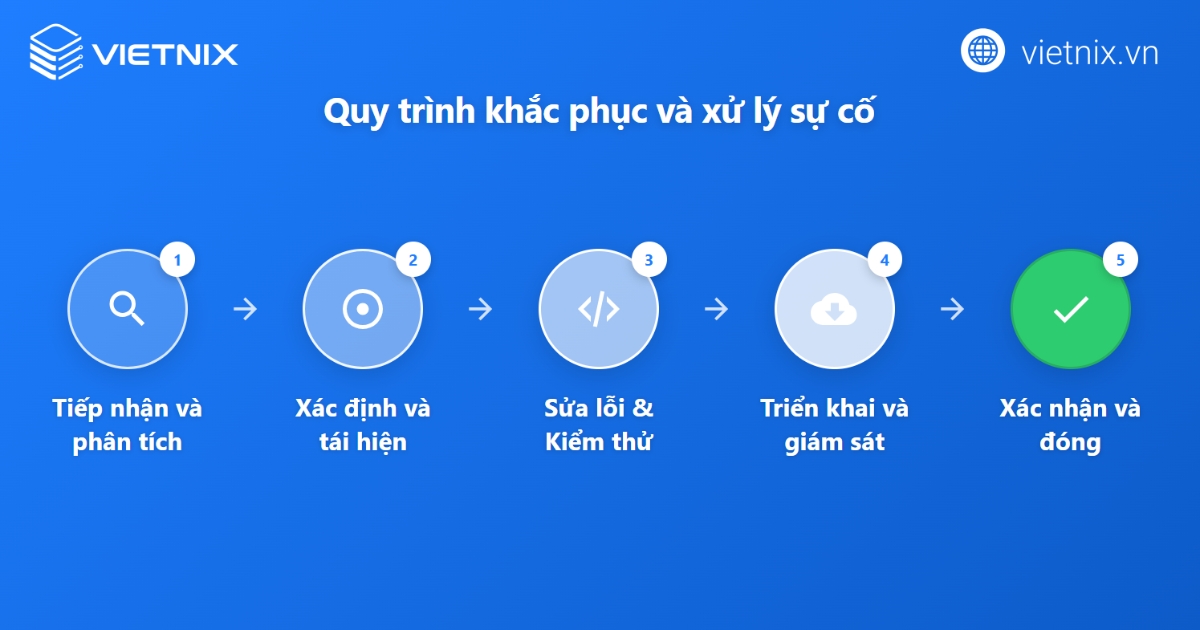

Quy trình kiểm tra và chẩn đoán lỗi Volume Node Affinity Conflict

Kiểm tra Events của Pod

Bạn dùng lệnh kubectl describe pod <pod-name> và quan sát phần Events để tìm cảnh báo dạng “N node(s) had volume node affinity conflict”. Thông tin này cho biết scheduler đã loại trừ node nào và lý do liên quan đến nodeAffinity của volume, giúp xác định vấn đề nằm ở ràng buộc volume–node thay vì các lỗi khác như thiếu tài nguyên hay taints.

Xem chi tiết PVC và PV

Bạn sử dụng kubectl get pvc và kubectl describe pvc <pvc-name> để xác định PVC được Pod sử dụng, sau đó dùng kubectl get pv và kubectl describe pv <pv-name> để kiểm tra cấu hình PV tương ứng. Trong phần mô tả PV, bạn cần chú ý các trường spec.nodeAffinity, storageClassName, cùng thông tin về zone/region hoặc label ràng buộc, rồi đối chiếu với node mà Pod đang được scheduler để phát hiện sự không khớp dẫn đến conflict.

Đối chiếu node labels và topology

Chạy kubectl get nodes --show-labels hoặc kubectl describe node <ode-name> để thu thập đầy đủ các label của node, bao gồm zone, region và các label tùy chỉnh như disktype. Sau đó bạn so sánh các label này với điều kiện trong spec.nodeAffinity.required.nodeSelectorTerms và matchExpressions của PV, cũng như topology (zone/region), để xác định label hoặc vùng nào không đáp ứng ràng buộc volume, từ đó khoanh vùng chính xác nơi xảy ra volume node affinity conflict.

Quan điểm của mình: Trong môi trường vận hành thực tế, bạn hãy bám sát chuỗi lệnh describe Pod > describe PVC/PV > đối chiếu node labels luôn cho kết quả nhanh và rõ ràng hơn so với việc thử chỉnh cấu hình “đoán mò”, giúp tránh phát sinh thêm lỗi scheduler khó truy vết về sau.

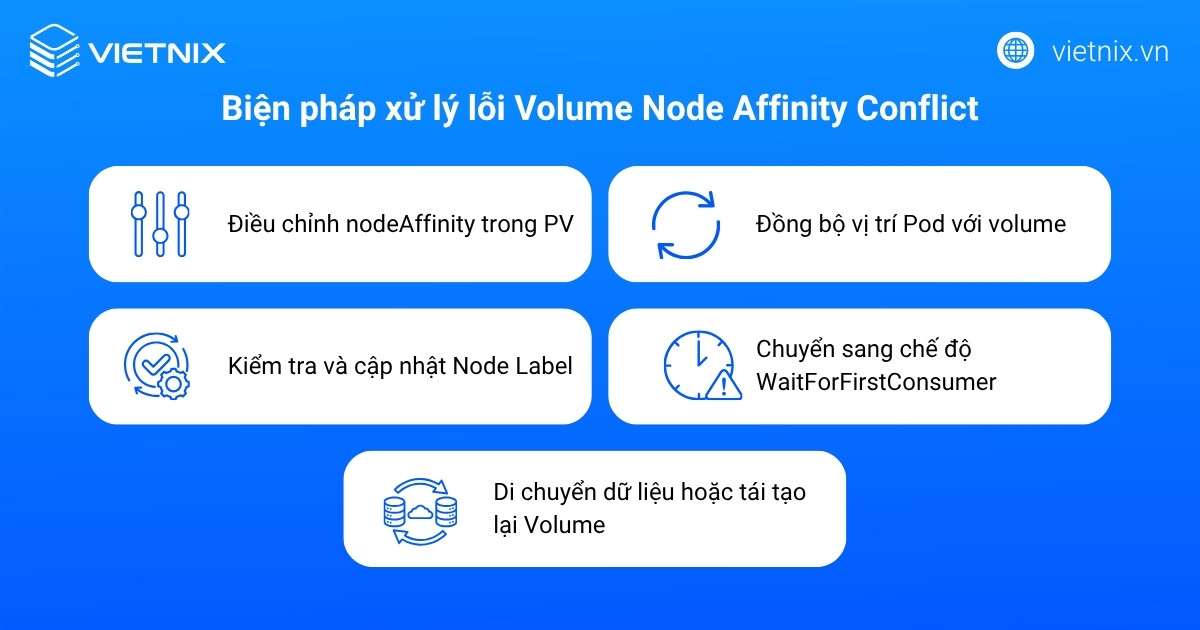

Biện pháp xử lý lỗi Volume Node Affinity Conflict

Điều chỉnh nodeAffinity trong PV

Cách xử lý đầu tiên là cập nhật trường spec.nodeAffinity trong PersistentVolume để tập node được phép attach volume phù hợp hơn với thực tế cluster. Quản trị viên có thể điều chỉnh lại các matchExpressions trong required.nodeSelectorTerms, ví dụ nới điều kiện về label zone, region hoặc hostname cho khớp với nhiều node hơn. Khi các điều kiện nodeAffinity được đồng bộ với topology và hệ thống labels hiện có, khả năng scheduler gặp volume node affinity conflict trong quá trình đặt Pod sẽ giảm đáng kể.

Kiểm tra và cập nhật Node Label

Trong trường hợp nodeAffinity trên PV đã phản ánh đúng đặc tính phần cứng hoặc zone của volume, nhưng node chưa có label tương ứng, giải pháp là gán hoặc chỉnh sửa label cho node. Bạn hãy sử dụng lệnh kubectl get nodes --show-labels để liệt kê toàn bộ nhãn hiện tại trên Node.

Nếu hệ thống báo thiếu nhãn tương thích, bạn phải bổ sung nhãn chính xác cho Node đó bằng cú pháp lệnh kubectl label node = để Pod và Volume có thể nhận diện nhau. Cách làm này phù hợp khi volume gắn với tài nguyên vật lý hoặc vùng cụ thể và cần để node khai báo đúng đặc điểm đó thông qua labels để tránh conflict.

Đồng bộ vị trí Pod với volume

Một hướng xử lý khác là điều chỉnh cấu hình Pod hoặc Deployment để Pod được schedule đúng lên những node tương thích với volume. Việc thêm nodeSelector hoặc nodeAffinity vào spec của Pod giúp ràng buộc Pod chạy trên các node có label phù hợp với nodeAffinity của PV. Khi vị trí Pod được đồng bộ với vị trí hoặc đặc tính của volume, scheduler có thể thỏa mãn đồng thời cả yêu cầu của Pod và ràng buộc của volume, qua đó loại bỏ lỗi volume node affinity conflict.

Chuyển sang chế độ WaitForFirstConsumer

Để khắc phục lỗi sai lệch vùng khả dụng, bạn cần thay đổi cấu hình volumeBindingMode bên trong StorageClass từ Immediate sang WaitForFirstConsumer. Thay đổi này sẽ buộc hệ thống Kubernetes phải trì hoãn việc tạo ra Persistent Volume cho đến khi Pod sử dụng PVC đó được lập lịch thành công vào một Node cụ thể. Nhờ cơ chế này, Volume và Pod sẽ luôn được khởi tạo cùng nhau trong một Availability Zone, qua đó đảm bảo khả năng kết nối thông suốt.

Di chuyển dữ liệu hoặc tái tạo lại Volume

Trong trường hợp ổ đĩa và Pod bắt buộc phải nằm ở hai vùng khác nhau mà không thể thay đổi cấu hình, giải pháp cuối cùng là sao lưu dữ liệu hiện tại, xóa PVC/PV cũ và tạo lại chúng ở vùng mong muốn. Đối với môi trường Cloud, bạn có thể tạo một Snapshot của ổ đĩa hiện tại, sau đó tạo một Volume mới từ Snapshot đó tại vùng mà Pod đang cố gắng khởi chạy để giải quyết triệt để xung đột.

Quan điểm của mình: Trong thực tế vận hành, mình ưu tiên áp dụng các bước ít rủi ro trước như chỉnh nodeAffinity, đồng bộ node label và dùng WaitForFirstConsumer, chỉ dùng tới phương án di chuyển dữ liệu hoặc tái tạo volume khi đã đánh giá kỹ tác động và có kế hoạch backup, rollback rõ ràng cho toàn bộ workload liên quan.

Vietnix – Nền tảng Enterprise Cloud mạnh mẽ cho mọi giải pháp Kubernetes và lưu trữ

Để hạn chế tối đa các lỗi về Affinity, Vietnix Enterprise Cloud cung cấp giải pháp Self-service portal hiện đại, cho phép khởi tạo Cloud Server chỉ trong 30 giây. Hệ thống hỗ trợ quản lý qua API chuẩn quốc tế, tích hợp mượt mà với CI/CD và các công cụ DevOps như Kubernetes. Với cơ chế tự động di chuyển khi gặp sự cố phần cứng, ứng dụng của bạn luôn được đảm bảo hoạt động liên tục, giúp tối ưu chi phí và tăng trưởng bền vững.

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

Tại sao lỗi này thường xảy ra trong các cụm Kubernetes đa vùng?

Lỗi này thường xảy ra trong các cụm đa vùng vì nhiều loại storage backend (như AWS EBS, GCE PD) bị ràng buộc theo vùng. Một volume được tạo trong zone-a không thể được gắn vào một node trong zone-b. Nếu volumeBindingMode là Immediate, volume có thể được tạo ngẫu nhiên ở một zone và sau đó scheduler có thể đặt Pod ở một zone khác, gây ra xung đột.

Nếu tôi muốn một Pod luôn chạy trên cùng một node với volume của nó, tôi nên sử dụng cơ chế nào?

Bạn nên sử dụng nodeSelector hoặc nodeAffinity trong cả Pod spec và PV spec để đảm bảo chúng cùng trỏ đến các node có cùng một tập nhãn. Ngoài ra, sử dụng StatefulSet cũng là một giải pháp tốt vì nó cung cấp danh tính ổn định cho Pod, giúp duy trì mối liên kết với volume của nó.

Có cách nào để tự động thêm node labels cho các node trong cluster không?

Có, Kubernetes và các nhà cung cấp đám mây thường tự động thêm các nhãn tiêu chuẩn cho các node, bao gồm thông tin về zone (topology.kubernetes.io/zone), region (topology.kubernetes.io/region), kiến trúc (kubernetes.io/arch) và hệ điều hành (kubernetes.io/os). Bạn cũng có thể sử dụng các công cụ như Node Feature Discovery (NFD) để tự động phát hiện và gán nhãn cho các node dựa trên các đặc điểm phần cứng của chúng.

Lỗi Volume Node Affinity Conflict là một thách thức phổ biến khi làm việc với các ứng dụng stateful trên Kubernetes, đặc biệt trong các môi trường đa vùng. Bằng cách hiểu rõ nguyên nhân, áp dụng các bước chẩn đoán có hệ thống và quan trọng hơn là thiết kế kiến trúc lưu trữ phù hợp ngay từ đầu, các nhà phát triển và quản trị viên có thể phòng tránh hiệu quả lỗi Volume Node Affinity Conflict, đảm bảo tính sẵn sàng và ổn định cho các ứng dụng quan trọng.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày