Deindex là gì? Cách kiểm tra và khắc phục tình trạng Deindex

Đánh giá

Deindex là kỹ thuật SEO quan trọng giúp bạn kiểm soát cách công cụ tìm kiếm thu thập dữ liệu và lưu trữ (index) các website. Tối ưu hóa deindex giúp cải thiện hiệu suất SEO và tăng trưởng truy cập cho website. Cùng Vietnix tìm hiểu ngay Deindex là gì, nguyên nhân và cách khắc phục nếu website của bạn đang bị deindex?

Deindex là gì?

Deindex (hay còn gọi là de-indexing) là kỹ thuật SEO quan trọng, liên quan đến việc loại bỏ một website hoặc một URL cụ thể khỏi chỉ mục tìm kiếm của Google (và các công cụ tìm kiếm khác). Điều này có nghĩa là website hoặc trang web đó sẽ không còn xuất hiện trong kết quả tìm kiếm khi người dùng tìm kiếm bằng các từ khóa liên quan.

Deindex có thể được áp dụng cho toàn bộ website hoặc một số trang web cụ thể, tùy thuộc vào mục tiêu SEO và chiến lược nội dung của bạn. Hiểu rõ về tác động và cách sử dụng từng loại deindex là rất quan trọng để tối ưu hóa SEO hiệu quả.

Có 2 loại Deindex chính là:

- Deindex toàn bộ website: Thường được sử dụng khi website đang gặp vấn đề nghiêm trọng về SEO hoặc bảo mật, cần xử lý triệt để trước khi index lại.

Dẫn đến tình trạng toàn bộ URL trên website biến mất khỏi kết quả tìm kiếm, lưu lượng truy cập sẽ giảm mạnh. Cần đảm bảo đã khắc phục tất cả các vấn đề trước khi index lại website.

2. Deindex một số URL: Thường áp dụng deindex để tối ưu hoá cấu trúc website, tránh nội dung trùng lặp và tập trung vào các trang quan trọng.

Tác động với các URL bị deindex và sẽ không tìm thấy trên SERP, traffic sẽ càng giảm. Nhưng cũng có ưu điểm nếu biết cách sử dụng deindex sẽ giúp cải thiện thứ hạng cho các trang quan trọng, nâng cao trải nghiệm tốt hơn.

Vai trò của deindex

Deindex đóng vai trò quan trọng trong chiến lược SEO, giúp kiểm soát cách công cụ tìm kiếm thu thập dữ liệu và index website, từ đó cải thiện hiệu suất SEO và tăng trưởng organic. Sử dụng deindex một cách có chiến lược và cẩn trọng để tối ưu hóa website và đạt được mục tiêu SEO.

Vai trò của deindex trong SEO:

- Cải thiện chất lượng index: Loại bỏ các trang không quan trọng hoặc trùng lặp nội dung khỏi chỉ mục tìm kiếm giúp công cụ tìm kiếm tập trung vào các trang chất lượng cao và liên quan, từ đó cải thiện thứ hạng trên SERPs.

- Tăng cường trải nghiệm người dùng: Loại bỏ các trang lỗi, spam hoặc nội dung mỏng (thin content) giúp cải thiện trải nghiệm người dùng, giảm tỷ lệ thoát và tăng thời gian người dùng ở lại website.

- Tối ưu hóa crawl budget: Hướng dẫn công cụ tìm kiếm thu thập dữ liệu các trang quan trọng hơn, tiết kiệm crawl budget và đảm bảo các trang quan trọng được index hiệu quả.

- Bảo vệ thông tin nhạy cảm: Deindex các trang chứa thông tin nhạy cảm để ngăn chặn truy cập trái phép và bảo vệ dữ liệu.

Rủi ro và hạn chế của Deindex:

- Giảm lưu lượng truy cập: Nếu deindex các trang quan trọng hoặc thu hút nhiều traffic, lưu lượng truy cập website có thể giảm.

- Mất backlink: Deindex các trang có backlink chất lượng có thể ảnh hưởng đến độ uy tín và thứ hạng website.

Sử dụng deindex một cách chiến lược và phù hợp với mục tiêu SEO và tình trạng website của bạn. Theo dõi hiệu suất SEO sau khi deindex để đánh giá tác động và điều chỉnh nếu cần.

Nguyên nhân dẫn đến tình trạng Deindex

Phần trên có nhắc tới deindex chủ động, và có một phần deindex bị động (do Google tác động đến) và bị mất index hàng loạt URL trên kết quả tìm kiếm. Hãy cùng tìm hiểu nguyên nhân nếu bạn đang gặp vấn đề này?

Deindex có thể xảy ra do nhiều nguyên nhân, ảnh hưởng đến hiệu suất SEO và khả năng hiển thị website trên công cụ tìm kiếm. Hiểu rõ các nguyên nhân và cách khắc phục giúp bạn bảo vệ website và duy trì thứ hạng.

Nguyên nhân dẫn đến tình trạng deindex:

- Vi phạm Hướng dẫn chất lượng dành cho quản trị viên trang web của Google:

- Nội dung spam: Sử dụng kỹ thuật SEO mũ đen (black hat) như nhồi nhét từ khóa, che giấu nội dung, mua backlink hoặc tạo nội dung tự động có thể khiến website bị Google phạt và deindex.

- Nội dung mỏng: Website có ít nội dung hoặc nội dung chất lượng thấp không mang lại giá trị cho người dùng có thể bị deindex.

- Backlink bẩn: Website có nhiều liên kết đến các trang web spam hoặc không liên quan có thể bị deindex.

- Vi phạm bản quyền: Website sao chép nội dung từ website khác mà không có sự cho phép có thể bị deindex.

- Chất lượng website kém:

- Trải nghiệm người dùng trên website kém: Website khó điều hướng, tốc độ tải trang chậm, không thân thiện với thiết bị di động hoặc giao diện khó sử dụng có thể bị deindex.

- Nội dung không liên quan: Website có nội dung không liên quan đến từ khóa hoặc chủ đề mà người dùng tìm kiếm có thể bị deindex.

- Lỗi Technical website:

- Lỗi 404: Lỗi 404 xảy ra khi trang web không tồn tại hoặc không thể truy cập được. Quá nhiều lỗi 404 có thể ảnh hưởng đến SEO và có thể dẫn đến bị deindex.

- Lỗi robots.txt: File robots.txt bị cấu hình sai có thể chặn công cụ tìm kiếm thu thập dữ liệu website.

- Lỗi sitemap: Sitemap bị lỗi hoặc không cập nhật có thể khiến công cụ tìm kiếm không index các trang mới.

- Bị tấn công:

- Website bị hack: Nếu website bị hacker tấn công và chèn mã độc, Google có thể deindex website để bảo vệ người dùng.

- Tấn công DDoS: Tấn công DDoS có thể khiến website không thể truy cập được.

Hướng dẫn cách kiểm tra website có bị deindex hay không?

Kiểm tra xem website của bạn có bị deindex hay không là bước quan trọng trong quá trình SEO. Phát hiện và khắc phục tình trạng deindex kịp thời giúp duy trì thứ hạng và tăng trưởng organic traffic của website.

Cách 1: Kiểm tra deindex bằng cách tìm kiếm website trên Google

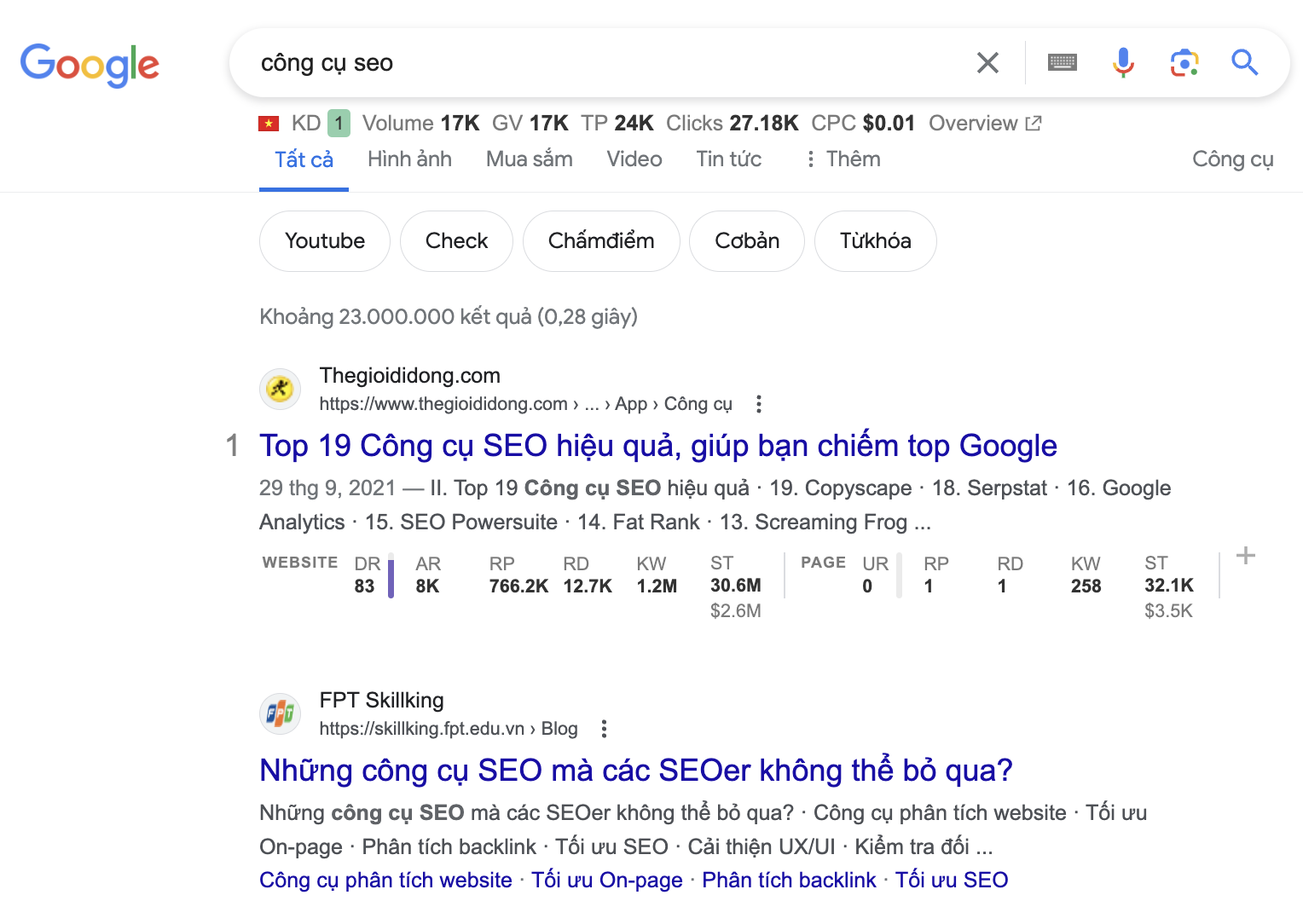

- Bước 1: Sử dụng cú pháp site:url (thay url bằng URL thực tế của bạn như site:https://vietnix.vn/cong-cu-seo/)

- Bước 2: Nếu không hiển thị ra bài viết “https://vietnix.vn/cong-cu-seo/” khi search thì rất có thể URL đã bị deindex. Hoặc khi bạn search từ khoá “công cụ seo” nhưng không thấy website của mình (Bình thường đang ở Top 2).

Cách 2: Sử dụng tool Spineditor

- Bước 1: Lấy URL ở sitemap website của bạn > Copy toàn bộ URL ra 1 file.

- Bước 2: Truy cập Spineditor > Menu nằm bên trái “Kiểm tra tên miền” > Sau đó dán danh sách URL vào > Bấm tải link > Tiếp đến nhấn vào Tự động nhập captcha > Và nhấn Check index >

- Bước 3: Sau đó kiểm tra cột Google index để biết có URL nào bị mất index hay không.

Cách 3: Sử dụng công cụ Google Search Console

- Bước 1: Truy cập vào Google Search Console.

- Bước 2: Copy URL cần kiểm tra vào thanh search Inspect Tool > Kiểm tra trạng thái Index của URL. Nếu URL đó vẫn được index nhưng kiểm tra ở ngoài Google không hiển thị, rất có thể URL đó bị deindex.

Cách khắc phục tình trạng Deindex

Bị deindex khỏi kết quả tìm kiếm Google là cơn ác mộng của bất kỳ chủ website nào. Điều này đồng nghĩa với việc website của bạn hoàn toàn mất khả năng hiển thị trên SERPs và traffic tự nhiên sẽ tụt dốc thảm hại. Tuy nhiên, đừng vội thất vọng! Việc khôi phục website sau khi bị deindex là hoàn toàn khả thi nếu bạn hiểu rõ nguyên nhân và thực hiện các bước khắc phục đúng đắn.

1. Bước 1: Xác định nguyên nhân deindex

Đầu tiên, hãy truy cập Google Search Console để kiểm tra các cảnh báo hoặc thông báo từ Google. Công cụ này cung cấp thông tin chi tiết về sức khỏe SEO của website, bao gồm các vấn đề có thể dẫn đến deindex như:

- Vi phạm hướng dẫn chất lượng của Google: Website của bạn có thể chứa nội dung spam, cloaking, hoặc các kỹ thuật black hat SEO khác.

- Lỗi technical: Các vấn đề về robots.txt, thẻ meta robots, canonical tag, hoặc cấu trúc website có thể ngăn cản Googlebot thu thập dữ liệu và lập chỉ mục website của bạn.

- Nội dung trùng lặp: Website có quá nhiều nội dung trùng lặp với các trang web khác.

- Backlink xấu, spam: Website của bạn chứa nhiều backlink từ các trang web kém chất lượng hoặc spam.

- Bị tấn công: Website bị hacker tấn công và chèn mã độc hoặc nội dung độc hại.

- Chất lượng nội dung thấp: Nội dung website không cung cấp giá trị cho người dùng, hoặc bị đánh giá là thin content.

- Trải nghiệm người dùng trên website thấp: Website có tốc độ tải trang chậm, giao diện khó sử dụng, hoặc không thân thiện với thiết bị di động.

2. Bước 2: Khắc phục sự cố

Sau khi xác định được nguyên nhân website đang gặp phải, hãy tập trung vào việc khắc phục sự cố một cách triệt để. Và còn tuỳ thuộc vào nguyên nhân website của bạn là gì nữa.

- Xoá nội dung spam hoặc các kỹ thuật SEO Blackhat.

- Kiểm tra và cập nhật lại file robots.txt theo đúng cấu trúc để Google đọc được.

- Sửa lỗi Canonical tag.

- Audit lại nội dung các bài viết thin content hoặc duplicate đầy đủ và mang lại giá trị cho người dùng.

- Tối ưu lại tốc độ tải trang và đảm bảo vượt qua được Core Web Vitals.

- Lọc các backlink kém chất lượng hoặc bị spam để thực hiện Disavow backlink.

- Khắc phục lỗ hổng bảo mật và tăng cường bảo mật website.

- …

3. Bước 3: Gửi yêu cầu Google xem xét lại

Sau khi đã khắc phục tất cả các vấn đề, bạn có thể gửi yêu cầu xem xét lại cho Google thông qua Google Search Console. Trong yêu cầu, hãy giải thích chi tiết những gì bạn đã làm để khắc phục sự cố và đảm bảo rằng website của bạn hiện tuân thủ hướng dẫn của Google. (Hoặc submit lại các URL và sitemap trên Google Search Console).

Quá trình khôi phục website sau khi bị deindex có thể mất thời gian và công sức. Tuy nhiên, với sự kiên nhẫn và nỗ lực, bạn hoàn toàn có thể đưa website của mình index trở lại tìm kiếm của Google và tiếp tục thu hút lưu lượng truy cập tự nhiên từ người dùng.

Lời kết

Trên đây là toàn bộ thông tin mà Vietnix muốn chia sẻ với bạn về khái niệm deindex là gì và hướng dẫn các cách khắc phục nếu gặp tình trạng deindex. Mong rằng những thông tin này sẽ giúp bạn hiểu rõ hơn về deindex và có những chiến lược và khắc phục tốt trong quá trình SEO. Nếu có bất kỳ câu hỏi hoặc cần thêm thông tin, đừng ngần ngại liên hệ để được hỗ trợ thêm.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày