Ensemble learning là gì? Các loại mô hình và ứng dụng thực tế của ensemble learning

Đã kiểm duyệt nội dung

Đánh giá

Ensemble learning là kỹ thuật học máy kết hợp nhiều mô hình dự đoán để tạo ra kết quả chính xác và ổn định hơn so với từng mô hình riêng lẻ. Bài viết này được mình đúc kết từ hàng trăm giờ xử lý dữ liệu thực tế, nhằm giúp bạn hiểu rõ và ứng dụng thành công kỹ thuật Ensemble Learning, giúp tối ưu hóa độ chính xác và sự ổn định cho các mô hình AI.

Những điểm chính

- Quan điểm của mình: Ensemble learning đóng vai trò là bộ công cụ giúp cân bằng giữa độ lệch và phương sai, từ đó cải thiện đáng kể khả năng dự báo của hệ thống.

- Khái niệm Ensemble learning: Hiểu rõ Ensemble learning là kỹ thuật kết hợp nhiều mô hình, giúp tạo ra kết quả dự đoán chính xác và ổn định hơn so với từng mô hình riêng lẻ.

- Cách kết hợp: Nắm được ba kỹ thuật ensemble phổ biến là Bagging, Boosting và Stacking, giúp bạn hiểu rõ cách các mô hình được huấn luyện và kết hợp để cải thiện hiệu suất chung.

- Các loại mô hình: Phân biệt các phương pháp Parallel và Sequential, giúp bạn hiểu cách các mô hình thành phần được huấn luyện để tạo ra một tổ hợp hiệu quả.

- Khi nào nên dùng: Biết được các tình huống lý tưởng để áp dụng Ensemble Learning, giúp bạn tối ưu hóa hiệu suất khi dữ liệu có nhiễu hoặc mất cân bằng.

- Các dạng học tập tổ hợp: Nắm được các phương pháp cơ bản như Max Voting, Averaging và Weighted Average, giúp bạn lựa chọn cách kết hợp mô hình phù hợp cho từng bài toán.

- Ưu và nhược điểm: Đánh giá được các ưu điểm và nhược điểm, giúp bạn cân nhắc khi nào nên và không nên sử dụng kỹ thuật này.

- Ứng dụng: Biết được các ứng dụng phổ biến trong y tế, tài chính và phân tích cảm xúc, giúp bạn hình dung cách Ensemble learning giải quyết các bài toán thực tế.

- Biết thêm Vietnix: Tìm hiểu về VPS Vietnix, giúp có thêm lựa chọn hạ tầng ảo riêng, hiệu năng cao cho doanh nghiệp.

- Câu hỏi thường gặp: Được giải đáp các thắc mắc về các phương pháp phổ biến, cách hoạt động của Bagging và các bài toán ứng dụng, giúp củng cố kiến thức và làm rõ các vấn đề kỹ thuật.

Ensemble learning là gì?

Ensemble learning (Học tập tổ hợp) là một kỹ thuật trong học máy, trong đó nhiều mô hình dự đoán (thường được gọi là “base learners”) được kết hợp với nhau để giải quyết cùng một bài toán. Thay vì dựa vào một mô hình duy nhất, phương pháp này tổng hợp kết quả từ nhiều mô hình để đạt được độ chính xác cao hơn và khả năng dự báo ổn định

Về bản chất, học tập tổ hợp dựa trên ý tưởng nhiều mô hình cùng hỗ trợ nhau. Mỗi mô hình riêng lẻ đều có ưu và nhược điểm, nhưng khi kết hợp chúng một cách hợp lý, mô hình tổ hợp thường cho kết quả ổn định và chính xác hơn hẳn.

Để huấn luyện các mô hình ensemble learning phức tạp một cách mượt mà, bạn cần một hạ tầng máy chủ ảo đủ mạnh. Dịch vụ VPS NVMe tại Vietnix chính là giải pháp lý tưởng nhờ tích hợp CPU AMD EPYC 7002 và ổ cứng NVMe Enterprise siêu tốc. Sự kết hợp này mang lại tốc độ truy xuất dữ liệu vượt trội, giúp rút ngắn đáng kể thời gian đọc dữ liệu, tăng tốc quá trình huấn luyện mô hình học máy và duy trì sự ổn định tối đa cho hệ thống của bạn.

Website nhanh hơn – Bán được nhiều hàng hơn

- Chiếm lĩnh TOP Google, hút traffic.

- Mua sắm mượt mà, tăng tỷ lệ chốt đơn.

- Chuyên gia kỹ thuật đồng hành 24/7.

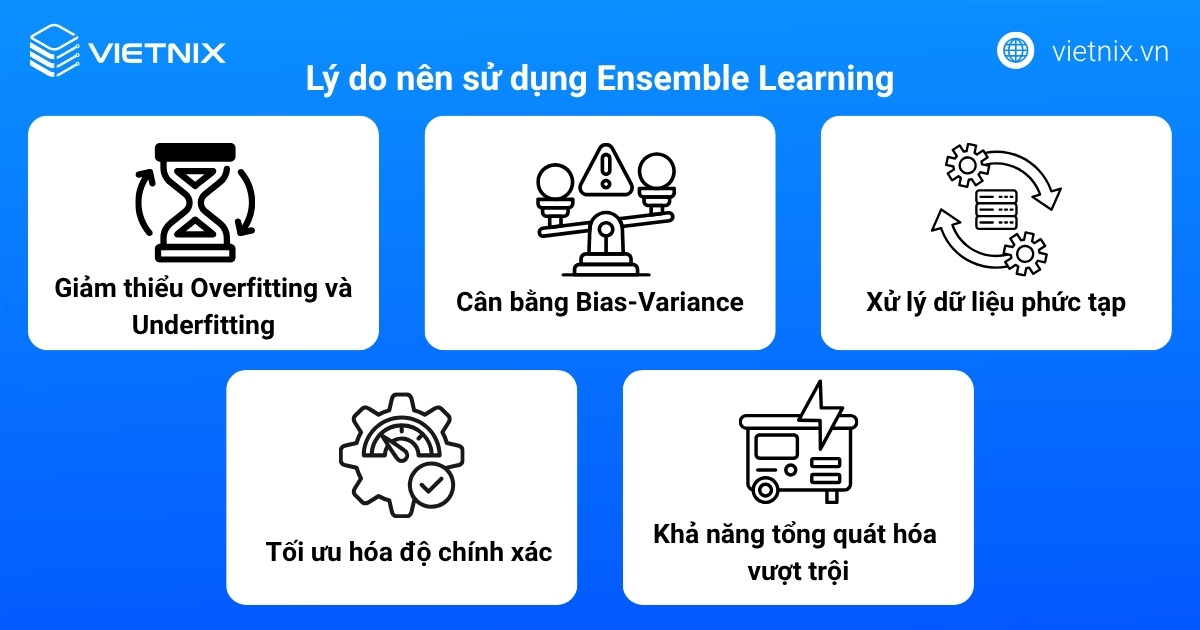

Tại sao nên sử dụng Ensemble Learning?

Học tập tổ hợp mang lại nhiều lợi ích vượt trội, giải quyết trực tiếp các vấn đề cốt lõi của việc huấn luyện mô hình:

- Giảm thiểu Overfitting và Underfitting: Bằng cách tổng hợp dự đoán, hệ thống triệt tiêu được hiện tượng học vẹt theo dữ liệu mẫu (overfitting) của từng cá nhân, đồng thời tránh việc bỏ sót các quy luật quan trọng (underfitting).

- Cân bằng Bias-Variance: Ensemble learning giải quyết bài toán kinh điển này bằng cách lấy trung bình các mô hình có phương sai cao (để giảm phương sai) hoặc kết hợp tuần tự các mô hình có độ lệch cao (để giảm độ lệch).

- Xử lý dữ liệu phức tạp: Nhờ kết hợp nhiều cách tiếp cận khác biệt, mô hình tổ hợp có khả năng nhận diện các đặc trưng phức tạp trong hình ảnh, ngôn ngữ tự nhiên mà một thuật toán đơn lẻ không thể nắm bắt.

- Tối ưu hóa độ chính xác: Kết hợp các mô hình đa dạng giúp hệ thống nắm bắt được nhiều mẫu phức tạp trong dữ liệu, từ đó đẩy độ chính xác lên mức tối đa.

- Khả năng tổng quát hóa vượt trội: Giúp mô hình hoạt động bền bỉ, không bị đánh lừa bởi dữ liệu nhiễu và đưa ra dự đoán tốt hơn khi gặp dữ liệu thực tế mới.

Góc nhìn chuyên gia: Theo quan điểm của mình, dù ensemble learning mang lại hiệu suất cao hơn nhưng bạn vẫn cần cân nhắc kỹ sự đánh đổi giữa hiệu năng và chi phí tính toán. Nếu một mô hình Decision Tree đơn giản đã giải quyết tốt 90% bài toán, việc nhồi nhét thêm các thuật toán tổ hợp phức tạp chỉ để tăng 1-2% độ chính xác có thể là sự lãng phí tài nguyên máy chủ vô ích.

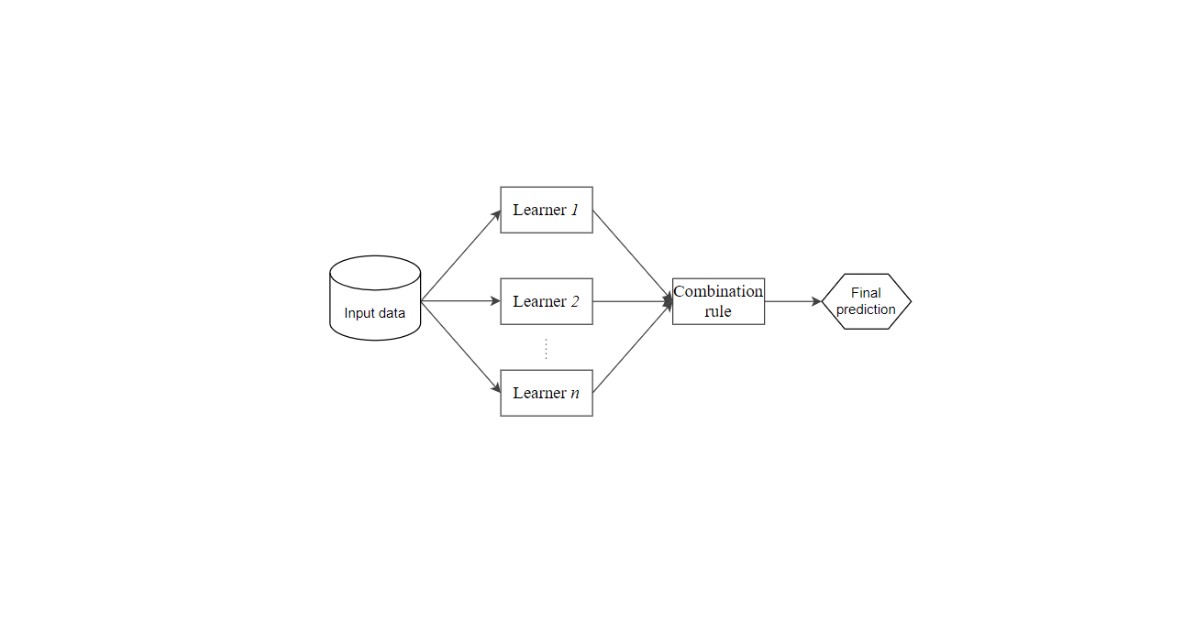

Cách kết hợp nhiều mô hình trong ensemble learning

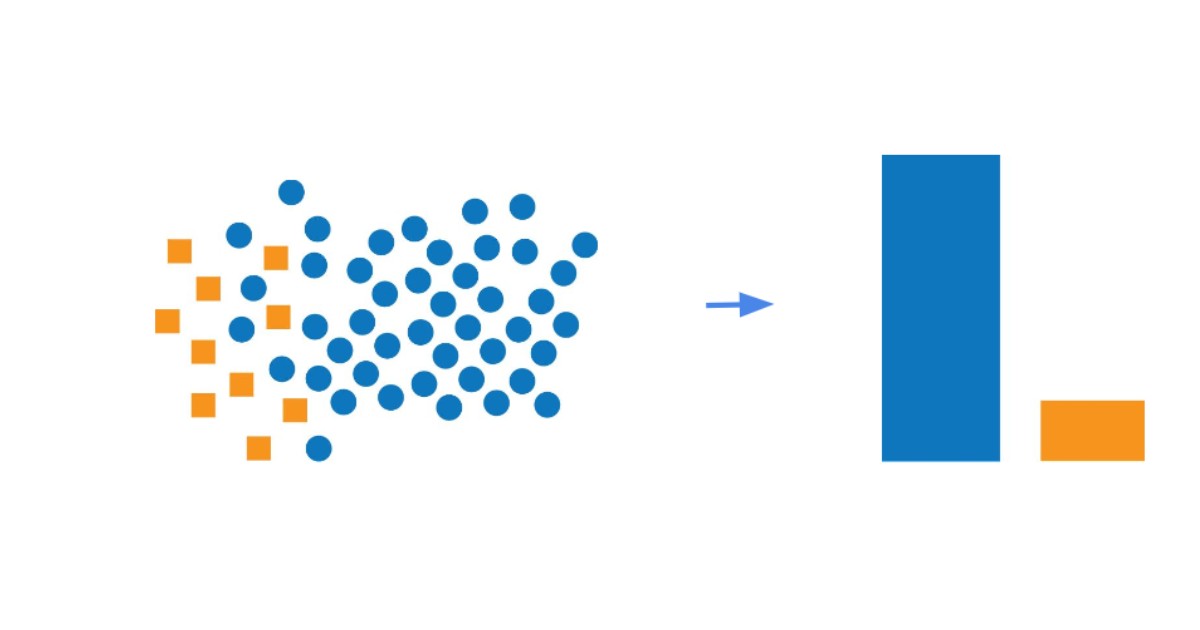

Giả sử có sẵn nhiều mô hình khác nhau và mục tiêu là kết hợp chúng thành một mô hình tổ hợp cho kết quả dự đoán tốt hơn. Quy trình có thể tóm tắt như sau:

Bước 1: Chọn mô hình nền

Trước tiên, chọn một loại mô hình làm nền cho thuật toán, ví dụ Decision Tree, sau đó khởi tạo nhiều mô hình cùng loại (n cây quyết định) và huấn luyện chúng với các cấu hình hoặc mẫu dữ liệu khác nhau để tạo ra sự đa dạng.

Khi lựa chọn, bạn cần cân nhắc đặc tính bias variance: Nếu mô hình đơn có bias thấp nhưng variance cao thì mô hình tổ hợp nên hướng tới giảm variance, nếu mô hình có bias cao nhưng variance thấp thì mô hình tổ hợp nên ưu tiên giảm bias.

Bước 2: Áp dụng các kỹ thuật ensemble phổ biến

Các kỹ thuật ensemble phổ biến, bao gồm:

- Bagging: Kỹ thuật này xây dựng nhiều mô hình trên các tập con dữ liệu được lấy mẫu ngẫu nhiên (có hoàn lại) từ cùng một tập huấn luyện. Các mô hình được huấn luyện độc lập, sau đó kết hợp đầu ra bằng trung bình hoặc bỏ phiếu. Bagging chủ yếu giúp giảm variance (Ví dụ tiêu biểu: Random Forest).

- Boosting: Xây dựng một dãy các mô hình huấn luyện tuần tự. Ở mỗi bước, mô hình mới sẽ học cách sửa những lỗi mà mô hình trước đó dự đoán sai bằng cách tăng trọng số cho các điểm dữ liệu bị phân loại nhầm. Nhờ đó, chuỗi mô hình dần cải thiện sai số và giảm thiểu bias của hệ thống.

- Stacking: Huấn luyện nhiều mô hình cơ sở (thường khác loại) một cách độc lập. Sau đó, một mô hình cấp cao hơn sẽ nhận đầu vào chính là dự đoán của các mô hình này và học cách kết hợp chúng sao cho đạt hiệu quả tốt nhất.

- Blending: Tương tự như Stacking, Blending cũng sử dụng một meta-model để tổng hợp dự đoán từ các mô hình cơ sở. Tuy nhiên, thay vì sử dụng kỹ thuật K-fold cross-validation trên toàn bộ tập train như Stacking, Blending chỉ sử dụng một tập dữ liệu validation riêng biệt để huấn luyện meta-model. Kỹ thuật này giúp tránh rò rỉ dữ liệu và dễ triển khai hơn, dù có thể tốn một phần dữ liệu cho tập validation.

Nhìn chung, Bagging thường được dùng để giảm variance, trong khi Boosting và Stacking tập trung nhiều hơn vào việc giảm bias (đồng thời có thể tác động đến variance).

Lựa chọn của chuyên gia: Mặc dù cả 4 phương pháp đều mạnh mẽ, nhưng nếu bạn đang phải đối mặt với một tập dữ liệu mất cân bằng nghiêm trọng (ví dụ: phát hiện giao dịch lừa đảo trong hàng triệu giao dịch bình thường) và ưu tiên độ chính xác tuyệt đối, mình khuyên dùng Boosting (đặc biệt là XGBoost hoặc LightGBM). Trong khi đó, nếu hệ thống yêu cầu tính ổn định cao và chống Overfit tốt, Bagging (Random Forest) luôn là sự lựa chọn an toàn nhất.

Các loại kiến trúc ensemble

Phương pháp ensemble learning thường được chia thành hai nhóm kiến trúc chính dựa trên quy trình huấn luyện: Parallel và sequential.

- Parallel (Song song): Các mô hình thành phần được huấn luyện tách biệt, không phụ thuộc lẫn nhau. Do đó, chúng có thể được chạy đồng thời để tiết kiệm thời gian tính toán.

- Sequential (Tuần tự): Mỗi mô hình mới được huấn luyện dựa trên kết quả của mô hình trước đó. Quá trình này diễn ra lần lượt qua từng giai đoạn nhằm khắc phục dần các sai số.

Khi nào nên dùng ensemble learning?

Ensemble Learning phù hợp nhất trong hai tình huống sau:

Khi dữ liệu có nhiều nhiễu

Khi dữ liệu chứa nhiều lỗi, giá trị ngoại lệ hoặc thông tin không liên quan, mô hình đơn lẻ dễ bị overfit và phương sai cao. Các kỹ thuật như bagging sẽ huấn luyện nhiều mô hình trên các tập con dữ liệu khác nhau rồi tổng hợp dự đoán, nhờ đó giảm ảnh hưởng của nhiễu và cho kết quả ổn định hơn.

Khi tập dữ liệu bị mất cân bằng

Trong các bài toán mà một lớp chiếm ưu thế (như phát hiện gian lận), mô hình đơn thường bỏ qua lớp thiểu số dù độ chính xác tổng thể cao. Lúc này, kỹ thuật Boosting (AdaBoost, Gradient Boosting) gia tăng trọng số cho các mẫu bị dự đoán sai, giúp mô hình chú ý hơn đến lớp thiểu số và giảm bias. Ngoài ra, một số biến thể bagging có thể tạo các tập con dữ liệu cân bằng hơn để huấn luyện.

Các kỹ thuật Ensemble Learning cơ bản và nâng cao

Học tập tổ hợp có thể được triển khai bằng nhiều kỹ thuật khác nhau, từ các cách kết hợp đơn giản cho đến những thuật toán phức tạp hơn. Dưới đây là một số phương pháp cơ bản thường gặp và cách chúng được áp dụng:

Max Voting

Trong bài toán phân loại, mỗi mô hình thành phần (base model) sẽ đưa ra một nhãn dự đoán cho cùng một mẫu dữ liệu. Nhãn xuất hiện nhiều lần nhất trong số các dự đoán đó sẽ được chọn làm kết quả cuối cùng. Cách làm này phù hợp khi các mô hình trong tổ hợp có chất lượng tương đương và cùng tham gia vào quyết định một cách cân bằng.

Trong Max Voting, có 2 biến thể chính:

- Hard-voting: Đếm trực tiếp số lượng nhãn dự đoán. Nhãn nào nhiều vote nhất sẽ chiến thắng.

- Soft-voting: Các mô hình tính toán xác suất dự đoán cho từng nhãn. Hệ thống sẽ tính trung bình cộng xác suất của từng nhãn từ tất cả các mô hình, sau đó chọn nhãn có xác suất trung bình cao nhất

Averaging

Đối với các bài toán hồi quy (hoặc khi làm việc với xác suất dự đoán), ta có thể lấy trung bình các giá trị dự đoán từ tất cả mô hình trong tổ hợp để tạo ra kết quả cuối cùng. Cách kết hợp này giúp giảm sai số của từng mô hình riêng lẻ và thường cho ra kết quả tổng thể ổn định, chính xác hơn. Ví dụ, trong bài toán dự đoán giá nhà, việc lấy trung bình dự đoán từ ba mô hình khác nhau thường đáng tin cậy hơn so với chỉ sử dụng một mô hình duy nhất.

Weighted Average

Weighted Average là phiên bản mở rộng của phương pháp Averaging, trong đó mỗi mô hình được gán một trọng số khác nhau dựa trên hiệu suất dự đoán. Các mô hình có độ chính xác cao hoặc sai số thấp sẽ nhận trọng số lớn hơn và vì vậy tác động nhiều hơn đến kết quả cuối cùng. Cách làm này đặc biệt hữu ích khi trong tổ hợp tồn tại một vài mô hình cho kết quả nổi trội so với các mô hình còn lại.

Ưu và nhược điểm của ensemble learning

Nâng cao độ chính xác: Việc gộp dự đoán từ nhiều mô hình thường cho kết quả tốt hơn so với chỉ sử dụng một mô hình đơn lẻ.

Tăng độ ổn định: Ensemble giúp giảm nguy cơ overfitting trong nhiều trường hợp, từ đó mô hình hoạt động tin cậy hơn trên dữ liệu mới.

Tính linh hoạt cao: Các phương pháp như bagging, boosting, stacking có thể kết hợp với nhiều thuật toán và phù hợp cho nhiều dạng dữ liệu khác nhau.

Giảm phương sai: Những kỹ thuật như bagging và random forest có khả năng giảm biến động trong dự đoán, giúp đầu ra ổn định hơn.

Khả năng khái quát hóa tốt: Kết hợp nhiều mô hình giúp hệ thống thích ứng tốt hơn với dữ liệu chưa từng thấy, nên rất phù hợp cho các ứng dụng triển khai ngoài thực tế.

Độ phức tạp cao hơn: Kết hợp nhiều mô hình khiến hệ thống trở nên cồng kềnh, khó phân tích và khó giải thích hơn so với một mô hình đơn giản.

Tốn tài nguyên và thời gian huấn luyện: Việc huấn luyện và suy luận với nhiều mô hình cùng lúc làm tăng chi phí tính toán, đặc biệt trong các hệ thống cần cập nhật thường xuyên hoặc yêu cầu thời gian phản hồi thấp.

Nguy cơ overfitting: Nếu cấu hình không hợp lý (ví dụ mô hình cơ sở quá phức tạp hoặc thiếu đa dạng), một số kỹ thuật ensemble, đặc biệt là boosting vẫn có thể bị overfit trên tập huấn luyện.

Đánh giá của mình:

Ensemble Learning chắc chắn là công cụ mạnh mẽ nhất để tối đa hóa các chỉ số đo lường (như Accuracy, F1-Score). Tuy nhiên, bạn phải đánh đổi bằng chi phí tính toán và tính minh bạch của mô hình. Nếu dự án của bạn (ví dụ: duyệt hồ sơ vay vốn ngân hàng) yêu cầu tính “Explainability” (khả năng giải thích lý do từ chối khoản vay cho khách hàng theo luật pháp định), thì các mô hình tổ hợp phức tạp như Stacking sẽ mang lại rủi ro vận hành cao.

Những ứng dụng của ensemble learning

Ensemble learning không chỉ là khái niệm lý thuyết mà đã được áp dụng rộng rãi trong nhiều bài toán thực tế, đặc biệt trong các hệ thống cần độ chính xác và độ tin cậy cao. Một số ứng dụng tiêu biểu gồm:

- Y tế (phát hiện bệnh): Hỗ trợ phân loại và định vị bệnh lý trên ảnh y khoa (X-quang, CT, MRI), giúp bác sĩ chẩn đoán nhanh và chính xác hơn.

- Viễn thám (Remote Sensing): Cải thiện độ chính xác trong các tác vụ như phát hiện sạt lở đất, phân loại cảnh quan và giám sát môi trường khi dữ liệu đến từ nhiều cảm biến với độ phân giải khác nhau.

- Phát hiện gian lận: Được dùng trong phát hiện gian lận thẻ tín dụng, gian lận quảng cáo và giao dịch tài chính, nơi yêu cầu độ chính xác rất cao để tự động hóa quy trình kiểm tra.

- Nhận dạng cảm xúc trong giọng nói: Áp dụng cho các hệ thống phân tích cảm xúc, đặc biệt trong môi trường đa ngôn ngữ, bằng cách kết hợp nhiều bộ phân loại để tăng độ chính xác.

- Nông nghiệp: Dự đoán năng suất cây trồng và đánh giá rủi ro dựa trên các yếu tố như thời tiết, đất đai và lịch sử sản xuất, từ đó hỗ trợ ra quyết định trồng trọt và hoạch định sản lượng.

- Tài chính – bảo hiểm: Định giá rủi ro, chấm điểm tín dụng và xác định phí bảo hiểm bằng cách kết hợp mô hình trên dữ liệu nhân khẩu học, lịch sử giao dịch và xu hướng thị trường.

- An ninh – giám sát bất thường: Phát hiện xâm nhập mạng, hành vi bất thường hoặc bất thường trong dữ liệu cảm biến (bao gồm cả ứng dụng viễn thám cho quản lý tài nguyên và hạ tầng từ xa).

- Thể thao: Dự đoán kết quả thi đấu, phân tích hiệu suất vận động viên, hỗ trợ chiến thuật, dự đoán chấn thương và tìm kiếm tài năng thông qua việc kết hợp nhiều mô hình thống kê và học máy.

- Xử lý ngôn ngữ tự nhiên và tiếp thị: Cải thiện phân tích cảm xúc, phân loại văn bản, phân khúc và nhắm mục tiêu khách hàng, tối ưu hiệu quả chiến dịch marketing nhờ mô hình tổng hợp.

Hạ tầng lưu trữ ổn định cho ứng dụng với giải pháp thuê VPS Vietnix

Khi triển khai các dự án học máy vào thực tế, một hạ tầng lưu trữ ổn định là yếu tố then chốt để đảm bảo mô hình phản hồi theo thời gian thực. Giải pháp thuê VPS tốc độ cao tại Vietnix mang đến các máy chủ ảo mạnh mẽ với đa dạng cấu hình cho ứng dụng. Dịch vụ cam kết uptime 99.9%, tự động sao lưu dữ liệu hàng tuần và cho phép toàn quyền quản trị. Hơn thế nữa, đội ngũ kỹ thuật Vietnix luôn túc trực 24/7, sẵn sàng hỗ trợ bạn giải quyết mọi sự cố kỹ thuật hệ thống một cách nhanh chóng nhất.

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

Những phương pháp ensemble learning phổ biến hiện nay là gì?

Ba nhóm kỹ thuật được dùng nhiều nhất là Bagging (như Random Forest), Boosting (như AdaBoost, XGBoost, Gradient Boosting) và Stacking, trong đó các mô hình con được kết hợp theo những cách khác nhau để cải thiện hiệu suất dự đoán.

Bagging trong ensemble learning hoạt động như thế nào?

Bagging sử dụng kỹ thuật bootstrap sampling để tạo nhiều tập dữ liệu con từ cùng một tập huấn luyện, huấn luyện riêng biệt nhiều mô hình (thường cùng loại) trên các tập này rồi kết hợp đầu ra bằng trung bình (hồi quy) hoặc bỏ phiếu đa số (phân loại) nhằm giảm phương sai và hạn chế overfitting.

Ensemble learning thường được dùng trong những bài toán nào?

Ensemble learning được áp dụng rộng rãi trong phân loại, hồi quy, phát hiện bất thường, xử lý ảnh, nhận dạng mẫu, bài toán y tế, tài chính, thương mại điện tử, nơi yêu cầu mô hình có độ chính xác cao và khả năng khái quát tốt trên dữ liệu thực tế.

Tóm lại, ensemble learning không chỉ giúp mô hình nâng cao độ chính xác và khả năng khái quát hóa, mà còn mang lại độ ổn định cần thiết khi triển khai trên dữ liệu thực tế. Việc hiểu rõ nguyên lý, ưu nhược điểm và các kỹ thuật phổ biến như bagging, boosting, stacking sẽ giúp bạn thiết kế những hệ thống học máy tin cậy hơn, tối ưu hiệu suất xử lý cho nhiều bài toán khác nhau.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày