Thuật toán Naive Bayes là gì? Ưu nhược điểm và ứng dụng của thuật toán Naive Bayes

Đã kiểm duyệt nội dung

Đánh giá

Trong quá trình trực tiếp triển khai các hệ thống phân loại văn bản và bộ lọc thư rác, mình đã ứng dụng thuật toán Naive Bayes như một giải pháp tối ưu nhờ tốc độ xử lý nhanh và hiệu quả trên các tập dữ liệu lớn. Thực tế kiểm thử cho thấy thuật toán này vẫn duy trì được độ chính xác cao trong các bài toán dự báo xác suất phức tạp. Bài viết này sẽ phân tích chi tiết nguyên lý hoạt động, ưu nhược điểm và các tình huống ứng dụng cụ thể để bạn tối ưu hóa mô hình Machine Learning.

Những điểm chính

Đối với mình, Naive Bayes không chỉ là một thuật toán phân loại cơ bản mà còn là nền tảng giúp hiểu sâu hơn về cách xác suất được ứng dụng trong machine learning. Để giúp bạn nắm rõ hơn về chủ đề này, bài viết dưới đây sẽ cung cấp các thông tin gồm:

- Định lý Bayes: Hiểu rõ Định lý Bayes cho phép tính xác suất xảy ra của một biến số ngẫu nhiên A khi đã biết biến cố liên quan B đã xảy ra.

- Khái niệm Naive Bayes: Hiểu rõ Naive Bayes là thuật toán phân loại xác suất, giúp định vị đúng vai trò và cách tiếp cận của nó so với các phương pháp khác.

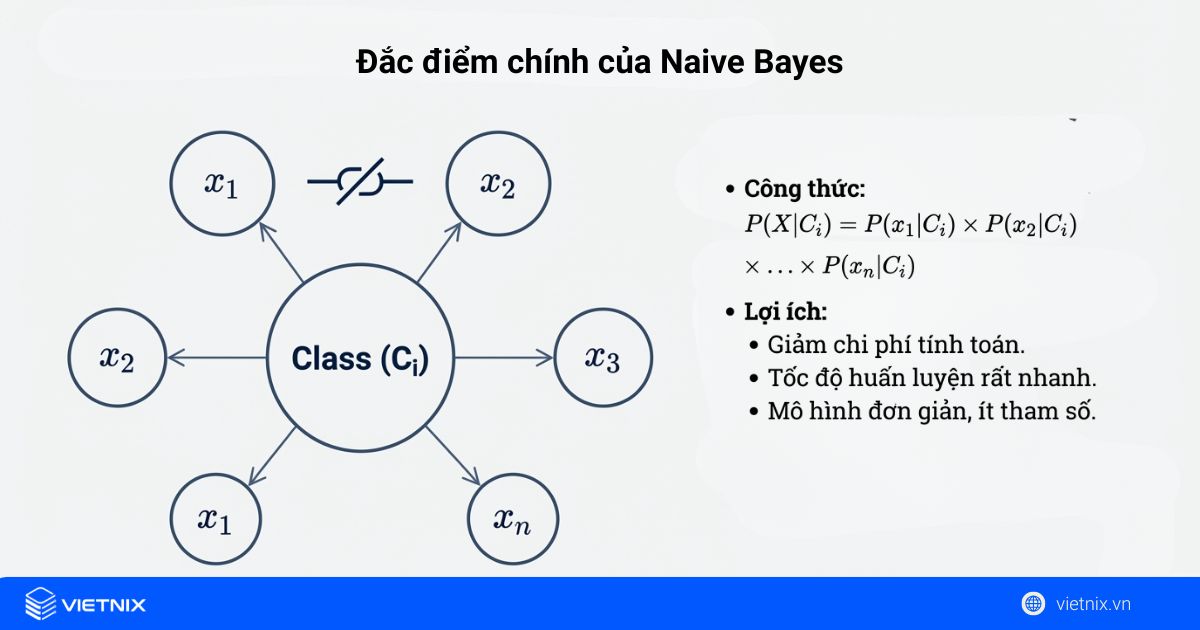

- Đặc điểm chính: Nắm được giả định độc lập có điều kiện, giúp lý giải tại sao thuật toán lại đơn giản, nhanh và hiệu quả trong các bài toán phân loại văn bản.

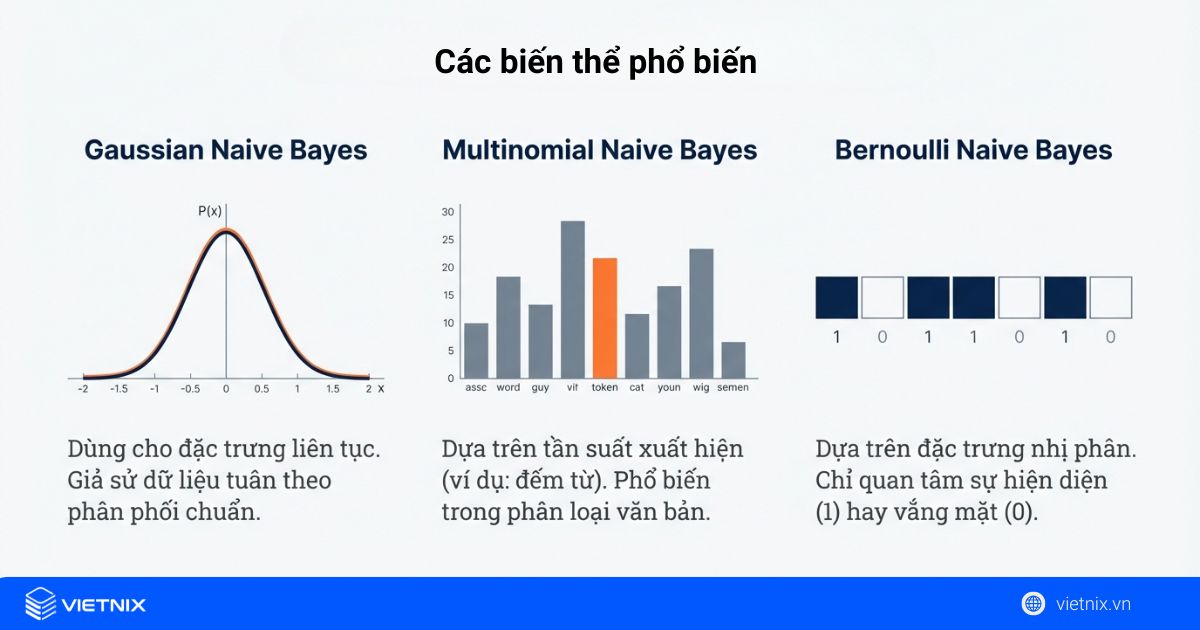

- Các biến thể phổ biến: Phân biệt được ba biến thể Gaussian, Multinomial và Bernoulli, giúp lựa chọn đúng mô hình cho từng loại dữ liệu để tối ưu hiệu quả.

- Ưu và nhược điểm: Tổng hợp các điểm mạnh và điểm yếu, giúp bạn đánh giá khách quan khi nào nên và không nên sử dụng thuật toán trong các dự án thực tế.

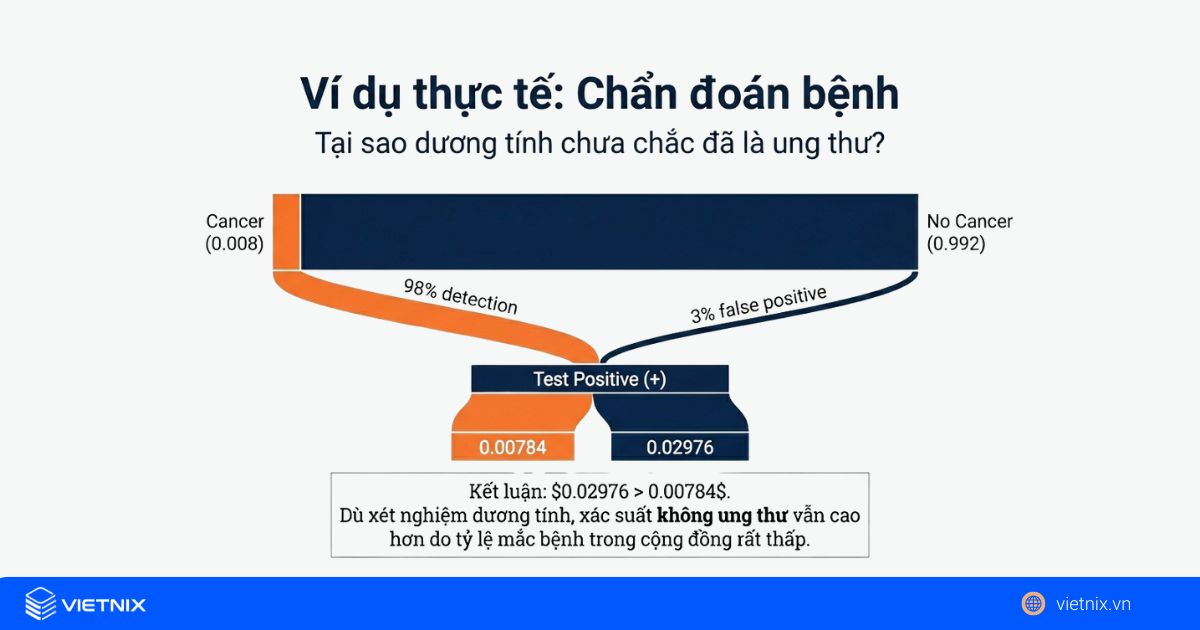

- Ví dụ thực tế: Tham khảo ví dụ về chẩn đoán bệnh, giúp hình dung rõ cách thuật toán áp dụng định lý Bayes để ra quyết định phân loại.

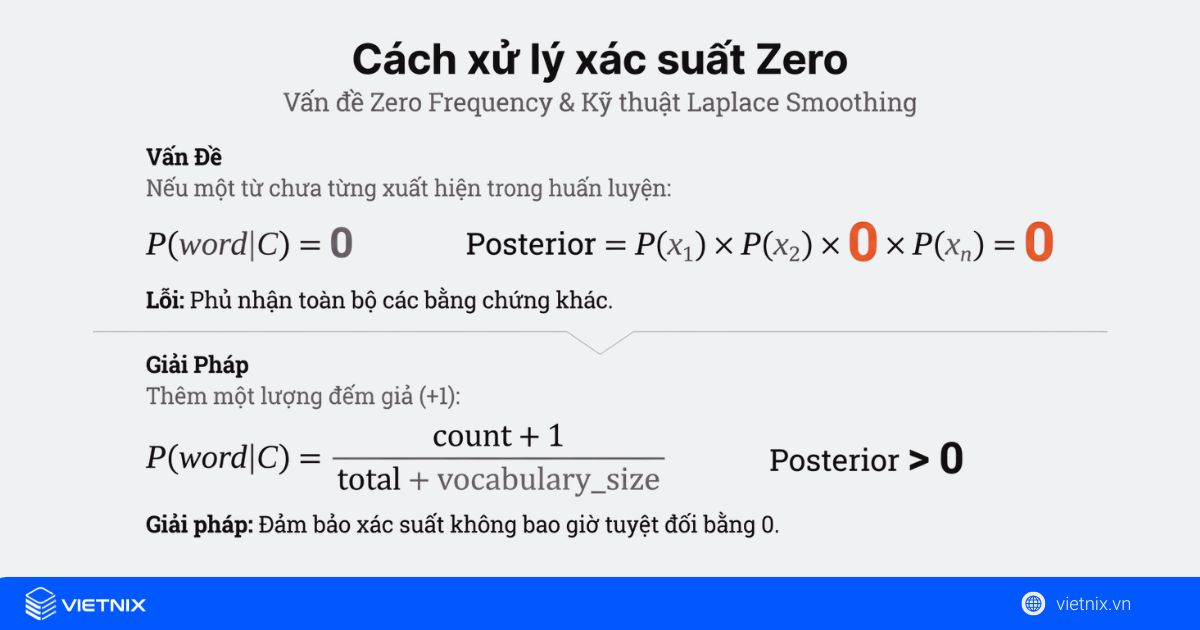

- Cách xử lý xác suất zero: Biết được vấn đề zero frequency và kỹ thuật làm mịn Laplace, giúp xử lý lỗi phổ biến để mô hình hoạt động ổn định hơn.

- So sánh với các thuật toán khác: Phân biệt rõ Naive Bayes với hồi quy logistic, Decision Trees và SVM, giúp bạn lựa chọn công cụ phù hợp nhất cho từng bài toán.

- Ứng dụng thực tiễn: Tìm hiểu các ứng dụng phổ biến như lọc thư rác và phân tích cảm xúc, giúp thấy rõ tính thực tiễn và sự hữu ích của thuật toán.

- Biết thêm Vietnix là nhà cung cấp dịch vụ hosting, VPS tốc độ cao, uy tín, chất lượng.

- Câu hỏi thường gặp: Giải đáp các thắc mắc liên quan đến thuật toán Naive Bayes.

Định lý Bayes là gì?

Định lý Bayes cho phép tính xác suất xảy ra của một biến cố A khi đã biết biến cố liên quan B đã xảy ra, với ký hiệu $P(A|B)$ và cách đọc xác suất của A nếu có B. Giá trị $P(A|B)$ được gọi là xác suất có điều kiện hay xác suất hậu nghiệm, vì xác suất này được suy ra sau khi đã xét đến thông tin xuất phát từ biến cố B.

Theo định lý Bayes, $P(A|B)$ phụ thuộc vào ba thành phần chính:

- Xác suất tiên nghiệm của A: Khả năng xảy ra của A khi chưa xét đến B, ký hiệu $P(A)$.

- Xác suất xảy ra của B: Khả năng B xảy ra một cách riêng lẻ, không gắn với A, ký hiệu $P(B)$.

- Likelihood: Xác suất để B xuất hiện khi A đã xảy ra, ký hiệu $P(B|A)$. Giá trị này thể hiện mức độ phù hợp giữa giả thuyết A và quan sát B.

Naive Bayes là gì?

Naive Bayes là một thuật toán học có giám sát (supervised learning) thường được áp dụng cho các bài toán phân loại, tiêu biểu như phân loại văn bản hay lọc thư rác. Cơ chế hoạt động dựa trên định lý Bayes, sử dụng các quy tắc về xác suất để gán một mẫu dữ liệu mới vào lớp phù hợp nhất.

Naive Bayes được xếp vào nhóm thuật toán sinh, nghĩa là mô hình học cách biểu diễn phân phối xác suất của dữ liệu đầu vào ứng với từng lớp nhãn. Cách tiếp cận này khác với các bộ phân loại mang tính phân biệt như hồi quy logistic, vốn tập trung trực tiếp vào việc học ranh giới quyết định giữa các lớp thay vì mô phỏng phân phối dữ liệu của từng lớp.

Với các bài toán phân loại văn bản, xử lý tập dữ liệu lớn hoặc xây dựng pipeline machine learning, tốc độ truy xuất và khả năng xử lý song song của hệ thống đóng vai trò rất quan trọng. Lúc này, lựa chọn một nền tảng như NVMe VPS tại Vietnix sẽ giúp tối ưu hiệu năng đọc/ghi, rút ngắn thời gian huấn luyện và đảm bảo quá trình vận hành mô hình diễn ra mượt mà, ổn định. Không những thế dịch vụ này còn đảm bảo uptime 99,99% và hỗ trợ kỹ thuật 24/7, giúp quá trình triển khai và vận hành mô hình diễn ra mượt mà, liên tục. Liên hệ ngay!

Website nhanh hơn – Bán được nhiều hàng hơn

- Chiếm lĩnh TOP Google, hút traffic.

- Mua sắm mượt mà, tăng tỷ lệ chốt đơn.

- Chuyên gia kỹ thuật đồng hành 24/7.

Những đặc điểm chính của các bộ phận Naive Bayes

Naive Bayes là một bộ phân loại dựa trên xác suất, ứng dụng định lý Bayes để tìm ra lớp có xác suất hậu nghiệm cao nhất cho một mẫu dữ liệu $X$ mới. Xác suất này được tính bằng công thức $P(X|C_i) \times P(C_i)$ đối với từng lớp $C_i$. Trong đó, $P(C_i)$ là xác suất tiên nghiệm của lớp và $P(X|C_i)$ là xác suất quan sát được mẫu $X$ biết rằng $X$ thuộc lớp $C_i$.

Để giảm thiểu khối lượng tính toán khi dữ liệu có quá nhiều chiều (nhiều đặc trưng), Naive Bayes đưa ra một giả định táo bạo: Các thuộc tính đầu vào hoàn toàn độc lập với nhau khi xét trên một lớp cụ thể. Nhờ đó, $P(X|C_i)$ được đơn giản hóa thành tích xác suất của từng thuộc tính riêng lẻ: $P(x_1|C_i) \times \dots \times P(x_n|C_i)$. Với mô hình ít tham số và cơ chế tính toán đơn giản, Naive Bayes có tốc độ huấn luyện và dự đoán cực kỳ nhanh, tỏ ra đặc biệt xuất sắc trong các bài toán phân loại văn bản, lọc thư rác và phân tích cảm xúc.

Những phân loại của các bộ phận Naive Bayes

Naive Bayes không chỉ là một mô hình đơn lẻ mà bao gồm nhiều biến thể, khác biệt chủ yếu ở cách chúng giả định về phân phối xác suất của các đặc trưng đầu vào. Ba loại phổ biến nhất bao gồm:

- Gaussian Naive Bayes: Chuyên dùng cho các đặc trưng mang giá trị số thực liên tục. Biến thể này giả định dữ liệu tuân theo phân phối chuẩn (normal distribution – đồ thị hình quả chuông).

- Multinomial Naive Bayes: Rất phù hợp khi các đặc trưng đại diện cho tần suất (ví dụ: số lần một từ xuất hiện trong văn bản). Đây là thuật toán quốc dân cho tác vụ phân loại văn bản.

- Bernoulli Naive Bayes: Được thiết kế riêng cho các đặc trưng nhị phân (0 và 1). Nó chỉ quan tâm đến việc một đặc trưng/từ vựng có xuất hiện hay không, thay vì đếm tần suất.

Ưu và nhược điểm của Naive Bayes

Đơn giản, triển khai dễ: Cấu trúc mô hình và cách ước lượng tham số của Naive Bayes rất thẳng nên dễ code, giải thích và phù hợp làm mô hình khởi đầu trong các khóa học ML/DS.

Hợp với dữ liệu nhiều chiều: Khi số đặc trưng rất lớn (như bag of words trong phân loại văn bản, lọc spam), nhiều model khác chật vật nhưng Naive Bayes vẫn cho kết quả tốt.

Không cần quá nhiều data: Ngay cả khi dữ liệu huấn luyện hạn chế, model vẫn hoạt động khá ổn, đặc biệt với đặc trưng dạng phân loại.

Khai thác được prior: Có thể đưa kiến thức tiên nghiệm vào mô hình và thường hoạt động ổn ngay cả khi số mẫu giữa các lớp mất cân bằng.

Giả định độc lập không thực tế: Cốt lõi của Naive Bayes là coi các đặc trưng độc lập có điều kiện theo lớp nhưng trong dữ liệu thật, các thuộc tính thường liên quan chặt chẽ. Điều này làm mô hình đôi khi dự đoán lệch so với thực tế.

Vấn đề zero frequency: Nếu một giá trị/thuộc tính chưa từng xuất hiện trong tập train, xác suất ước lượng cho trường hợp đó bằng 0, kéo xác suất hậu nghiệm về 0, làm mô hình gần như không gán mẫu đó cho lớp tương ứng.

Không nắm được tương tác đặc trưng: Mô hình chỉ ghép các xác suất điều kiện đơn lẻ, không biểu diễn rõ các tổ hợp thuộc tính có quan hệ mạnh với nhau và cũng không được tối ưu bằng các kỹ thuật tối ưu hóa phức tạp như nhiều thuật toán hiện đại khác.

Ví dụ về Naive Bayes

Xét bài tập Naive Bayes về chẩn đoán bệnh với hai lớp: “có ung thư” và “không ung thư”. Giả sử xác suất một người bất kỳ mắc ung thư là 0,008 nên P(cancer) = 0,008, khi đó P(nocancer) = 0,992. Ngoài ra, xác suất cho kết quả xét nghiệm dương tính nếu bệnh nhân thực sự bị ung thư là 0,98, còn nếu bệnh nhân không bị ung thư thì xác suất cho kết quả dương tính là 0,03, tức P(+|cancer) = 0,98 và P(+|nocancer) = 0,03.

Giả sử một bệnh nhân có kết quả xét nghiệm dương tính, bạn tính:

- P(+|cancer)P(cancer) = 0,98 x 0,008 = 0,00784

- P(+|nocancer)P(nocancer) = 0,03 x 0,992 = 0,02976

Rõ ràng 0,02976 lớn hơn nhiều so với 0,00784, nên xác suất tương ứng với trường hợp “không ung thư” chiếm ưu thế hơn. Vì vậy, dù xét nghiệm dương tính thì đánh giá theo Bayes vẫn nghiêng về khả năng bệnh nhân không mắc ung thư.

Cách khắc phục tình trạng xác suất điều kiện bằng zero

Khi huấn luyện mô hình, bạn có thể xảy ra tình huống trong tập dữ liệu không hề xuất hiện mẫu X nào thuộc lớp Ck mà lại có thuộc tính Fi nhận giá trị cụ thể vij, khiến xác suất điều kiện P(Fi = vij | Ck) bị ước lượng bằng 0. Nếu một mẫu mới mang đúng giá trị thuộc tính này, xác suất gán mẫu đó vào lớp Ck sẽ trở thành 0, dù các bằng chứng khác có thể được phân vào lớp Ck.

Để xử lý hiện tượng zero frequency problem, mô hình thường sử dụng kỹ thuật làm mịn, điển hình là Laplace smoothing, bằng cách điều chỉnh công thức ước lượng xác suất điều kiện sao cho mọi giá trị đều nhận được một lượng đếm giả, giúp loại bỏ xác suất bằng 0.

So sánh Naive Bayes với những thuật toán khác

| Thuật toán so sánh | Khi nào tốt hơn / kém hơn Naive Bayes | Điểm mạnh – yếu nổi bật so với Naive Bayes | Nhận xét tổng quát |

| Hồi quy logistic | Thường cho kết quả tốt hơn Naive Bayes khi các đặc trưng có quan hệ phụ thuộc lẫn nhau, không thỏa giả định độc lập có điều kiện. | Mô hình phân biệt mạnh cho phân loại nhị phân, nhưng phức tạp và tốn tính toán hơn. Naive Bayes đơn giản, huấn luyện nhanh, đặc biệt hữu ích cho phân loại văn bản với tập dữ liệu lớn. | Nếu ưu tiên độ chính xác trong bối cảnh đặc trưng tương quan, hồi quy logistic thường là lựa chọn tốt hơn; nếu cần triển khai nhanh, nhẹ, Naive Bayes vẫn rất thực dụng. |

| Decision Trees | Phù hợp khi cần mô hình hóa quan hệ phức tạp giữa đặc trưng và nhãn, số lớp không quá nhiều, dữ liệu có thể thiếu. | Dễ diễn giải, bắt được cấu trúc phân nhánh phức tạp; tuy nhiên có nguy cơ overfit và có thể kém ổn định với biến động dữ liệu, trong khi Naive Bayes thường ổn định và nhanh hơn. | Trong một số miền như robot học, thị giác máy tính hoặc hiện tượng hiếm gặp, Naive Bayes và k-NN đôi khi cho hiệu quả tốt hơn Decision Trees |

| Support Vector Machines (SVM) | Thường vượt trội Naive Bayes trên nhiều bài toán phân loại văn bản, đặc biệt khi ranh giới phân lớp phức tạp và dữ liệu độ phân giải cao. | Mạnh trong không gian đặc trưng cao, mô hình hóa tốt các biên phân tách phức tạp nhưng đòi hỏi tài nguyên tính toán lớn, tuning tham số khó hơn. Naive Bayes vẫn giữ lợi thế về tốc độ và đơn giản khi làm việc với tập dữ liệu rất lớn. | Các nghiên cứu chỉ ra SVM thường đạt độ chính xác cao hơn nói chung, nhưng các biến thể như Multinomial và Complement Naive Bayes vẫn rất cạnh tranh trong phân loại tin tức và bài báo. |

Với kinh nghiệm triển khai hạ tầng tại Vietnix, mình luôn khuyên bạn bắt đầu với Naive Bayes như một mô hình cơ sở. Nếu hiệu suất không đạt kỳ vọng, lúc đó bạn mới nên cân nhắc chuyển sang các mô hình tiêu tốn tài nguyên hơn như SVM hay Random Forest.

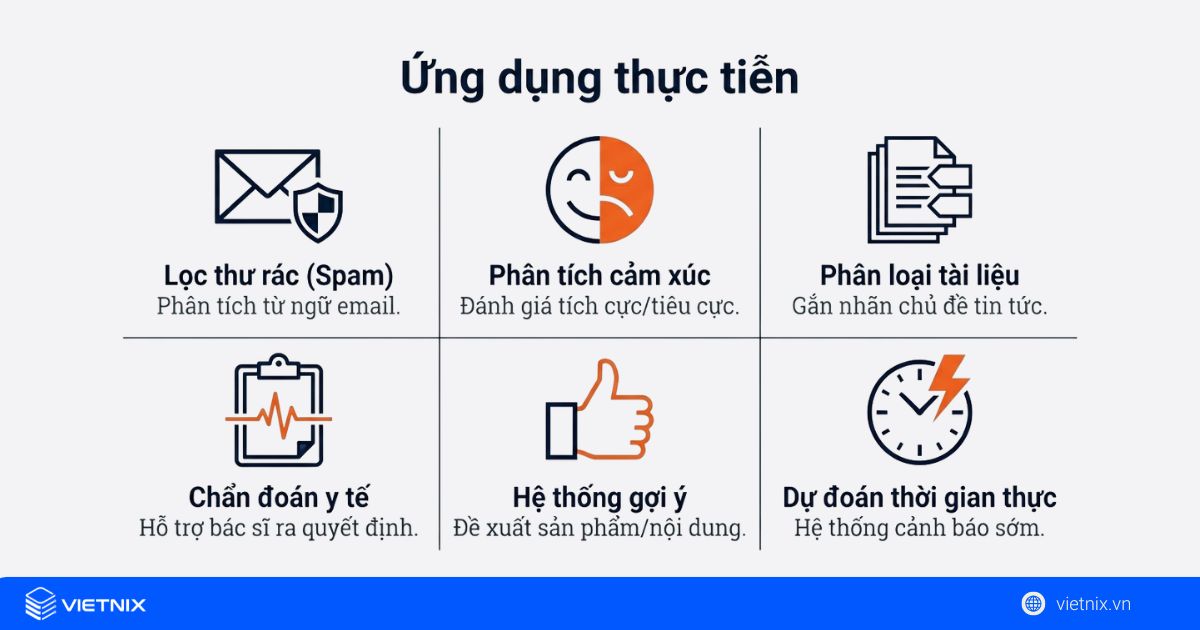

Những ứng dụng thực tiễn của Naive Bayes

Naive Bayes được dùng rộng rãi để giải các bài toán phân loại nhờ mô hình đơn giản, linh hoạt và cho kết quả tốt trên nhiều loại dữ liệu. Dưới đây là những ứng dụng Naive Bayes phổ biến:

- Phát hiện thư rác: Được tích hợp trong các hệ thống email để phân loại thư thành spam hoặc không spam bằng cách phân tích từ ngữ, mẫu nội dung và các đặc trưng khác trong email.

- Phân tích cảm xúc: Hỗ trợ doanh nghiệp tự động gán nhãn cảm xúc cho đánh giá, bình luận hoặc bài đăng mạng xã hội (tích cực, tiêu cực, trung tính), từ đó cải thiện sản phẩm và dịch vụ.

- Phân loại tài liệu: Được dùng để tự động gắn nhãn chủ đề cho tin tức, bài báo, tài liệu… giúp tổ chức nội dung, tối ưu tìm kiếm và cải thiện trải nghiệm người dùng.

- Hỗ trợ chẩn đoán y tế: Áp dụng để ước lượng khả năng mắc bệnh dựa trên triệu chứng và hồ sơ bệnh án, đóng vai trò như công cụ gợi ý, hỗ trợ bác sĩ trong quá trình ra quyết định.

- Dự đoán trong thời gian thực: Nhờ tốc độ xử lý nhanh, Naive Bayes phù hợp với các hệ thống cần phản hồi tức thì, như hệ thống cảnh báo sớm, phát hiện bất thường hoặc dự đoán hành vi theo thời gian thực.

- Dự đoán đa lớp: Có thể xử lý bài toán nhiều lớp, cho phép dự đoán đồng thời nhiều nhãn/giả thuyết khác nhau thay vì chỉ giới hạn ở phân loại nhị phân.

- Hệ thống gợi ý: Được sử dụng trong các module gợi ý sản phẩm, nội dung, phim, bài viết,… bằng cách ước lượng xác suất người dùng quan tâm đến từng lựa chọn dựa trên lịch sử tương tác.

Vietnix – Nhà cung cấp dịch vụ hosting, VPS tốc độ cao, uy tín, chất lượng

Vietnix là nhà cung cấp dịch vụ thuê hosting website và máy ảo VPS dành cho doanh nghiệp, tập trung vào hiệu năng, độ ổn định và khả năng mở rộng theo nhu cầu thực tế. Các giải pháp được tối ưu về tốc độ xử lý, khả năng truy xuất dữ liệu nhanh và hệ thống bảo mật nhiều lớp, phù hợp cho website, ứng dụng và các hệ thống cần vận hành liên tục. Bên cạnh đó, đội ngũ kỹ thuật hỗ trợ 24/7 giúp xử lý nhanh các sự cố phát sinh, đảm bảo hệ thống hoạt động ổn định, hạn chế gián đoạn và đáp ứng tốt yêu cầu vận hành dài hạn. Liên hệ ngay!

Thông tin liên hệ:

- Website: https://vietnix.vn/

- Hotline: 1800 1093

- Email: sales@vietnix.com.vn

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

Câu hỏi thường gặp

Làm sao cài đặt thuật toán Naive Bayes trong Python?

Để code thuật toán Naive Bayes python, bạn có thể triển khai nhanh chóng bằng thư viện scikit-learn, chỉ cần chuẩn bị dữ liệu X, y, tách train/test rồi dùng các class như GaussianNB, MultinomialNB hoặc BernoulliNB để huấn luyện và dự đoán. Ví dụ cơ bản là nạp dữ liệu, gọi model = MultinomialNB() rồi model.fit(X_train, y_train) và model.predict(X_test) để tạo bộ phân loại đầy đủ.

Gaussian Naive Bayes là gì?

Gaussian Naive Bayes là biến thể của Naive Bayes dùng cho dữ liệu đặc trưng liên tục, với giả định mỗi đặc trưng trong từng lớp tuân theo phân phối chuẩn. Biến thể này thường được áp dụng trong các bài toán phân loại khi dữ liệu có dạng số thực, ví dụ đo lường, tín hiệu, đặc trưng thống kê,… thay vì dữ liệu đếm tần suất.

Naive Bayes thường được ứng dụng trong những bài toán nào?

Naive Bayes được dùng nhiều trong phân loại văn bản, lọc email spam, phân tích cảm xúc, phân loại tin tức, chẩn đoán bệnh và các bài toán dự đoán đa lớp với dữ liệu nhiều chiều. Nhờ tốc độ xử lý nhanh và mô hình đơn giản, nó rất phù hợp làm baseline và triển khai trong các hệ thống thực tế yêu cầu phản hồi nhanh.

Thuật toán SVM là gì?

SVM (Support Vector Machine) là thuật toán phân loại dựa trên việc tìm siêu phẳng phân tách tối ưu giữa các lớp trong không gian đặc trưng. Trong nhiều bài toán văn bản, SVM thường cho độ chính xác cao hơn nhưng tính toán khó hơn.

Thuật toán SVR là gì?

SVR (Support Vector Regression) là phiên bản dùng cho bài toán hồi quy của SVM, thay vì phân loại. Thay cho việc dự đoán nhãn lớp, SVR dự đoán giá trị liên tục bằng cách tìm hàm xấp xỉ dữ liệu với sai số trong một ngưỡng cho phép, vẫn dựa trên ý tưởng siêu phẳng và vector hỗ trợ tương tự SVM.

Định lý Bayes là gì?

Định lý Bayes là một kết quả cơ bản trong lý thuyết xác suất, cho phép ta cập nhật xác suất của một giả thuyết A sau khi quan sát một bằng chứng B thông qua xác suất có điều kiện P(A∣B). Định lý này trở thành nền tảng cho nhiều phương pháp suy luận xác suất và thuật toán học máy như Naive Bayes, nơi mô hình dựa vào các xác suất tiên nghiệm và likelihood để đưa ra quyết định phân loại tối ưu dưới góc nhìn xác suất.

Code thuật toán Naive Bayes trong Python như thế nào?

Bạn có thể triển khai Naive Bayes nhanh bằng thư viện scikit‑learn: Chuẩn bị dữ liệu X, y, chia train/test rồi dùng các lớp GaussianNB, MultinomialNB hoặc BernoulliNB để huấn luyện và dự đoán. Ví dụ model = MultinomialNB(); model.fit(X_train, y_train); model.predict(X_test) cho một bộ phân loại Naive Bayes hoàn chỉnh trong Python.

Có thể áp dụng công thức Naive Bayes trong thực tế như thế nào?

Trong thực tế, bạn chỉ cần ước lượng xác suất của từng lớp và xác suất xuất hiện của các đặc trưng từ tập train, sau đó với mỗi mẫu mới, mô hình tính điểm cho từng lớp dựa trên các xác suất này và gán mẫu vào lớp có điểm cao nhất, nên người dùng hầu như không phải đụng trực tiếp vào công thức mà chỉ cần dùng thư viện như scikit‑learn.

Mô hình Naive Bayes là gì?

Mô hình Naive Bayes là một mô hình phân loại có giám sát dựa trên định lý Bayes, trong đó giả định các đặc trưng đầu vào độc lập với nhau khi đã biết lớp (giả định “naive”). Mô hình ước lượng xác suất hậu nghiệm của từng lớp dựa trên xác suất tiên nghiệm của lớp và xác suất xuất hiện của từng đặc trưng theo lớp, rồi gán mẫu dữ liệu vào lớp có xác suất lớn nhất.

Thuật toán Naive Bayes là một lựa chọn lý tưởng để khởi đầu với các bài toán phân loại nhờ sự kết hợp giữa mô hình đơn giản, tốc độ xử lý nhanh và hiệu quả cao trên dữ liệu nhiều chiều như văn bản, log hệ thống hay dữ liệu giao dịch. Khi được áp dụng đúng bối cảnh và hiểu rõ giả định độc lập đặc trưng, thuật toán Naive Bayes không chỉ phù hợp làm baseline so sánh mà còn đủ mạnh để triển khai trực tiếp trong thực tế, từ lọc spam, phân tích cảm xúc cho đến các hệ thống dự đoán thời gian thực.

THEO DÕI VÀ CẬP NHẬT CHỦ ĐỀ BẠN QUAN TÂM

Đăng ký ngay để nhận những thông tin mới nhất từ blog của chúng tôi. Đừng bỏ lỡ cơ hội truy cập kiến thức và tin tức hàng ngày